本文主要是介绍MWC 2024丨生成式AIGC成为最大亮点—美格智能携手阿加犀推出多感知融合VSLAM解决方案,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

2024世界移动通信大会盛况空前,AI成为最大亮点。2月28日,美格智能携手阿加犀,将算力模组的硬件优势与AI优化部署技术相结合,在MWC展会现场展示了基于高算力AI模组的多感知融合VSLAM解决方案。这一创新性方案可应用于智能机器人与低速无人驾驶场景,助力扩展智能机器人生态系统。

▌VSLAM是什么

VSLAM是一种结合了人工智能和3D视觉技术的导航技术,VSLAM通过安装在自主移动机器人(AMR)上的视觉相机采集数据信息,生成周边区域所有物体的实时3D地图。

与其他导航技术相比,VSLAM是直接用机器的摄像头检测和跟踪环境中的自然特征,不需要磁条、二维码和反射板等额外的参照物,就能使AMR动态适应周围环境,规划通往目标地点最安全、最高效的路线,为移动机器人在多样化环境中的应用提供了一种更安全、稳定和智能的解决方案。该技术可广泛应用于智能机器人、无人驾驶、元宇宙、游戏等领域。

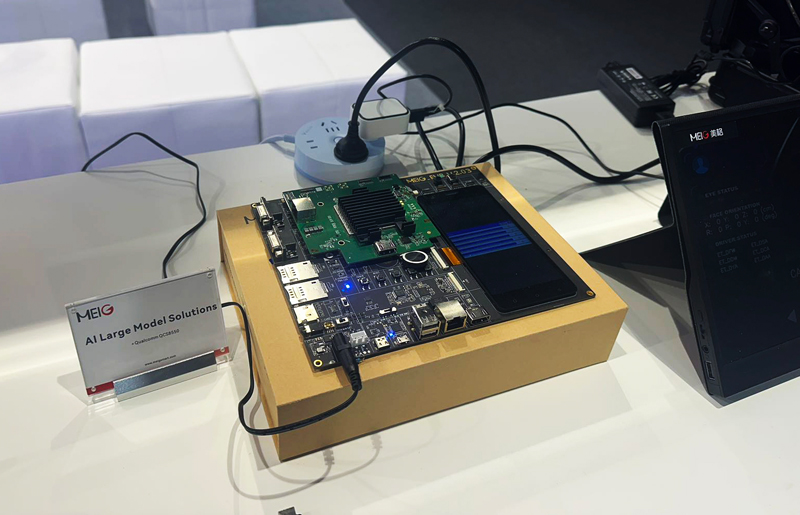

▲ MWC 2024现场方案演示

▌多感知融合VSLAM解决方案

VSLAM技术涉及的复杂的视觉计算及高难度的系统集成能力,对于产品的算力和响应速度有着极高的要求,这限制了该项技术的规模化应用。基于上述难点与行业需求,美格智能携手阿加犀推出了多感知融合VSLAM解决方案,面向机器人行业,突破了机器人系统软硬件之间的协同瓶颈,显著提升VSLAM方案的整体性能和效率。

该方案基于美格智能的高配置硬件设备——高算力AI模组SNM970,模组内置高通®QCS8550芯片,可为机器人系统提供高速、低功耗的AI计算平台,有效地解决了端侧算力不足的难题。同时,结合了阿加犀独创的融合操作系统能力与AI优化部署技术,在视觉相机上搭载阿加犀改进的VSLAM算法,实现对周围环境的3D建模,生成机器人运行所需导航地图,帮助机器人更好判断自身在环境中的位置,实现高精度导航。

此外,借助阿加犀高性能SoC调度能力,充分利用高算力AI模组的CPU、GPU异构计算能力对VSLAM算法进行加速,全面提升设备的AI性能和执行效率,让机器人快速完成实时建图、定位、智能避障等任务,满足商业、工业等不同场景的应用需求。

基于多感知融合VSLAM解决方案,智能机器人能够在动态场景下快速实现更优秀的自主定位与导航,未来结合视觉AI分析,还能进一步提升场地适应性与系统稳定性,高效完成智能配送、清洁、割草、巡检、低速无人驾驶等多场景任务。该方案有望推动美格智能高算力AI模组在商用服务机器人领域的应用,加速机器人技术与行业需求深度融合,助力智能机器人在更多场景中大规模落地。

▌高算力AI模组助力机器人技术突破

作为算力基础和终端智能化的关键器件,算力模组能够为海量碎片化物联网应用场景提供稳定的通信能力和强大的端侧算力,让终端开发者能够利用标准化的算力模组,以更低成本、更短流程的方式完成多种机器人算法与应用部署,助力机器人技术突破。

SNM970的AI算力高达48Tops,能轻松匹配服务机器人在算力方面的高要求,内置高通神经网络处理单元高通®Hexagon™ 处理器,能为整个系统提供开创性的AI性能。支持Wi-Fi 7、蓝牙5.3,以及2x2 Wi-Fi MIMO连接,带来更加稳定、畅快的网络体验。SNM970模组还配备了丰富的外围接口,满足多方位的开发需求,帮助开发者以AI模组的形式将语音识别、机器视觉、导航、定位、避障和多模态感知技术通过各种传感器植入到设备中,实现更加自然、流畅的人机交互,让机器人“眼明脑快”。

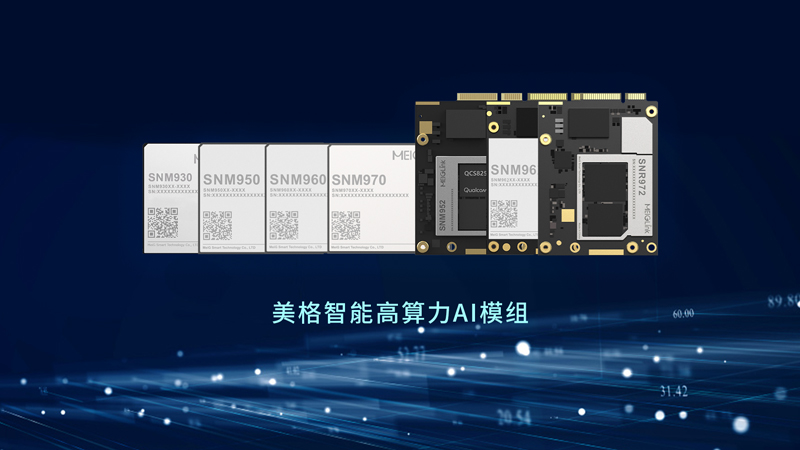

美格智能建立了完善的高算力AI模组产品线,包括SNM930、SNM950、SNM960、SNM970、SNM952、SNM962、SNM972等型号,AI算力覆盖14Tops~48Tops,涵盖入门级、中端、旗舰级多层次算力水平,以及LGA和PCle插槽式两种封装系列,适应不同行业和应用场景需求,为端侧AI提供通用智算底座。

AIoT时代,物联网边界不断拓展,AI技术脱虚向实。迎接新时期巨大的变革与机遇,美格智能愿与更多合作伙伴携手,以澎湃算力助力端侧AI发展,让AI融入千行百业,为社会创造更大的价值。

这篇关于MWC 2024丨生成式AIGC成为最大亮点—美格智能携手阿加犀推出多感知融合VSLAM解决方案的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!