本文主要是介绍Chain-of-Thought Prompting Elicits Reasoning in Large Language Models导读,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

通过生成一系列中间推理步骤(即“思维链”)显著提高大型语言模型进行复杂推理的能力

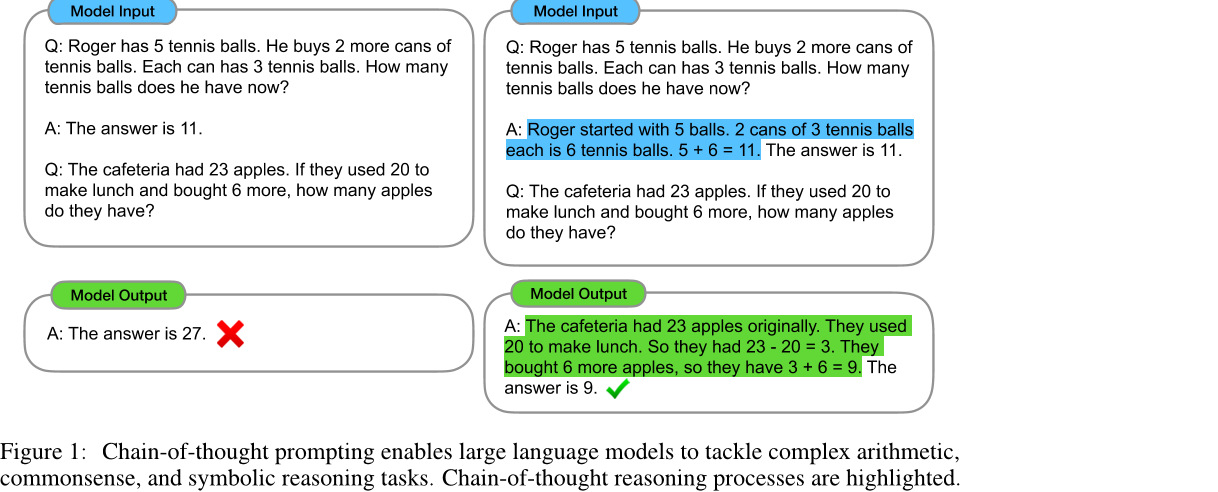

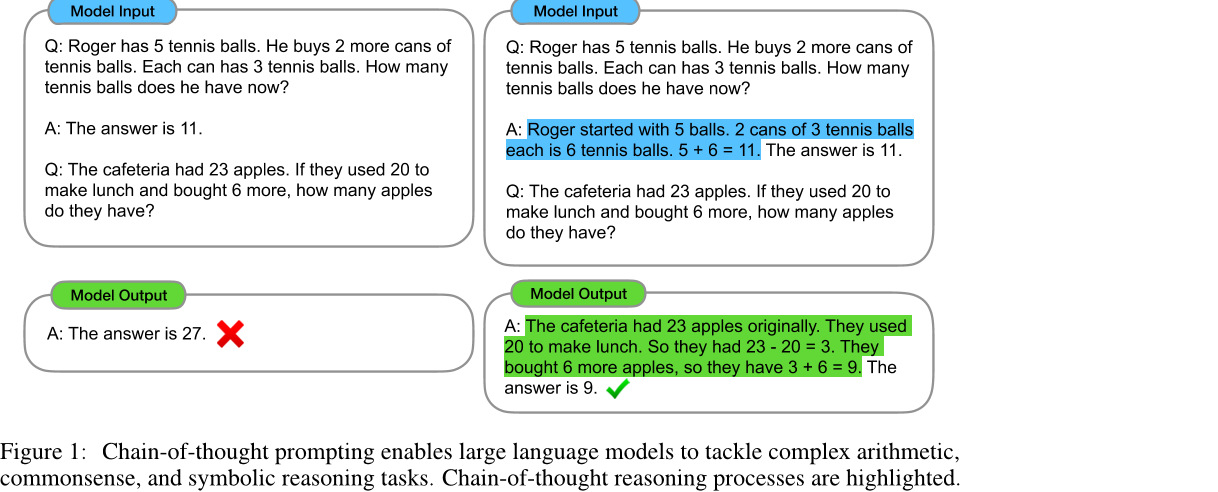

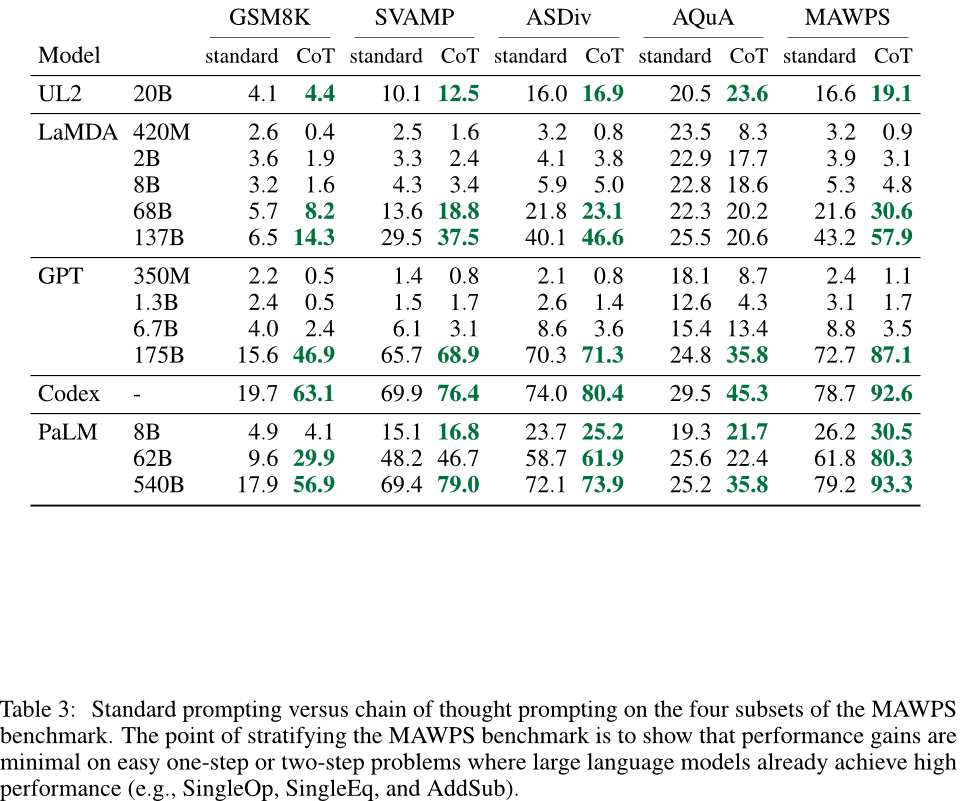

这篇论文探讨了如何通过生成一系列中间推理步骤(即“思维链”)显著提高大型语言模型进行复杂推理的能力。研究人员使用一种简单的方法——思维链提示法——提供一些思维链示例作为提示,发现这种方法可以使足够大的语言模型自然地获得这种推理能力。实验结果表明,在三个大型语言模型上进行测试时,思维链提示法可以显著提高在算术、常识和符号推理任务上的表现。例如,仅使用八个思维链示例就可以将PaLM 540B的语言模型准确率提升到GSM8K基准测试中的最佳水平,甚至超过了经过微调的GPT-3模型。

论文方法

方法描述

该论文提出了一种名为“chain-of-thought prompting”的方法,旨在让语言模型能够生成一系列连贯的中间推理步骤,最终得出问题的答案。这种方法是通过提供一些示范性的例子来训练模型,并使用少量的提示来引导模型生成链式思维过程。例如,在数学问题中,可以将问题分解为多个子问题并逐步求解,最后给出答案。

方法改进

与传统的基于任务特定微调的方法相比,“chain-of-thought prompting”具有以下优点:

-

可以处理多步推理问题:通过将问题分解成多个子问题,模型可以更有效地分配计算资源来解决问题。

-

提供可解释性窗口:链式思维过程提供了模型如何得出某个答案的解释,可以帮助调试模型在推理路径上出错的地方。

-

可应用于多种任务:链式思维推理可用于解决各种人类可以通过语言解决的任务,如数学问题、常识推理和符号操作等。

-

易于实现:只需将一些示例性的链式思维序列作为少数样本提示输入到大型预训练的语言模型中即可实现。

解决的问题

该方法主要解决了语言模型在处理需要多步推理的问题时表现不佳的问题。通过引入链式思维推理,模型可以更好地理解和解决这些问题,从而提高其性能。此外,该方法还提供了可解释性和可扩展性,使其适用于各种不同的任务和应用场景。

论文实验

本文主要介绍了针对数学和常识推理问题的链式思维提示技术在不同规模的语言模型中的应用效果,并对其进行了多组对比实验。具体来说,本文涉及了以下四个方面的实验:

-

数学问题解决能力实验:本实验旨在探讨语言模型使用链式思维提示技术在解决数学问题方面的能力。实验结果表明,链式思维提示技术能够显著提高语言模型在解决复杂数学问题上的表现,尤其是在需要多个步骤才能得出答案的问题上。此外,该技术的效果随着模型规模的增加而逐渐增强。

-

常识推理实验:本实验旨在研究链式思维提示技术在解决常识推理问题上的效果。实验结果显示,链式思维提示技术能够显著提高语言模型在解决各种类型的常识推理问题上的表现,尤其是对于需要多个步骤才能得出答案的问题。

-

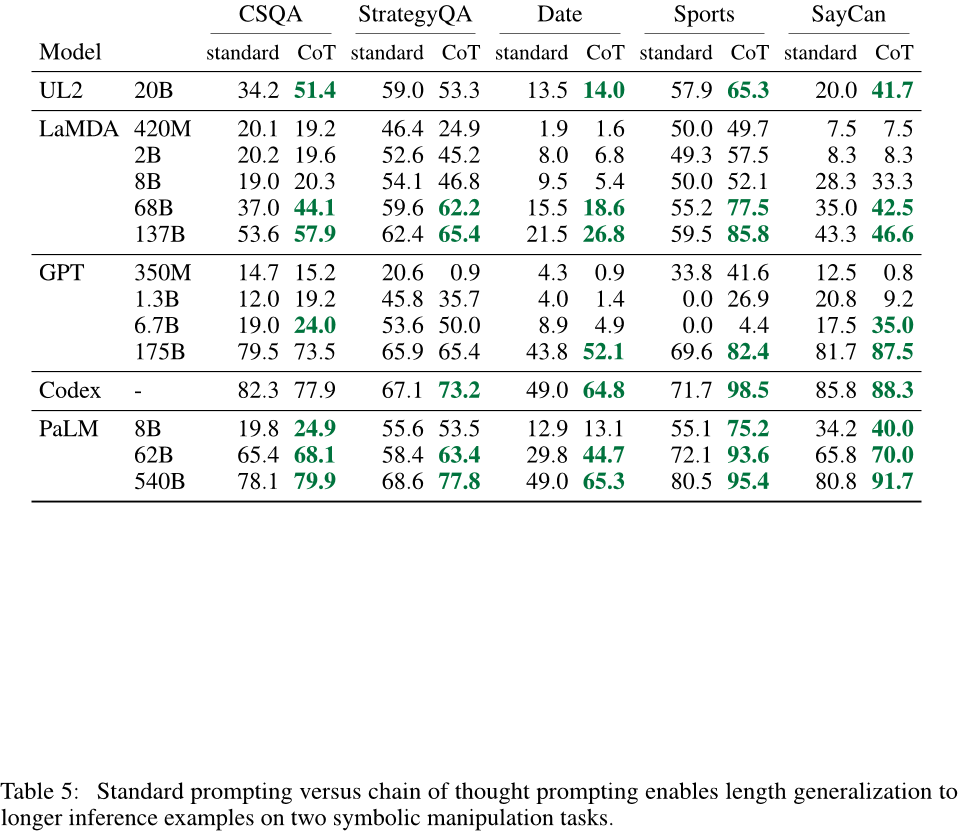

符号推理实验:本实验旨在探究链式思维提示技术在解决符号推理问题上的效果。实验结果表明,链式思维提示技术能够帮助语言模型更好地理解和处理符号推理问题,从而实现更好的解决方案。

-

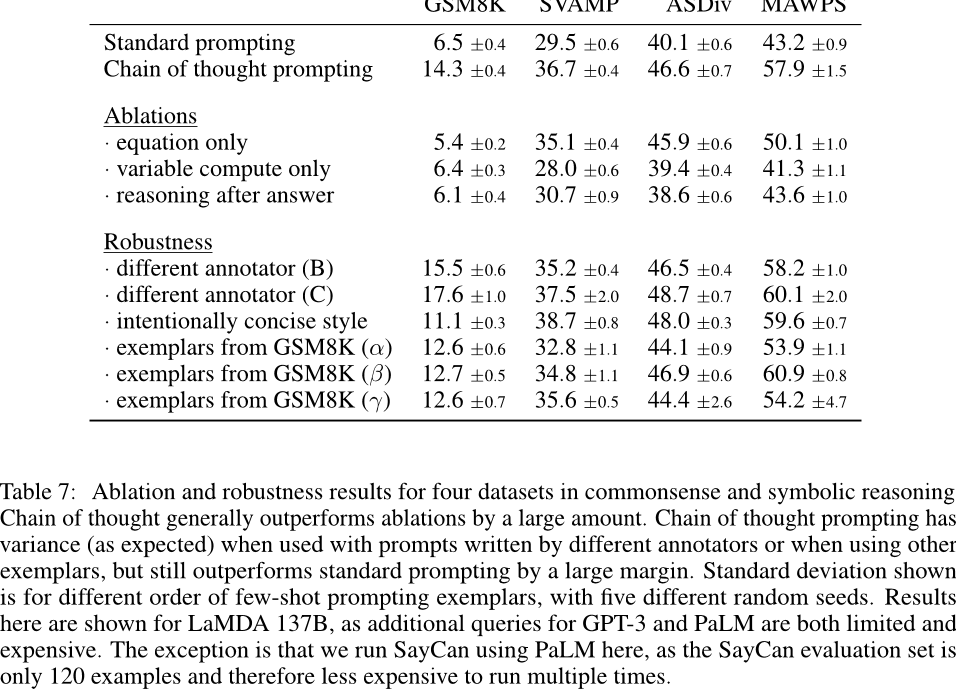

鲁棒性测试实验:本实验旨在评估链式思维提示技术在面对不同标注者、不同数据集以及不同模型规模时的表现。实验结果表明,链式思维提示技术对不同的数据集和模型规模具有较好的鲁棒性,且其表现不受标注者的影响。

综上所述,本文通过多项实验证明了链式思维提示技术在解决数学、常识推理和符号推理问题上的有效性,并证明了该技术在不同数据集和模型规模下的鲁棒性。这些实验结果为将链式思维提示技术应用于实际场景提供了有力的支持。

论文总结

文章优点

-

论文提出了一种简单而广泛适用的方法——链式思维提示(chain-of-thought prompting),用于增强大型语言模型的推理能力。

-

通过实验证明,链式思维提示能够显著提高大型语言模型在算术、常识和符号推理等任务上的表现,并且比传统的提示方法具有更强的泛化能力和更小的数据需求。

-

研究结果表明,链式思维提示是一种有效的工具,可以扩展大型语言模型的能力范围,进一步激发了使用自然语言处理技术解决复杂问题的研究方向。

方法创新点

-

提出了链式思维提示这一新的提示方式,通过生成一系列中间自然语言推理步骤来引导模型完成推理任务。

-

在实验中,将链式思维提示与标准提示进行了比较,证明了其优越性和普适性。

-

这一方法不需要大规模训练数据集,也不需要针对每个新任务单独微调模型,因此具有很大的应用潜力。

未来展望

-

链式思维提示方法的成功启示我们,可以通过更加复杂的提示方式来提高大型语言模型的推理能力。

-

可以探索如何在更小的语言模型上实现推理能力,并研究如何更好地利用合成数据或零样本推理等技术来降低注释成本。

-

可以进一步研究如何使链式思维提示与其他提示方法相结合,以提高大型语言模型的表现。

这篇关于Chain-of-Thought Prompting Elicits Reasoning in Large Language Models导读的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[论文笔记]Making Large Language Models A Better Foundation For Dense Retrieval](https://img-blog.csdnimg.cn/img_convert/6dbbf911e7e57daa6ac5366f311e3e68.png)