本文主要是介绍使用Brainwash人头数据集训练SSD_MobilenetV1训练自己的模型,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

关于Brainwash数据集

Brainwash数据集是一个密集人头检测数据集,拍摄的是在一个咖啡馆里出现的人群,然后对这群人进行标注而得到的数据集。包含三个部分,训练集:10769张图像81975个人头,验证集:500张图像3318个人头。测试集:500张图像5007个人头。

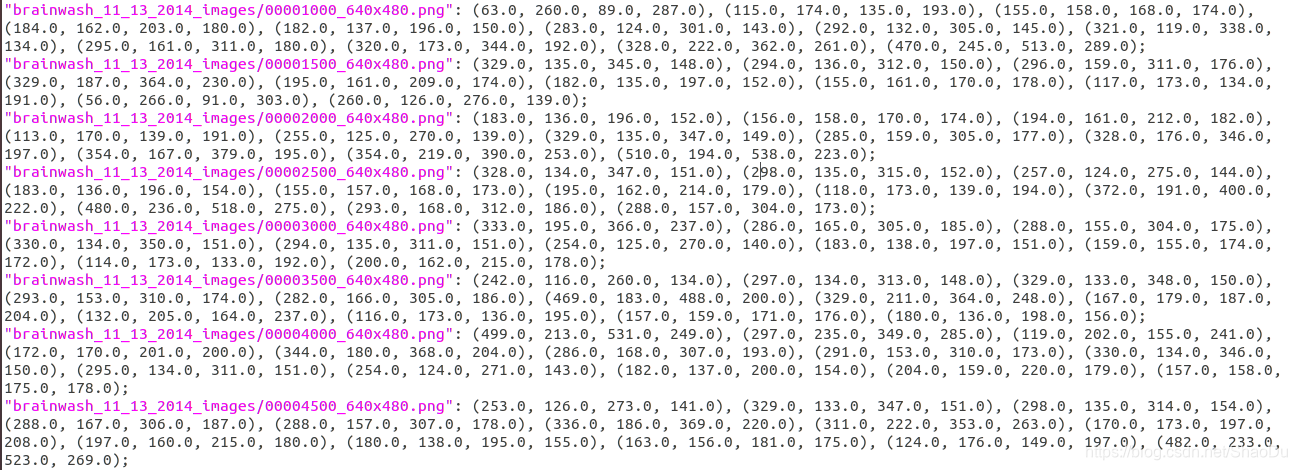

对于此数据集,其中brainwash_test.idl、brainwash_train.idl和brainwash_val.idl分别是对应的测试集、训练集和验证集的坐标文本。

通过上图可以发现该数据集以及把人头信息标注的很明显,但是在其中不乏有一些没有人头信息的图片 ,所以在尽心数据集操作时要仔细关注它的影响。

Brainwash人头数据集转VOC格式

对于voc数据集格式,我们可以很清楚的知道里面的逻辑结构,这里我就不详细介绍了,尚未了解的可以参考:VOC数据集格式详解

但是有一点需要注意的是在进行数据集转换的时候图片谨记需要6位的命名方式

下面进行制作Voc数据集

首先,进行图片的提取。因为brainwash数据集已将有文本将图片相关坐标信息保存了,而且划分好训练、测试和验证,但是因为在其中有图片没有人头,这里我没有考虑该负样本对最终模型的影响,分别读取brainwash_test.idl、brainwash_train.idl和brainwash_val.idl三个文档,获得有人头坐标信息的图片名字,保存到列表,然后根据列表中的名字信息,经图片分别提取到指定的文件夹。

import os

from PIL import Imageidl_file_dir = "/home/lf/桌面/brainwash/brainwash_val.idl"

imgFile="/home/lf/桌面/train/train3"if not os.path.exists(imgFile):os.mkdir(imgFile)f1=open(idl_file_dir,'r+')

lines=f1.readlines()lst1=[]

lst2=[]

lst3=[]

for i in range(len(lines)):line=lines[i]line = line.replace(":", ";")if line.split(";")[1]!="\n":img_dir=line.split(";")[0]img_dir=img_dir.replace('"',"")dirs=img_dir.split("/")[0]img_name=img_dir.split("/")[1]if dirs=="brainwash_10_27_2014_images":lst1.append(img_name)print(lst1)elif dirs=="brainwash_11_13_2014_images":lst2.append(img_name)else:lst3.append(img_name)

img_dir1="/home/lf/桌面/brainwash/brainwash_10_27_2014_images"

img_dir2="/home/lf/桌面/brainwash/brainwash_11_13_2014_images"

img_dir3="/home/lf/桌面/brainwash/brainwash_11_24_2014_images"# print(lst1)

# for i in lst1:

# print(i[:-1])

# im=Image.open("/home/lf/桌面/brainwash/brainwash_10_27_2014_images/{}".format(i))

# im.save(imgFile+"/{}".format(i))

# im.close()# for i in lst2:

# print(i[:-1])

# im=Image.open("/home/lf/桌面/brainwash/brainwash_11_13_2014_images/{}".format(i))

# im.save(imgFile+"/{}".format(i))

# im.close()for i in lst3:print(i[:-1])im=Image.open("/home/lf/桌面/brainwash/brainwash_11_24_2014_images/{}".format(i))im.save(imgFile+"/{}".format(i))im.close()

然后经获得的图片名分别转成6位的VOC格式,这里因为训练、测试和验证我保存的不是一个文件夹(因为可能有图片名字重复的),所以我先将图片给转成对于格式后,在全部转到一个JPEGImages文件夹下

#将图片转成jpg格式,这里没必要写的,因为在后面改名的时候就直接改成jpg格式了

import glob

import os

import cv2

from PIL import Imageurl = '/home/lf/桌面/img/JPEGImages2'

img_list=os.listdir(url)

print(sorted(img_list))#进行排序好,为后面更改名字作准备#将png格式的图片转换成jpg格式

for name in img_list:prename=name.split(".")[0]src=cv2.imread("/home/lf/桌面/img/JPEGImages2/"+name)cv2.imwrite("/home/lf/桌面/img/jnwe2/"+prename+'.jpg',src)

cv2.waitKey(0)# url2 = '/home/lf/桌面/JPEGImages2'

# img_list2=os.listdir(url2)

# for name in img_list2:

# print(name)

# prename=name.split(".")[0]

# src=cv2.imread("/home/lf/桌面/JPEGImages2/"+name)

#

# cv2.imwrite("/home/lf/桌面/jnwe2/"+prename+'.jpg',src)

# cv2.waitKey(0)

因为训练集中的图片都是png格式,所以后续的我都将其转成了jpg格式,但是在测试集中的图片转成jpg格式会无法显示加载,因此数据集总体我就使用了训练集和验证集的图图片。

#将图片转成6位的对应格式

import glob

import os

import cv2

from PIL import Imageurl = '/home/lf/桌面/train/train2'

img_list=os.listdir(url)

img_list=sorted(img_list)#将图片的名字转成符合voc格式的图片

for i in range(len(img_list)):src=os.path.join(os.path.abspath(url),img_list[i])dst=os.path.join(os.path.abspath(url),(str(i+10462).zfill(6)+'.jpg'))os.rename(src,dst)# url2 = '/home/lf/桌面/img/jnwe2'

# img_list2=os.listdir(url2)

# img_list2=sorted(img_list2)

#

# # 将图片的名字转成符合voc格式的图片

# for i in range(len(img_list2)):

# src=os.path.join(os.path.abspath(url2),img_list2[i])

# dst=os.path.这篇关于使用Brainwash人头数据集训练SSD_MobilenetV1训练自己的模型的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!