本文主要是介绍全球地表水年度数据集JRC Yearly Water Classification History, v1.4数据集,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

简介:

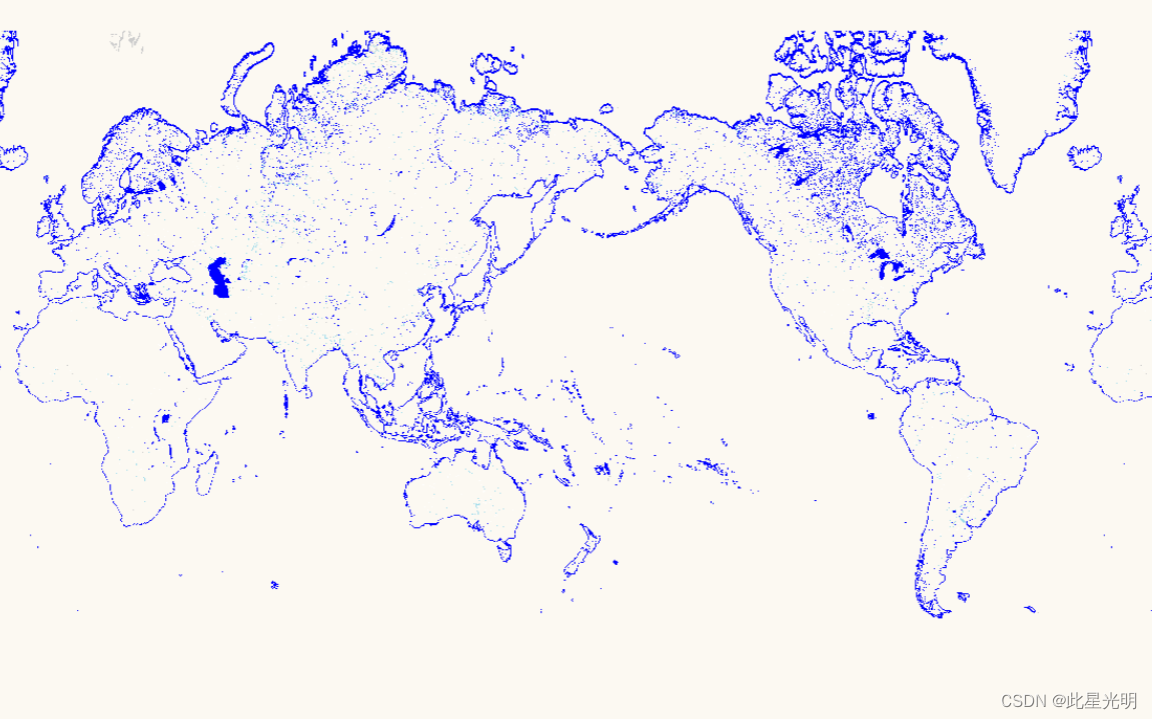

JRC Yearly Water Classification History, v1.4是一个对全球水资源进行分类的数据集,覆盖了1984年至2019年的时间范围。该数据集是由欧盟联合研究中心(JRC)开发的,使用的数据源是来自Landsat系列卫星的高分辨率图像。数据集根据水体的类型和水体覆盖的百分比进行分类,包括河流、湖泊、人工水体和沼泽等。前言 – 人工智能教程

JRC Yearly Water Classification History, v1.4可以用于分析全球水资源的变化趋势,比如城市化和气候变化对水体的影响等。它也可以被用于编制水资源管理计划和预测洪水和干旱等自然灾害的发生概率。该数据集可以在JRC的网站上免费下载和使用。

JRC Yearly Water Classification History产品,是利用1984至2020年获取的landsat5、landsat7和landsat8的卫星影像,生成的一套分辨率为30米的年度全球地表水体分类地图集。该数据集将水体共分为四类:无数据、非水体、间歇性水体和永久性水体。用户可以在全球尺度上按地区回溯某年地表水体的分类情况。

长时序地表水观测具有重要的意义,包括以下几个方面:

1. 研究气候变化影响地表水循环的过程和机制:长时序地表水观测可以提供准确的水文数据,帮助科学家研究气候变化对地表水循环的影响,包括降水、蒸散发、径流等,有助于推理水资源的变化趋势。

2. 检测地表水资源的变化趋势:长时间序列观测数据能够反映出地表水资源的变化趋势,包括变化的周期、变化的单调性、变化速率等,有助于发现地表水资源的威胁和机会,以及制定水资源的管理计划。

3. 评估水资源利用的可行性:长时间序列观测能够提供水资源的质量和量的信息,有助于科学家评估水资源的利用的可行性,包括是否能够满足人类需求以及是否拥有足够的水资源来支持其生态系统的健康。

4. 引导水资源管理决策和政策制定:长时间序列观测数据能够为水资源管理提供可靠的数据基础,帮助政策制定者和决策者制定具有前瞻性和可持续性的水资源管理计划,从而提升水资源的管理效率和保障水资源的可持续利用。

数据集ID:

GSW1_4/YearlyClassification

时间范围: 1984年-2020年

范围: 全球

来源: EC JRC/Google

复制代码段:

var images = pie.ImageCollection("GSW1_4/YearlyClassification")

| 名称 | 类型 | 空间分辨率(m) | 无效值 | 描述信息 |

|---|---|---|---|---|

| water | byte | 30 | 255 | 全年水的季节性分类:

|

代码:

/*** @File : GlobalSurfaceWater* @Time : 2022/3/29* @Author : piesat* @Version : 1.0* @Contact : 400-890-0662* @License : (C)Copyright 航天宏图信息技术股份有限公司* @Desc : 加载JRC Yearly Water Classification History, v1.4数据集*///加载JRC Yearly Water Classification History, v1.4数据集

var dataset = pie.ImageCollection('GSW1_4/YearlyClassification').filterDate("2015","2016").select("water")

print("dataset",dataset);//设置预览参数

var visualization = {min: 0.0,max: 3.0,palette: ['cccccc', 'ffffff', '99d9ea', '0000ff']

};//定位地图中心及缩放级别

Map.setCenter(117.7, 33.41, 7);//加载显示影像

Map.addLayer(dataset, visualization,"dataset")数据引用:Jean-Francois Pekel, Andrew Cottam, Noel Gorelick, Alan S. Belward, High-resolution mapping of global surface water and its long-term changes. Nature 540, 418-422 (2016). (doi:10.1038/nature20584)

这篇关于全球地表水年度数据集JRC Yearly Water Classification History, v1.4数据集的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!