本文主要是介绍RNN基于时间的反向传播算法BPTT(Back Propagation Trough Time)梯度消失与梯度爆炸,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

日萌社

人工智能AI:Keras PyTorch MXNet TensorFlow PaddlePaddle 深度学习实战(不定时更新)

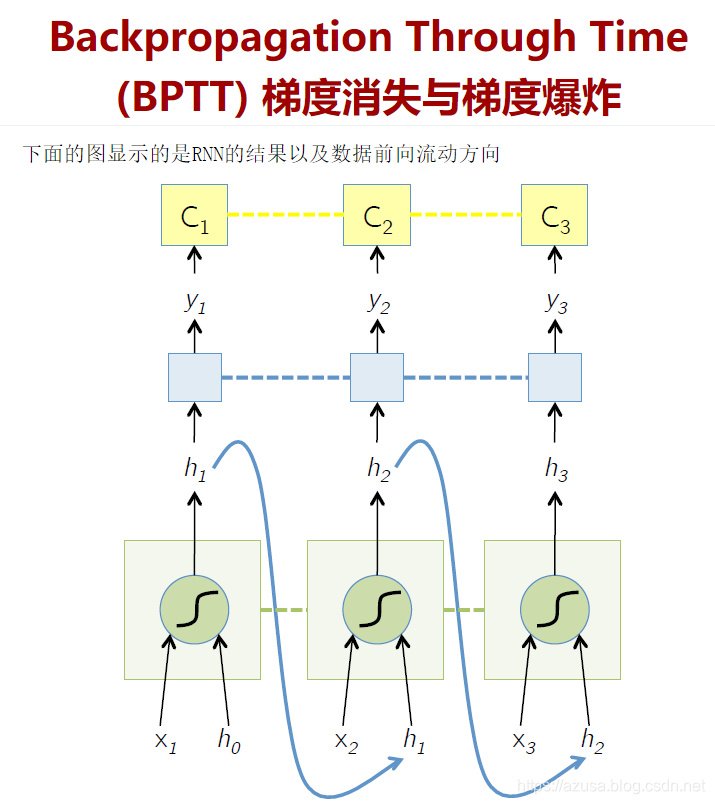

将RNN展开之后,前向传播(Forward Propagation)就是依次按照时间的顺序计算一次就好了,

反向传播(Back Propagation)就是从最后一个时间将累积的残差传递回来即可,这与普通的神经网络训练本质上是相似的。

这篇关于RNN基于时间的反向传播算法BPTT(Back Propagation Trough Time)梯度消失与梯度爆炸的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!