本文主要是介绍改进YOLOv5、YOLOv8系列:17.添加NAMAttention注意力机制,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

最新创新点改进推荐

-💡统一使用 YOLO 代码框架,结合不同模块来构建不同的YOLO目标检测模型。

🔥 《芒果书》系列改进专栏内的改进文章,均包含多种模型改进方式,均适用于YOLOv3 、YOLOv4 、 YOLOR 、 YOLOX 、YOLOv5 、 YOLOv7 、 YOLOv8 改进(重点)!!!

🔥 专栏创新点教程 均有不少同学反应和我说已经在自己的数据集上有效涨点啦!! 包括COCO数据集也能涨点

所有文章博客均包含 改进源代码部分,一键训练即可

🔥 对应专栏订阅的越早,就可以越早使用原创创新点去改进模型,抢先一步

YOLOv8 + 改进注意力机制

详细内容

参考这篇博客:点击查看详情:YOLOv5改进、YOLOv7、YOLOv8改进|YOLO改进超过多种注意力机制,全篇共计30万字(内附改进源代码),原创改进多种Attention注意力机制和Transformer自注意力机制

芒果书 点击以下链接 查看文章目录详情🔗

-

💡🎈☁️:一、CSDN原创《芒果改进YOLO高阶指南》强烈改进涨点推荐!📚推荐指数:🌟🌟🌟🌟🌟

-

💡🎈☁️:二、CSDN原创YOLO进阶 | 《芒果改进YOLO进阶指南》改进涨点推荐!📚推荐指数:🌟🌟🌟🌟🌟

-

💡🎈☁️:三、CSDN独家全网首发专栏 | 《目标检测YOLO改进指南》改进涨点推荐!推荐指数:🌟🌟🌟🌟🌟

文章目录

- 最新创新点改进推荐

- YOLOv8 + 改进注意力机制

- YOLOv5、YOLOv7 + 注意力机制一览

- 之后继续更新🔥🔥🔥

- 第一种、YOLOv5使用NAMAttention注意力机制

- NAMAttention注意力机制原理图

- 1.1增加以下NAMAttention.yaml文件

- 1.2common.py配置

- 1.3yolo.py配置

- 1.4训练模型

- 往期YOLO改进教程导航

YOLOv5、YOLOv7 + 注意力机制一览

YOLOv5 + ShuffleAttention注意力机制

博客链接🔗🌟:改进YOLOv5系列:12.添加ShuffleAttention注意力机制

YOLOv5 + CrissCrossAttention注意力机制

博客链接🔗🌟:改进YOLOv5系列:13.添加CrissCrossAttention注意力机制

YOLOv5 + S2-MLPv2注意力机制

博客链接🔗🌟:改进YOLOv5系列:14.添加S2-MLPv2注意力机制

YOLOv5 + SimAM注意力机制

博客链接🔗🌟:改进YOLOv5系列:15.添加SimAM注意力机制

YOLOv5 + SKAttention注意力机制

博客链接🔗🌟:改进YOLOv5系列:16.添加SKAttention注意力机制

YOLOv5 + NAMAttention注意力机制

博客链接🔗🌟:改进YOLOv5系列:17.添加NAMAttention注意力机制

YOLOv5 + SOCA注意力机制

博客链接🔗🌟:改进YOLOv5系列:18.添加SOCA注意力机制

YOLOv5 + CBAM注意力机制

博客链接🔗🌟:改进YOLOv5系列:18.添加CBAM注意力机制

YOLOv5 + SEAttention注意力机制

博客链接🔗🌟:改进YOLOv5系列:19.添加SEAttention注意力机制

YOLOv5 + GAMAttention注意力机制

博客链接🔗🌟:改进YOLOv5系列:20.添加GAMAttention注意力机制

YOLOv5 + CA注意力机制

博客链接🔗🌟:github

YOLOv5 + ECA注意力机制 博客链接🔗🌟:github

更多模块详细解释持续更新中。。。

之后继续更新🔥🔥🔥

第一种、YOLOv5使用NAMAttention注意力机制

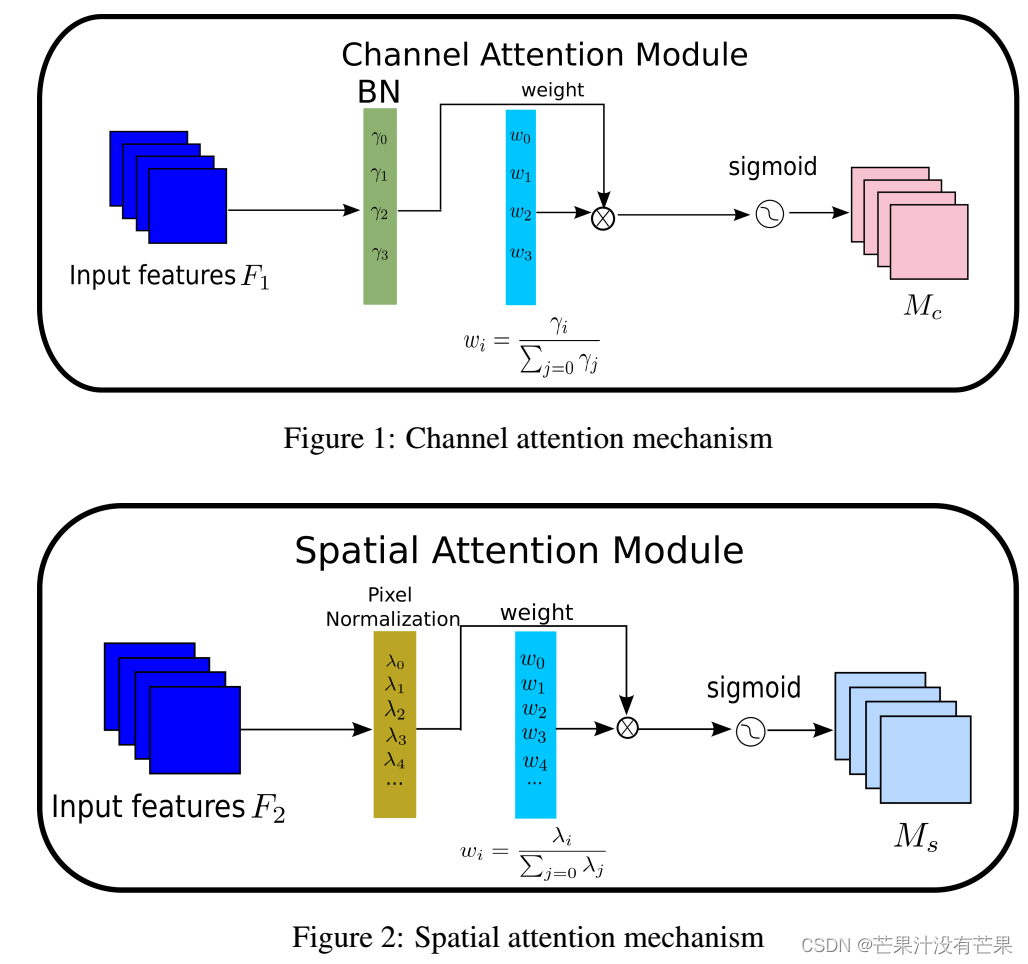

NAMAttention注意力机制原理图

1.1增加以下NAMAttention.yaml文件

# YOLOv5 🚀 YOLOair, GPL-3.0 license# Parameters

nc: 80 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.50 # layer channel multiple

anchors:- [10,13, 16,30, 33,23] # P3/8- [30,61, 62,45, 59,119] # P4/16- [116,90, 156,198, 373,326] # P5/32# YOLOv5 v6.0 backbone

backbone:# [from, number, module, args][[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2[-1, 1, Conv, [128, 3, 2]], # 1-P2/4[-1, 3, C3, [128]],[-1, 1, Conv, [256, 3, 2]], # 3-P3/8[-1, 6, C3, [256]],[-1, 1, Conv, [512, 3, 2]], # 5-P4/16[-1, 9, C3, [512]],[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32[-1, 3, C3, [1024]],[-1, 1, SPPF, [1024, 5]], # 9]# YOLOv5 v6.0 head

head:[[-1, 1, Conv, [512, 1, 1]],[-1, 1, nn.Upsample, [None, 2, 'nearest']],[[-1, 6], 1, Concat, [1]], # cat backbone P4[-1, 3, C3, [512, False]], # 13[-1, 1, Conv, [256, 1, 1]],[-1, 1, nn.Upsample, [None, 2, 'nearest']],[[-1, 4], 1, Concat, [1]], # cat backbone P3[-1, 3, C3, [256, False]], # 17 (P3/8-small)[-1, 1, Conv, [256, 3, 2]],[[-1, 14], 1, Concat, [1]], # cat head P4[-1, 3, C3, [512, False]], # 20 (P4/16-medium)[-1, 1, Conv, [512, 3, 2]],[[-1, 10], 1, Concat, [1]], # cat head P5[-1, 3, C3, [1024, False]], # 23 (P5/32-large)[-1, 1, NAMAttention, [1024]],# 修改[[17, 20, 24], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)]

1.2common.py配置

./models/common.py文件增加以下模块

import torch.nn as nn

import torch

from torch.nn import functional as Fclass Channel_Att(nn.Module):def __init__(self, channels, t=16):super(Channel_Att, self).__init__()self.channels = channelsself.bn2 = nn.BatchNorm2d(self.channels, affine=True)def forward(self, x):residual = xx = self.bn2(x)weight_bn = self.bn2.weight.data.abs() / torch.sum(self.bn2.weight.data.abs())x = x.permute(0, 2, 3, 1).contiguous()x = torch.mul(weight_bn, x)x = x.permute(0, 3, 1, 2).contiguous()x = torch.sigmoid(x) * residual #return xclass NAMAttention(nn.Module):def __init__(self, channels, out_channels=None, no_spatial=True):super(NAMAttention, self).__init__()self.Channel_Att = Channel_Att(channels)def forward(self, x):x_out1=self.Channel_Att(x)return x_out1 1.3yolo.py配置

在 models/yolo.py文件夹下

- 定位到parse_model函数中

for i, (f, n, m, args) in enumerate(d['backbone'] + d['head']):内部- 对应位置 下方只需要新增以下代码

elif m is NAMAttention:c1, c2 = ch[f], args[0]if c2 != no:c2 = make_divisible(c2 * gw, 8)args = [c1, *args[1:]]

1.4训练模型

python train.py --cfg NAMAttention.yaml

往期YOLO改进教程导航

11.改进YOLOv5系列:11.ConvNeXt结合YOLO | CVPR2022 多种搭配,即插即用 | Backbone主干CNN模型

10.改进YOLOv5系列:10.最新HorNet结合YOLO应用首发! | ECCV2022出品,多种搭配,即插即用 | Backbone主干、递归门控卷积的高效高阶空间交互

9.改进YOLOv5系列:9.BoTNet Transformer结构的修改

8.改进YOLOv5系列:8.增加ACmix结构的修改,自注意力和卷积集成

7.改进YOLOv5系列:7.修改DIoU-NMS,SIoU-NMS,EIoU-NMS,CIoU-NMS,GIoU-NMS

6.改进YOLOv5系列:6.修改Soft-NMS,Soft-CIoUNMS,Soft-SIoUNMS

5.改进YOLOv5系列:5.CotNet Transformer结构的修改

4.改进YOLOv5系列:4.YOLOv5_最新MobileOne结构换Backbone修改

3.改进YOLOv5系列:3.Swin Transformer结构的修改

2.改进YOLOv5系列:2.PicoDet结构的修改

1.改进YOLOv5系列:1.多种注意力机制修改

这篇关于改进YOLOv5、YOLOv8系列:17.添加NAMAttention注意力机制的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!