本文主要是介绍用Zipkin在分布式系统追踪收集和查看时间数据,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

Zipkin是一个开源的分布式追踪系统,它帮助收集、存储和展示实时的数据,以便于定位微服务架构中的延迟问题。以下是Zipkin的核心组件和工作流程的介绍,以及如何在Java中使用Spring Cloud Sleuth与Zipkin集成的案例。

Zipkin的核心组件:

- Collector:负责接收来自应用的追踪数据。

- Storage:存储追踪数据,支持内存、MySQL、Elasticsearch和Cassandra等多种存储方式。

- API:提供查询接口,允许通过trace ID等信息查询追踪数据。

- UI:Web界面,用于可视化展示追踪数据和调用链路。

工作流程:

- 用户发起请求,Zipkin客户端为整个调用链生成一个全局唯一的

trace id,并为每次调用生成一个span id。 - 客户端将这些信息添加到HTTP请求的头部,发送请求。

- 请求结束时,客户端记录调用耗时,并将

span信息发送到Zipkin的Collector模块。 - Collector接收到数据后,存储到配置的Storage中,供API和UI使用。

案例:使用Spring Cloud Sleuth与Zipkin集成

步骤:

- 添加依赖:在Spring Boot项目中添加

spring-cloud-starter-zipkin依赖。 - 配置文件:配置

application.properties或application.yml,设置Zipkin服务器地址和采样率:

spring:cloud:sleuth:sampler:probability: 1.0 # 设置采样率zipkin:base-url: http://127.0.0.1:9411 # Zipkin服务器地址discovery-client-enabled: false # 避免与服务发现冲突

- 启动Zipkin服务器:下载并运行Zipkin服务器,例如使用以下命令:

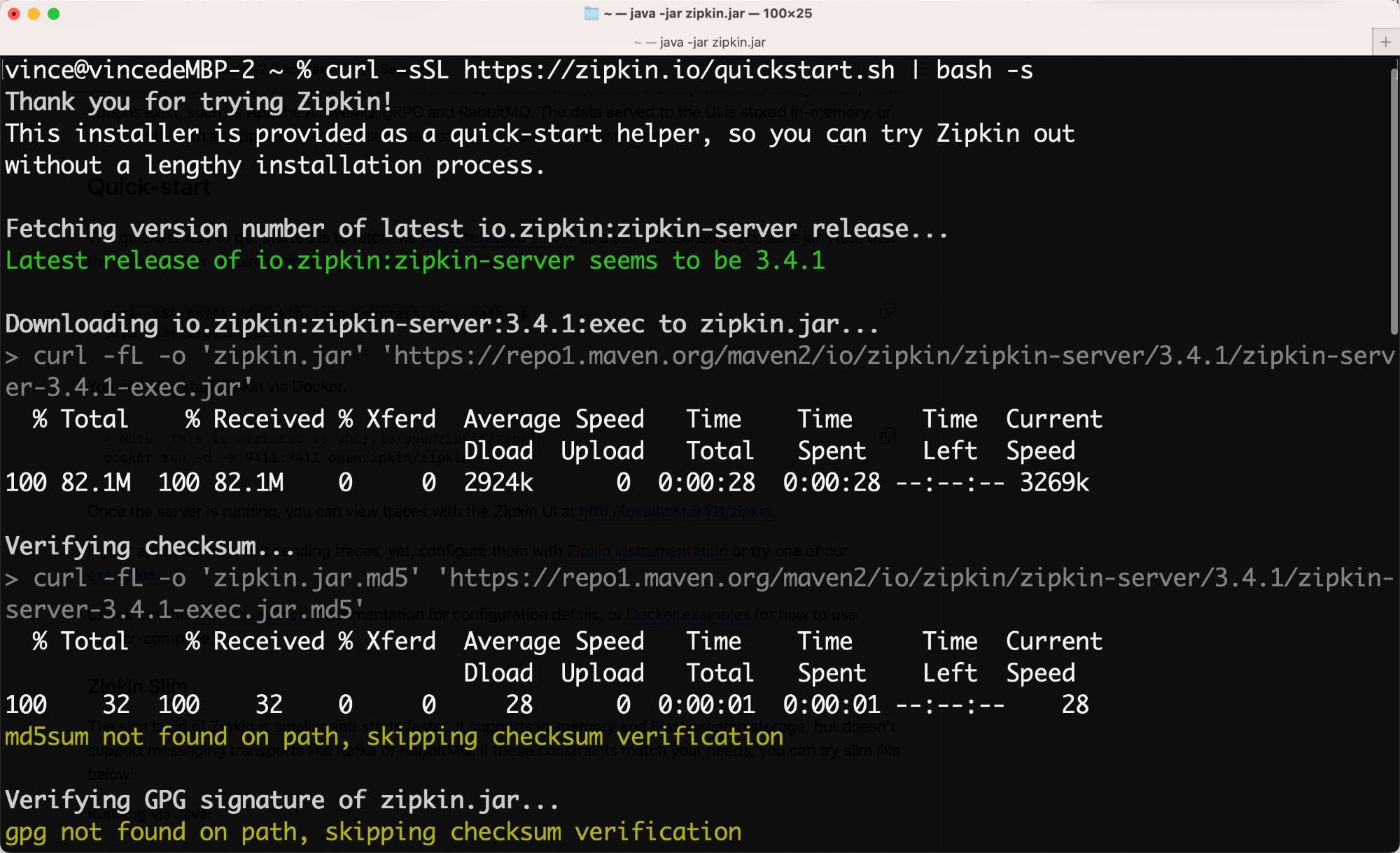

curl -sSL https://zipkin.io/quickstart.sh | bash -s

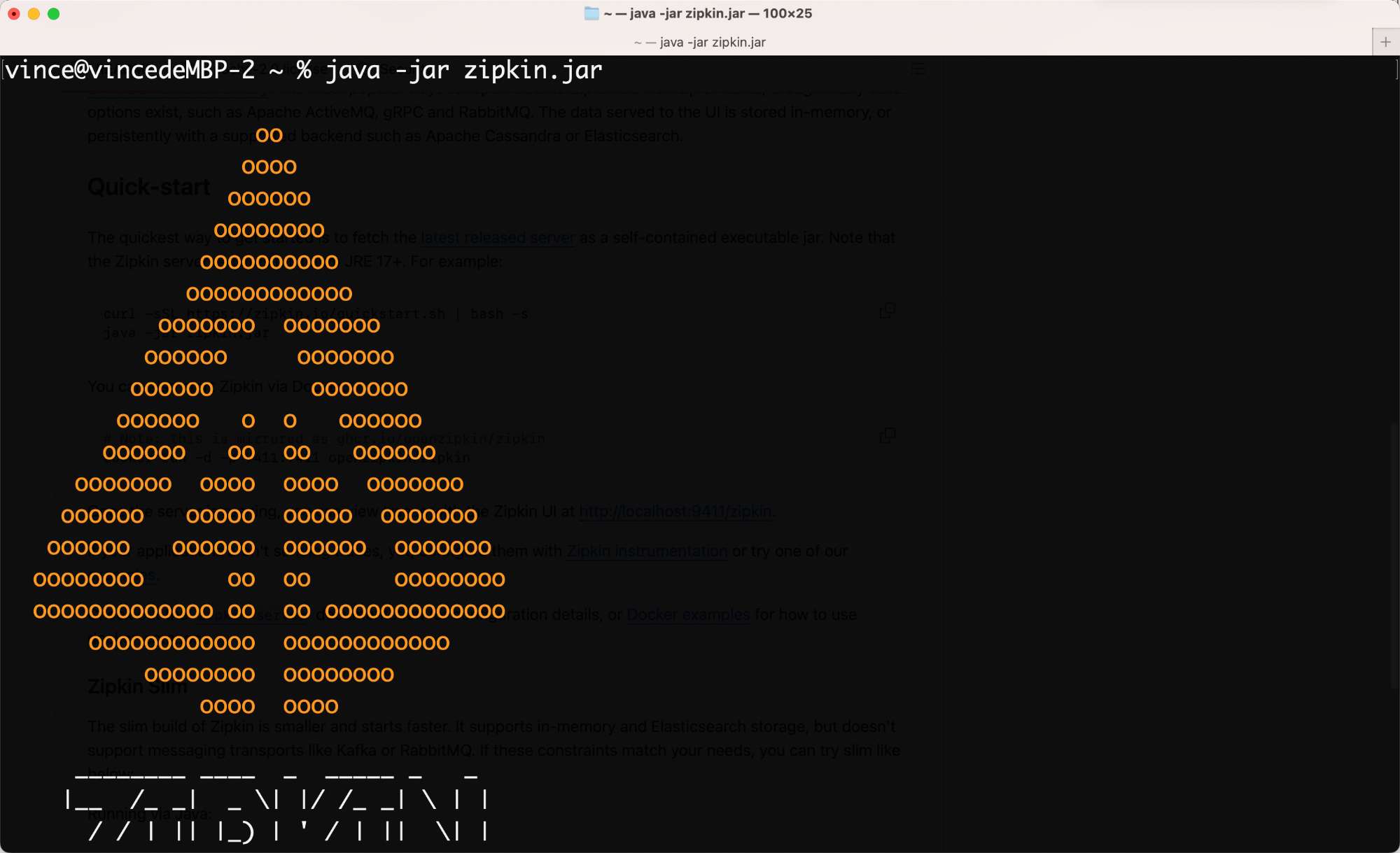

java -jar zipkin.jar

-

启动应用:启动Spring Boot应用,访问你的服务接口,数据将被发送到Zipkin。

-

查看追踪信息:打开Zipkin Web界面,查看请求的调用链路和相关信息。

技巧:

- 使用环境变量或配置中心管理Zipkin服务器地址,便于在不同环境中切换。

- 根据需要调整采样率,生产环境中通常不需要100%采样,以减少性能开销。

- 考虑使用消息队列(如RabbitMQ、Kafka)作为数据传输方式,提高数据传输的可靠性。

- 对于数据持久化,可以选择MySQL、Elasticsearch或Cassandra等,根据项目需求和现有技术栈进行选择。

使用Zipkin,咱们可以轻松地将Spring Boot应用与Zipkin集成,实现分布式追踪。

这篇关于用Zipkin在分布式系统追踪收集和查看时间数据的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!