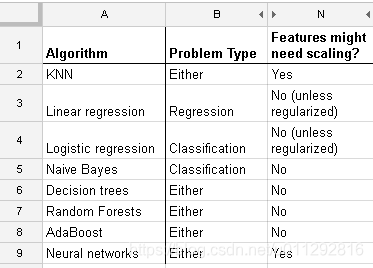

本文主要是介绍哪些机器学习算法需要进行特征缩放 - feature scaling,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

通常以距离或者相似度(例如标量积scaler product)作为计算量的算法: 例如KNN, SVM。

而基于概率图模型(graphical model)的算法:Fisher LDA ,Naive Bayes, Decision trees 和 Tree-based 集成方法 (RF, XGB)不会受到特征缩放的影响。

Reference: https://stats.stackexchange.com/questions/244507/what-algorithms-need-feature-scaling-beside-from-svm

这篇关于哪些机器学习算法需要进行特征缩放 - feature scaling的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!