自强专题

和鲸科技出席第五届空间数据智能学术会议,执行总裁殷自强受邀发表主题报告

4月26日,由 ACM SIGSPATIAL 中国分会、ACM SIGMOD 中国分会主办的第五届空间数据智能学术会议(SpatialDI 2024,下简称“会议”)在南京盛大开幕。本次会议特邀李清泉院士、周成虎院士、丛高教授、谢炯博士、张雪英教授等国内外知名专家做大会特邀报告,并设立 9 个专题论坛、1 个企业论坛和 1 个前沿讲习班,旨在进一步促进空间数据智能研究的理论发展与应用,交流相关领域

清华 AI自强计划-计算机视觉3经典神经网络_作业(1)

作业下载网址:https://pan.baidu.com/s/1iXUi78OIEzT2U4F4TofGmA Part1:(tensorflow-MNIST-logistRes) #以下函数的使用方法,请参考:https://tensorflow.google.cn/api_docs/python/from tensorflow.examples.tutorials.mnist import

『青年AI自强计划』第6章视觉分类任务LeNet5,AlexNet,ZFNet,VGG,GoogleNet,ResNet,ResNeXt,SENet,MobileNet!

视觉分类任务 文章目录 一、分类任务简介1.1、分类发展简史 二、卷积知识回顾2.1、卷积运算2.2、池化运算2.3、padding运算2.4、三维卷积(池化)2.5、LeNet5 :一切的原点 三、AlexNet&ZFNet3.1、AlexNet(2012):深度CNN与BD的首次触电3.2、ZFNet(2013):过渡,对AlexNet小调整 四、VGG(2014):“标准模块+堆叠”

清华AI自强计划作业3-Part3 tensorflow-MNIST-NN

如何将作业提供的神经网络模型优化跑出99%的准确率 导读 mnist数据集基本上可以算做是数据科学里的hello world程序。 对于Part3部分的作业,按照注释部分的提示可以达到96%的准确率。 关于准确率的进一步优化 激活函数 在尝试了不同的激活函数sigmoid、relu、tanh之后,在本次作业的模型里sigmoid的表现较后两者更为出色。 神经元 通过增加A1、A2层

清华AI自强计划作业2实验—逻辑回归模型

问题: 运行模型输出loss值为NAN,训练200次后未出现线性模型 nan nan的数据类型为float, not a number 的缩写。python中判断是否为nan类型的方法,使用math库中的*isnan()*函数判断: from math import isnan import numpy as np res = np.nan print (isnan(res))

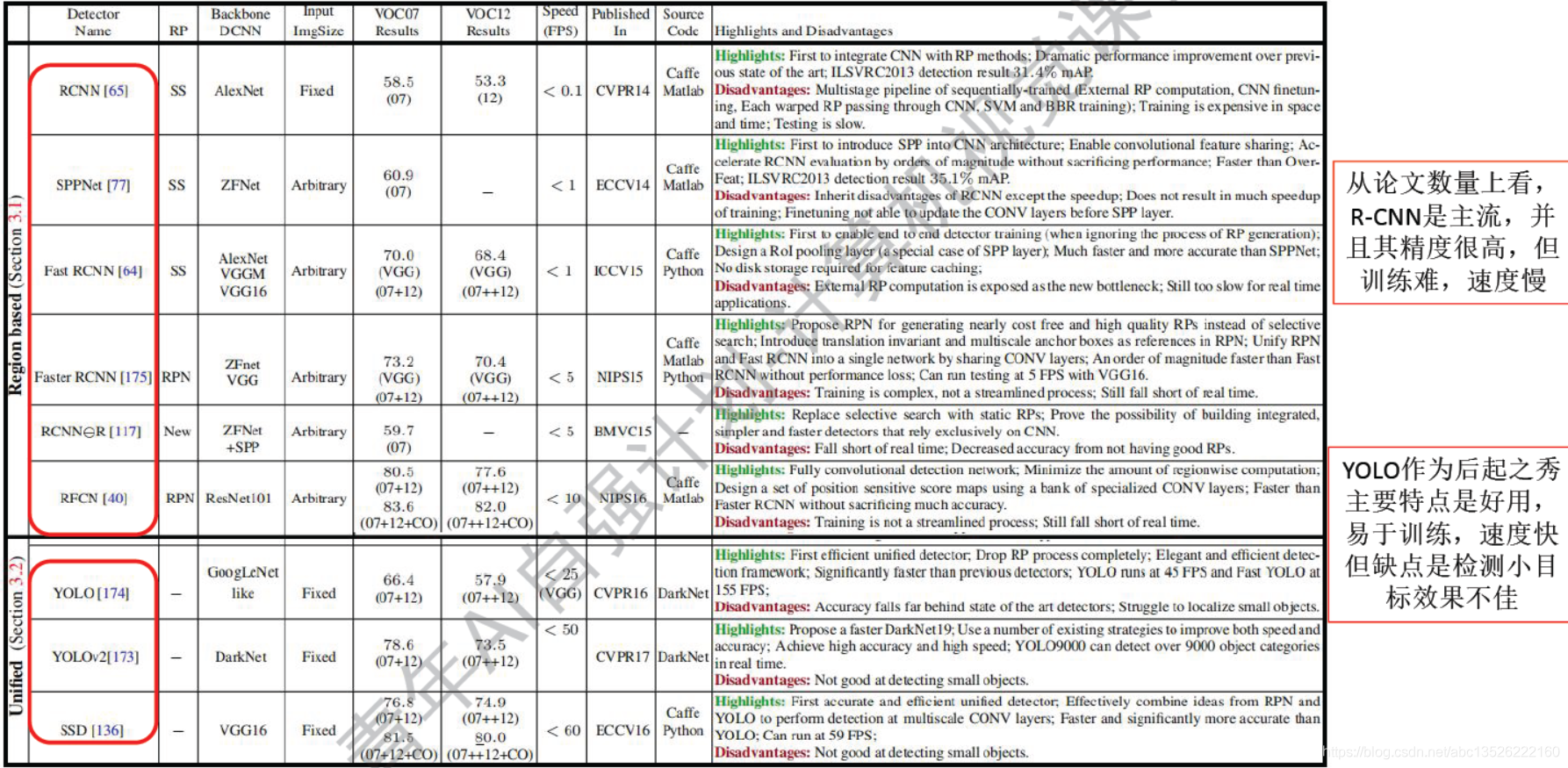

『青年AI自强计划』第7章视觉探测任务R-CNN,Fast R-CNN,Faster R-CNN,YOLO!

视觉探测任务 文章目录 一、初始探测任务1.1、silding windows & IoU1.2、Region Proposal1.3、Non-Max Suppression (NMS)非极大值抑制 二、探测任务-网络发展概览2.1、PASCAL VOC 数据集简介2.2、R-CNN(Region)-前馈工作流2.3、R-CNN(Region)-如何训练2.4、R-CNN(Region

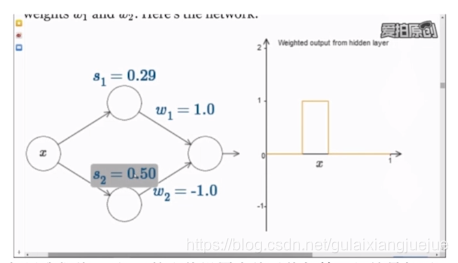

【清华AI自强计划-计算机视觉课程-第三讲课程笔记2】

神经网络为什么有效? 神经网络有一个性质:Universality_——“全包了”(普遍性)——即可代替所有的函数画出决策边界。 简化模型到只有w和b两个参数,激活函数为sigmoid函数,而激活函数的跳变点和-b/w有关。 如果启用隐藏层神经元,同时令w1和w2的绝对值相等,符号相反,并且s1和s2设置为不同取值,则就会出现形如方波信号的图像。 再扩展一步,隐藏层每2个神经元可以画出一个形似

清华青年AI自强项目核心内容总结

文章目录 讲座梗概第1讲:AI鸟瞰与升级指南第2讲:机器学习入门第3讲:经典神经网络第4讲:深度神经网络第5讲:卷积神经网络第6讲:视觉分类任务第7讲:视觉探测任务第8讲:实例与调参 本文主要梳理总结学习清华大学青年AI自强项目中的核心知识内容,各位读者可以根据需要按图索骥,enjoy! 讲座梗概 第1讲:AI鸟瞰与升级指南第2讲:机器学习入门第3讲:经典神经网

清华 AI自强计划-计算机视觉4深度神经网络_笔记

笔记: 4.1 前言&DNN 4.2 数据集简介及知识回顾 4.3 梯度消失(***) 4.4 梯度爆炸及激活函数 4.5 过拟合及其解决办法 4.6 处理大数据的小技巧 ***