林轩专题

林轩田机器学习基石3:机器学习类型划分(Types of Learning)

欢迎关注公众号-AI圈终身学习。 公众号首页回复“机器学习”查看所有系列文章。 上节主要介绍了: 二元分类(Yes/No)问题线性可分数据的感知器演算法(PLA)针对线性不可分数据改进的贪心算法Pocket Algorithm。 本节笔记Lecture 3包含内容如下: 机器学习类型划分(Types of Learning) 根据不同的输出空间Y(Learning with Di

林轩田机器学习基石2:学习回答Yes/No(Learning to Answer Yes/No)

欢迎关注公众号-AI圈终身学习。 公众号首页回复“机器学习”查看所有系列文章。 上节林老师讲了机器学习的定义与流程: 总结就是:训练数据D在演算法A的观察学习下,从假设集合H中,选择出最好的一个假设h得到最终的模型函数g。 本节笔记Lecture 2-Learning to Answer Yes/No包含内容如下: When Can Machines Learn?(什么时候用机器

林轩田机器学习基石1:机器学习问题(The Learning Problem)

欢迎关注公众号-AI圈终身学习。 公众号首页回复“机器学习”查看所有系列文章。 机器学习基石课程大概八周,分为四个部分: When Can Machines Learn?Why Can Machines Learn?How Can Machines Learn?How Can Machines Learn Better? 课程主页: http://www.csie.ntu.edu.

【林轩田】机器学习基石(九)——线性回归

ppt video Lecture 9: Linear Regression 线性回归 9.1 Linear Regression Problem 线性回归问题 考虑一个问题,银行按照每个顾客的个人情况,赋予不同的信用额度。我们可不可以通过机器学习,学到一个赋予信用额度的比较好的方式呢? 信用额度是一个实数,所以输出 y ∈ R y \in R y∈R,属于回归问题。 这里介绍最简单的

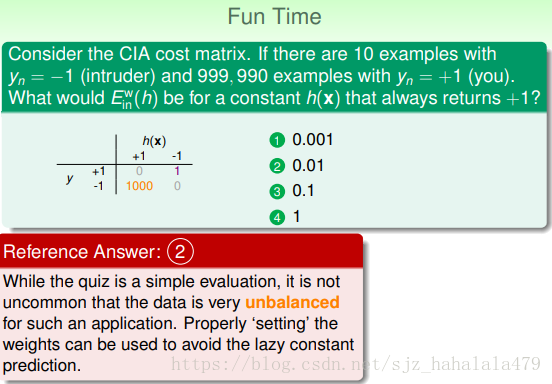

【林轩田】机器学习基石(八)——噪声和误差

ppt video Lecture 8: Noise and Error 噪声和误差 8.1 Noise and Probabilistic Target 噪音和概率目标 我们原有的机器学习流程如下图: 有一个未知的目标函数 f(x) f ( x ) f(x),还有一个未知的分布 P P P,训练样本的输入XXX根据 P P P生成,训练样本的输出YYY根据 f f f生成

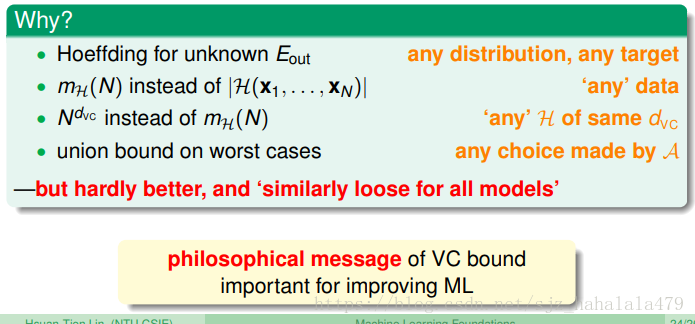

【林轩田】机器学习基石(七)——VC维

Lecture 7: VC Dimension VC维 ppt video 7.1 Definition of VC Dimension VC维的定义 复习1 上节课,林教授讲到了,当样本 N N N足够大,且成长函数mH(N)mH(N)m_{H}(N)存在断点 k k k时,可以概率性地推出Eout≃EinEout≃EinE_{out} \simeq E_{in} 即

【林轩田】机器学习基石(六)——泛化理论

ppt video Lecture 6: Theory of Generalization 6.1 Restriction of Break Point 断点的限制 这一小节提出了一个问题,当我们最小的断点 k=2 k = 2 k=2,时,我们能推出什么? N=1时, x1 x 1 x_1是圈、叉都可以,这样有 mH(1)=2 m H ( 1 ) = 2 m_H(1) = 2

[林轩田]机器学习基石(四)

Lecture 4: Feasibility of Learning 机器学习的可行性 ppt 4.1 Learning is impossible 学习是不可能的 这一小节的主要内容是,既然假设函数 f f f是未知的,那么我们怎么能保证我们在数据样本中学到的ggg,是越来越接近 f f f的呢?在没有任何限定的情况下,很有可能我们在DDD中学到的知识没有任何意义,即我们不能够利用我们

【林轩田】机器学习基石(二)——PLA

Lecture 2 Learning to Answer Yes or No ppt 2.1 Perceptron Hypothesis Set 感知假说集 感知假说集这部分,林老师主要是举了个线性回归的例子,来帮我们感性地认识了 h 这个东西到底是什么。 比如说线性回归: h=sign(wTx) h = s i g n ( w T x ) h = sign(w^Tx)

![[林轩田]机器学习基石(四)](https://img-blog.csdn.net/2018080119165672?watermark/2/text/aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3Nqel9oYWhhbGFsYTQ3OQ==/font/5a6L5L2T/fontsize/400/fill/I0JBQkFCMA==/dissolve/70)