tricks专题

2015多校联合训练第一场Tricks Device(hdu5294)

题意:给一个无向图,给起点s,终点t,求最少拆掉几条边使得s到不了t,最多拆几条边使得s能到t 思路: 先跑一边最短路,记录最短路中最短的边数,总边数-最短边数就是第二个答案 第一个答案就是在最短路里面求最小割,也就是求最大流,然后根据最短路在建个新图,权为1,跑一边网络流 模板题,以后就用这套模板了 #include <iostream>#include <cstdio>#incl

10条提升大模型任务微调效果的tricks

在大型语言模型(LLMs)的研究和应用中,如何通过微调来适应特定任务是一个关键问题。尽管提示工程(PE)在提升LLMs的零样本学习和上下文内学习方面取得了显著成效,但关于如何设计有效的微调样本以进一步提升LLMs性能的研究还相对欠缺。 为解决上述问题,提出了样本设计工程SDE(Sample Design Engineering),这是一种系统化的方法,旨在通过精细化设计输入、输出和推理环节来增强

3个Tricks帮你提升你Debug Pytorch的效率

点击上方“AI公园”,关注公众号,选择加“星标“或“置顶” 作者:Adrian Wälchli 编译:ronghuaiyang 导读 好的工具和工作习惯可以极大的提升工作效率。 每一个深度学习项目都是不同的。不管你有多少经验,你总会遇到新的挑战和意想不到的行为。你在项目中运用的技巧和思维方式将决定你多快发现并解决这些阻碍成功的障碍。 从实践的角度来看,深度学习项目从代码开始。一开始组织它很

深度学习小目标检测问题——(转载)目标检测——深度学习下的小目标检测(检测难的原因和Tricks)

转载:https://www.cnblogs.com/E-Dreamer-Blogs/p/11442927.html 小目标难检测原因 主要原因 (1)小目标在原图中尺寸比较小,通用目标检测模型中,一般的基础骨干神经网络(VGG系列和Resnet系列)都有几次下采样处理,导致小目标在特征图的尺寸基本上只有个位数的像素大小,导致设计的目标检测分类器对小目标的分类效果差。 (2)小目标在原图中

hdu 5294 Tricks Device

题意: 最少破坏多少条路,所有的最短路都无法走通。 最多破环多少条路,任然有一条最短路可以走。 分析:对于第二个问题,求出最短路路径数最小的一条即可,第一个问题,用最短路径上所有的边构建网络,然后求出最大流即为所求,因为这题边很多,所以用EK会超时,换成dinic就能AC。 ps:构建网络写的太乱了,不过好歹A了,需要好好整理一下,写一个更清晰的版本。 以下附上代码:

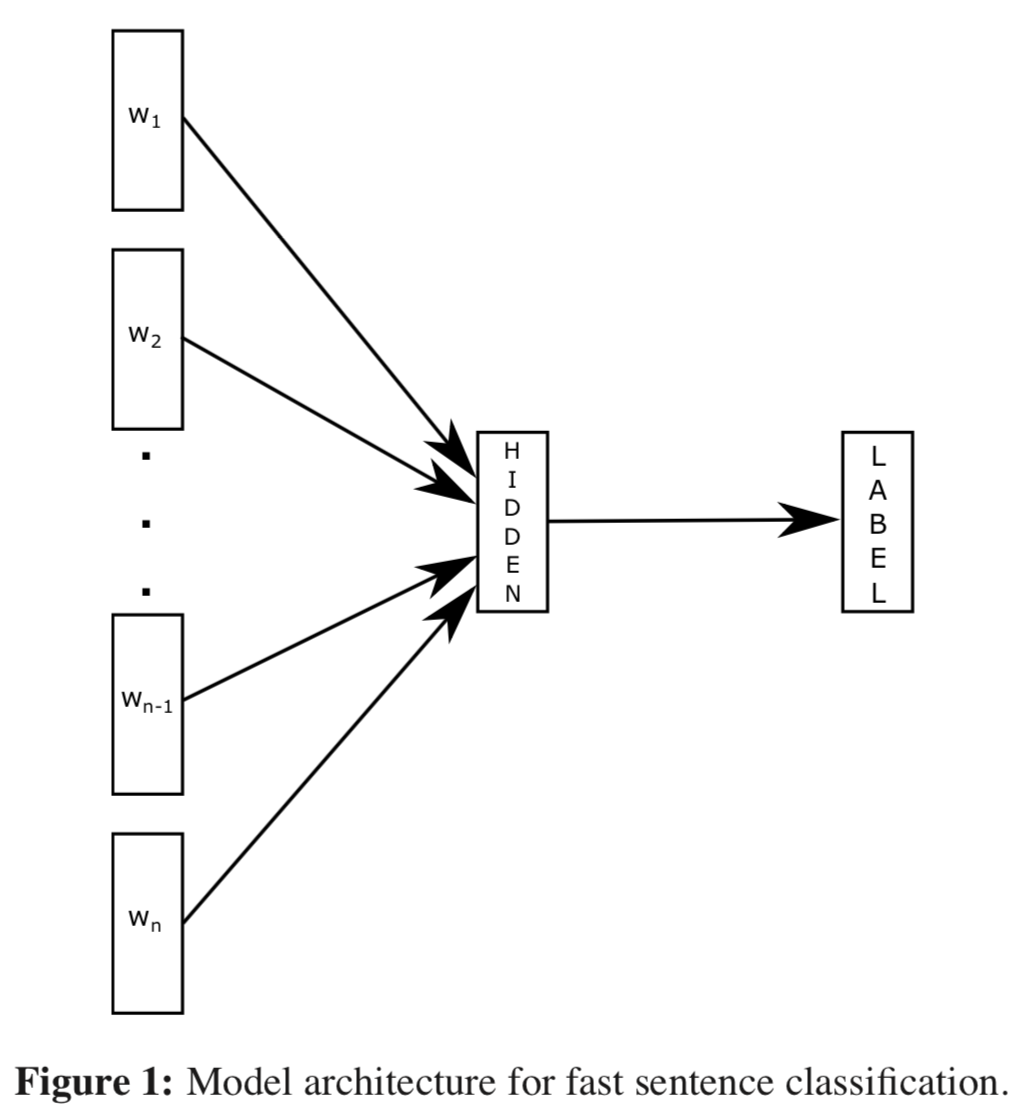

论文阅读:《Bag of Tricks for Efficient Text Classification》

重磅专栏推荐: 《大模型AIGC》 《课程大纲》 《知识星球》 本专栏致力于探索和讨论当今最前沿的技术趋势和应用领域,包括但不限于ChatGPT和Stable Diffusion等。我们将深入研究大型模型的开发和应用,以及与之相关的人工智能生成内容(AIGC)技术。通过深入的技术解析和实践经验分享,旨在帮助读者更好地理解和应用这些领域的最新进展 https://blog.csdn.

HDU 3292 No more tricks, Mr Nanguo(佩尔方程,矩阵快速幂)

题目: LINK 题意可以理解为: y^2 - n*x^2 == 1 已知n,求(x, y)的第k小的解. 这个式子可以用佩尔方程定理来解,可以把用到的前29个最小的解先打表。至于求第k小解,k比较大,可以用矩阵快速幂来做。 #include<cstdio>#include<cstring>#include<algorithm>#include<iostream>#include

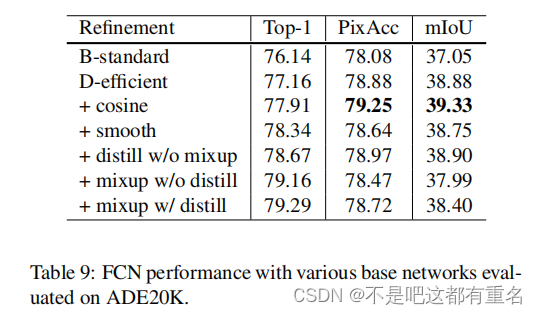

【论文精读】Bag of Tricks for Image Classification with Convolutional Neural Networks

这篇文章比较早了,2018年的 摘要 最近在图像分类研究方面取得的大部分进展可以归功于训练程序的改进,如数据增强和优化方法的改变。然而,在文献中,大多数改进要么作为实现细节简要提到,要么只在源代码中可见。在本文中,我们将检验这些改进的集合,并通过消融研究来评估它们对最终模型准确性的影响。我们将展示,通过将这些改进结合在一起,我们能够显著地改进各种CNN模型。例如,我们在ImageNet上将ResN

Tricks of the Windows game programming gurus

版权声明:原创作品,允许转载,转载时请务必以超链接形式标明文章原始出版、作者信息和本声明。否则将追究法律责任。 http://blog.csdn.net/topmvp - topmvp Tricks of the Windows Game Programmin Gurus, 2E takes the reader through Win32 programming, covering all

Lifehacker: 88 Tech Tricks to Turbocharge Your Day

版权声明:原创作品,允许转载,转载时请务必以超链接形式标明文章原始出版、作者信息和本声明。否则将追究法律责任。 http://blog.csdn.net/topmvp - topmvp Redefine your personal productivity by tweaking, modding, mashing up, and repurposing Web apps, desktop s

Flex 3 Cookbook: Code-Recipes, Tips, and Tricks for RIA Developers

版权声明:原创作品,允许转载,转载时请务必以超链接形式标明文章原始出版、作者信息和本声明。否则将追究法律责任。 http://blog.csdn.net/topmvp - topmvp The best way to show off a powerful new technology is to demonstrate real-world results with it, and that

从39个kaggle竞赛中总结出来的图像分割的Tips和Tricks(附资源)

来源:AI公园本文约2700字,建议阅读10分钟本文与你分享参加了39个Kaggle比赛的技巧和经验。 想象一下,如果你能得到所有的tips和tricks,你需要去参加一个Kaggle比赛。我已经超过39个Kaggle比赛,包括: Data Science Bowl 2017 – $1,000,000Intel & MobileODT Cervical Cancer Screening

hdu contest day1 1007 Tricks Device

传送门:http://acm.hdu.edu.cn/contests/contest_showproblem.php?cid=589&pid=1007 思路:预处理出最短路,跑最小割 lll的代码: #include<bits/stdc++.h>#define maxn 2100#define maxm 180000#define inf 0x7fffffff#define mi

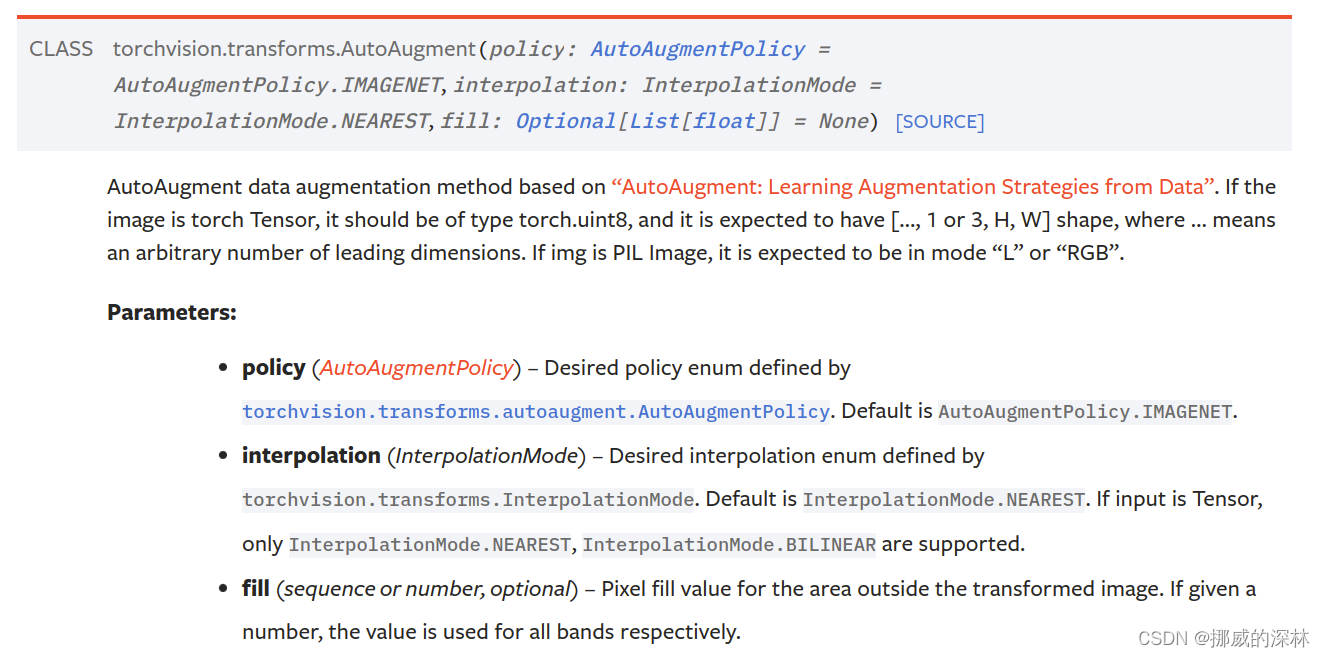

【Pytorch 第四讲】图像分类的Tricks

1. 标签平滑 在分类问题中,最后一层一般是全连接层,然后对应标签的one-hot编码,即把对应类别的值编码为1,其他为0。这种编码方式和通过降低交叉熵损失来调整参数的方式结合起来,会有一些问题。这种方式会鼓励模型对不同类别的输出分数差异非常大,或者说,模型过分相信它的判断。但是,对于一个由多人标注的数据集,不同人标注的准则可能不同,每个人的标注也可能会有一些错误。模型对标签的过分相信会导致过

ResNet 皮肤癌分类tricks总结

project introduction project使用的数据为皮肤癌的图片数据,分为了训练和测试集,两个数据集内图片没有重合,均为彩色图像,因为为良恶性皮肤癌的二分类任务,所以相对来讲比较简单。对于网络选择我个人不是很赞成使用算力很大的网络来提升参数指标,毕竟大算力可能会造成落地困难并且较大的算力并不亲民。 Approach 与分割任务不同,分类任务对应的label不会改变所以可以随心

Hibernate Tips Tricks 1

You can count the number of query results without returning them: 你可以统计查询结果的数目而不必实际返回他们: ((Long)session.createQuery("select count(*) from ……").iterate().next() ).intValue()

PyTorch使用Tricks:Dropout,R-Dropout和Multi-Sample Dropout等 !!

文章目录 1、为什么使用Dropout? 2、Dropout的拓展1:R-Dropout 3、Dropout的拓展2:Multi-Sample Dropout 4、Dropout的拓展3:DropConnect 5、Dropout的拓展4:Standout 6、Dropout的拓展5:Gaussian Dropout 1、为什么使用Dropout? Dropout是一种在神经网络训

Deep Neural Networks for YouTube Recommendations 工程Tricks总结

Deep Neural Networks for YouTube Recommendations 2016 继项亮书后值得反复品味的推荐入门神文。 首先奉上两位大佬的博客,也是主要参考的地方。其实这篇文章已经看过两三次了,一些地方总是看不懂,直到这两天王喆大佬在某乎提供了一个大家分享经验的平台后,很多地方都理解了,一些至今仍在工程中应用的东西,原来都能在这篇文章中找到。 王喆 沙韬伟 其

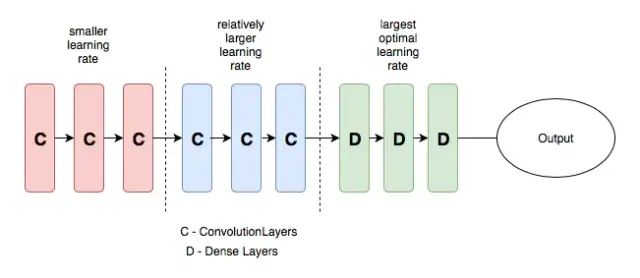

深度学习模型训练调参的tricks总结

目录 一、调参tricks总结分析 1、数据与标签角度 1.1 数据归一化 1.2 数据增强 1.3、标签平滑(Label Smoothing) 2、权重初始化 (Weight Initialization) 3、学习率角度 3.1、Warm up 3.2、Linear scaling learning rate —— learning-rate与batch-size的关系

语义分割技巧:纯工程tricks

转自:https://www.zhihu.com/question/272988870/answer/562262315 作者:AlexL 知乎问题:有关语义分割的奇技淫巧有哪些? AlexL的回答: 代码取自在Kaggle论坛上看到的帖子和个人做过的project 1. 如何去优化IoU 在分割中我们有时会去用intersection over union去衡量模型的表现,具体定义

Tips Tricks

1: options -> preferences -> Display, 去掉"Trim long path names with ellipses", 这样就可以在source insight下显示文件的完整路径了。 2: Source Insight 中得到当前文件名和路径 使用 Source Insight 过程中,有时需要使用当前文件的文件名或路径,

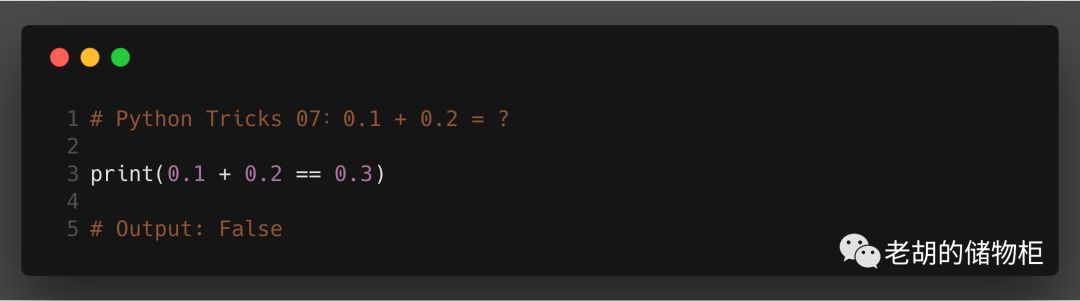

Python Tricks 07:0.1 + 0.2 = ?

在二进制浮点中,0.1和0.2都不能精确表示 具体为什么,可以点击阅读原文看这篇文章:Why 0.1 Does Not Exist In Floating-Point - Exploring Binary 往期推荐:

Python Tricks 06:**kwargs 的⽤法

**kwargs允许你将不定长度的键值对, 作为参数传递给⼀个函数。 如果你想要在⼀个函 数⾥处理带名字的参数, 你应该使⽤ **kwargs: 参考:GitHub - yasoob/intermediatePython,见阅读原文 往期推荐:

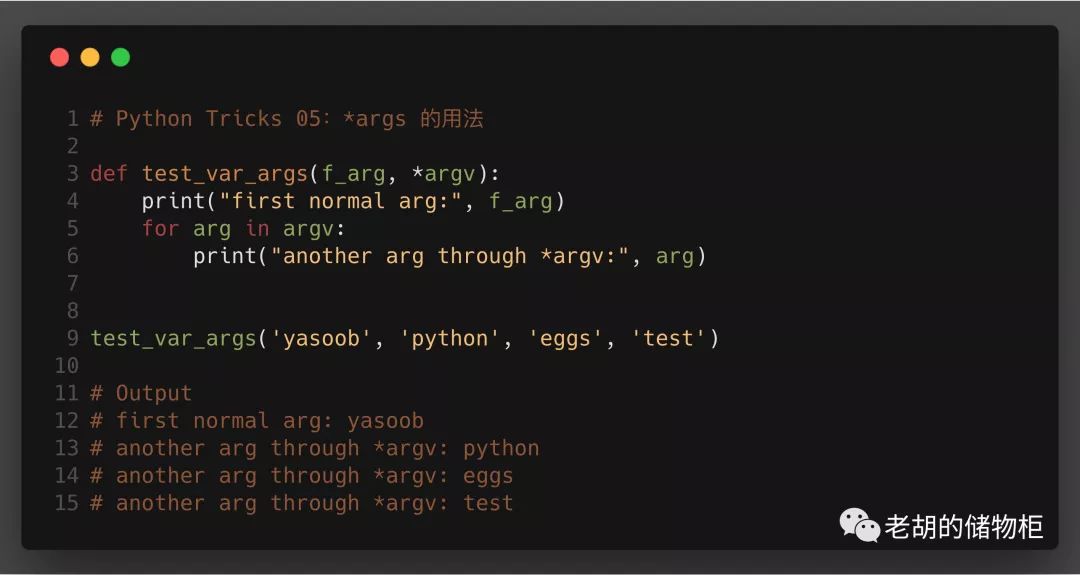

Python Tricks 05:*args 的⽤法

对于初学者来说,可能比较难以理解 *args这个魔术变量,其实不用考虑 args,主要将注意力放在*即可,你写成 *var也完全没有问题 *args主要用于函数定义,它可以接收不定数量的参数,具体请看例子: 参考:GitHub - yasoob/intermediatePython,见阅读原文 往期推荐:

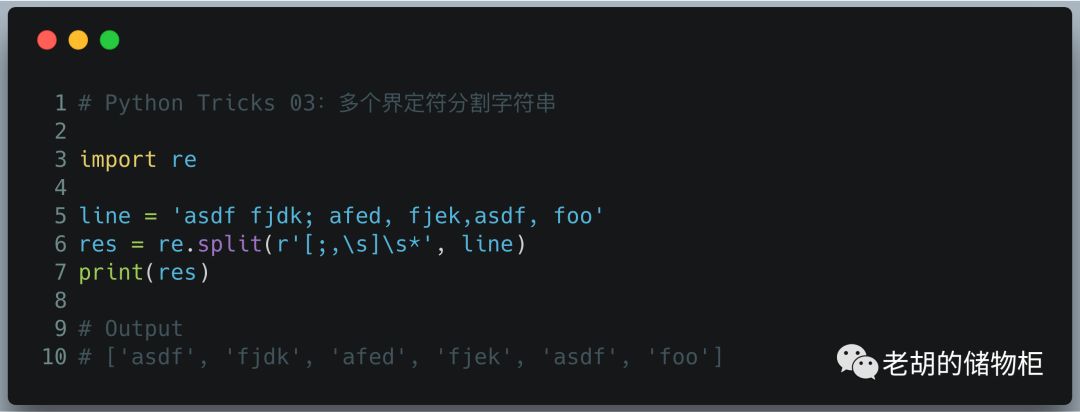

Python Tricks 03:多个界定符分割字符串

将字符串 a = 'asdf fjdk; afed, fjek,asdf, foo' 的元素分割出来,其中分隔符(还有周围的空格)并不是固定 你有其他方案么?欢迎留言