retinanet专题

CV-笔记-RetinaNet和Focal Loss

目录 1 Focal Loss1.1 之前目标检测中解决样本不平衡的方法1.2 Focal loss1.2.1 普通的加权方式1.2.2 focal loss 2 RetinaNet2.1 FPN2.2 anchor2.3 打label2.4 分类分支2.5 回归分支2.6 推理阶段 Inference阶段 也就是预测阶段2.5 训练阶段2.5.1 参数初始化 网络训练细节 结果引用

目标检测之RetinaNet(Focal Loss)

一、目标检测之RetinaNet(Focal Loss) Focal Loss for Dense Object Detection 论文链接:https://arxiv.org/abs/1708.02002论文翻译:https://blog.csdn.net/PPLLO_o/article/details/88952923论文详解:https://blog.csdn.net/JNingWei

Pytorch下Retinanet的代码调试

最近在复现经典cv论文的网络结构,经典的AlexNet,VGG等网络由于基本都是同源的。基本只是深度和预处理的代码不同,因此用Pytorch搭建起来很容易,到了RetinaNet,由于其将多个网络融合,代码和实验量较大(RetinaNet论文的实验量吓到我了,真、实验狂魔)复现起来较困难,因此选择了取github上下载大佬的代码来用。此帖记录了跑代码的过程和全程遇到问题的解决方案。 一、项目链接

[Focal Loss] Retinanet

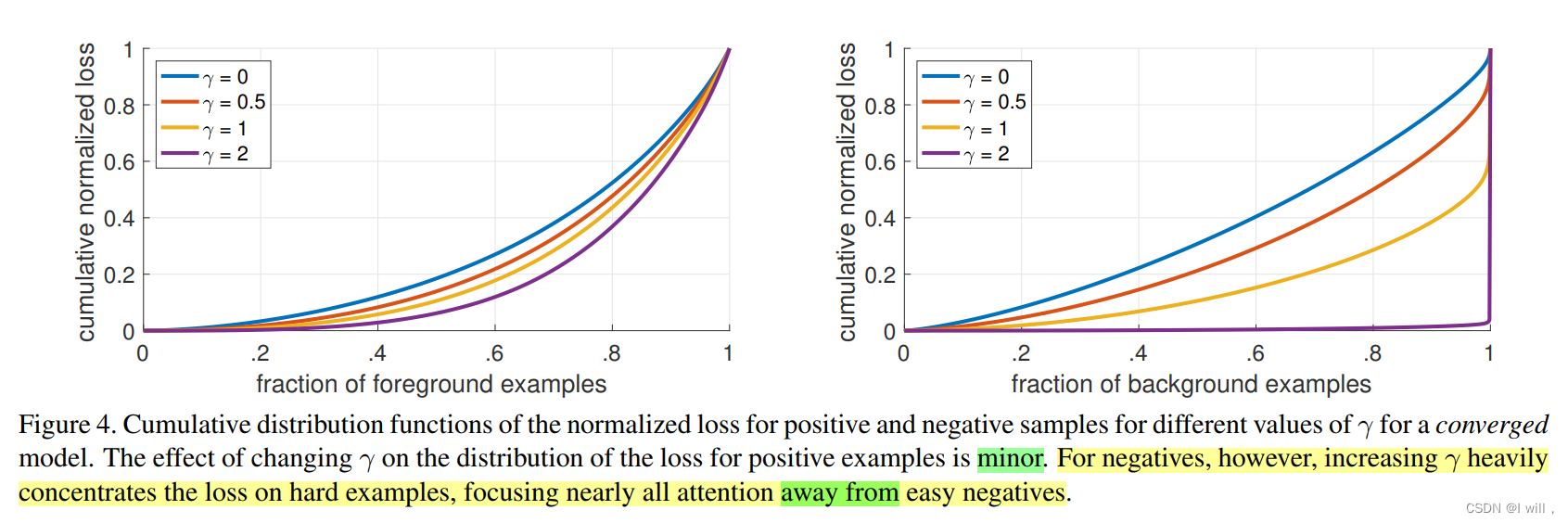

1、解决的问题 一阶段检测网络的性能瓶颈:dense detector场景下,前景-背景训练样本极度不平衡 2、Focal loss 1)通过增加项,让网络更关注难的、容易误分的样本;减少大量easy negative的权重,使得他们对loss的贡献更小 2)γ越大,容易样本的weight越小(γ = 0时,focal loss和CE l

目标检测经典工作:RetinaNet和它背后的Focal Loss

点击上方“AI算法修炼营”,选择“星标”公众号 精选作品,第一时间送达 RetinaNet 是通过对单目标检测模型 (如 YOLO 和 SSD) 进行两次改进而形成的: 1.Feature Pyramid Networks for Object Detection (https://arxiv.org/abs/1612.03144) 2.Focal Loss for Dense Object

第97步 深度学习图像目标检测:RetinaNet建模

基于WIN10的64位系统演示 一、写在前面 本期开始,我们继续学习深度学习图像目标检测系列,RetinaNet模型。 二、RetinaNet简介 RetinaNet 是由 Facebook AI Research (FAIR) 的研究人员在 2017 年提出的一种目标检测模型。它是一种单阶段(one-stage)的目标检测方法,但通过引入一个名为 Focal Loss 的创新损失函数

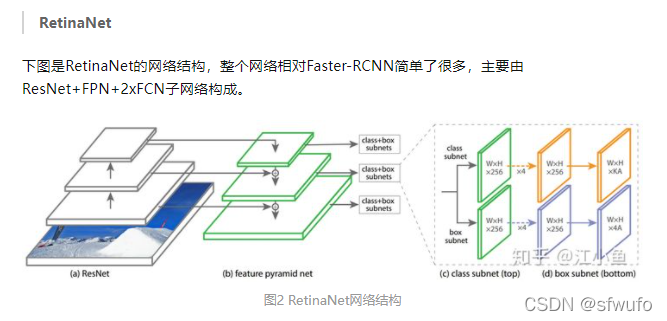

RetinaNet网络

来源:2022年02月阅读文献《基于改进RetinaNet的跑道边灯亮度检测》http://www.opticsjournal.net/Articles/OJ8fa2b1a080c41792/Abstract 参考:目标检测算法 - RetinaNet - 知乎 (zhihu.com) 实例分割算法 - Mask-RCNN - 知乎 (zhihu.com) 摘要: 为了

RetinaNet论文翻译

论文原文:https://arxiv.org/abs/1708.02002v2代码:GitHub - facebookresearch/Detectron: FAIR's research platform for object detection research, implementing popular algorithms like Mask R-CNN and RetinaNet. 标

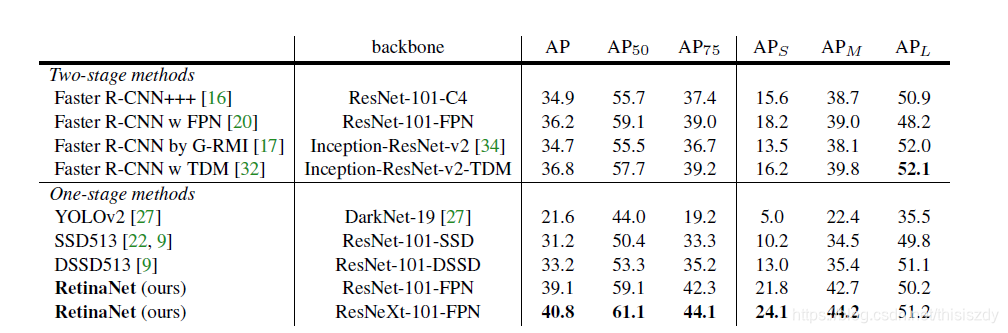

目标定位与检测系列(12):RetinaNet

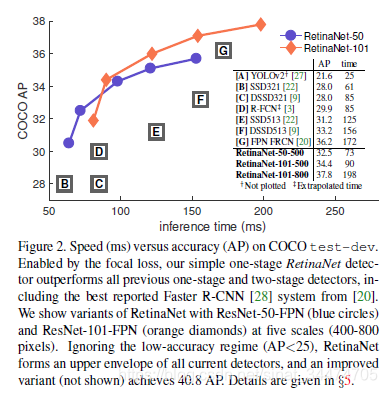

论文链接:RetinaNet 摘要 目前目标检测任务中精度最高的模型是基于主流的R-CNN框架的二阶段模型,该类方法在一些列目标候选框上进行分类。相对的,一阶段模型直接在大量的可能包含目标的区域进行检测,这样做速度更快但相比于两阶段模型也牺牲了精度,我们在本文工作中分析了这个问题的原因。我们发现训练过程中正负样本(指前景和背景)之间严重的不平衡是主要原因。我们通过修改标准的交叉信息熵损失函数来

![[Focal Loss] Retinanet](https://img-blog.csdnimg.cn/20210408143358250.png)