本文主要是介绍Pytorch下Retinanet的代码调试,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

最近在复现经典cv论文的网络结构,经典的AlexNet,VGG等网络由于基本都是同源的。基本只是深度和预处理的代码不同,因此用Pytorch搭建起来很容易,到了RetinaNet,由于其将多个网络融合,代码和实验量较大(RetinaNet论文的实验量吓到我了,真、实验狂魔)复现起来较困难,因此选择了取github上下载大佬的代码来用。此帖记录了跑代码的过程和全程遇到问题的解决方案。

一、项目链接

我采用了github上star最多的pytorch版本: yhenon 大佬的复现版本,项目传送门: yhenon /pytorch-retinanet .

二、运行环境

操作系统:windows10

IDE:Pycharm

python版本:anaconda Pyhon3.7

pytorch版本:torch 1.1.0 cpu-only

torchvision版本:torchvision 0.3.0 cpu-only

由于硬件限制,我的GPU显存太小,于是选择了CPU版本,目的也不是完整地训练网络,就是看看代码+跑几个epoch+看看作者提供的预训练数据的可视化结果

因为涉及到一些模块源代码的修改,所以推荐使用conda create命令单独新建虚拟环境来运行这个项目,新建虚拟环境后键入以下命令来一键配置torch+torchvision:

conda install pytorch-cpu==1.1.0 torchvision-cpu==0.3.0 cpuonly -c pytorch

三、配置运行

3.1安装依赖模块

作者在项目页面给出了需要的模块,另外还有一些依赖库,我合并了一下,在terminal中执行以下命令来安装:

pip install pandas

pip install scikit-image

pip install Cython

pip install opencv-python

pip install requests

conda install git

pip install pycocotools

需要注意的是,在windows下执行pip安装pycocotools模块会报错,是因为早期的版本兼容性问题,现在大佬们已经解决了这些问题,首先安装Visual C++ 2015 build tools:然后执行下方git命令即可,这也是为什么我在pip安装pycocotools之前先conda安装了git模块。

解决:如果pip install pycocotools报错,则在terminal中粘贴执行如下命令:

1.安装Visual C++ 2015 build tools:点击这里.下载,然后执行即可傻瓜式安装

安装后在Terminal中执行下面命令:

pip install git+https://github.com/philferriere/cocoapi.git#subdirectory=PythonAPI

即可完成安装。

3.2下载COCO数据集:

以下是COCO2017数据集的连接,数据集大约30G,推荐复制链接后使用迅雷下载:

train2017:http://images.cocodataset.org/zips/train2017.zip.

val2017:http://images.cocodataset.org/zips/val2017.zip.

test2017:http://images.cocodataset.org/zips/test2017.zip.

trainval2017:http://images.cocodataset.org/annotations/annotations_trainval2017.zip.

trainval2017_stuff_annotation:http://images.cocodataset.org/annotations/stuff_annotations_trainval2017.zip.

image_info_test2017:http://images.cocodataset.org/annotations/image_info_test2017.zip.

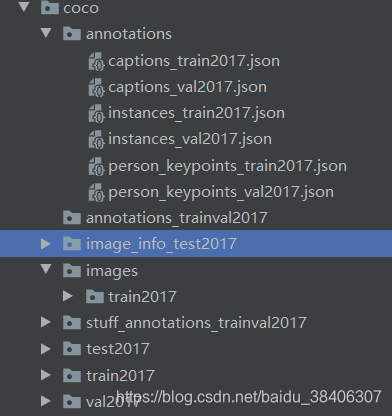

数据集下载完毕后解压,在项目根目录下建立coco文件夹,coco内部建立images文件夹,把数据集的train2017文件夹放入到images文件夹中,另外annotations_trainval2017下的annotations文件夹也剪切出来单独放在coco文件夹下,其余数据集不用动,直接放在coco文件夹下。数据集合摆放如图:

3.3开始训练:

在Terminal中进入项目路径,并输入以下命令开始训练:

python train.py --dataset coco --coco_path ./coco --depth 50

测试训练正常,但是由于硬件的原因,训练的很慢,5分钟一个iteration,13个小时左右才能跑完一个epoch,可以运行,但硬件限制无法跑出结果,就不上图了。

3.4使用预训练模型进行可视化测试:

作者提供了训练好的模型供我们使用,首先下载模型:

预训练模型-下载

下载完成后把文件放在项目根目录,然后打开visualize.py,在加载模型的代码附近做如下修改:

我注释掉的是作者原来的代码,51,,52新增加了两行来初始化模型并加载作者训练好的权重。

我注释掉的是作者原来的代码,51,,52新增加了两行来初始化模型并加载作者训练好的权重。

代码修改完毕后先来尝试运行,在Terminal中输入以下命令来开始执行:

python visualize.py --dataset coco --coco_path ./coco --model ./coco_resnet_50_map_0_335_state_dict.pt

输入完毕后回车,出现问题:

ImportError: cannot import name ‘PILLOW_VERSION’ from ‘PIL’

经过搜索,我发现问题出在torchvision和PIL库的版本不兼容上,我们点击进入最后一条报错信息(错误栈的栈顶)的文件中,Ctrl+R进行查找替换,将所有PILLOW_VERSION替换为__version__,保存退出即可。

修正后再次运行指令:

python visualize.py --dataset coco --coco_path ./coco --model ./coco_resnet_50_map_0_335_state_dict.pt

就可以正常运行了,附一张运行的结果图:

以上代码运行完毕。

以上代码运行完毕。

四、自定义数据集

跑通了代码以后我们就可以自定义自己的数据集进行训练,我总结了两种方法来自定义数据集:

1.仿COCO数据集定义: 按照COCO的数据及定义格式来替换掉本项目中的图片,并配置json文件进行相关的注释。

2.VOC数据集定义: VOC数据集中采用的格式也被很多数据集沿用,我在网上找到了一段将VOC数据集转成项目可以适用的数据集的代码,未经测试,贴上来:

import xml.etree.ElementTree as ET

from os import getcwdsets=[('VOC_TT_512_test', 'train'), ('VOC_TT_512_test', 'val'), ('VOC_TT_512_test', 'trainval')]type42="i2,i4,i5,il100,il60,il80,ip,p10,p11,p12,p19,p23,p26,p27,p3,p5,p6,pg,ph4,ph4.5,ph5,pl100,pl120,pl20,pl30,pl40,pl5,pl50,pl60,pl70,pl80,pm20,pm30,pm55,pn,pne,pr40,w13,w32,w55,w57,w59"

classes = type42.split(',')def convert_annotation(year, image_id, list_file):in_file = open('%s/Annotations/%s.xml'%(year, image_id))tree=ET.parse(in_file)root = tree.getroot()for obj in root.iter('object'):difficult = obj.find('difficult').textcls = obj.find('name').textif cls not in classes or int(difficult)==1:continuecls_id = classes.index(cls)xmlbox = obj.find('bndbox')b = (int(xmlbox.find('xmin').text), int(xmlbox.find('ymin').text), int(xmlbox.find('xmax').text), int(xmlbox.find('ymax').text))list_file.write("," + ",".join([str(a) for a in b]) + ',' + str(cls_id))wd = getcwd()for year, image_set in sets:image_ids = open('%s/ImageSets/Main/%s.txt'%(year, image_set)).read().strip().split()list_file = open('csv%s_%s.txt'%(year, image_set), 'w')for image_id in image_ids:list_file.write('%s/%s/JPEGImages/%s.jpg'%(wd, year, image_id))convert_annotation(year, image_id, list_file)list_file.write('\n')list_file.close()

这篇关于Pytorch下Retinanet的代码调试的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!