nnlm专题

[NNLM]论文实现:A Neural Probabilistic Language Model [Yoshua Bengio, Rejean Ducharme, Pascal Vincent]

A Neural Probabilistic Language Model 一、完整代码1.1 Python 完整程序 二、论文解读2.1 目标 三、过程实现3.1 Tensorflow模型3.2 数据准备3.3 数据训练和预测 四、整体总结 论文:A Neural Probabilistic Language Model 作者:Yoshua Bengio; Rejean Du

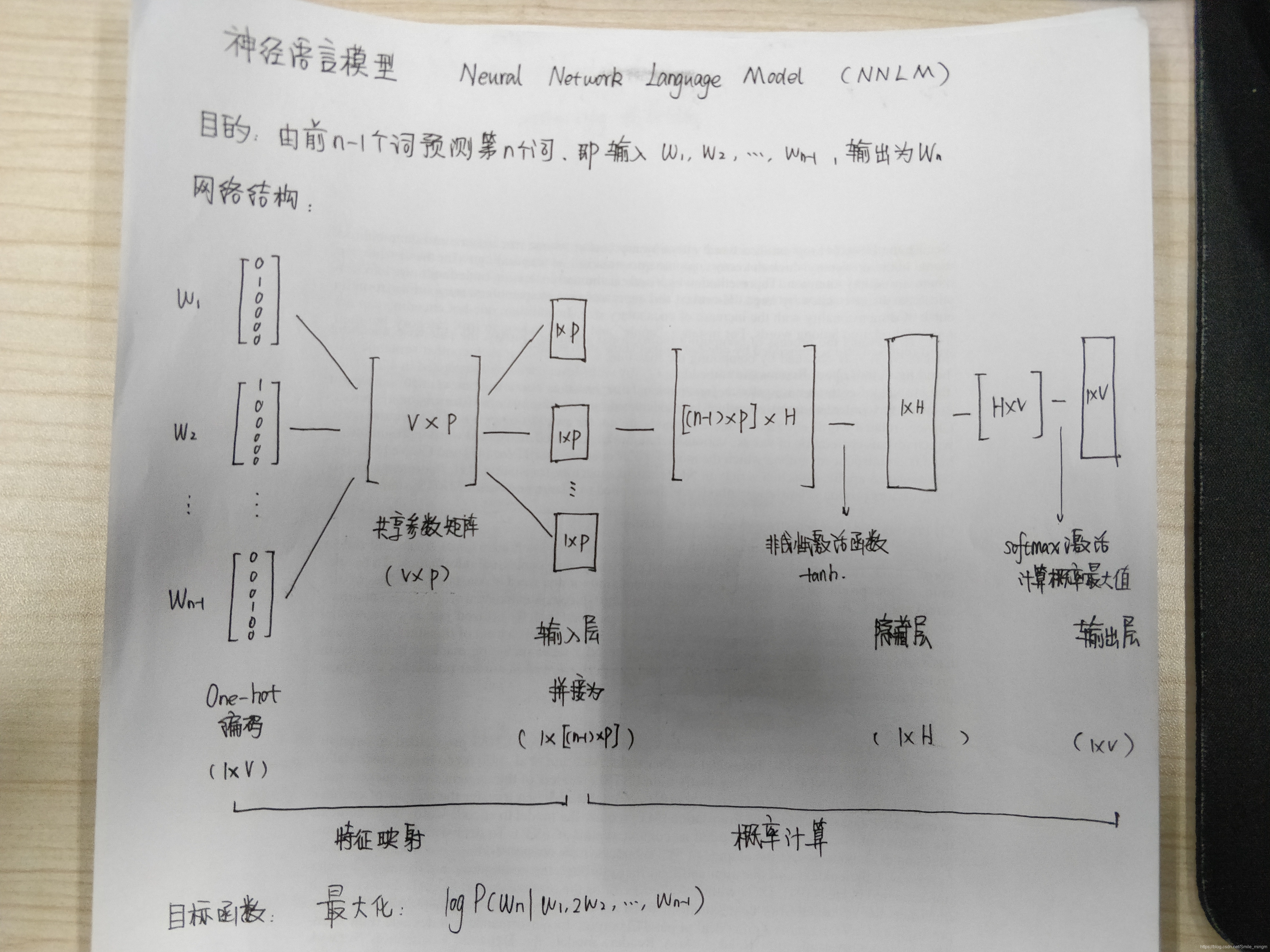

神经网络语言模型(Neural Network Language Model,NNLM)

神经网络语言模型(Neural Network Language Model,NNLM)是一种用神经网络建模语言的方法。NNLM 通过学习文本序列中的词汇之间的概率关系,能够捕捉到语言的结构和语境,从而能够生成自然语言文本或进行其他与语言相关的任务。 想象一下,你正在阅读一本小说。每当你读到一个单词时,你的大脑都在努力理解上下文,以便预测下一个单词是什么。NNLM的工作方式类似于这个过程。它通过

神经网络语言模型(NNLM)

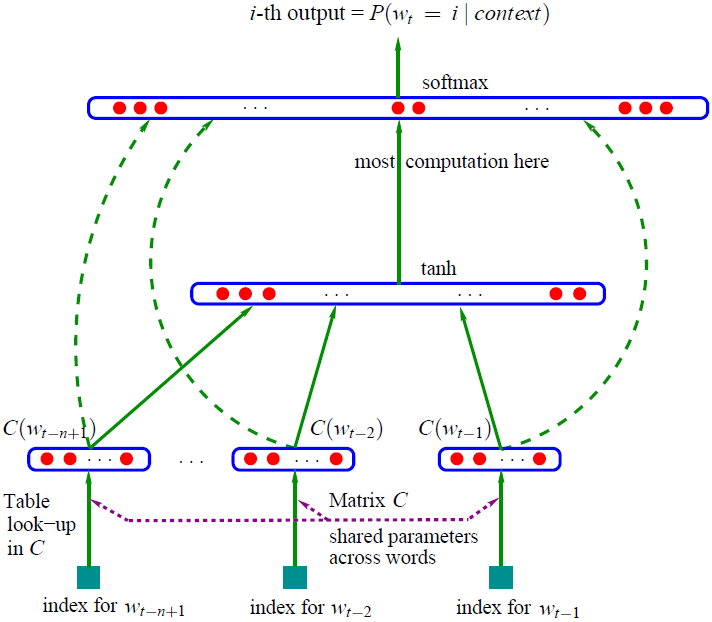

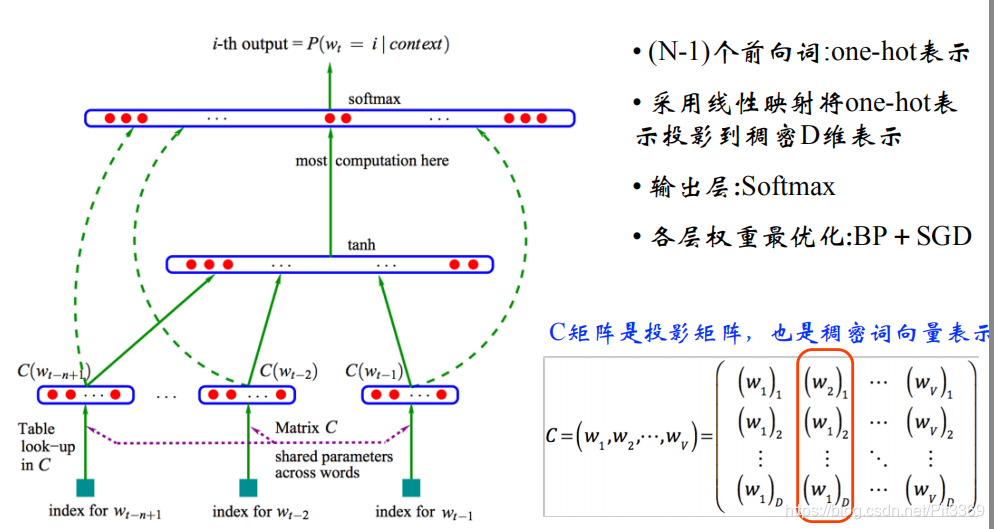

#1. 模型原理 用神经网络来训练语言模型的思想最早由百度 IDL (深度学习研究院)的徐伟提出[1],其中这方面的一个经典模型是NNLM(Nerual Network Language Model),具体内容可参考 Bengio 2003年发表在JMLR上的论文[2] 模型的训练数据是一组词序列$ w_{1 } . . . ... ...w_{T} , , ,w_{t} \in V$。其中

入门通俗易懂的神经网络语言模型(NNLM)详解

文章目录 神经网络语言模型(NNLM)输入层(投射层)隐藏层输出层计算复杂度 神经网络语言模型(NNLM) 输入层(投射层) 一个文本,由N个词语组成,现在呢:想根据 前N个词语 来预测 第N个词语 是啥? 我们采用的语料库V(也就是我们最大限度能想到的的所有词语集合)包含10万个词语 词向量W:是一个one-hot向量,大小=[10W,1],W(t)表示第t个词语的

NLP----神经网络语言模型(NNLM),词向量生成,词嵌入,python实现

理论主要来自论文A Neural Probabilistic Language Model,可以百度到的 这篇博文对理论方面的介绍挺不错的 链接地址 一下是其中的一些截图,主要是算法步骤部分 算法步骤 前向计算 反向更新 个人实现的代码 import globimport randomimport mathimport pickleimport num

![[NNLM]论文实现:A Neural Probabilistic Language Model [Yoshua Bengio, Rejean Ducharme, Pascal Vincent]](https://img-blog.csdnimg.cn/9d892cdb8578462895e354e22f12e9c6.png)