mutual专题

【读论文】MUTUAL-CHANNEL LOSS

论文题目:《The Devil is in the Channels: Mutual-Channel Loss for Fine-Grained Image Classification》 链接:https://arxiv.org/abs/2002.04264 来源:IEEE TIP2020 细粒度分类的主要思想是找出各个子类间的可区分特征,因此文章指出要尽早在通道上进行钻研,而不是从合并

基于Stereo Processing by Semiglobal Matching and Mutual Information对SGM算法的理解

看大佬的分析,醍醐灌顶!大家对算法的一些困惑也贴上来。 (转载http://blog.csdn.net/wsj998689aa/article/details/49464017, 作者:迷雾forest) SGM算法源于《Stereo Processing by Semi-Global Matching and Mutual Information》一文,我认为这篇文章是立体匹配算法中最给力的,放

Stereo Processing by Semi-Global Matching and Mutual Information基础算法解析

*原创文章,非作者允许,禁止一切形式的转载。 Stereo Processing by Semi-Global Matching and Mutual Information 是立体匹配中一个非常有名的算法,算法快、重建精度也不错、非常适合并行加速。 A.匹配代价计算 这部分作者在讲匹配代价计算,作者用的是信息熵,然而在实际应用中发现这一匹配代价好像效果也比较一般,使用census t

normalized_mutual_info_score评价

今天发现一个很奇怪的东西,就是我使用sklearn库进行计算normalized_mutual_info_score时,发现有两种语法 from sklearn.metrics.cluster import normalized_mutual_info_scoreprint(normalized_mutual_info_score([0, 0, 1, 1], [0, 0, 1, 1]))pr

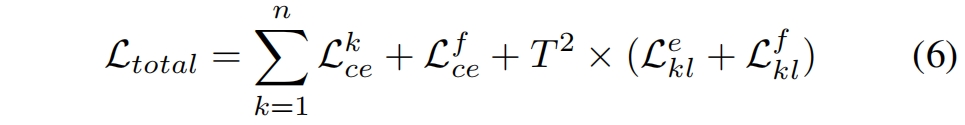

变分互信息蒸馏(Variational mutual information KD)

原文标题是Variational Information Distillation for Knowledge Transfer,是CVPR2019的录用paper。 VID方法 思路比较简单,就是利用互信息(mutual information,MI)的角度,增加teacher网络与student网络中间层特征的MI,motivation是因为MI可以表示两个变量的依赖程度,MI越大,表明

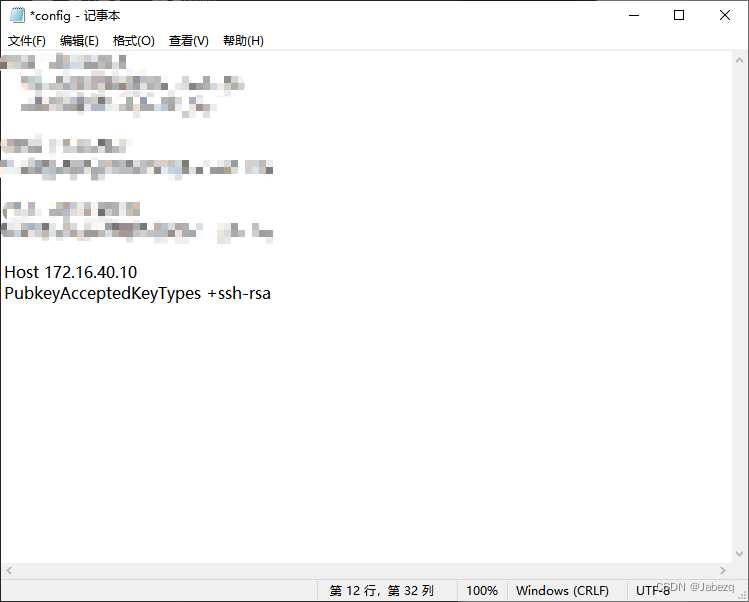

ssh连接 send_pubkey_test: no mutual signature algorithm

ssh连接过程出错或者还需输入密码,可以添加-vvv打断点调试,例如: 可以看到导致问题的原因:send_pubkey_test: no mutual signature algorithm 解决办法之一: 打开 .ssh/config 文件添加下面 其实简单讲就是加密算法不同,改配置文件让指定IP使用旧版的加密算法就行。

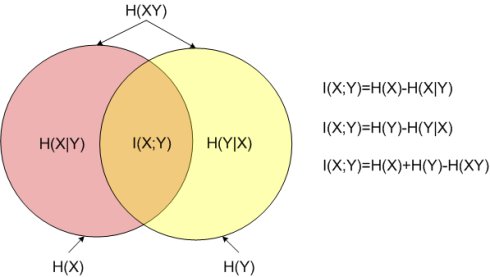

条件互信息的理解(Conditional Mutual Information)

在概率论,尤其是信息论中,条件互信息的基本形式是在给定第三个变量值的情况下,两个随机变量互信息的期望值。 对于离散随机变量X,Y,Z,其条件互信息为: 用图形表示条件互信息为: 具体的定义等后续补充。

Feature Fusion for Online Mutual KD

paper:Feature Fusion for Online Mutual Knowledge Distillation official implementation:https://github.com/Jangho-Kim/FFL-pytorch 本文的创新点 本文提出了一个名为特征融合学习(Feature Fusion Learning, FFL)的框架,该框架通过一个组合并行网

【MMT】ICLR 2020: MMT(Mutual Mean-Teaching)方法,无监督域适应在Person Re-ID上性能再创新高

原文链接 小样本学习与智能前沿 。 在这个公众号后台回复“200708”,即可获得课件电子资源。 为了减轻噪音伪标签的影响,文章提出了一种无监督的MMT(Mutual Mean-Teaching)方法,通过在迭代训练的方式中使用离线精炼硬伪标签和在线精炼软伪标签,来学习更佳的目标域中的特征。同时,还提出了可以让Traplet loss支持软标签的soft softmax-triplet lo

InfoGraph方法部分 (Unsupervised and Semi-supervised Graph-Level Representation Learning via Mutual Info)

目录 摘要 贡献 方法 问题定义 INFOGRAPH 论文链接:https://arxiv.org/abs/1908.01000 摘要 本文研究了在无监督和半监督情况下学习整个图的表示。图级表示在各种现实应用中至关重要,例如预测分子的属性和社交网络中的社区分析。 传统的基于图核的方法很简单,但对于获得图的固定长度表示很有效,但由于手工设计,它

互信息 java_互信息(Mutual Information)是度量两个事件集合之间的相关性(mutual depe...

互信息(Mutual Information)是度量两个事件集合之间的相关性(mutual dependence)。 平均互信息量定义: 互信息量I(xi;yj)在联合概率空间P(XY)中的统计平均值。 平均互信息I(X;Y)克服了互信息量I(xi;yj)的随机性,成为一个确定的量。 平均互信息量的物理含义 1) 观察者站在输出端: H(X/Y) —信道疑义度/损失熵.。Y关于X的后验不确定