本文主要是介绍论文略读:Window Attention is Bugged: How not to Interpolate Position Embeddings,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

iclr 2024 reviewer 打分 6666

- 窗口注意力、位置嵌入以及高分辨率微调是现代Transformer X CV 时代的核心概念。

- 论文发现,将这些几乎无处不在的组件简单地结合在一起,可能会对性能产生不利影响

- 问题很简单:在使用窗口注意力时对位置嵌入进行插值是错误的

- 相对位置嵌入直接添加到注意力矩阵——>不仅速度慢,而且无法从最近的创新中受益

- 理想情况下,希望只使用简单快速的绝对位置嵌入,就像最初的ViT一样

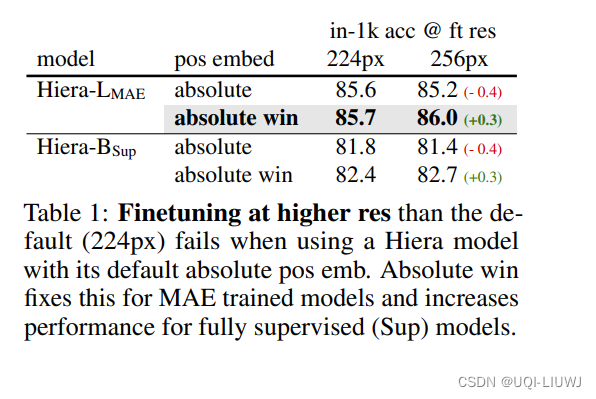

- 论文研究了两种具有这三个组件的最先进方法,即Hiera和ViTDet,发现两者确实都存在这个问题

- Hiera是一个现代层次化视觉变换器,只使用绝对位置嵌入。

- Hiera比其他最先进的视觉架构更强大、更高效,而且完全由简单的ViT块组成。

- 但是,Hiera的插值效果不佳

- 当在比训练时稍大的图像上微调Hiera时,所得模型的准确性急剧下降

- 罪魁祸首是窗口注意力和绝对位置嵌入之间的相互作用。

- 即,在同一模型中同时使用窗口注意力和绝对位置嵌入时,在插值到更大的图像时会引入一个错误

- Hiera是一个现代层次化视觉变换器,只使用绝对位置嵌入。

- 为了解决这个问题,论文引入了一种简单的绝对窗口位置嵌入策略,这在Hiera中彻底解决了这个问题,并允许在ViTDet中提高模型的速度和性能

- 可以插值到任何图像大小而不会出现问题

- 最终,论文将两者结合起来,得到了HieraDet,其在COCO上达到了61.7的box mAP

- 这一切都源于本质上是一个3行代码的错误修复,我们将其命名为“absolute win”

- ※论文并不声称引入了任何极其新颖的技术。相反,它识别并分析了当前最先进状态中存在的一个错误,引入了一个简单的策略来修复它,并建立了插值位置嵌入的最佳实践

这篇关于论文略读:Window Attention is Bugged: How not to Interpolate Position Embeddings的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!