本文主要是介绍[MGK∗19] 《Neural rerendering in the wild》(CVPR2019)阅读笔记 (完),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

一、文献拟解决的问题

- 提出了一个完整的场景捕捉框架,利用网络上的图片进行一个大型建筑的全景捕获——重建和渲染

- 将输入的场景图像分解为视点,外观,语义标签,并依靠一个近似的几何代理,我们可以渲染出真实感的图像

- 与过去的一些方法的比较,提高了结果的真实性

效果展示: 【Neural Rerendering in the Wild - CVPR 2019-哔哩哔哩】

二、分析的思路

(一)总览

- 首先,利用传统的三维重建方法(COLMAP)将场景重建为近似的点云数据,并作为几何代理。

- 然后,利用这个几何代理,学习点云中的场景图像到真实图像之间的映射,增强结果的真实性。

(二)神经渲染框架

(三)方法过程介绍

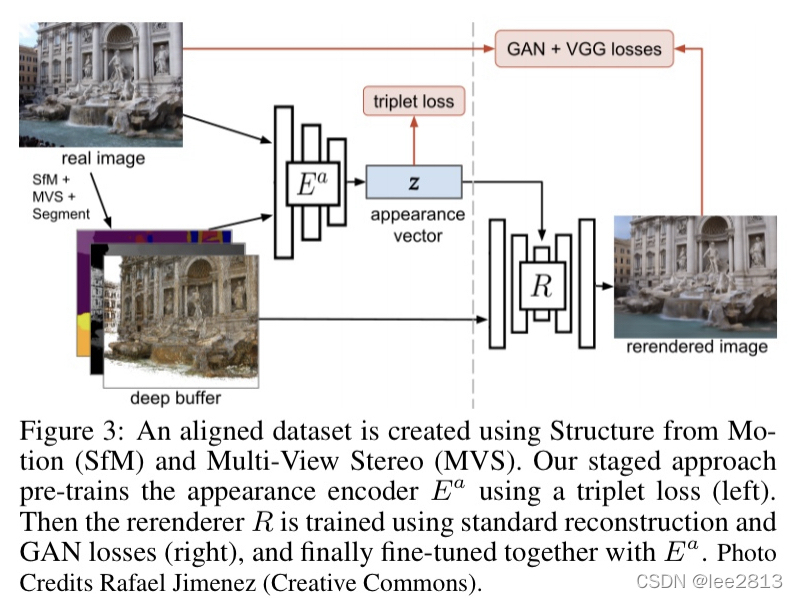

图示:

介绍:

1.关键结构

- 编码器Ea

输入:真实图像,包含图像信息的深度图(包括法线,反射率及其他信息)

输出:图像与深度图之间的配对数据 - 渲染网络R

输入:视点,图像与深度图之间的配对数据

输出:渲染结果

2.外观训练方法

- 第一步:预先训练编码器Ea,提高模型精细度。

- 第二步:训练渲染网络R

- 第三步:对两者进行联合训练

(1)网络设计

使用了BicycleGAN,附加了跨域损失计算,用于物体外观在不同视角下的转换。

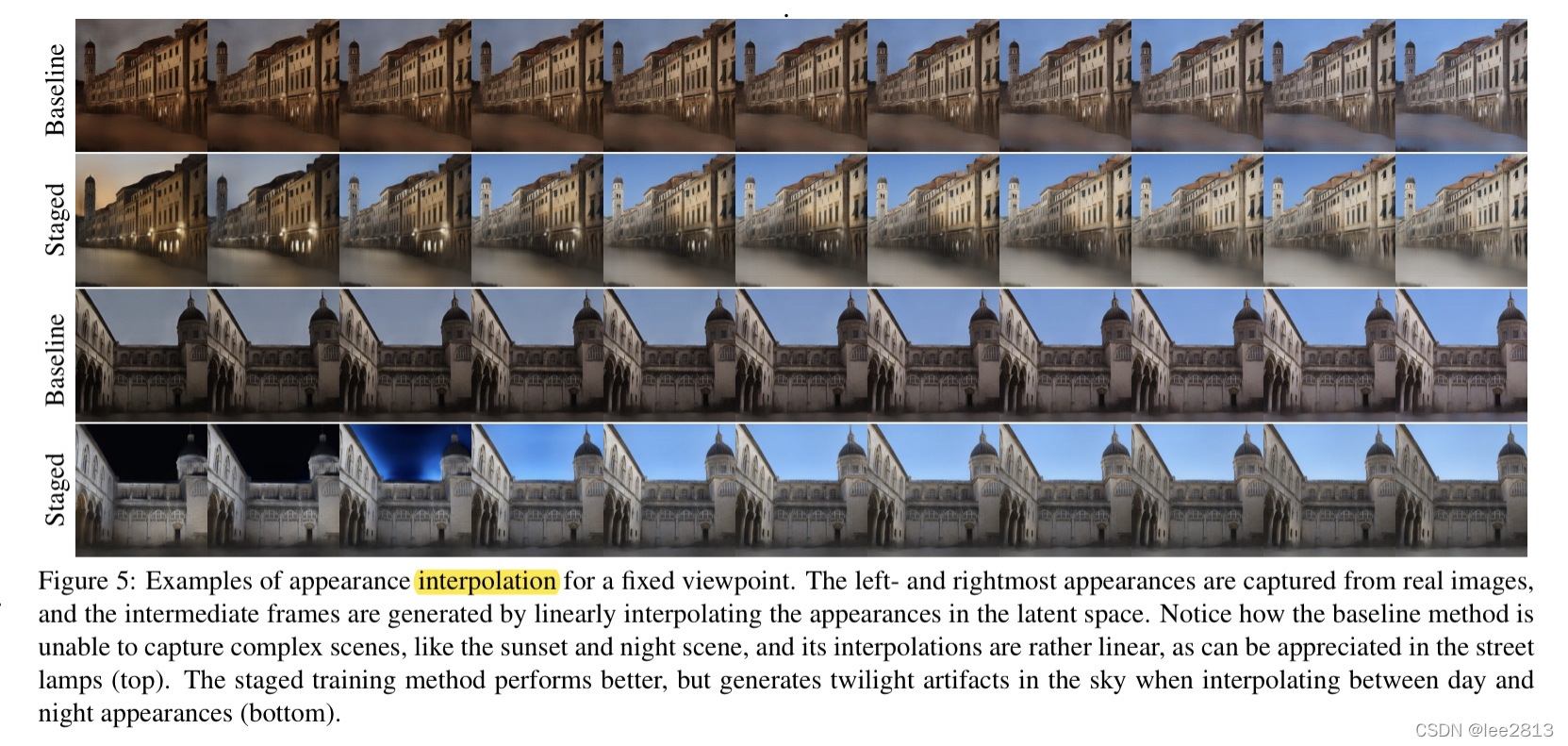

(2)阶段性训练

简化了渲染网络,以及训练轮数

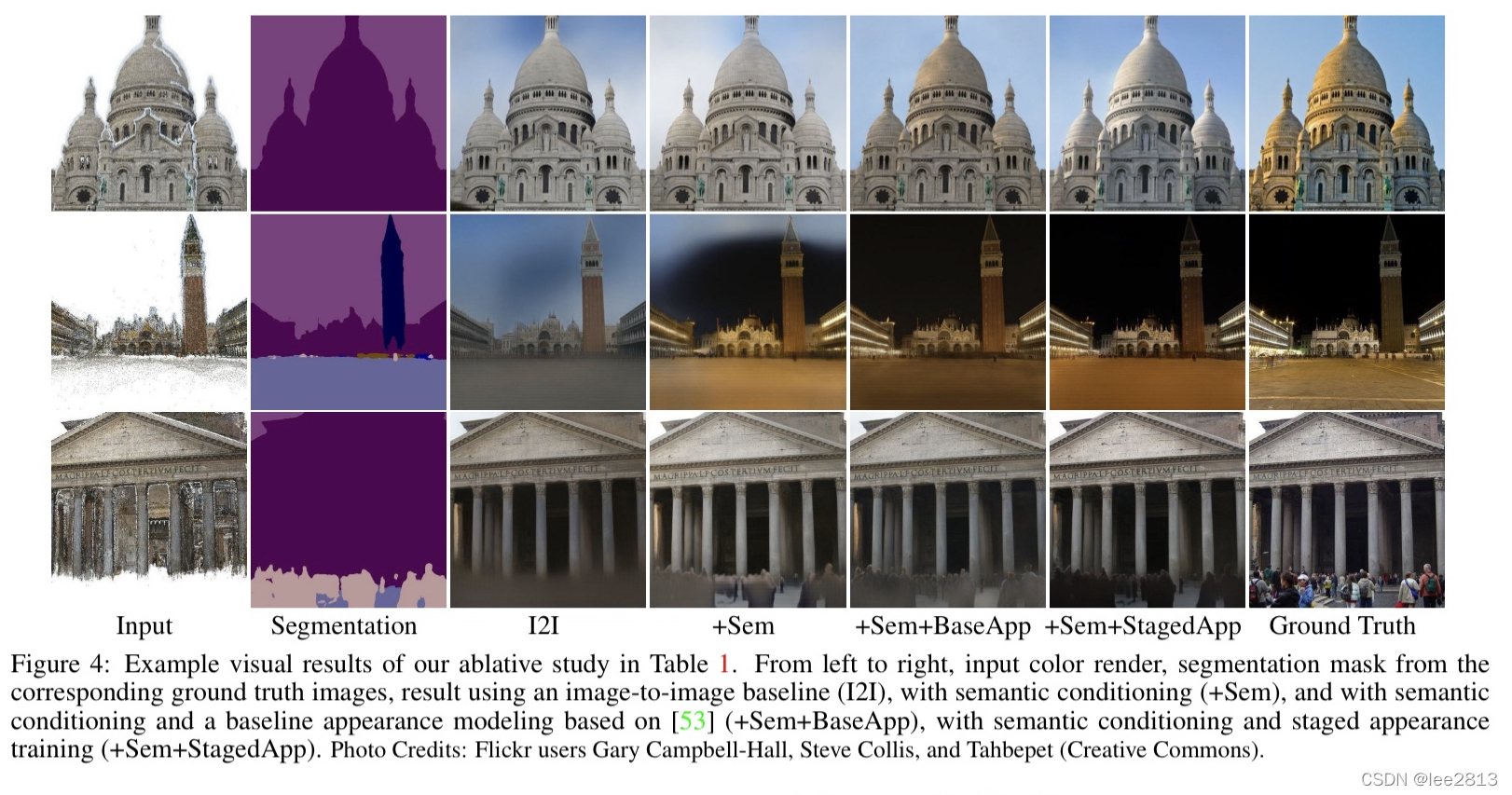

训练效果如下:

(3)预训练外观

在预训练外观阶段,我们选择了一个几何代理,并定义了一个输入图像间的距离度规来优化输入图像到外观的合成。

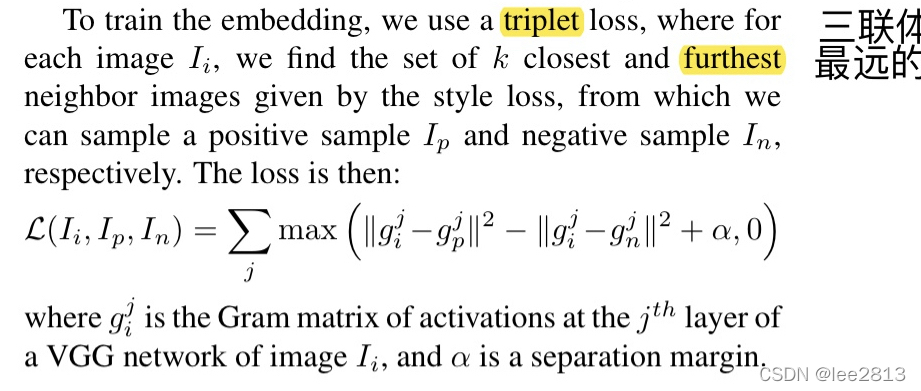

另外,在训练阶段定义了一个三联损失,对于每张图片,正采样后的图片,负采样后的图片进行训练损失的计算。

3.语义训练方法

(1)标签化的好处

- 可以调节单个对象而不是整个被捕获的场景

- 可以在针对某标签物体进行外边编辑的时候考虑其标签信息

(2)训练方法

使用DeepLab网络,及ADE20K对输入的图像进行训练,得到标签化后的结果。

三、评价

1.阶段性训练对于复杂细节的提升

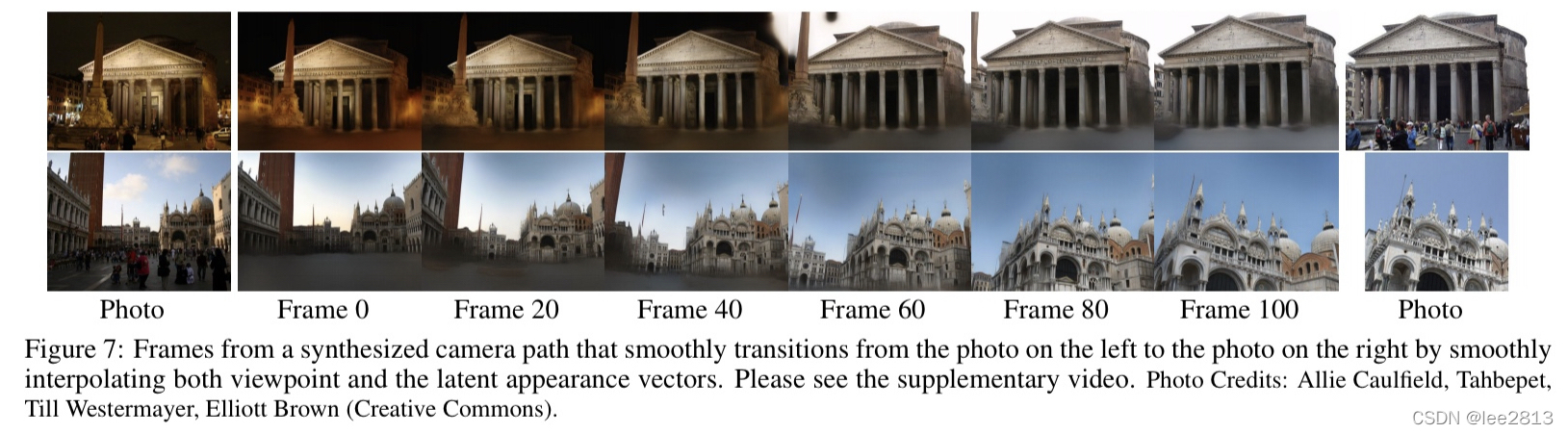

2.神经渲染对于点云结果的重渲染

3.语义图像的在不同语境下的平滑过渡

三、创新点

提出了一套针对户外场景的神经渲染框架,并进行了语义化处理。

四、学术问题

待续

五、个人意义

对于网络的设计仍存在一些疑惑

这篇关于[MGK∗19] 《Neural rerendering in the wild》(CVPR2019)阅读笔记 (完)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!