本文主要是介绍字节发布AnimateDiff-Lightning文生视频模型——可在线免费试玩,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

Sora文生视频大模型

随着Sora文生视频大模型的爆火,文生视频大模型必定是各大人工智能公司竞争的主要领域。虽然 Sora模型的视频效果绝对是领先地位,但是Sora模型目前还没有开放使用,我们并无法直接使用。前期我们也介绍过字节发布的MagicVideo2文生视频模型,但是MagicVideo2并没有提供开源或者试用地址。

MagicVideo2文生视频大模型

本期我们介绍一下字节发布的另外一个文生视频模型AnimateDiff-Lightning,其AnimateDiff-Lightning模型已经上线到hugging face,任何人都可以直接在线试玩。

AnimateDiff文生视频模型

AnimateDiff-Lightning模型

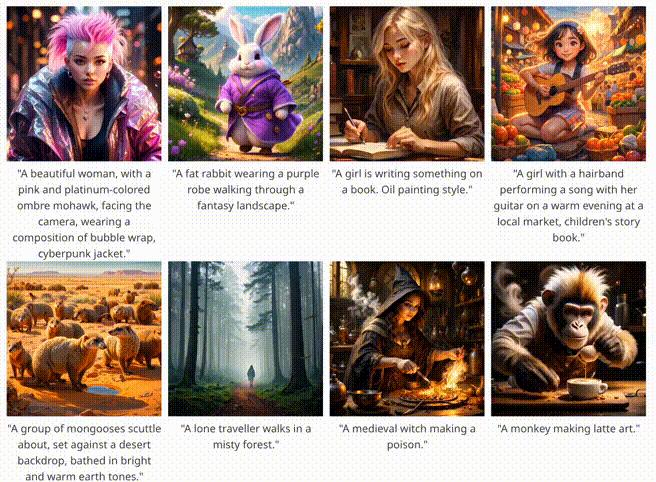

AnimateDiff-Lightning模型是一个轻量级的文生视频大模型,其速度比原始AnimateDiff模型要快10倍以上。此模型基于AnimateDiff SD1.5 v2进行蒸馏,并提供step1,step2,step4,step8四种类型的模型,并提供了开源的预训练模型供大家直接使用,主要分为写实模型与卡通模型。

realistic写实模型主要有5个,可以根据自己的喜好,挑选任意一个模型使用即可。

- epiCRealism

- Realistic Vision

- DreamShaper

- AbsoluteReality

- MajicMix Realistic

Anime & Cartoon卡通模型包含如下6个模型

- ToonYou

- IMP

- Mistoon Anime

- DynaVision

- RCNZ Cartoon 3d

- MajicMix Reverie

AnimateDiff-Lightning模型在线试玩

每个模型都可以直接在hugging face上面下载使用,当然AnimateDiff-Lightning模型也在hugging face上面提供了试玩地址,直接打开官方链接,输入自己需要生成的视频prompt,这里注意的是其prompt是英文格式。选择base model以及视频呈现方式与模型step,点击run等待一会便可以得到自己的视频了。

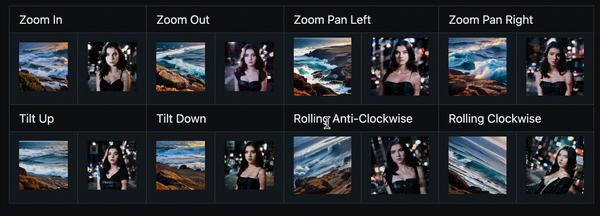

AnimateDiff-Lightning不同视频呈现方式

AnimateDiff-Lightning模型也定义了视频的呈现方式,包含缩放,偏移,旋转等。让生成的视频更具镜头感。

ComfyUI使用AnimateDiff-Lightning模型

AnimateDiff-Lightning模型也可以直接在comfy UI中使用,请按照如下步骤:

下载animatediff_lightning_workflow.json文件,并导入到comfyui

安装nodes

下载AnimateDiff-Lightning模型的预训练模型,并放置在models/checkpoints文件夹

下载AnimateDiff-Lightning模型animatediff_lightning_Nstep_comfyui.safetensors并放置到/custom_nodes/ComfyUI-AnimateDiff-Evolved/models/文件夹下

ComfyUI使用AnimateDiff-Lightning模型

AnimateDiff-Lightning模型除了可以使用文生视频外,还可以直接使用视频到视频生成模型,此模式支持输入一段视频,然后模型根据模型的输入内容,使用control net实现检测人物动作,并根据选择的模型生成对应的视频。

代码使用AnimateDiff-Lightning模型

hugging face上线的在线试玩模型,并没有支持太多的模型,目前只支持epiCRealism与ToonYou模型,其他的模型并没有开放使用,若要完全使用AnimateDiff-Lightning,也可以使用代码来实现文生视频的生成,其代码实现如下:

import torch

from diffusers import AnimateDiffPipeline, MotionAdapter, EulerDiscreteScheduler

from diffusers.utils import export_to_gif

from huggingface_hub import hf_hub_download

from safetensors.torch import load_file

device = "cuda"

dtype = torch.float16

step = 4 # 可供选择: [1,2,4,8]

repo = "ByteDance/AnimateDiff-Lightning"

ckpt = f"animatediff_lightning_{step}step_diffusers.safetensors"

base = "emilianJR/epiCRealism" # 选择自己的模型.

adapter = MotionAdapter().to(device, dtype)

adapter.load_state_dict(load_file(hf_hub_download(repo ,ckpt), device=device))

pipe = AnimateDiffPipeline.from_pretrained(base, motion_adapter=adapter, torch_dtype=dtype).to(device)

pipe.scheduler = EulerDiscreteScheduler.from_config(pipe.scheduler.config, timestep_spacing="trailing", beta_schedule="linear")

output = pipe(prompt="A girl smiling", guidance_scale=1.0, num_inference_steps=step)

export_to_gif(output.frames[0], "animation.gif")AnimateDiff-Lightning模型已经支持hugging face代码,base模型可以选择任意一个介绍的模型,运行以上代码就可以直接生成对应的视频了。

https://github.com/guoyww/AnimateDiff/tree/main?tab=readme-ov-file

https://huggingface.co/ByteDance/AnimateDiff-Lightning

更多transformer,VIT,swin tranformer

参考头条号:人工智能研究所

v号:启示AI科技

微信中复制如下链接,打开,免费使用chatgpthttps://wx2.expostar.cn/qz/pages/manor/index?id=1137&share_from_id=79482&sid=24

动画详解transformer 在线教程

这篇关于字节发布AnimateDiff-Lightning文生视频模型——可在线免费试玩的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!