本文主要是介绍Self Organizing Maps 自映射人工神经网络,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

原文地址:Self Organizing Maps作者:shiqj1980

the ebook: http://davis.wpi.edu/~matt/courses/soms/

using som in excel:http://www.geocities.com/adotsaha/NN/SOMinExcel.html

人工神经网络技术在模式识别方面有着独特的优势,神经网络能够进行非线性数据处理,发现复杂的数据关系,其中,自组织映射神经网络( Self-Organizing Map , SOM )可以对模式数据进行自动聚类。

自组织特征映射是 Kohonen 在 1990 年提出的类似大脑思维的一种人工神经网络方法,它是一种竞争学习算法,可以被认为是一种从 N 维模式空间各点到输出空间少数点的映射。这一映射由系统本身完成,没有外部的监督,即聚类是以自组织的方式实现的。

SOM 采用无教师学习训练,训练完成后,分类信息存储在网络各节点连接权值向量中,与权值向量相似的输入向量将分为一类。 SOM 包括一维和二维模型,二维 SOM 也称为 KFM(Kohonen Feature Mapping) 。它们的区别在于 KFM 考虑邻近神经元的相互作用,即获胜神经元对周围神经元由于距离的不同会产生不同的影响。

KFM 的结构如 图 8.3 所示 ,输入网络的是一个 n 维向量的所有 n 个数值,输出单元呈二维排列,个数为 p × p, 输入层与输出层的各单元之间是全连接的,并用 W 表示连接权重。 KFM 的学习过程就是对所有的 G 个样本向量进行迭代学习,直到权值 W 的变化小于某一个确定的阈值或迭代达到一定的次数。测试过程比较简单,对于每一个样本向量,计算其获胜神经元,输出单元相同的样本向量属于同一类。虽然 KFM 有学习过程,但是可以看到这种学习是从所有的样本中自动获取特征,没有教师的参与,因此称为无监督的学习方法。

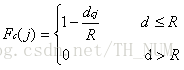

Kohonen 认为,神经网络中邻近的各个神经元通过侧向交互作用彼此相互竞争,自适应地发展成检测不同信号的特殊检测器。该思想来自于大脑神经元的特性,即大脑皮层的神经元成二维空间排列,不同区域分工不同,各自对输入模式的不同特征敏感,神经元之间存在信息交互,主要是侧向交互,即某个经元对周围神经元之间存在由近到远的不同的影响作用,而不是简单的侧抑制作用。对邻近神经元的交互作用函数有巴拿马草帽型 (公式 8-22 ) 或矩形型 (公式 8-23 ) 。

其中 dcj 是输出单元 c 与邻近单元 j 之间在神经元平面上的距离, R 是交互作用半径。

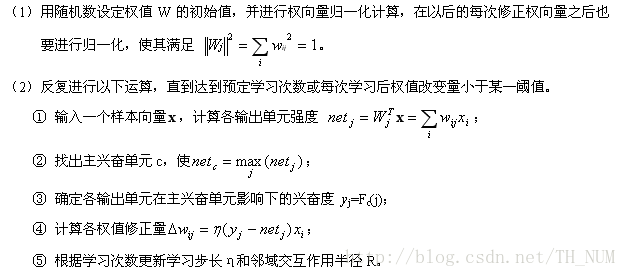

KFM 的学习过程如下:

学习过程可以采用从全局到局部的策略。采取这种策略时,学习初期可设定较大的交互作用半径 R ,随着学习过程的不断推进,逐步减小 R ,直至不考虑对邻近单元的影响。邻域的形状可以是正方形或者圆形。

KFM 的聚类结果与 K 均值相似,它的优点是自动提取样本数据中的信息,同时也是一种全局的决策方法,能避免陷入局部最小,缺点在于必须实现人为设定类的数目与学习参数,而且学习时间较长。 KFM 方法克服了 K- 均值聚类的一些缺点:它应用类间的全局关系,能提供大数据集内相似性关系的综合看法,便于研究数据变量值的分布及发现类结构。而且,它具有更稳健更准确的特点,对噪声稳定,一般不依赖于数据分布的形状。

这篇关于Self Organizing Maps 自映射人工神经网络的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!