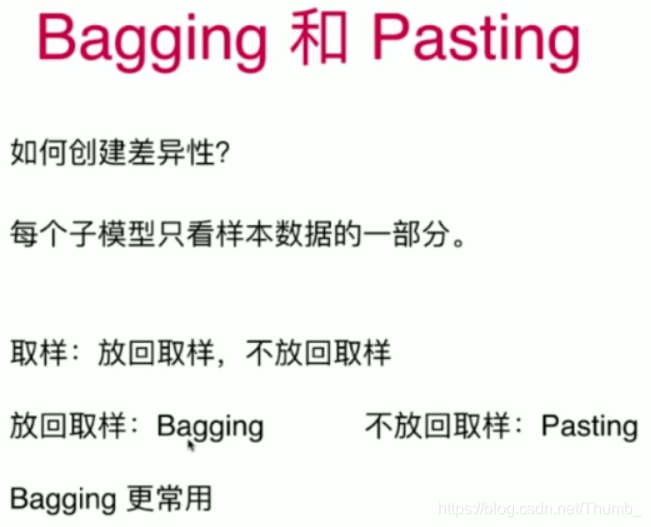

本文主要是介绍Bagging和Pasting,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

同样实验前加载和上一节相同的数据集

同样实验前加载和上一节相同的数据集

#%% 使用Baggingfrom sklearn.tree import DecisionTreeClassifier

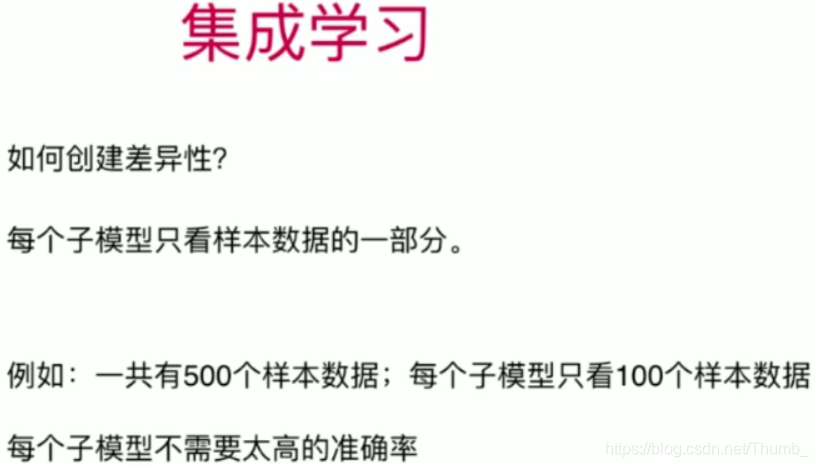

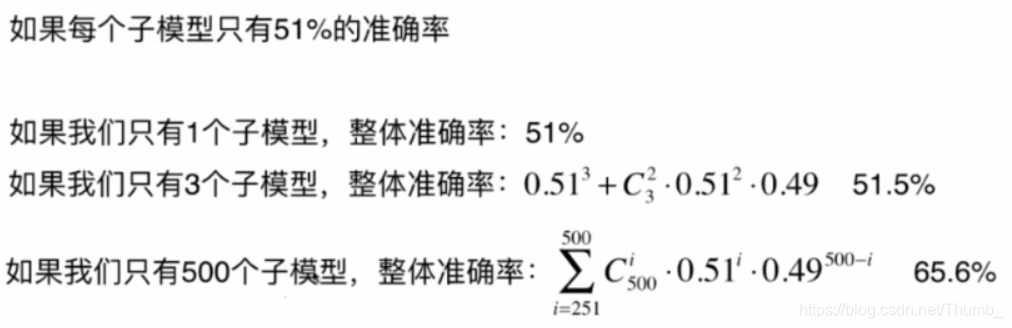

from sklearn.ensemble import BaggingClassifierbagging_clf = BaggingClassifier(DecisionTreeClassifier(), #使用决策树模型n_estimators=500,max_samples=100, # 集成500个决策树这样的子模型,每个子模型要看100个样本数bootstrap=True) # 选择 True ,放回取样bagging_clf.fit(X_train,y_train)

bagging_clf.score(X_test,y_test)结果:0.872

修改参数

bagging_clf2 = BaggingClassifier(DecisionTreeClassifier(),n_estimators=5000,max_samples=100, # 集成500个决策树这样的子模型,每个子模型要看100个样本数bootstrap=True) # 选择 True ,放回取样bagging_clf2.fit(X_train,y_train)

bagging_clf2.score(X_test,y_test)结果:0.872

这篇关于Bagging和Pasting的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!