本文主要是介绍“大数据杀熟”中的结构化与非结构化,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

“大数据杀熟”这件事不管是从人的劣根性角度,还是从平台的商业逻辑角度都存在着不可避免的必然性,只是各家有各家的说法而已。但作为必然是消费者的每个人来讲反抗是必须的,而且要经常给予相关平台进行必要的鞭策和警示。

本篇文章我们就两个点来讨论分析一下“大数据杀熟”中的结构化与非结构化。

-

两篇关于“大数据杀熟”的基本事件概要及讨论

-

“大数据杀熟”事件引发的思考

一.两篇关于“大数据杀熟”的基本事件概要及讨论

-

《复旦大学孙教授花费近5万打车800次,石锤大数据杀熟》的文章以及相关的报道。

“复旦大学教授孙金云的一项调研成了网上热议的话题:最近,他带领团队做了一项“手机打车软件打车”的调研。该团队在国内5个城市,花50000元,收集了常规场景下的800多份样本,得出一份打车报告。报告显示:苹果机主更容易被专车、优享这类更贵车型接单;如果不是苹果手机,则手机越贵,越容易被更贵车型接单——这样的报告,让人们对大数据用户画像、大数据杀熟产生的消费陷阱意难平。”

2.《戴头盔买房少花30万,“人脸识别”用在这里“扎心”了》

这个部分我们要先引入两个信息点:结构化数据和非结构化数据。

计算机信息化系统中的数据分为结构化数据和非结构化数据。非结构化数据其格式非常多样,标准也是多样性的,而且在技术上非结构化信息比结构化信息更难标准化和理解。我们在日常生活中使用电子产品进行浏览网页、视频等内容或者利用电子支付进行购买东西等在计算机系统里面所留存的都是结构化数据。而在日常生活中非主动与电子设备交互的而留存在计算机系统里面的,如监控拍下的视频影像数据、交通抓拍的图片数据、日常对话的语音数据都是非结构化数据。

有了上面的两个基础概念我们就比较好理解了,首先我们可以把数字世界看做现实世界的一种数字化映射。在数字化世界中,我们经历过了几次演变,从互联网时期到移动互联网时期再到人工智能时期再到数字时期,更像是一种把现实世界的各个细节通过不同技术手段进行的分阶段分领域映射的完善。

目前基于深度学习的图片识别、语音识别等人工智能技术已经在特定场景上非常好的可以把非结构化数据转化成结构化数据并且进行应用和辅助决策,所以把这两个新闻放到一起来看就会发现:对我们的数据采集已经不仅仅停留在几年前的基于电子产品的用户主动交互所产生的结果话数据的层面了,已经对我们的行为数据可以进行实时采集分析了,而基于非主动交互的非结构化数据的应用会让我们的数据画像更完善让“大数据杀熟”无微不至并且更难以察觉和精准。

二.“大数据杀熟”事件引发的一些思考

“大数据杀熟”在实际场景中是非常难界定也非常难以避免的。但我们要如何进行避免、监管、对抗呢?从目前的看到文章中很多都在呼吁国家出台相关政策来进行监管,但是我认为这也非常难落实,很容易就变成一纸空文。所以想从上面介绍的两个事件出发从以下几个方面来进行讨论一下。

-

市场价格体系监管

基于上面两件事,涉及到最直接的内容就是不同的人付出不同的价格拿到了类似的产品或者服务,有失公平。所以要面对的第一个问题应该是市场价格体系面对动态价格体系的监管要进行优化。在目前的市场经济里面,市场监管局对农副产品、防疫物资、名优白酒、旅游业、交通运输、电商平台价格进行了较为严格的监管,严肃查处囤积居奇、哄抬价格、串通涨价等违法行为,坚决制止捏造散布涨价信息、哄抬价格等行为,维护防疫物资价格稳定;依法查处虚构原价、误导性价格标示、不履行价格承诺等各类不正当价格行为。而对于更为动态的针对个性化推进的产品或者服务的监管没有进一步要求,就难免让平台利用算法钻监管的空子。

但所有的公平都是相对的,如果所承担的价格是在合理的范围之内,那么是不是就不存在违规违法了呢?还是否需要监管呢?

-

对抗算法

(信息点参见于文章:《教你如何对抗算法,大数据时代的硬核生存指南》)

这里我们先要引入三个信息点:

-

生产算法

将使用者作为生产要素进行更合理的分配调度,提高生产效率,比如系统里的外面小哥、滴滴司机。

-

消费算法

让使用者尽可能的消费更多的东西,比如:内容、商品、信息等,最典型的就是抖音、淘宝等

-

信息茧房

就是不断接触同类信息的过程中自身被禁锢在一个由算法隔绝的茧房,进一步形成回声室效应和过滤气泡

-

对于大部分人的一生来说是生存在“信息茧房”里的,只是茧房形成的过程是相对较慢的,也是我们主动选择的过程。但是由于算法的介入极大加快了这一过程。当然算法被研发出来的本意是好的是未来更高效的处理日常的事物,提高生活效率。但是不管是生产算法还是消费算法在市场机制下都更加逐利的,我们在被动的情况下却加快了在算法系统中自我“信息茧房”的建立。最可怕的不是在某次打车上多花了几块钱这么简单了,最可怕的或许是基于算法的诱导式消费、引导式生活等等,最后变成被操控式的生活,你的喜好不是你的喜好,你的生活不是你的生活我认为这才是需要警醒的。这里我再推荐大家看一个视频《达伦·布朗:就范》或许就更能理解被操控的意思了。

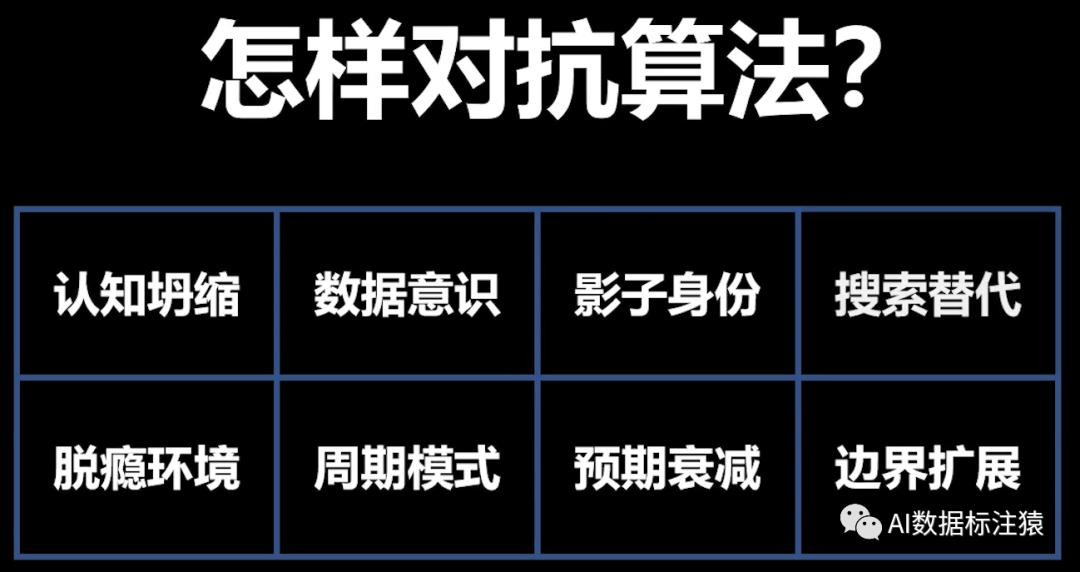

对于怎样对抗算法,大家可以看一上面提到的视频文章讲解的更为详细,这里截取一张图片作为参考:

-

数据财产化、资产化

在数字经济的大背景下,对于数据财产化、资产化的讨论这两年尤为热烈。数据作为生产要素要进行合理合法的流通才能更好的激活数字经济的发展。

结合文本讨论的问题,我们可以举例说明,有买过房的小伙们会深有体会,上午交的房款,下午可能就会有装修公司的人给你打电话而且在未来一段时间内你的电话会被打爆且不同的装修公司,直到装完房子的半年后这类电话才会消失。通过我们买房子这件事触发了一个有装修需求的标签生成。理论上这个数据应该是我们个人的信息资产,但是收益方却是他人且这显然是非常不合理的也不合法的。

是否可以有一个机构或者是数字银行可以让我们通过泛标注的方式来主动进行数据资产存入并进行可选择行流通呢?为数据要素流通从最小单元确权开始呢?

-

立法

立法是必然的,只是从落地的角度来看立法还没有非常好的实操抓手。也看到有相关文章提出了《平台经济领域反垄断指南》作为判断标准。但仅仅从指南的角度来看是还是解决不了针对个性化服务的动态价格波动合理性的问题。

对于合理性的问题是次要问题,核心矛盾点还是数据作为生产要素的确征、确权、定价以及数据安全的问题。

很多“大数据杀熟”的文章都在讨论各个互联网平台的“大数据杀熟”,但其实事实上已经不仅如此了,由于数据标注的助力,AI的发展应用,对于音频、图片、视频等非结构化数据的处理已经让我们的标签维度增加了非常多,基于这些数据就可以更好在营销场景上应用,而这些应用更隐蔽更不容易被察觉。

现实世界的孪生数字世界已经在云端开始疯狂建设,还处于相对没有监管的状态,是机遇也是挑战。普通人要考虑如何在这个孪生的数字世界里保全自己,企业们要考虑如何在孪生的数字世界还处于无序状态时抢占更多的地盘,政府更要考虑如何在孪生的数字世界发挥监管职能。

这篇关于“大数据杀熟”中的结构化与非结构化的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!