本文主要是介绍吴恩达机器学习笔记 二十七 决策树中连续值特征的选择 回归树,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

还是猫狗分类的案例,假如再增加一个特征weight,该值是一个连续的值,如何在决策树中使用该特征?

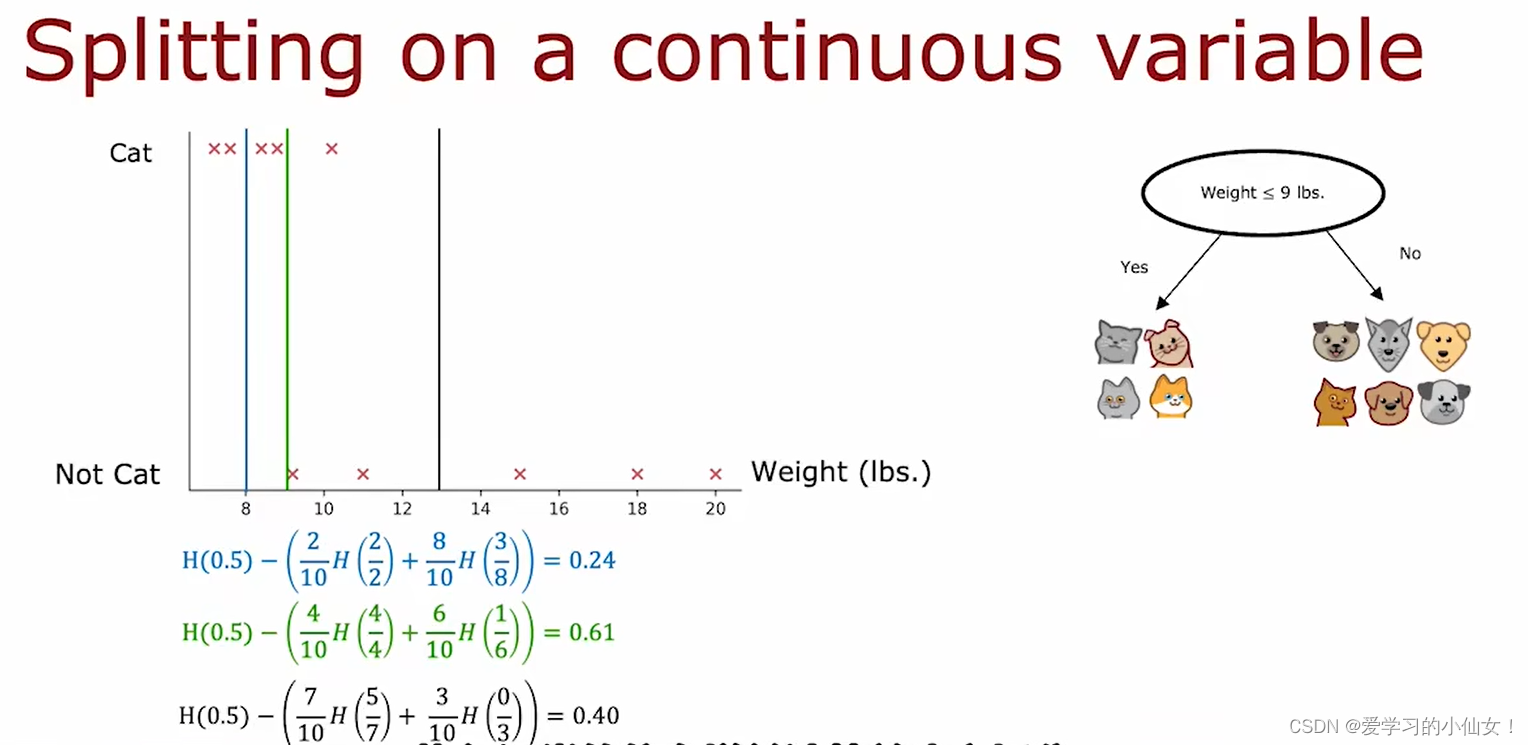

如下图所示,尝试不同的阈值,如 weight<=9 , 此时左边有四个样本,都为猫,右边有六个样本,其中一个为猫,计算信息增益(绿色的那个)。同理,把条件设为weight<=8,划分后左边有两个样本,全是猫,右边有八个样本,其中三个是猫,计算信息增益(蓝色的那个),可以发现边界设为9时信息增益最大,所以就按照这个标准分。

决策树用于分类问题-->推广到回归问题:回归树

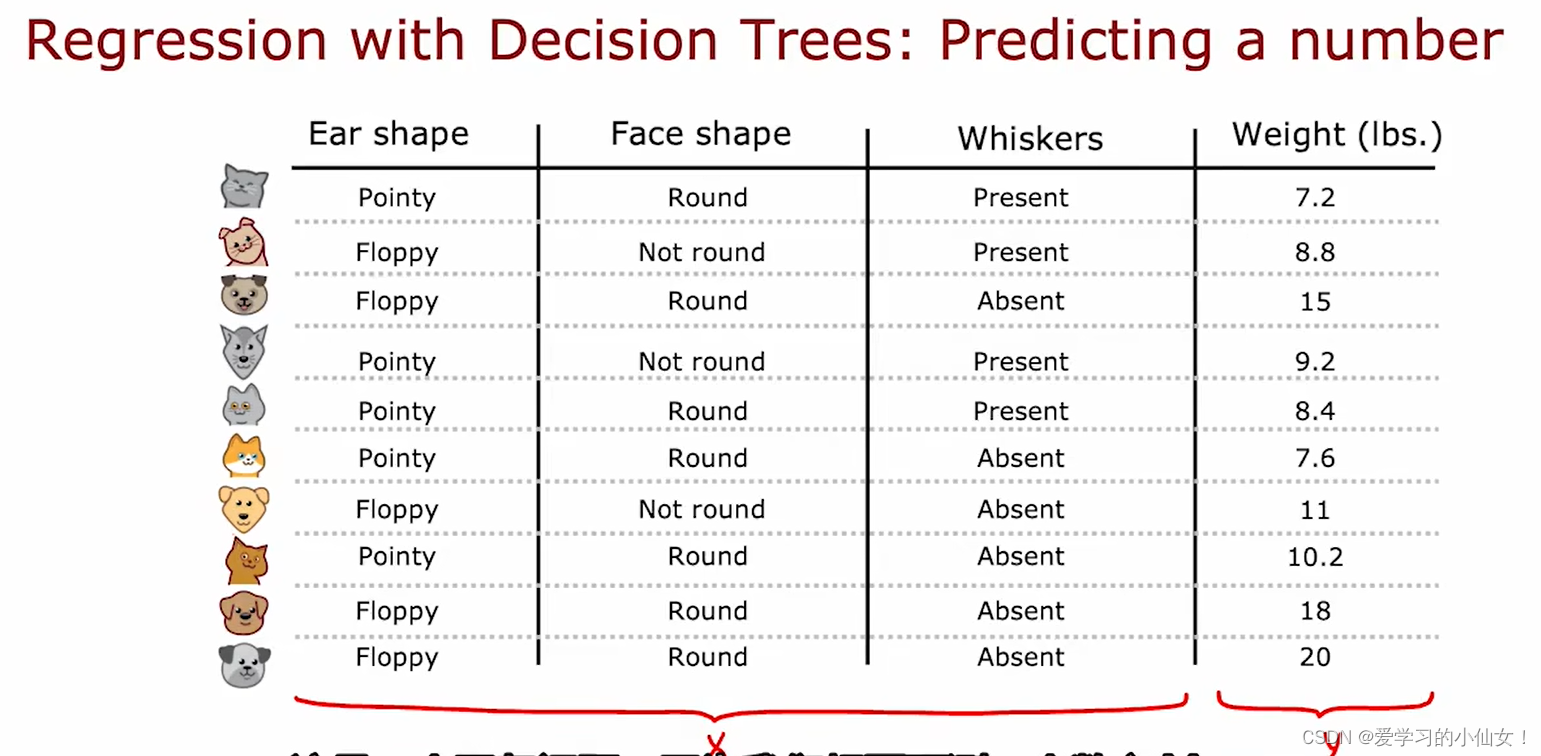

用决策树来预测一个数字而不是类别

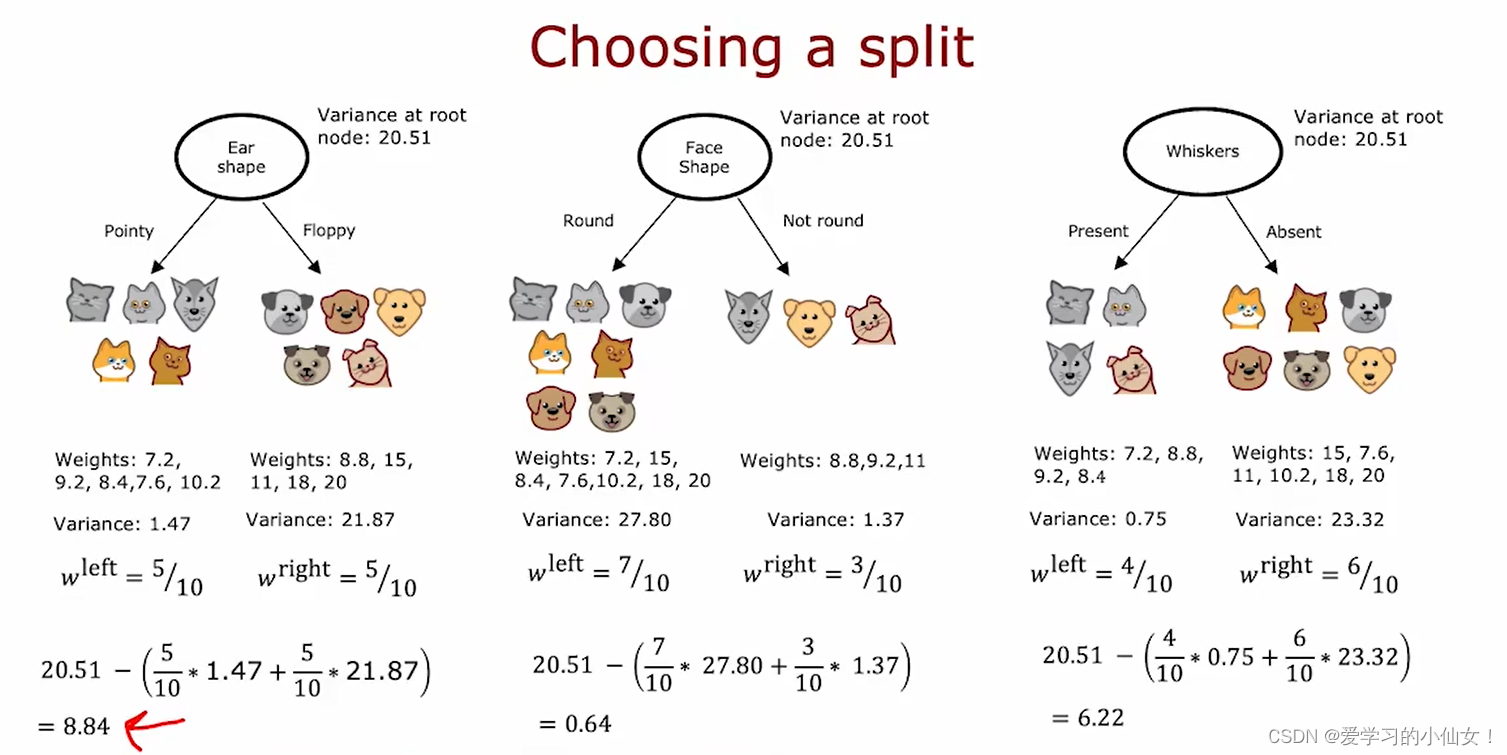

用于回归问题时,我们不追求减少熵,而是期望能够降低分类后每个子集 weight 的方差 。如下图,计算不同分类后的左右两支子树的带权重方差和,再用根节点的方差减去这个数,得到方差的减少量,方差减少的越多越好,所以选择 ear shape 作为分割特征。

这篇关于吴恩达机器学习笔记 二十七 决策树中连续值特征的选择 回归树的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!