本文主要是介绍Bidirectional A*,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

双向A*。

A* : A*(A star)

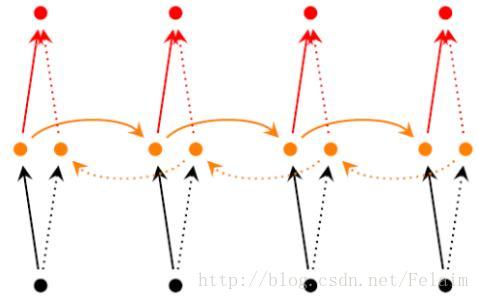

从起点和终点同时开始A*搜索,直至交汇。

从起点端:代价值Fs=起点到当前点的距离Gs+当前点到终点的启发式代价值Hs

从终点端:代价值Fe=终点到当前点的距离Ge+当前点到起点的启发式代价值He

最终整个路径的代价值=Gs+Ge

图示

特点

比A*更快

其他路径规划算法: 路径规划算法总览

这篇关于Bidirectional A*的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!