本文主要是介绍SRGAN简记,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

SRGAN简记

文章目录

- SRGAN简记

- 参考

- 模型结构

- LOSS定义

- Content Loss

- Adversarial loss

- 实验

- 它是第一个能够推断4×放大因子的照片真实自然图像的框架

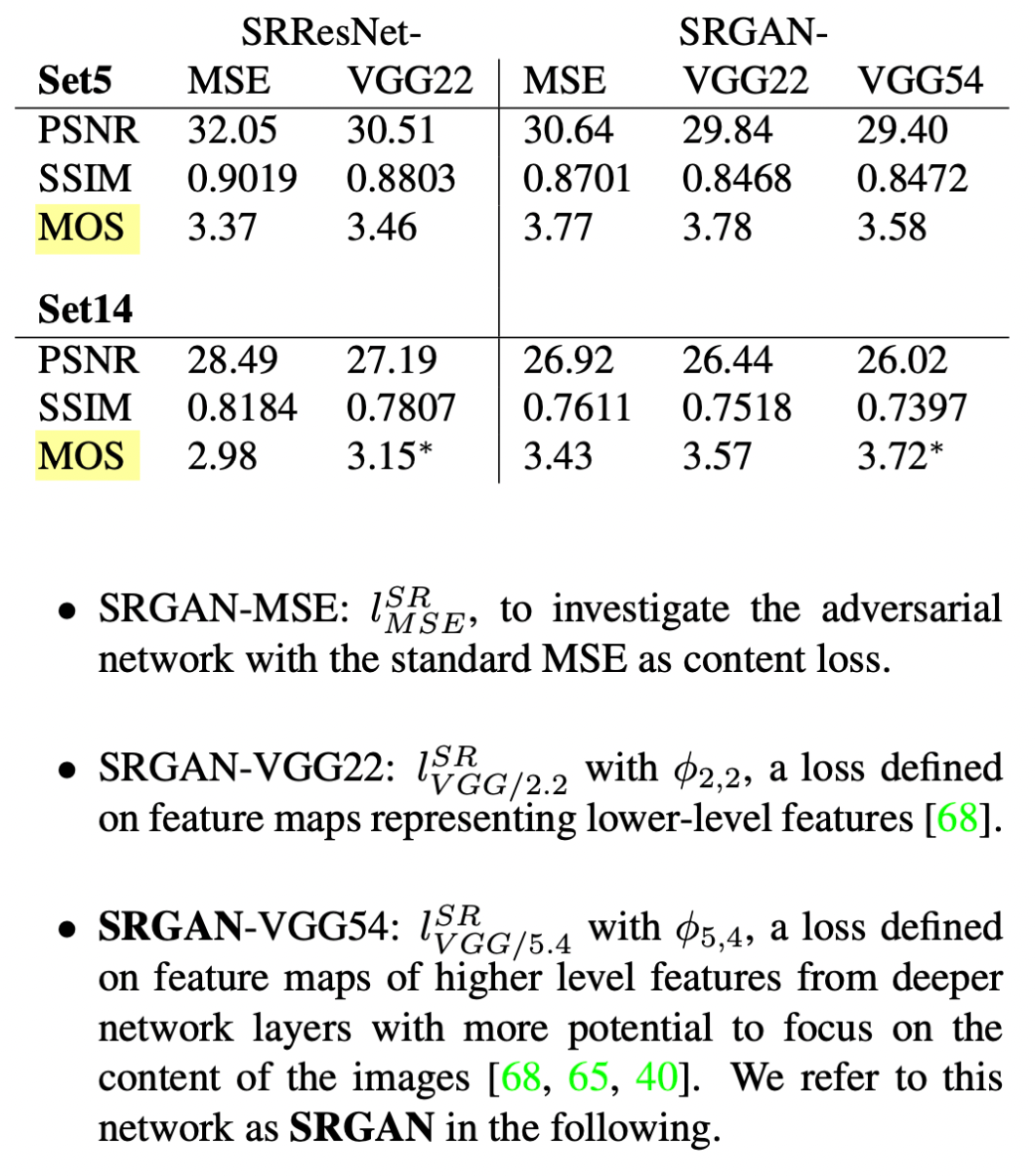

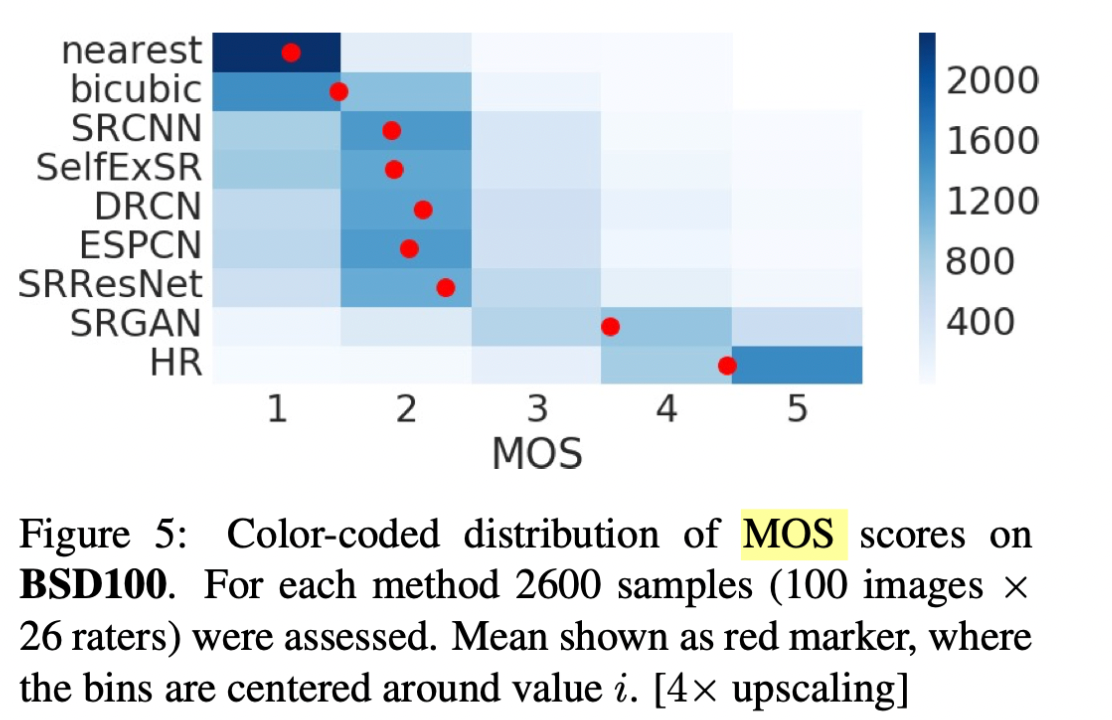

- 作者将GAN的思想用于SR任务,虽然PSNR还比不上此前提出的方式,但是在MOS这一评价维度上达到了state-of-the-art

- 作者的贡献是:

- 提出了SRResNet(SRCNN的增强版)

- 提出了SRGAN(主要内容,引入GAN来做超分)

- 引入MOS评价指标,并说明PSNR的一些问题(图像过于平滑,缺少高频细节信息,所谓高频即在频域中频率较高的部分,通常认为这部分用于保存图像细节信息)

参考

- pytorch代码

- 原文

模型结构

- GAN分为Generator和Discriminator两个部分,其中Generator用于图像超分,Discriminator用于判定超分图和原图

LOSS定义

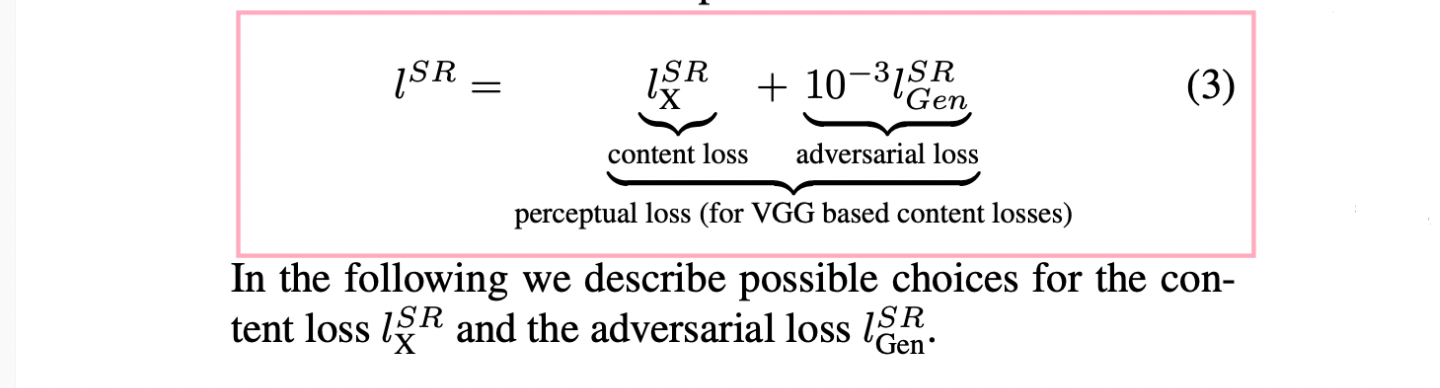

- 整体的LOSS分为两个部分,分别是Content Loss 和adversarial loss,

Content Loss

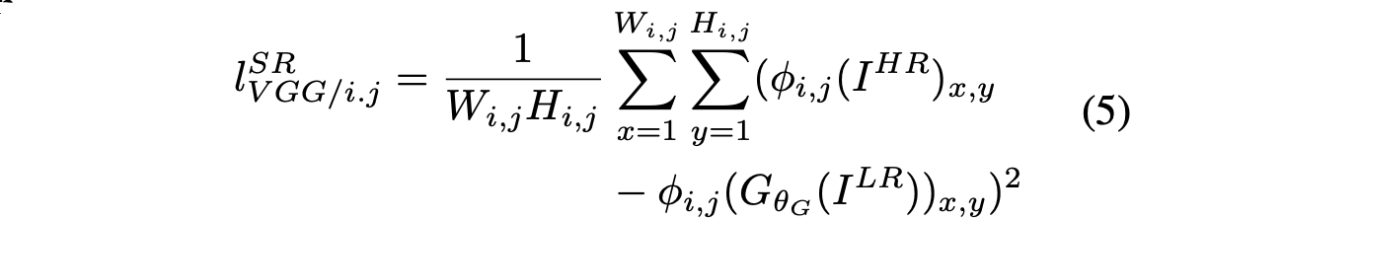

- 内容损失loss,此前用的一般是MSE,这种LOSS拥有比较好的PSNR(峰值信噪比),但是通常来说回丢失高频信息,导致图像过于平滑(一般我们认为图像中的细节信息大部分存在高频部分),因此作者由欧几里得距离提出了 I X S R I_{X}^{SR} IXSR,如下所示

- 其中X替代为VGG(意思是Backbone用的VGG,可替换), ϕ i , j 表 示 第 i t h 个 m a x p o o l 之 前 的 第 j t h 个 c o n v l o t i o n \phi_{i,j}表示第i_{th}个maxpool之前的第j_{th}个conv lotion ϕi,j表示第ith个maxpool之前的第jth个convlotion,然后H和W表示feature map的空间维度。

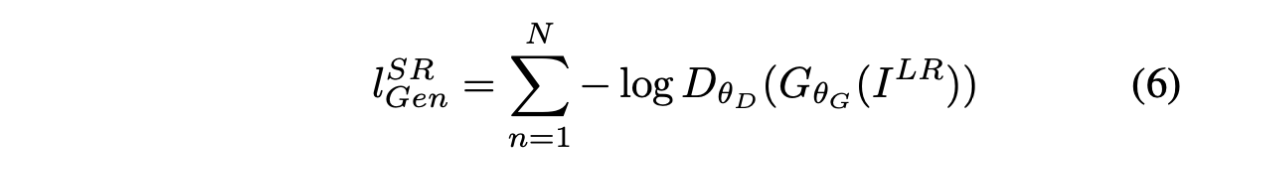

Adversarial loss

- 为对抗loss,是生成器和检测器之间的loss,类似交叉熵但好像并不是,这里由于我们希望生成器的结果被检测器误认为是nature的图片,所以希望最小化检测器认为是生成器生成的概率(也就是使得D的结果趋向于1)

实验

-

有关于MOS的结果,SR GAN在Set5和Set14数据集上的MOS分数均比SRResNet(可以看作SR CNN的增强版)高不少

-

-

MOS评级分布,可以看到SRResNet高于此前的方法,而SRGAN又超过了SRResnet。

-

这篇关于SRGAN简记的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!