本文主要是介绍Image Super-Resolution via Deep Recursive Residual Network(DRRN)论文阅读笔记,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

目的

尽管其他深度网络再进行SR时取得了优异的性能,但深度网络需要大量的参数。与紧凑模型相比,大型模型需要更多的存储空间,对移动系统的适用性较差,作者创造DRRN取得更好的性能,并且比VDSR,DRCN,RED30等网络所需要的参数更加少。

DRRN在算法上的创新

-

在DRRN中引入了global learning和residual learning

在视觉识别和图像恢复等领域中,如果使用深度网络可能会出现性能下降等问题,原因是在经过多层网络之后,图片的很多细节信息丢失了,为了解决这一问题,作者引入了一种增强的残差单元结构,成为多路径模式局部残差学习(LRL),其中的identity branch将丰富的图像细节信息传递到了网络中更深的层中,GRL和LRL的主要区别在于LRL是在每几个堆叠的层中执行,而GRL是在输入和输出图像之间执行,即DRRN有许多LRLs,但只有一个GRL

-

为了保持模型的紧凑性,在DRRN中提出了残差单元的递归学习。

与DRCN相比,我们的DRRN有两个主要区别:(a)与在卷积层之间共享权重的DRCN不同,DRRN有一个由几个残差单元组成的递归块,这些残差单元共享权重集。为了解决极深模型的消失/爆炸梯度问题,DRCN监督每一个递归,以便对早期递归的监督有助于反向传播。DRRN通过设计一个具有多路径结构的递归块来减轻这种负担。

相关工作

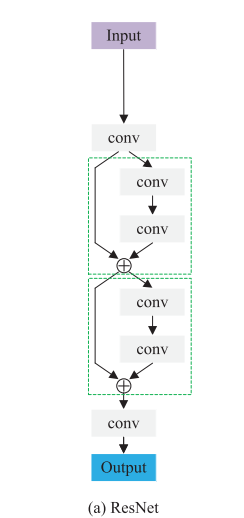

ResNet

ResNet中的残差学习框架简化了深度网络的训练,残差单元公式化为

x ^ = U ( x ) = σ ( F ( x , W ) + h ( x ) ) \hat{\mathbf{x}}=\mathcal{U}(\mathbf{x})=\sigma(\mathcal{F}(\mathbf{x}, W)+h(\mathbf{x})) x^=U(x)=σ(F(x,W)+h(x))

h(x)为恒等映射(identity mapping),F为残差函数,残差网络的核心就是去学习增加的残差函数F,这样的设计让网络更加容易训练并且不会产生过拟合

VDSR

VDSR中在输入的低分辨率图片和输出的高分辨图片之间引入了GRL,VDSR主要有三个特点

-

VDSR在残差分支中使用了20个权重层,这能让网络的reception field增大

-

GRL(Global Residual Learning)能让VDSR快速收敛

-

通过尺度扩展,单个VDSR网络对不同尺度的图像具有较强的鲁棒性

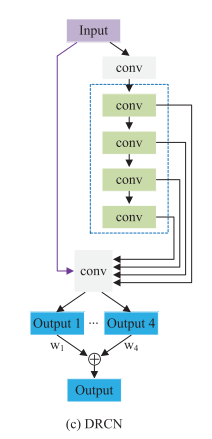

DRCN

添加更多的权层会引入更多的参数,其中模型可能会过拟合,并且可能会导致模型更大难以存储和复现,为了解决这些问题,作者在网络中引入了一个递归层,每层的递归层都是监督式的,包含三个部分,如下图所示

- 第一部分为embedding net,对输入中的特征进行提取,

- 第二层为为inference net,相当于特征的非线性变换, 将T个递归堆叠在一个递归层中,在这些递归之间共享权重

- 第三层为reconstruction net,即特征图重建

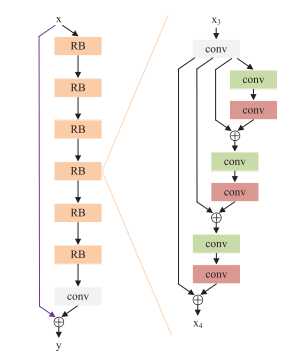

DRRN

作者在DRRN中将GRL和递归网络结合在一起使用,将多个残差单元堆积在一起,如下两幅图所示,在ResNet中,不同的残差单元对identity branch使用不同的输入,但是在DRRN中,使用了多路径结构,所有残差单元共享相同的identity branch的输入,

)

)

DRRN中的残差单元

在DRRN的残差单元将激活层放到了权重层的前面,通过别人的论文可知,这样的设计让网络更加容易训练

而每个残差单元之间的残差路径有助于学习高度复杂的有限元结构,同一路径有助于训练过程中的梯度反向传播,与ResNet中的链模式相比,这种模式更有利于学习,不容易过拟合,具体公式如下, 由于残差单元被递归学习,权重w在一个递归区中共享,但是在不同的递归区内不同

H u = G ( H u − 1 ) = F ( H u − 1 , W ) + H 0 H^{u}=\mathcal{G}\left(H^{u-1}\right)=\mathcal{F}\left(H^{u-1}, W\right)+H^{0} Hu=G(Hu−1)=F(Hu−1,W)+H0

DRRN中的残差块及网络结构

DRRN的网络结构如下图所示,通过叠加几个递归块,然后用卷积层重建LR和HR图像之间的残差。然后将剩余图像从输入LR image添加到全局标识映射中。整个DRRN网络结构如下图所示。实际上,VDSR[13]可以看作是DRRN的一个特例。,当残差单元为0时,DRRN变为VDSR

DRRN网络中递归块的个数和残差单元数最终影响网络的性能

这篇关于Image Super-Resolution via Deep Recursive Residual Network(DRRN)论文阅读笔记的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!