本文主要是介绍基于NSFW数据集的违规图片检测系统,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

目录

一、功能介绍

二、安装部署说明

2.1数据集简介

2.2文件目录说明

一、功能介绍

本程序是一个违规图片检测系统,能够识别用户上传的信息图片,是否包含有敏感(NSFW,Not Safe For Work)信息。

本程序使用雅虎开源的NSFW数据集(NSFW数据集),利用机器学习算法进行模型训练,将训练好的模型保存在本地,以供程序下一步调用。使用django开发网页端程序,调用上一个步骤中训练好的模型,能够检测用户上传的图片是否违规,并记录和管理用户的图片识别记录。

二、安装部署说明

2.1数据集简介

程序使用的数据集是雅虎开源的NFSW数据集,数据及更多的介绍信息,可以查看下方文章:一网打尽小黄图!手把手教你造AI鉴黄神器

2.2文件目录说明

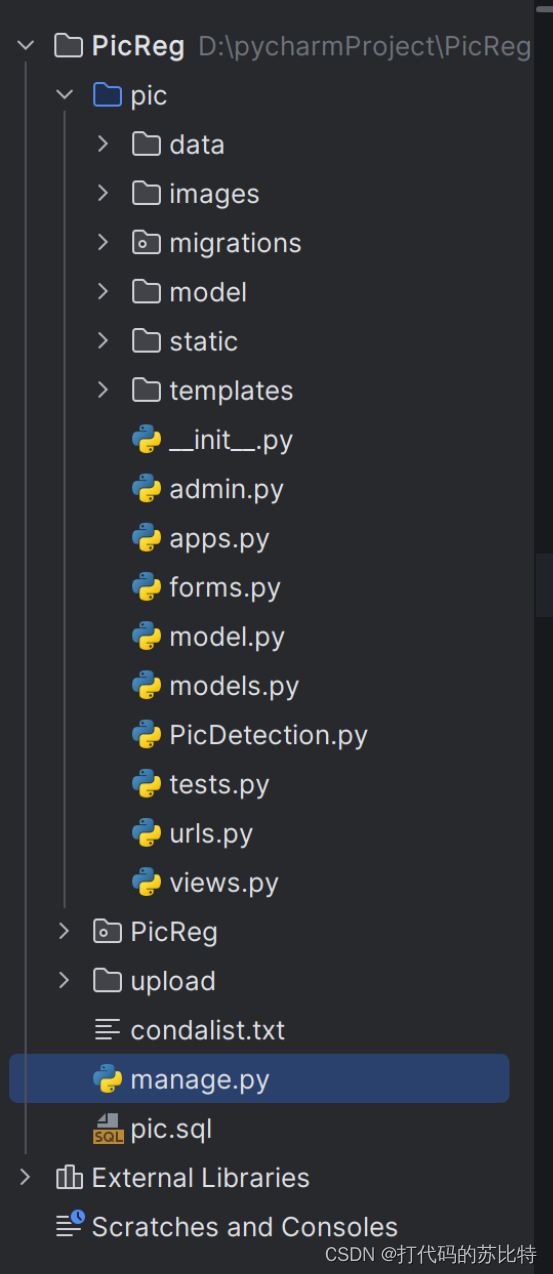

下图展示的是工程目录。

pic:图片识别程序文件夹

data:保存离线模型

image:模型训练结果

migrations:django生成目录

model:模型临时文件

static:前端静态资源

tepmlates:前端页面代码

admin.py:django生成目录

apps.py:django生成目录,服务注册

forms.py:django生成目录,表单注册

model.py:模型训练文件

models.py:django生成目录,数据库表

PicDetection.py:调用训练好的模型,检测图片是否含有违规信息

tests.py:django生成目录,存放测速案例

urls.py:django生成目录,url设置

views.py:django生成目录,页面路由设置

PicReg:django生成目录

upload:用户上传图片的保存目录

condalist.txt:环境信息

manage.py:django生成目录,项目启动文件

pic.sql:数据库初始化脚本

如需源码联系:1456719640

这篇关于基于NSFW数据集的违规图片检测系统的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!