本文主要是介绍GELU激活函数: 高斯误差线性单元,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

文章目录

- 引言

- GELU公式

- GELU实验

【Reference】

1. GAUSSIAN ERROR LINEAR UNITS (GELUS)

引言

早期网络使用二元阈值单元,sigmoid激活函数将二元阈值决策平滑,使得神经元可解释为发射率,并得以通过BP算法训练。随着网络深度增加,在训练神经网络时,sigmoid激活函数已被证实不如一些非平滑的非线性激活函数高效,如ReLU通常比sigmoid训练更快、收敛更快,ELUs允许ReLU输出负值,通常能够进一步加快训练速度。

深度非线性网络可以很好地拟合数据,因此设计者常向网络引入随机正则化,如隐藏层中添加噪声、应用dropout等,这些正则化操作与输入函数不同。某些随机正则化如dropout,使得网络能够近似于多个网络的集成(集成模型能够显著增加准确率)。正则化与非线性激活函数共同决定网络输出,正则化用于辅助非线性激活函数。

本文提出一种新的非线性激活函数Gaussian Error Linear Unit (GELU),它是自适应dropout修正的期望,与随机正则化有关。GELU使得神经元输出具有概率性。GELU在多数CV、NLP、ASR等领域表现出比ReLU、ELUs更优异的性能。

GELU公式

我们结合dropout、zoneout和RELUs的一些性质构造激活函数,对于同时使用RELUs和dropout的网络,RELUs将输入乘以1或0,而dropout将输入随机乘以0。新的RNN正则化器zoneout,随机将输入乘以1。我们通过随机向输入乘以1或0,合并这些性质,这些zero-one mask随机确定,但依赖于输入。

具体地说,我们使用 m ∼ Bernoulli ( Φ ( x ) ) m\sim \text{Bernoulli}(\Phi(x)) m∼Bernoulli(Φ(x))乘以神经元输入,其中 Φ ( x ) = P ( X ≤ x ) \Phi(x)=P(X\leq x) Φ(x)=P(X≤x), X ∼ N ( 0 , 1 ) X\sim \mathcal N(0, 1) X∼N(0,1)是标准正太分布的累计分布函数。选择这一分布的原因是因为输入特征多服从于正太分布,比如使用Batch Norm的网络。这一条件下,随着输入 x x x的降低,其被drop的概率逐渐增加,这种对输入 x x x的转换是随机的、且依赖于自身值。

这种非线性变换可看作随机正则化器对输入 x x x的期望:

x Φ ( x ) = Φ ( x ) × I x + ( 1 − Φ ( x ) ) × 0 x x\Phi(x)=\Phi(x)\times Ix + (1-\Phi(x))\times 0 x xΦ(x)=Φ(x)×Ix+(1−Φ(x))×0x

不严谨地说,该表达式表示根据 x x x比其他输入大多少对 x x x进行缩放。由于高斯累计分布函数常用于计算误差函数,因此我们定义GELUs为

GELU ( x ) = x P ( x ≤ X ) = x Φ ( x ) = x ⋅ 1 2 [ 1 + erf ( x / 2 ) ] \text{GELU}(x)=xP(x\leq X)=x\Phi(x)=x\cdot\frac{1}{2}\left[1+\text{erf}(x/\sqrt 2)\right] GELU(x)=xP(x≤X)=xΦ(x)=x⋅21[1+erf(x/2)]

公式推导

标准正太分布函数 Φ ( x ) \Phi(x) Φ(x)和右尾函数 Q ( x ) Q(x) Q(x):

Φ ( x ) = P ( X ≤ x ) = 1 2 π ∫ − ∞ x e − x 2 / 2 d x = 1 − Q ( x ) \Phi(x)=P(X\leq x)=\frac{1}{\sqrt{2\pi}}\int_{-\infin}^xe^{-x^2/2}\text dx=1-Q(x) Φ(x)=P(X≤x)=2π1∫−∞xe−x2/2dx=1−Q(x)

误差函数 erf ( x ) \text{erf}(x) erf(x):

erf ( x ) = 1 − 2 Q ( 2 x ) = 2 π ∫ 0 x e − x 2 d x \text{erf}(x)=1-2Q(\sqrt 2x)=\frac{2}{\sqrt\pi}\int_0^xe^{-x^2}\text dx erf(x)=1−2Q(2x)=π2∫0xe−x2dx

因此

Φ ( x ) = 1 2 [ 1 + erf ( x / 2 ) ] \Phi(x)=\frac{1}{2}\left[1+\text{erf}(x/\sqrt 2)\right] Φ(x)=21[1+erf(x/2)]

近似形式为

0.5 x ( 1 + tanh [ 2 / π ( x + 0.044715 x 3 ) ] ) o r x σ ( 1.702 x ) 0.5x(1+\tanh[\sqrt{2/\pi}(x+0.044715x^3)])\quad or \quad x\sigma(1.702x) 0.5x(1+tanh[2/π(x+0.044715x3)])orxσ(1.702x)

GELU实验

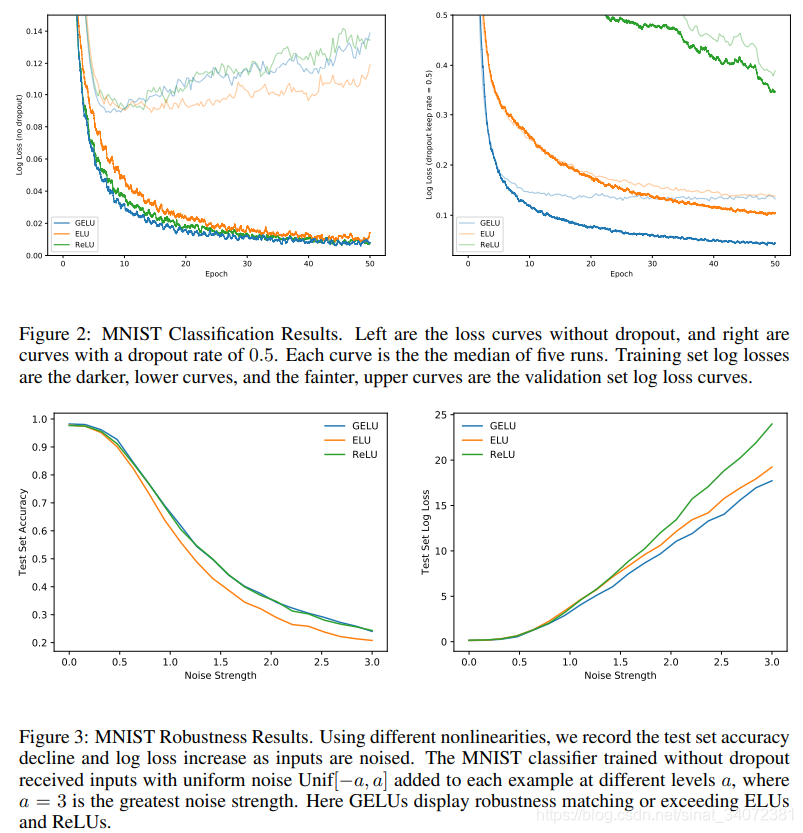

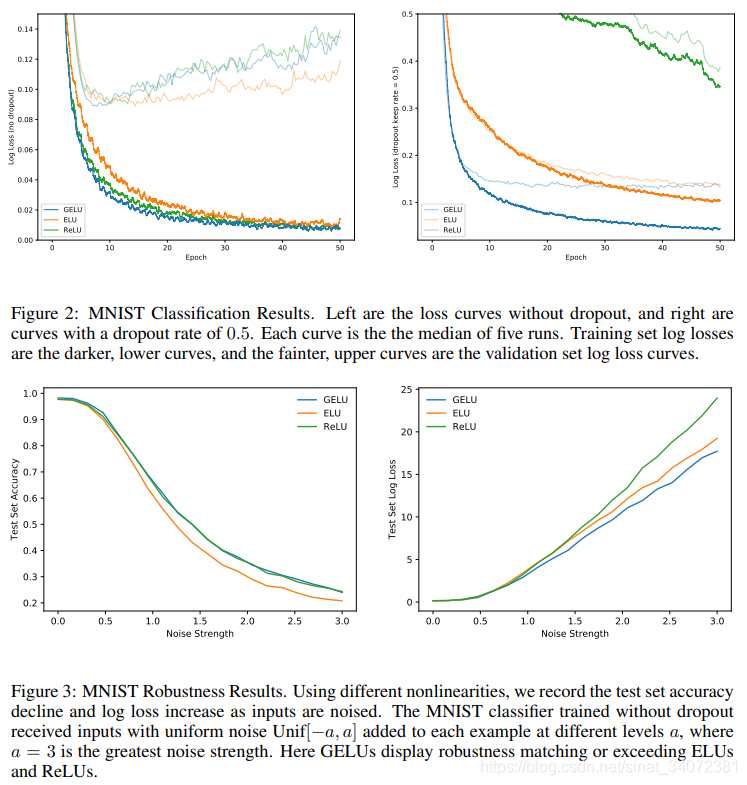

MNIST CLASSIFICATION

MNIST AUTOENCODER

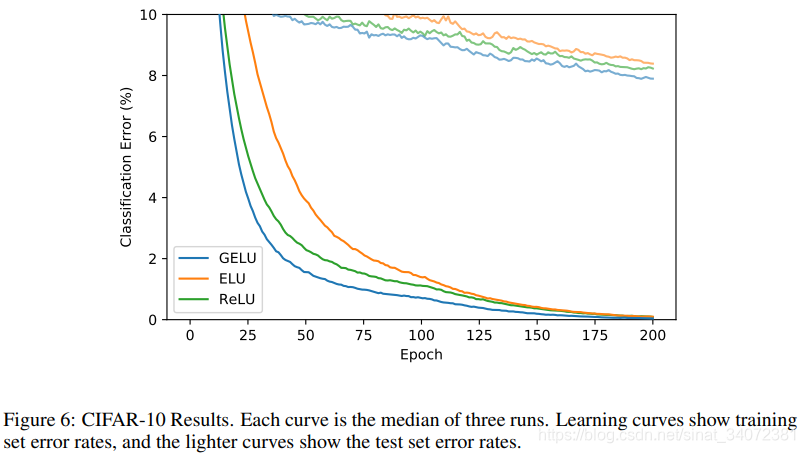

CIFAR-10/100 CLASSIFICATION

这篇关于GELU激活函数: 高斯误差线性单元的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!