本文主要是介绍掌握PyTorch数据预处理(一):让模型表现更上一层楼!!!,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

引言

在PyTorch中,数据预处理是模型训练过程中不可或缺的一环。通过精心优化数据,我们能够确保模型在训练时能够更高效地学习,从而在实际应用中达到更好的性能。今天,我们将深入探讨一些常用的PyTorch数据预处理技巧,帮助你充分发挥数据的潜力,为模型训练打下坚实的基础。

常用数据预处理方法

数据标准化

数据标准化的目的是将数据转换成均值为0,标准差为1的形式,这样可以使得数据分布更加均匀,减少数据的可变性。

在PyTorch中,可以使用torchvision.transforms.Normalize来进行数据标准化。Normalize函数需要传入两个参数,分别为mean和std。mean为数据集的均值,std为数据集的标准差。通过将数据减去mean,再除以std,就可以得到标准化的数据。

下面是一个使用torchvision.transforms.Normalize进行数据标准化的例子:

import torchvision.transforms as transforms

from PIL import Image

import numpy as np # 加载图像

image = Image.open("lena.png") # 将图像转换为numpy数组

image_array = np.array(image) # 定义预处理步骤

preprocess = transforms.Compose([ transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

]) # 对图像进行预处理

preprocessed_image = preprocess(image_array)

数据增强

数据增强是一种通过应用各种随机变换来生成新数据的技术,可以增加模型的泛化能力。对于图像数据,可以使用torchvision.transforms模块中的函数来随机旋转、裁剪、翻转图像等,从而增加模型的泛化能力。

下面是一个示例代码,用于对同目录下的lena.png图片进行数据增强:

import torchvision.transforms as transforms

import numpy as np

from PIL import Image

import matplotlib.pyplot as plt# 加载图像

image = Image.open("lena.png")# 定义数据增强变换

transform = transforms.Compose([transforms.RandomRotation(20), # 随机旋转20度# transforms.RandomCrop(32), # 随机裁剪出32x32的区域transforms.RandomHorizontalFlip(), # 随机水平翻转

])# 对图像进行数据增强

enhanced_image = transform(image)# 将PIL.Image对象转换为numpy数组

numpy_image = np.array(enhanced_image)# 显示图像

plt.imshow(numpy_image)

plt.axis("off")

plt.show()

运行结果:

To Tensor

transforms.ToTensor()可以将PIL Image或者ndarray转化为tensor,并且将Intensity的取值范围转化为[0.0, 1.0]之间 。

示例代码如下:

import torchvision.transforms as transforms

from PIL import Image

import numpy as np # 加载图像

image = Image.open("lena.png") # 将图像转换为numpy数组

image_array = np.array(image) # 这步没有也没问题# 定义预处理步骤

preprocess = transforms.Compose([ transforms.ToTensor()

]) # 对图像进行预处理

preprocessed_image = preprocess(image_array)

one-hot编码

在机器学习中,分类问题的标签通常是以整数的形式表示的。然而,为了使模型能够更好地处理这些标签,我们可以使用一种称为"one-hot编码"的技术将它们转换为二进制向量。在PyTorch中,可以使用torch.nn.functional.one_hot来实现这一操作。

在one-hot编码中,每个标签都被表示为一个唯一的二进制向量。假设我们有N个类别的标签,那么每个标签都会被转换为长度为N的二进制向量,其中只有该标签对应的索引位置上的值为1,其余位置上的值为0。

下面是一个示例代码,展示了如何在PyTorch中使用torch.nn.functional.one_hot来实现标签的one-hot编码:

import torch

import torch.nn.functional as F # 假设我们有5个类别的标签

num_classes = 5 # 创建一个标签的张量,其中包含了3个样本的标签

# 每个标签都是一个整数,取值范围从0到num_classes-1

labels = torch.tensor([1, 3, 2]) # 使用torch.nn.functional.one_hot将标签转换为one-hot编码的二进制向量

one_hot_labels = F.one_hot(labels, num_classes) # 输出one-hot编码的标签张量

print(one_hot_labels)

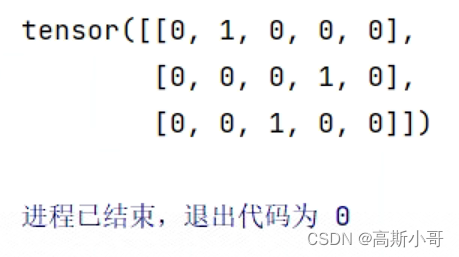

运行结果:

调整图像大小

在处理图像数据时,一个常见的需求是将所有图像调整为相同的大小,以便输入到神经网络中。这样做可以避免因为输入图像尺寸不同而带来的麻烦,同时提高神经网络的训练效率。在PyTorch中,可以使用torchvision.transforms.Resize轻松实现这一需求。

下面是一个示例代码,展示了如何使用torchvision.transforms.Resize将图像调整为相同的大小:

from torchvision import transforms

from PIL import Image# 加载图像

image1 = Image.open("lena.png")

print(image1.size)# 创建转换操作

transform = transforms.Resize((224, 224)) # 将所有图像调整为224x224的大小# 对图像进行转换

resized_image1 = transform(image1)

print(resized_image1.size)

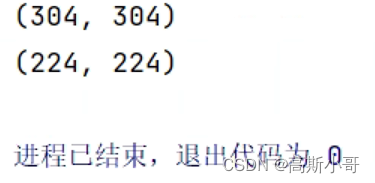

运行结果

结束语

如果本博文对你有所帮助/启发,可以点个赞/收藏支持一下,如果能够持续关注,小编感激不尽~

如果有相关需求/问题需要小编帮助,欢迎私信~

小编会坚持创作,持续优化博文质量,给读者带来更好de阅读体验~

这篇关于掌握PyTorch数据预处理(一):让模型表现更上一层楼!!!的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!