本文主要是介绍【论文笔记】NestedFormer: Nested Modality-Aware Transformer for Brain Tumor Segmentation,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

论文

标题:NestedFormer: Nested Modality-Aware Transformer for Brain Tumor Segmentation

收录:MICCAI 2022

paper:https://arxiv.org/abs/2208.14876

code:GitHub - 920232796/NestedFormer: NestedFormer: Nested Modality-Aware Transformer for Brain Tumor Segmentation (MICCAI 2022)

摘要

多模态磁共振成像通过提供丰富的互补信息,在临床实践中经常被用于诊断和研究脑肿瘤。以前的多模态MRI分割方法通常是在网络的早期/中期通过串联(cat)多模态MRI来执行模态融合,这很难探索模态之间的非线性依赖关系。论文提出一种新的嵌套的模态感知transformer(NestedFormer)来显式地探索用于脑肿瘤分割的多模态磁共振成像的模态内和模态间的关系。在基于transformer的多编码器和单解码器结构的基础上,对不同模态的高层表示进行嵌套的多模态融合,并且在较低的尺度上应用模态敏感门控(MSG)以实现更有效的跳层连接。具体地说,多模态融合是在提出的嵌套的模态感知特征聚集(NMaFA)模块中进行的,该模块通过一个三维的空间注意力transformer来增强单个模态的长距离相关性,并通过跨模态注意力transformer进一步补充模态之间的关键上下文信息。在BraTS2020基准和私有的脑膜瘤分割(MeniSeg)数据集上的广泛实验表明,NestedFormer明显优于最先进的分割。

动机

- 从多模态磁共振成像对中自动分割脑瘤结构有助于临床诊断和治疗规划。

- 现有多模态MRI分割方法难以探索不同模态间的非线性关系,通道融合方法没有建立通道内和通道间的长期空间依赖关系,没有针对多模态融合进行具体设计,不能充分利用不同通道间的互补信息。

贡献

- 提出一种新的嵌套式感知Transformer,(NestedFormer),用于有效和鲁棒的多模态脑瘤分割。首先设计一种有效的Global Poolformer,从不同图像中提取区分性的提及空间特征,并加强全局相关性。

- 为了更好地提取互补特征,并支持任意数量的模式进行融合,提出了一种新的嵌套模式感知特征聚合(NMaF A)模块。它明确考虑了单通道的空间一致性和跨通道的一致性,并利用嵌套的转换器来建立通道内和通道间的长期依赖关系,从而得到更有效的特征表示。

- 此外,设计了一种计算效率高的三向空间注意(TSA)范式来加速3D空间一致性计算。为了提高解码过程中的特征重用效果,提出了一种新的通道敏感门控(MSG)模块,用于动态过滤通道感知的低分辨率特征,以实现有效的跳跃连接。

方法

Framework

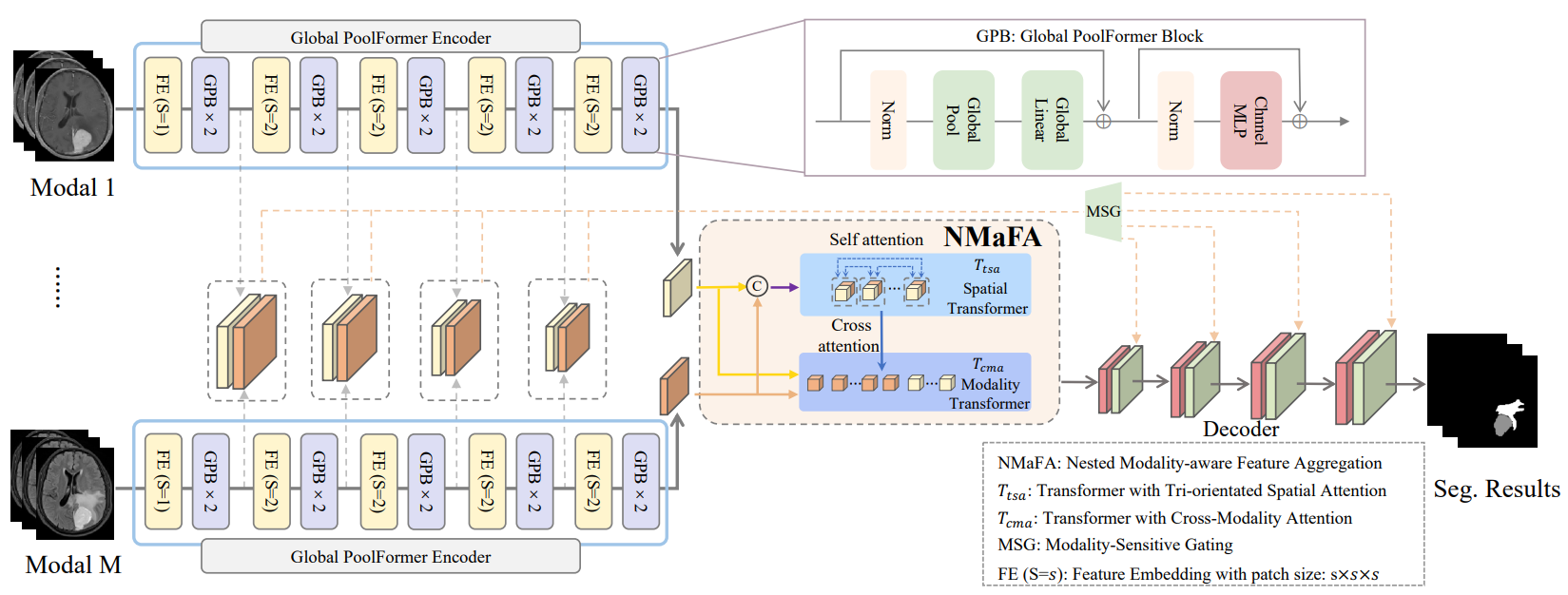

NestedFormer,包括三个组件:

- 多个编码器,以获得不同模式的多尺度表示;

- NMaFA融合模块,以探索多模式高层嵌入内和多模式高层嵌入之间的相关特征;

- 选通(门控)策略,以选择性地将对模式敏感的低分辨率特征传输到解码器。

Global Poolformer Encoder

Global Poolformer Encoder,每个包含五组,每组一个特征嵌入(FE)层和两个GPB块。 FE是一个三维卷积。编码器提取出多尺度特征。

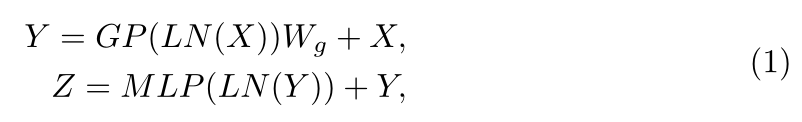

GPB(Global Poolformer Block):

扩展Poolformer,作为通道特定的编码器;

Poolformer 认为 用平均池化 替换 Transformer中的计算密集型注意模块,效果更好;

本文设计GPB模块,以增强全局信息,利用全局池化,替换Poolformer中的平均池化。

GPB的公式表达:

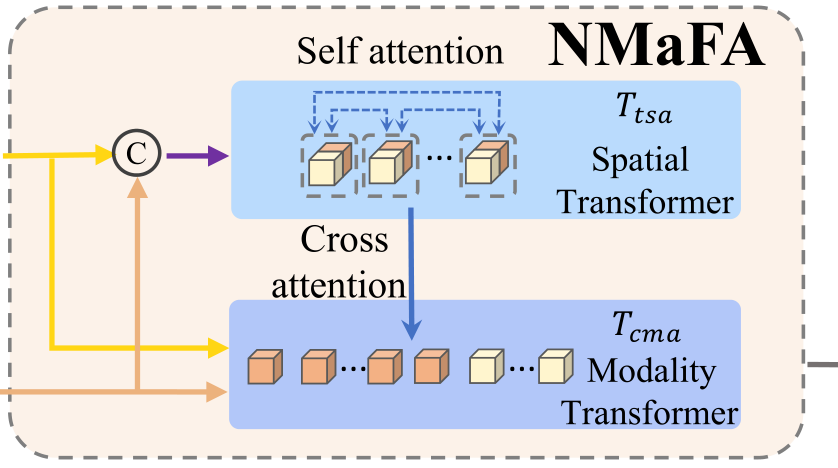

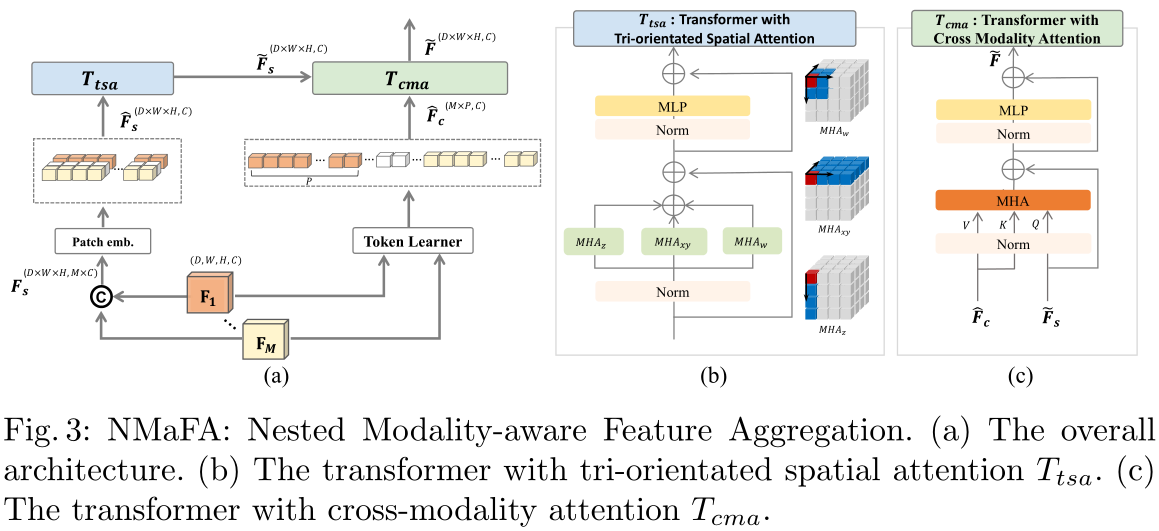

Nested Modality-Aware Feature Aggregation

给定高级特征F_1,…,F_M,NMaFA以嵌套的方式,利用基于空间注意力的转换器T_tsa 和 基于跨模态注意力的转换器T_cma。

- 首先,转换器T_tsa利用自注意力来计算每个模态内不同patch之间的长距离相关性。 将F_1,…,F_M,先通道cat拼接得到

,利用patch embedding layer 映射成 token sequence

。T_tsa以

和位置编码作为输入,输出空间增强的特征

。

- 其次,转换器T_cma 利用交叉注意力计算不同模态之间的全局关系,实现模态间融合。 将F_1,…,F_M,在空间维度中拼接,以获得flatten sequence

。其中,P(P=32)表示通过令牌学习器策略[23]学习的主导令牌的数量,有助于减小计算范围,特别是当令牌的数量随着更多的模态而大大增加时。然后,将

和

一起输入到T_cma中,得到模态增强特征

。

- 两个Transformer块,不同于以往的串联或者并联的通道、空间注意力,而是使用嵌套形式融合。

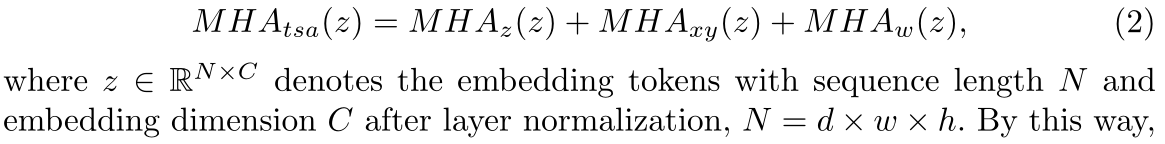

Transformer with Tri-orientated Spatial Attention

为了提高体积嵌入的空间注意的计算效率,受Axial Transformer和Swin Transformer的启发,论文利用轴向注意力MHA_z、平面注意力MHA_xy 和 窗口注意力MHA_w多头注意力方案。具体地说,MHA_z模拟垂直方向上特征标记之间的远程关系;MHA_xy模拟每个切片内的远程关系;MHA_w使用滑动窗口来模拟局部3D窗口之间的关系。轴和平面可学习绝对位置编码分别用于MHA_z和M HA_xy,并使用相对位置编码用于窗口注意MHA_w。

该模型不仅增强了局部重要区域的特征提取,而且计算全局特征依赖关系的计算量更小。

该模型不仅增强了局部重要区域的特征提取,而且计算全局特征依赖关系的计算量更小。

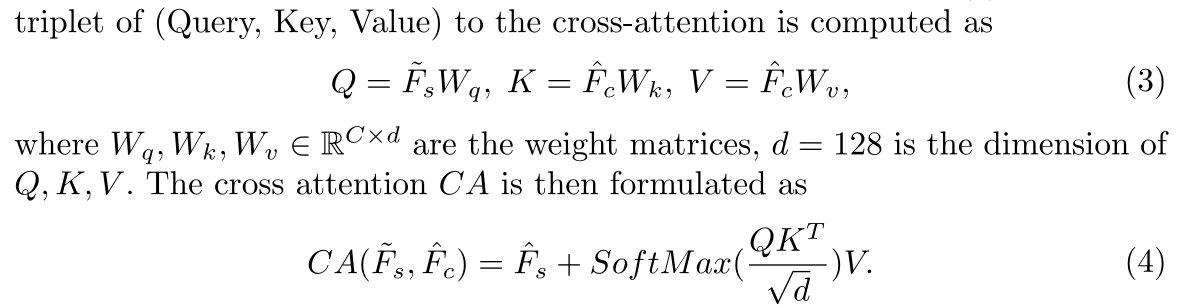

Transformer with Cross-Modality Attention

通过在通道维度中串联特征,T_tsa主要增强每个模态内的相关性并产生,尽管模态间的集成也通过补丁嵌入进行。为了明确地探索模态之间的关系,沿着空间维度连接不同模态的特征token,产生

;然后使用交叉注意转换器T_cma来将模态依赖信息增强到

中。交叉注意的输入三元组(查询、关键字、值)计算为

T_cma生成的令牌序列融合并增强了输入特征,增加了接收域和跨通道的全局相关性。

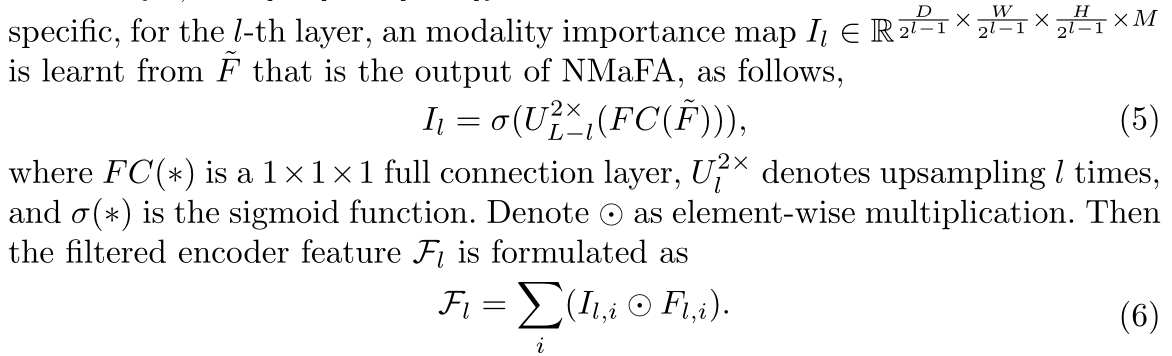

Modality-Sensitive Gating

在特征解码中,首先将token折叠回高级4D特征图

。R_L以规则的自下而上的方式逐步处理:通过3D卷积和2×上采样操作来恢复用于分割的全分辨率特征图

,其中N_c是分段的数量。请注意,编码器功能是多模态的。因此,在跳跃连接中设计了一种通道敏感门控策略,根据模态重要性过滤编码特征

。

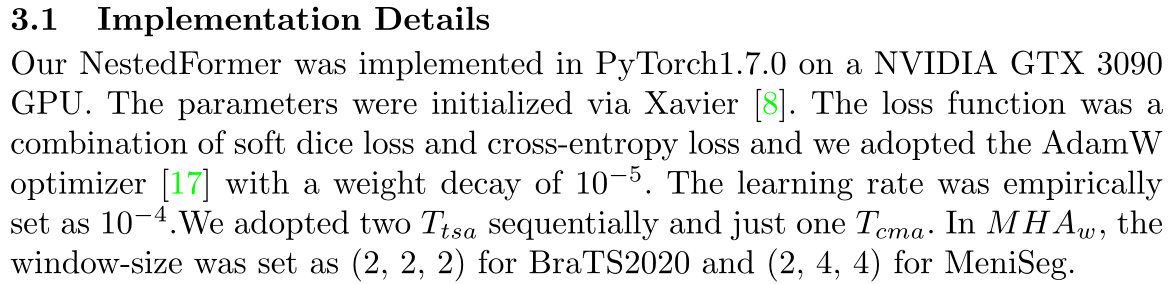

实验

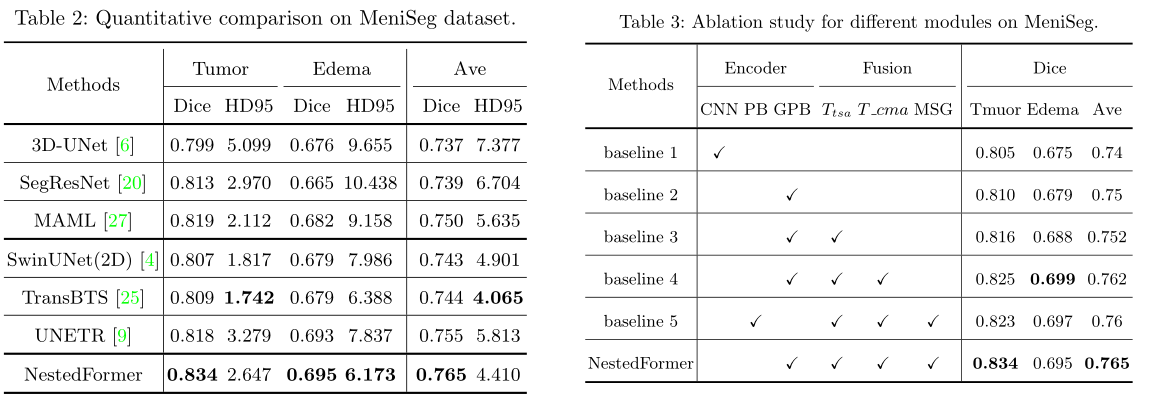

与sota比较:

消融实验:

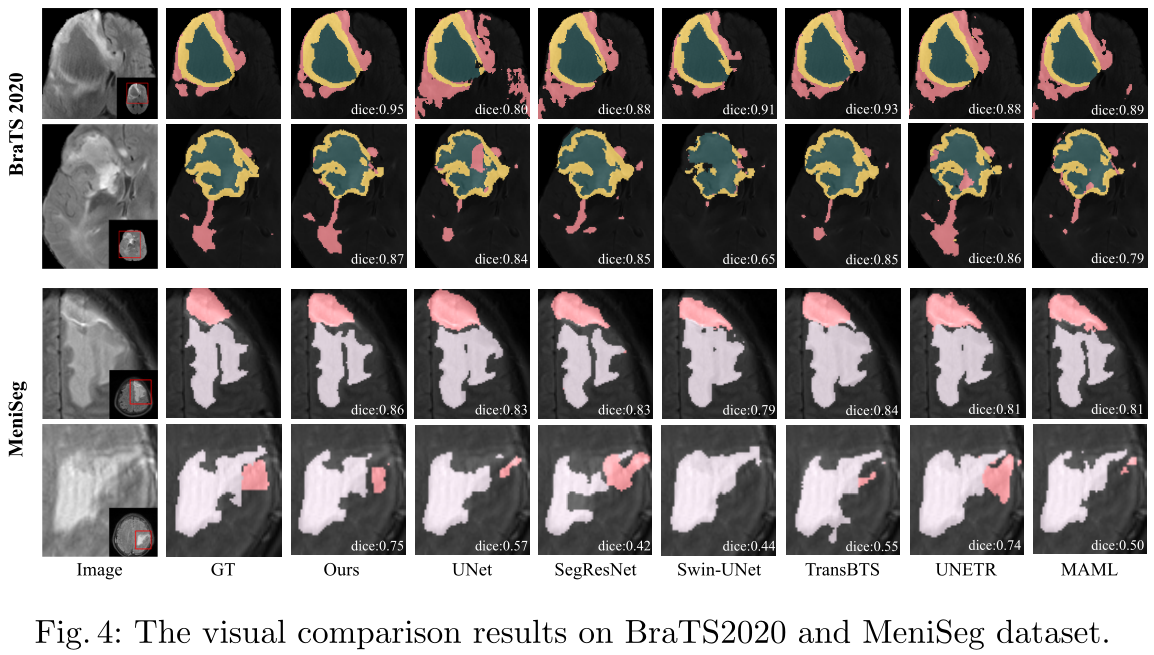

可视化:

这篇关于【论文笔记】NestedFormer: Nested Modality-Aware Transformer for Brain Tumor Segmentation的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!