本文主要是介绍Elasticsearch:数据摄取中的使用指南,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

数据摄取是利用 Elasticsearch 的全部潜力进行高效搜索和分析的关键步骤。 在本文中,我们将探讨几个常用的基本实践,以确保将无缝且有效的数据摄取到 Elasticsearch 中。 通过遵循这些指南,你可以优化数据摄取流程,并在你的部署中最大限度地发挥 Elasticsearch 的优势。

准备好你的数据

在将数据提取到 Elasticsearch 之前,正确构建和准备数据至关重要。 花点时间确保你的数据干净、格式正确并且针对搜索进行了优化。 此外,考虑任何必要的数据转换或扩充以增强其在 Elasticsearch 环境中的实用性。

批量 API 的效率

在处理大量数据时,强烈建议使用 Bulk API 进行高效的批处理。 这种方法允许你在单个请求中索引多个文档,从而减少与单个请求相关的开销并提高整体索引性能。

from elasticsearch import Elasticsearches = Elasticsearch()bulk_data = [{"index": {"_index": "my_index", "_id": 1}},{"field1": "value1", "field2": "value2"},{"index": {"_index": "my_index", "_id": 2}},{"field1": "value3", "field2": "value4"}

]es.bulk(index="my_index", body=bulk_data)优化批量大小

在使用批量 API 时,重要的是要考虑适当的批量大小以优化性能。 建议尝试不同的批量大小并密切监控摄取速度和系统资源以找到最佳平衡点。 请记住在提高效率和使系统过载之间取得平衡。

利用索引压缩

启用索引压缩可以显着减少 Elasticsearch 集群所需的磁盘空间。 通过压缩索引数据,你可以有效地存储更多信息并提高整体查询性能。 要启用压缩,你可以在 elasticsearch.yml 文件中配置 index.codec 设置。

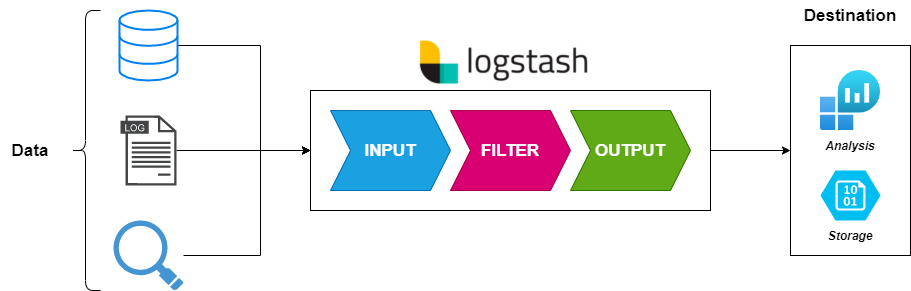

index.codec: best_compression利用 Logstash 进行数据转换

如果你的数据在摄取之前需要进行复杂的转换,那么利用 Logstash 作为中介可能会有所帮助。 Logstash 为数据转换提供了一个强大的管道,使您能够在将数据发送到 Elasticsearch 之前解析、丰富和过滤数据。 根据你的特定数据转换要求配置 Logstash 管道。

input {file {path => "/path/to/input.log"start_position => "beginning"}

}filter {# Apply necessary transformations here

}output {elasticsearch {hosts => ["localhost:9200"]index => "my_index"}

}更多关于如何使用 Logstash,请详细阅读文章 “Logstash:Logstash 入门教程 (一)”。

监控和管理摄取性能

定期监控 Elasticsearch 集群的摄取性能对于识别任何瓶颈或问题至关重要。 利用 Elasticsearch 监控 API、Kibana 等工具或第三方监控解决方案来跟踪索引率、延迟和资源利用率。 根据观察到的指标,对你的数据摄取过程进行必要的调整。

有关监控方面的信息,请详细阅读 “Elastic:开发者上手指南”。

总结

通过遵循 Elasticsearch 中数据摄取的这些最佳实践,你可以确保高效可靠的数据摄取过程。 正确准备和构建数据、利用具有最佳批量大小的批量摄取、启用压缩、利用 Logstash 进行数据转换以及监控摄取性能是实现稳健且可扩展的 Elasticsearch 部署的关键步骤。

这篇关于Elasticsearch:数据摄取中的使用指南的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!