本文主要是介绍Joint Noise-Tolerant Learning and Meta Camera Shift Adaptation for Unsupervised Person Re-ID,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

方法概述

联合噪声容忍学习和元相机转换适应。

1,我们提出了一种动态对称损失(dynamic and symmetric loss(DSCE)),增强了模型对与噪音伪标签的鲁棒性,进而提高模型性能。

2, 我们提出了一种camera-aware的元学习算法(MetaCam)用来适应相机的转换,该算法可以提高模型应对相机变化的鲁棒性

3,文章引入了一个关于DSCE和MetaCam的统一框架,综合提高了模型的鲁棒性。

文章目录

- 方法概述

- 内容概要

- 工作概述

- 成果概述

- 方法详解

- 方法框架

- 算法描述

- 具体实现

- 实验结果

- 总体评价

- 引用格式

内容概要

| 论文名称 | 简称 | 会议/期刊 | 出版年份 | baseline | backbone | 数据集 |

|---|---|---|---|---|---|---|

| Joint Noise-Tolerant Learning and Meta Camera Shift Adaptation for Unsupervised Person Re-Identification. | MetaCam | CVPR | 2021 | - | ResNet-50 [12] | DukeMTMC-ReID, Mar- ket1501, and MSMT17 |

在线链接: https://openaccess.thecvf.com/content/CVPR2021/html/Yang_Joint_Noise-Tolerant_Learning_and_Meta_Camera_Shift_Adaptation_for_Unsupervised_CVPR_2021_paper.html

源码链接: https://github.com/FlyingRoastDuck/MetaCam_DSCE

工作概述

1,we propose a Dynamic and Symmetric Cross-Entropy loss (DSCE) to deal with noisy samples and a camera-aware meta-learning algo- rithm (MetaCam) to adapt camera shift.

2,DSCE can allevi- ate the negative effects ofnoisy samples and accommodate the change ofclusters after each clustering step.

3,MetaCam simulates cross-camera constraint by splitting the training data into meta-train and meta-test based on camera IDs.

成果概述

Extensive experiments on three re-ID benchmarks show the effectiveness and the complementary ofthe proposed DSCE and MetaCam. Our method outperforms the state-of-the-art methods on both fully unsupervised re-ID and unsupervised domain adaptive re-ID.

方法详解

方法框架

算法描述

具体实现

1,图二是总体框架。 由挖掘伪标签和 元优化两个阶段组成。 第一阶段,提取特征然后使用DBSCAN进行聚类打伪标签, 第二阶段,使用伪标签训练模型。 过程中,维护了一个内存表,用来保存所有样本的特征,并在训练过程中进行更新。

2, 训练的时候,数据集根据相机标签被划分为了 元训练集+元测试集 两个部分,具体的训练采用的是文章提出的MeataCam算法。另外,文章还提出了动态对称交叉熵损失用于稳定噪音标签。

3, 使用了雅卡尔距离来生成伪标签.

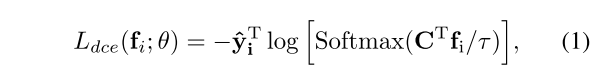

4, 受到【17】的启发,提出动态交叉熵损失,维护内存表 ,直接平均内存特征(公式1)

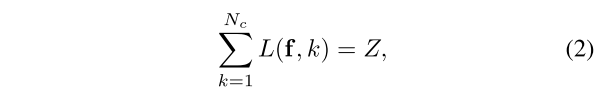

5, 【9】 提出了判断损失函数是否对噪音样本是有鲁棒性的公式 (公式2),含义是各个类别的分类损失之和是一个常量。

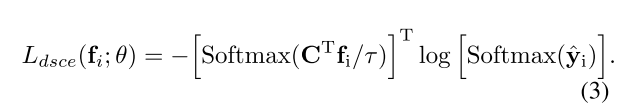

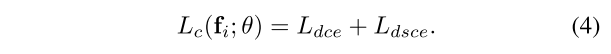

6,受到【36】启发,文章提出了动态对称交叉熵损失(DSCE)(公式3),和36不同的是,我们采用了softmax 标准化来避免除0。 最终的损失函数如公式4所示。

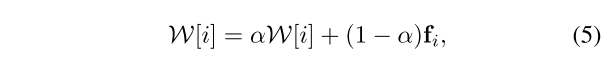

7,内存表的更新根据公式5进行更新。 加权求和更新。

8 MetaCam 主要是用来优化模型对相机变化的鲁棒性,由Meta-sets preparation \ meta-train、 meta-test 和 meta-update 四个步骤组成。

9, Meta-sets preparation: 随机选个Nmtr个相机的样本作为元训练集,剩下的作为元测试集

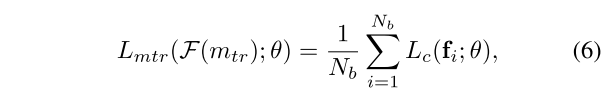

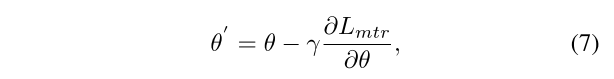

10,Meta-train:损失函数如公式6所示。 模型参数的更新如公式7所示。

11,meta-test:损失函数如公式8所示。

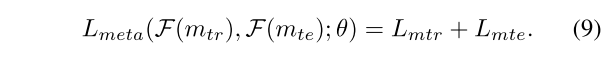

12,mete-update:元损失如公式9所示。

实验结果

总体评价

1,在2021CVPR的论文中,该论文的性能并不算突出,但是还是碾压了一批2020CVPR的论文。

2,考虑两个问题,关于噪音标签和相机差异的鲁棒性,是非常值得去考虑和思考的。

3,这里又用到了雅卡尔距离来生成伪标签。但是文中并没有给出公式。

4,框架图很赞,美观大气,表达内容清晰,和文字内容呼应得很好。

5,算法部分加入了注释,结构清晰,可读性更强。

6,图3的聚类效果,对方法的有效性具有强说服力。

小样本学习与智能前沿(下方↓公众号)后台回复“MetaCam",即可获得论文电子资源。

引用格式

@inproceedings{DBLP:conf/cvpr/YangZLCLLS21,

author = {Fengxiang Yang and

Zhun Zhong and

Zhiming Luo and

Yuanzheng Cai and

Yaojin Lin and

Shaozi Li and

Nicu Sebe},

title = {Joint Noise-Tolerant Learning and Meta Camera Shift Adaptation for

Unsupervised Person Re-Identification},

booktitle = {{CVPR}},

pages = {4855–4864},

publisher = {Computer Vision Foundation / {IEEE}},

year = {2021}

}

这篇关于Joint Noise-Tolerant Learning and Meta Camera Shift Adaptation for Unsupervised Person Re-ID的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!