本文主要是介绍神经网络硬件加速器-DPU分析,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

一 DPU概述

DPU是专为卷积神经网络优化的可编程引擎,其使用专用指令集,支持诸多卷积神经网络的有效实现。

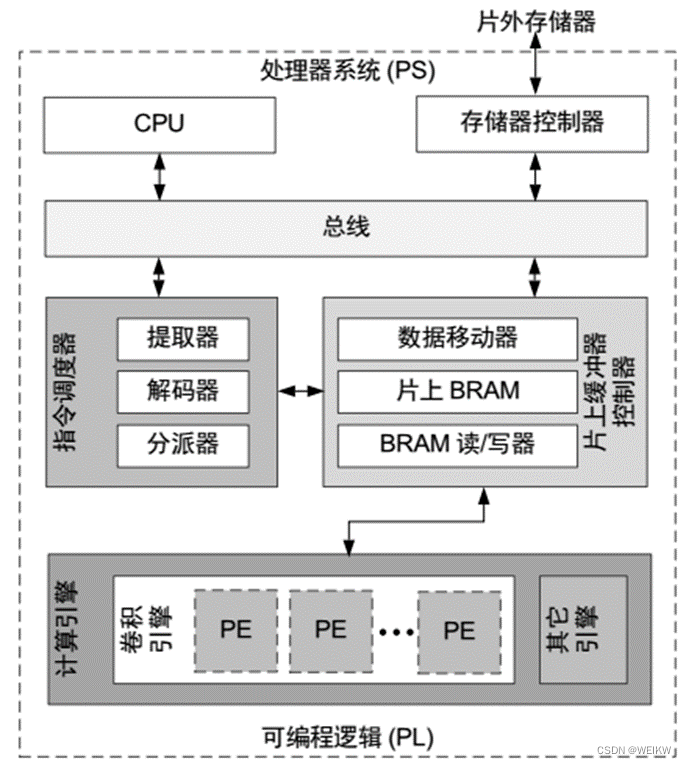

1、关键模块

- 卷积引擎:常规CONV等

- ALU:DepthwiseConv

- Scheduler:指令调度分发

- Buffer Group:片上数据缓存

- Data Mover:高速数据通道

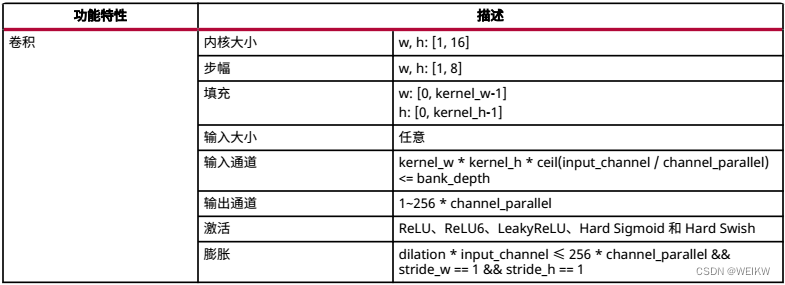

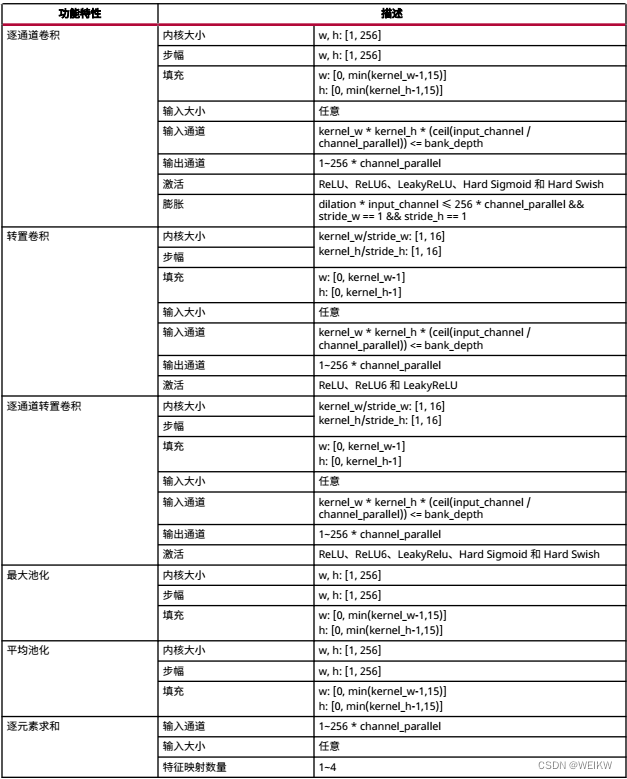

2、特性

3、工作流程

- 阶段一:上电后,DPU将指令从外部DRAM加载到片上,译码并分发至各个模块;并根据指令通过DMA将相应权重和输入特征图加载至片上缓存

- 阶段二:计算引擎根据调度算法将所需数据加载至计算阵列中,通过并行计算引擎完成计算任务

- 阶段三: 一旦完成当。前层计算任务,则需要将输出特征图通过DMA写回片外DRAM,然后开启下一层计算任务。进而实现整个网络的逐层加速计算

二 设计分析

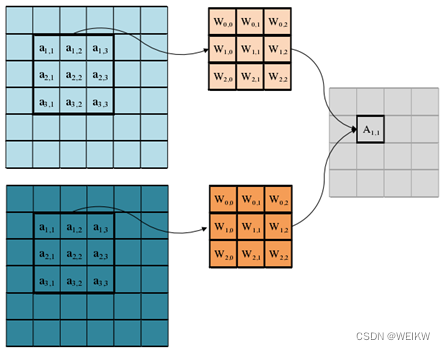

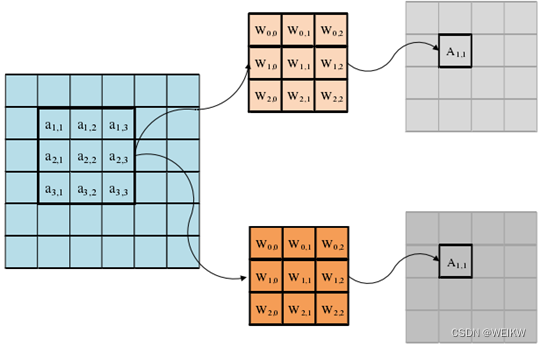

DPU通过组合多种并行度来搭配多种卷积架构,DPU卷积架构包括三个维度的并行度:像素并行度/输入通道并行度/输出通道并行度(通常输入通道并行度=输出通道并行度)。

1、并行度

- 像素并行度:PP

- 输入通道并行度:ICP

- 输出通道并行度:OCP

2、计算模式

数据排布格式猜测大致为:NHWC

计算模式:

- 1 优先复用输入通道:计算卷积时每次将部分输入特征图从外部缓存读到FPGA片上缓存,卷积计算时优先复用输入特征图,计算尽可能多的输出通道结果,避免计算不同输出通道时多次加载这部分特征图。

- 2 然后复用输出通道:基于1,每次计算尽可能多的计算输出通道,因片上缓存资源受限,通常无法一次计算玩所有输出通道,这里需要配合调度优先计算剩余的输出通道。

- 3 采用输出复用方法:输出数据复用对输出缓存具有最少的访问次数,计算过程中,将累加的中间结果保存在片上,直到全部结果累加结束再存回片外。

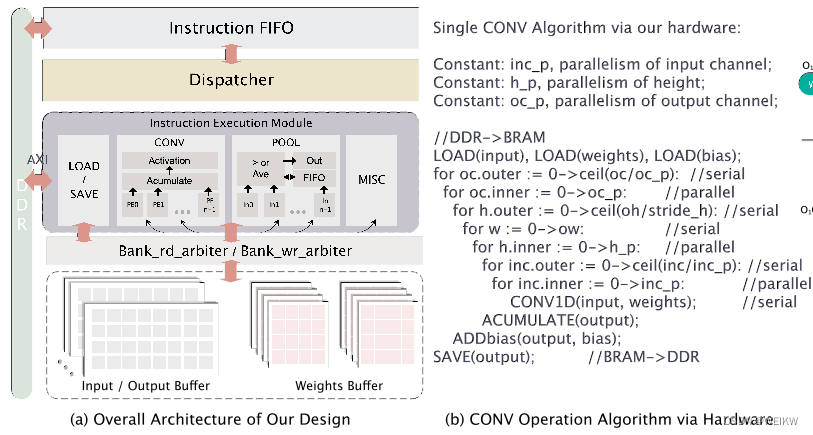

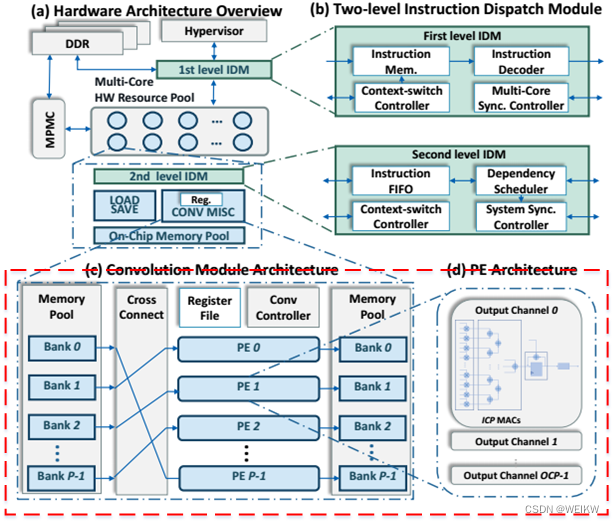

3、架构设计

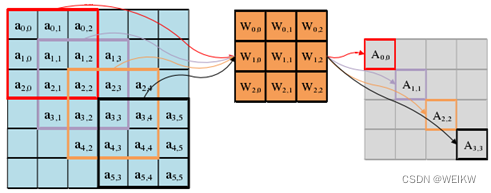

DPU计算架构设计如下图红色方框部分

CONV计算阵列:计算阵列包括P个PE,每个PE用于完成1个输出像素计算,P个PE完成P个并行像素的卷积计算;每个PE包含OCP个计算阵列,每个计算阵列包含ICP个MACs,分别完成输出通道并行/输出通道并行的卷积计算。

单个计算阵列中包含多个乘法器单元,加法树,非线性计算采用流水线方式设计,通过复制OCP个并行流水线,完成OCP并行度的输出通道卷积运算。也包含任意尺寸的池化、逐元素、尺寸变换、全连接等

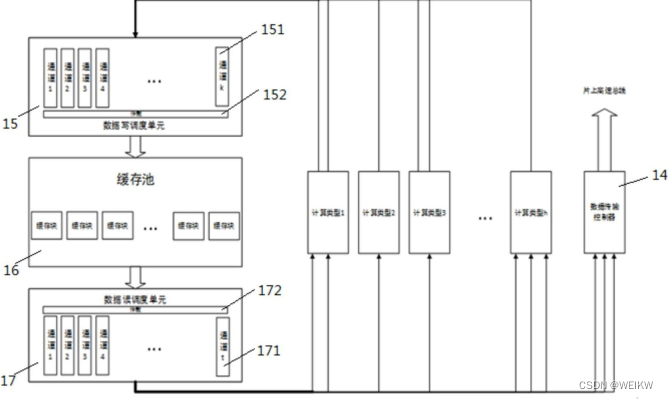

Memory POOL:缓存池根据相关专利,为统一缓存池,与传统的输入缓冲区-计算核阵列-输出缓存区结构不同,其采用统一的缓存池,多通道数据读写调度单元设计。DPU根据不同网络不同层的特点,动态申请、分配来使用相应的缓存空间,最大化利用片上缓存资源。

卷积计算单元和ALU可以脱离顺序执行的流水线限制而彼此独立,同时可以保证各计算单元的数据吞吐率,有效提升计算模块的灵活性和并行度。

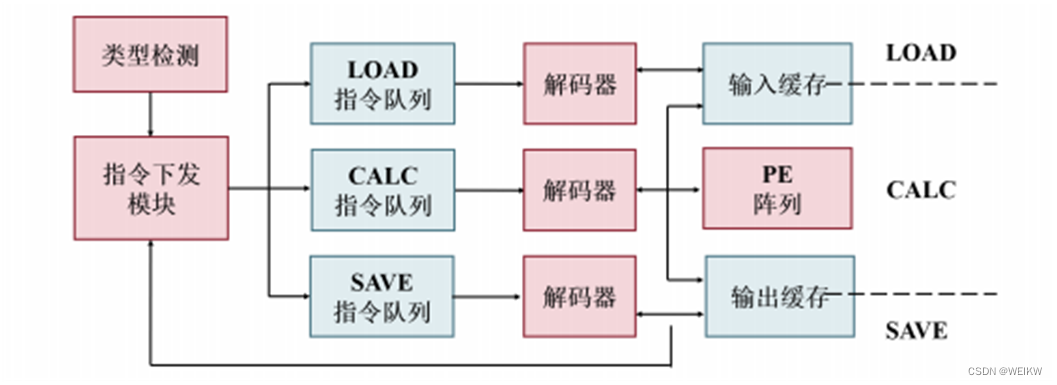

4、指令集

DPU采用多指令多数据流架构,包含指令类型如下:

- LOAD:数据加载

- SAVE:数据缓存

- CONV:卷积计算,包括常规卷积/转置卷积等

- MISC:逐通道卷积等

具有以下特点:

- 不同类别指令并行执行

- 相同类别指令串行执行

- 不同类别指令间存在相互依赖

- 依赖关系不应存在死锁

指令优化:

- 将访存和计算并行,提高计算单元利用率

- 通过调整tile策略和大小,优化系统访存

指令字段包括:操作码(区分不同指令类型)、依赖码(不同类型指令集安存在并行可能性)、指令参数(具体指令功能描述)

待补充。。。

三 参考文献

[1] 深鉴相关专利

[2] 清华大学NICS-EFC组相关paper

[3]XILINX DPU相关datasheet

这篇关于神经网络硬件加速器-DPU分析的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!