本文主要是介绍Logistic Regression -- 单自变量,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

Why

传统的回归过程如线性回归解决的是 Y 为连续实数的情况。Logistic 回归是解决离散的分类问题,换句话说,要求

名字来自于指数分布家族中的Logistic 分布。

What

我们处理的是0-1分类问题. 输入n个样本, 第 i 个样本为

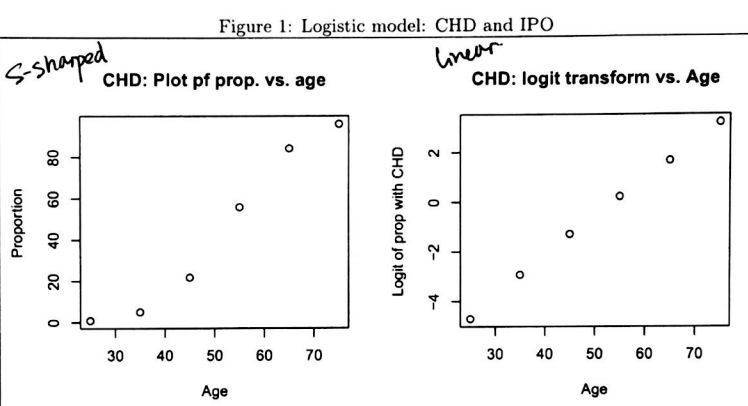

让它更具体一些, 设 pi=P(Yi=1|Xi=xi;β)=ezi1+ezi=F(zi) 。具体针对回归问题来说,假设model是最简单的对X线性的Logistic regression, 则 Y=1 事件发生的概率/比例/proportion为 p=P(Y=1|X=x;β)=ez1+ez∈[0,1]→z=log(p1−p)=β0+β1x. F(Z)=p 形状是从0到1的S型.

通过 p 寻找

注: 其实不局限于用直线做拟合`, 只要是linear in parameters 的linear regression即可.

How

例子

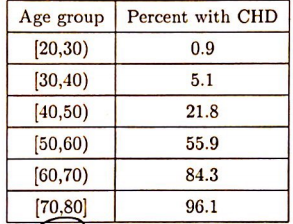

图中所示为某城市心脏病数据。

左手边列表示年龄段,右手边表对应年龄段中有心脏病的比例(占样本中的)。能看到随着年龄增长心脏病比例也相应增高.

设 π(X)=p 表年龄为 X 的人口中有心脏病的所占比例,取年龄段中点为该年龄段的代表年龄。以

当我们找出合适的直线后, 对要预测的 X 带入

比如我们算得 β0≈−8.467,β

这篇关于Logistic Regression -- 单自变量的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!