本文主要是介绍吴恩达神经网络Course——week4,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

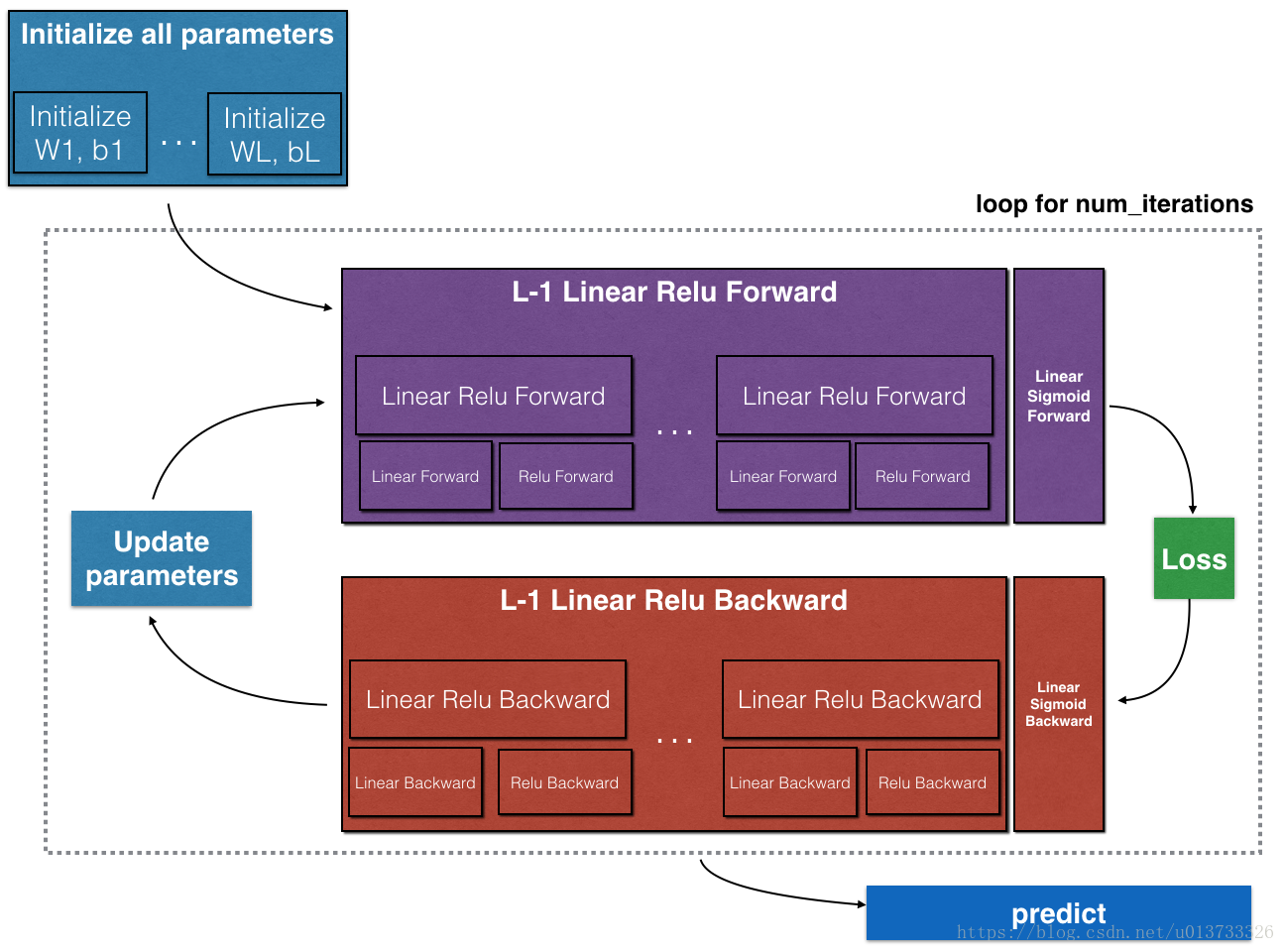

一个多层的神经网络,结构是输入层->隐藏层->隐藏层->···->隐藏层->输出层**,在每一层中,我会首先计算Z = np.dot(W,A) + b,这叫做【linear_forward】,然后再计算A = relu(Z) 或者 A = sigmoid(Z),这叫做【linear_activation_forward】,合并起来就是这一层的计算方法,所以每

-

初始化网络参数

-

前向传播

2.1 计算一层的中线性求和的部分

2.2 计算激活函数的部分(ReLU使用L-1次,Sigmod使用1次)

2.3 结合线性求和与激活函数

-

计算误差

-

反向传播

4.1 线性部分的反向传播公式

4.2 激活函数部分的反向传播公式

4.3 结合线性部分与激活函数的反向传播公式

-

更新参数

这篇关于吴恩达神经网络Course——week4的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!