本文主要是介绍【论文速递】CVPR2022 - 本征图像分解的判别特征编码,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

【论文速递】CVPR2022 - 本征图像分解的判别特征编码

【论文原文】:Discriminative feature encoding for intrinsic image decomposition

【作者信息】:Zongji Wang, Yufei Liu, Feng Lu

获取地址:https://arxiv.org/abs/2209.12155v1

博主关键词: 本征图像分解,特征编码

摘要:

本征图像分解是一项重要的、长期存在的计算机视觉问题。给定一个输入图像,想要恢复其物理场景的属性是不适定的,需要应用若干基于物理的先验约束到图像本征分解优化问题的解空间。本文的工作利用了深度学习方法来解决这一具有挑战性的计算机视觉问题。文章的焦点在于在特征编码阶段,模型从输入图像中提取不同本征层的判别特征,为了实现这一目标,我们探索了不同本征分量在高维特征嵌入空间中的显著特性。我们定义了特征分布散度来有效地区分不同本征分量的特征向量。通过应用特征分布一致性,对特征分布进行约束使其与真实分布相适应。此外,还提供了一种数据细化方法来去除Sintel数据集的数据不一致性,使其更适合于本征图像分解。我们的方法也扩展到了基于相邻帧之间像素级对应的本征视频分解。实验结果表明,我们提出的网络结构的表现优于现有的最先进网络。

关键词 -本征图像分解,深度学习,特征分布,数据细化。

简介:

在本征图像分解方面,反照率图像A表示表面材料在不同光照条件下的不变的反射率,而阴影图像S则表示来自物体几何和相机视点的光照影响。从单幅彩色图像I重构这两类本征图像是一个不适定问题,其形成模型为:

为了解决这一具有挑战性的逆成像问题,许多研究者尝试应用基于物理的先验作为约束来消除分解的歧义性。这些方法通常是以能量项的形式表示先验,并通过基于图(Graph)的推理算法来解决分解问题。随着地真的本征分解数据激增,数据驱动的深度学习方法取得了良好的分解效果,引起了越来越大的研究兴趣。然而,完全监督的方法需要高质量和密集标记的本征分解,获取代价高昂。为了克服这一问题,研究者提出了跨不同数据集训练、在合成数据集上训练、添加额外约束和重用基于物理先验的方法。

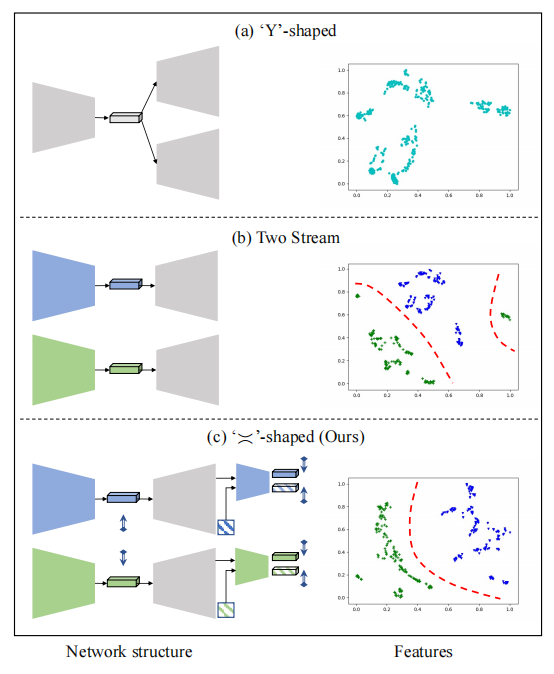

在开发特定的深度学习技术时,以前的方法通常通过共享编码器提取特征,然后使用不同的解码器来为特定的内在层解开信息。观察反照率和阴影在梯度域中的不同分布,我们很自然地假设在高维嵌入空间中可以分离出代表不同本征层的特征。通过在编码阶段分离特征,解码器可以从提取特定目标的线索任务中解脱出来,专注于重建过程。

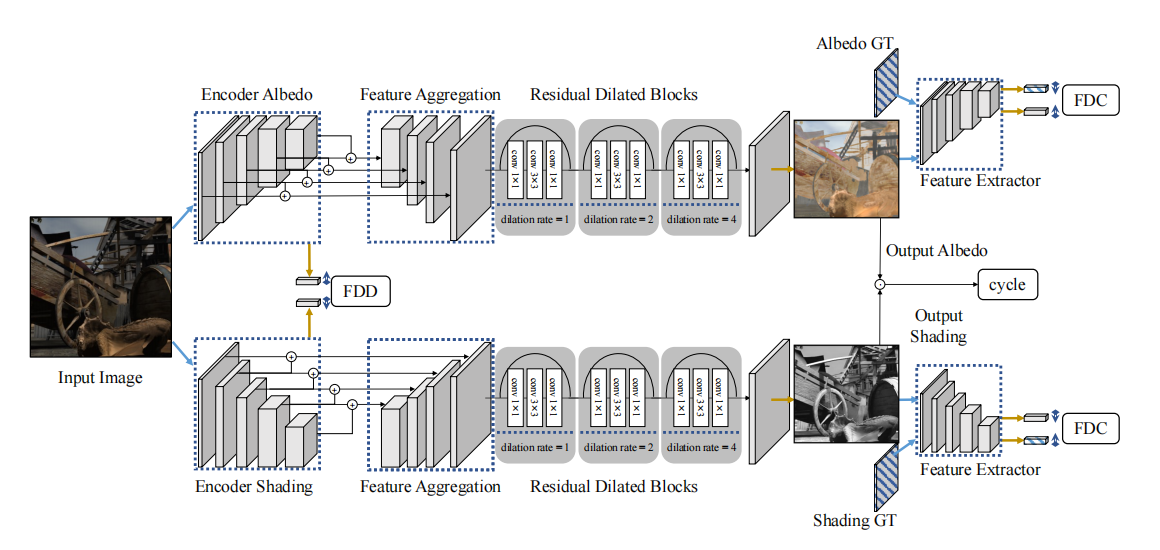

我们提出了一种新型的双流编码器-解码器网络,用于本征图像分解。特别地,我们的特征分布散度(FDD)约束旨在鼓励两个编码器为不同的本征层提取不同的特征。我们的特征一致性(FDC)约束旨在鼓励重构的本征层的特征具有与地真分解相似的分布模式。此外,我们还提供了一种处理MPI Sintel数据集中地真阴影与输入图像之间光照不一致的方法,使其更适合于本征图像分解。我们还提供了一种基于相邻帧之间像素级对应的视频数据的本征分解方法。这项工作是我们在之前发表的研讨会论文的延伸,提供了更详细的方法描述,新颖的技术贡献和更全面的实验。

综上所述,本文的贡献如下:首先,我们提出了一种新型的双流编码器-解码器网络用于本征图像分解,其中判别特征的编码通过特征分布散度(FDD)和特征分布一致性(FDC)约束实现。其次,我们提出了一种对MPI Sintel数据集的数据细化算法,以产生更适合本征分解任务的物理一致的数据集。最后,在各种数据集上的实验结果表明了我们提出方法的有效性,包括了对视频数据本征分解的实验性扩展。

【论文速递 | 精选】

这篇关于【论文速递】CVPR2022 - 本征图像分解的判别特征编码的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!