本文主要是介绍【365天深度学习训练营】第6周:好莱坞明星识别,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

- 🍨 本文为🔗365天深度学习训练营 内部限免文章(版权归 K同学啊 所有)

- 🍦 参考文章地址: 🔗第6周:好莱坞明星识别 | 365天深度学习训练营

- 🍖 作者:K同学啊 | 接辅导、程序定制

文章目录

- 我的环境:

- 一、前期工作

- 1. 设置 GPU

- 2. 导入数据

- 3. 查看数据

- 4. 可视化图片

- 二、数据预处理

- 1. 加载数据

- 2. 可视化数据

- 3. 再次检查数据

- 4. 配置数据集

- 三、构建CNN网络

- 四、训练模型

- 1.设置动态学习率

- 学习率大与学习率小的优缺点分析:

- 2.早停与保存最佳模型参数

- EarlyStopping()参数说明:

- 3.模型训练

- 五、模型评估

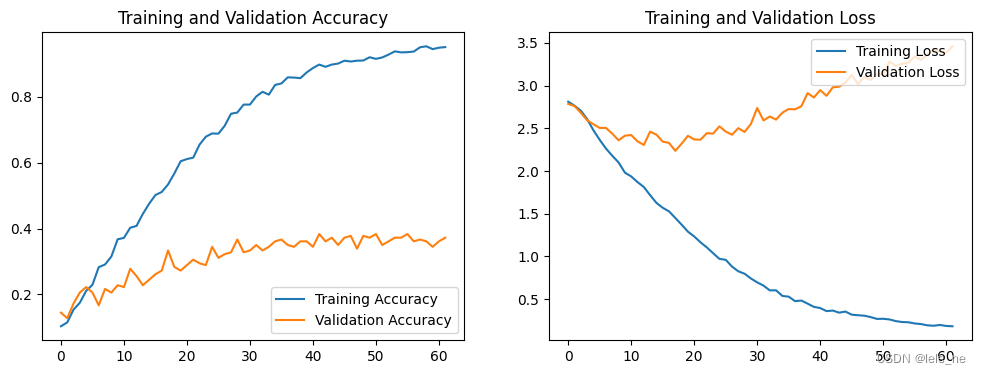

- 1. Loss 与 Accuracy 图

- 2. 指定图片进行预测

我的环境:

- 语言环境:Python3.6.8

- 编译器:jupyter notebook

- 深度学习环境:TensorFlow2.3

一、前期工作

1. 设置 GPU

import tensorflow as tfgpus = tf.config.list_physical_devices("GPU")if gpus:gpu0 = gpus[0] #如果有多个GPU,仅使用第0个GPUtf.config.experimental.set_memory_growth(gpu0, True) #设置GPU显存用量按需使用tf.config.set_visible_devices([gpu0],"GPU")gpus

[PhysicalDevice(name='/physical_device:GPU:0', device_type='GPU')]

2. 导入数据

import os,PIL,pathlib

import matplotlib.pyplot as plt

import numpy as np

from tensorflow import keras

from tensorflow.keras import layers,modelsdata_dir = "D:/jupyter notebook/DL-100-days/datasets/48-data/" # 图片存放目录

data_dir = pathlib.Path(data_dir) # 构造 pathlib 模块下的 Path 对象

有关 pathlib 模块的更多介绍,大家可以去了解一下

3. 查看数据

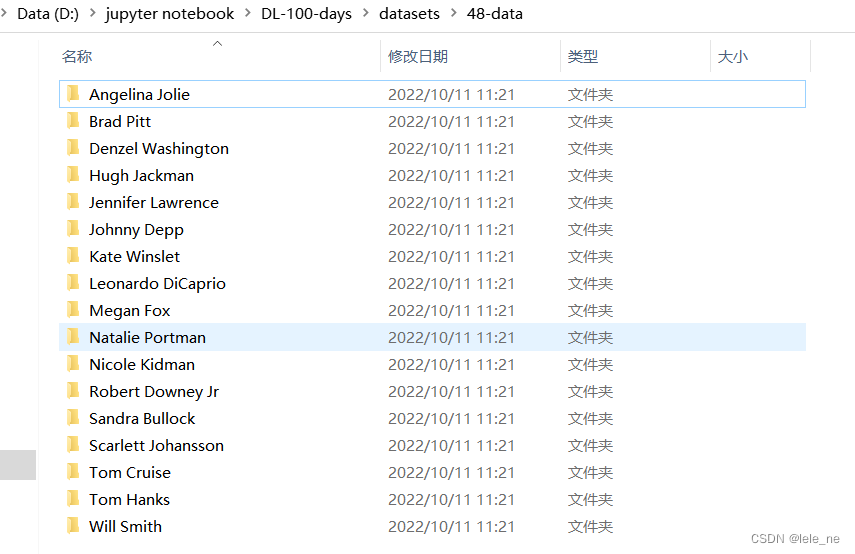

数据集一共分为 17 类,分别存放于 48-data 文件夹中以 17 个好莱坞明星名字命名的子文件夹中

image_count = len(list(data_dir.glob('*/*.jpg'))) # 使用 Path 对象的 glob() 方法获取 48-data 目录下的 17 个文件夹所有图片print("图片总数为:",image_count)

图片总数为: 578

4. 可视化图片

# 返回图片路径

roses = list(data_dir.glob('Jennifer Lawrence/*.jpg'))# 使用 Path 对象的 glob() 方法获取 48-data/train/Jennifer Lawrence 目录下的所有图片对象

PIL.Image.open(str(roses[25])) # 读取第 26 张图片

二、数据预处理

1. 加载数据

使用 image_dataset_from_directory 方法将磁盘中的数据加载到 tf.data.Dataset 中

batch_size = 32 # 批量大小,一次训练 32 张图片

img_height = 224 # 图片高度,把图片进行统一处理,因为图片尺寸不一,需要我们自己定义图片高度

img_width = 224 # 图片宽度,把图片进行统一处理,因为图片尺寸不一,需要我们自己定义图片宽度

tf.keras.preprocessing.image_dataset_from_directory() 的参数:

- directory, # 存放目录

- labels=“inferred”, # 图片标签

- label_mode=“int”, # 图片模式

- class_names=None, # 分类

- color_mode=“rgb”, # 颜色模式

- batch_size=32, # 批量大小

- image_size=(256, 256), # 从磁盘读取数据后将其重新调整大小。

- shuffle=True, # 是否打乱

- seed=None, # 随机种子

- validation_split=None, # 0 和 1 之间的数,可保留一部分数据用于验证。如:0.2=20%

- subset=None, # “training” 或 “validation”。仅在设置 validation_split 时使用。

- interpolation=“bilinear”, # 插值方式:双线性插值

- follow_links=False, # 是否跟踪类子目录中的符号链接

#!pip install tf-nightly

train_ds = tf.keras.preprocessing.image_dataset_from_directory(data_dir,validation_split=0.1,subset="training",label_mode = "categorical",#导入的目标数据,进行onehot编码seed=123,image_size=(img_height, img_width),batch_size=batch_size)

输出:

Found 1800 files belonging to 17 classes.

Using 1620 files for training.

val_ds = tf.keras.preprocessing.image_dataset_from_directory(data_dir,validation_split=0.1,subset="validation",label_mode = "categorical",seed=123,image_size=(img_height, img_width),batch_size=batch_size)

输出:

Found 1800 files belonging to 17 classes.

Using 180 files for validation.

class_names = train_ds.class_names

print(class_names)

输出:

[‘Angelina Jolie’, ‘Brad Pitt’, ‘Denzel Washington’, ‘Hugh Jackman’, ‘Jennifer Lawrence’, ‘Johnny Depp’, ‘Kate Winslet’, ‘Leonardo DiCaprio’, ‘Megan Fox’, ‘Natalie Portman’, ‘Nicole Kidman’, ‘Robert Downey Jr’, ‘Sandra Bullock’, ‘Scarlett Johansson’, ‘Tom Cruise’, ‘Tom Hanks’, ‘Will Smith’]

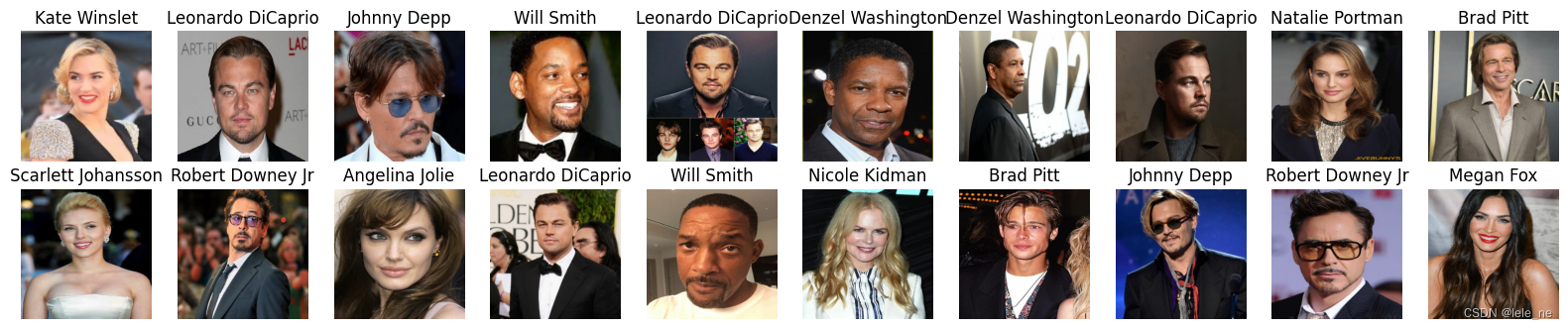

2. 可视化数据

# 设置画板的宽高,单位为英寸

plt.figure(figsize=(20, 10))

# train_ds.take(1) 是指从训练集数据集中取出 1 个 batch 大小的数据,返回值 images 存放图像数据,labels 存放图像的标签。

for images, labels in train_ds.take(1):for i in range(20):# plt.subplot('行', '列','编号') 绘制画板的子区域 将整个图像窗口分为5行10列,当前位置为 i + 1ax = plt.subplot(5, 10, i + 1)# imshow() 其实就是将数组的值以图片的形式展示出来,数组的值对应着不同的颜色深浅,而数值的横纵坐标就是数组的索引plt.imshow(images[i].numpy().astype("uint8"))# labels[i] 的值为 0, 1, 2, 3,映射到 class_names 可以得到图片的类别plt.title(class_names[labels[i]])# 不显示轴线plt.axis("off")

3. 再次检查数据

for image_batch, labels_batch in train_ds:print(image_batch.shape)print(labels_batch.shape)break

输出

(32, 224, 224, 3)

(32,17)

- image_batch : (32, 224, 224, 3) 第一个32是批次尺寸,224是我们修改后的宽高,3是RGB三个通道

- labels_batch : (32,) 一维,32个标签

4. 配置数据集

AUTOTUNE = tf.data.AUTOTUNEtrain_ds = train_ds.cache().shuffle(1000).prefetch(buffer_size=AUTOTUNE)

val_ds = val_ds.cache().prefetch(buffer_size=AUTOTUNE)

- shuffle() : 数据乱序

- prefetch() : 预取数据加速运行

- cache() : 数据集缓存到内存中,加速

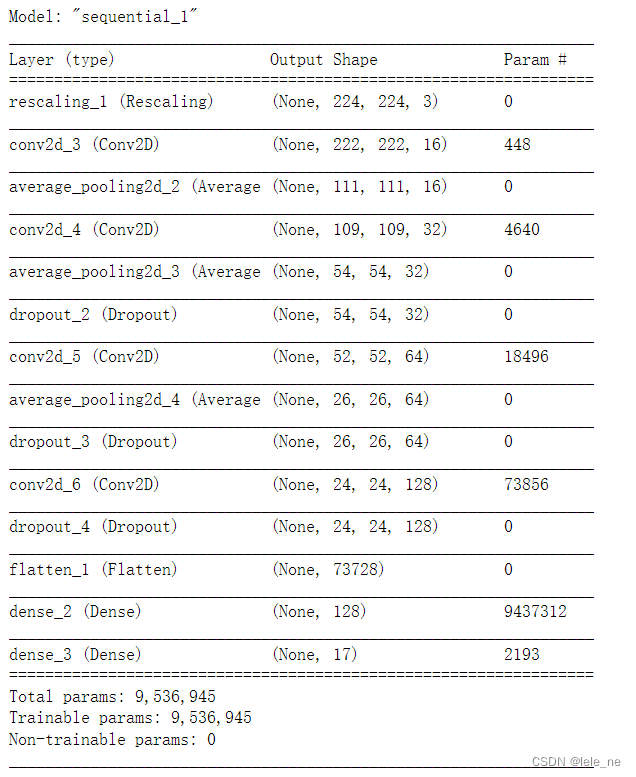

三、构建CNN网络

"""

关于卷积核的计算不懂的可以参考文章:https://blog.csdn.net/qq_38251616/article/details/114278995layers.Dropout(0.4) 作用是防止过拟合,提高模型的泛化能力。

在上一篇文章花朵识别中,训练准确率与验证准确率相差巨大就是由于模型过拟合导致的关于Dropout层的更多介绍可以参考文章:https://mtyjkh.blog.csdn.net/article/details/115826689

"""model = models.Sequential([layers.experimental.preprocessing.Rescaling(1./255, input_shape=(img_height, img_width, 3)),layers.Conv2D(16, (3, 3), activation='relu', input_shape=(img_height, img_width, 3)), # 卷积层1,卷积核3*3 layers.AveragePooling2D((2, 2)), # 池化层1,2*2采样layers.Conv2D(32, (3, 3), activation='relu'), # 卷积层2,卷积核3*3layers.AveragePooling2D((2, 2)), # 池化层2,2*2采样layers.Dropout(0.5), layers.Conv2D(64, (3, 3), activation='relu'), # 卷积层3,卷积核3*3layers.AveragePooling2D((2, 2)), layers.Dropout(0.5), layers.Conv2D(128, (3, 3), activation='relu'), # 卷积层3,卷积核3*3layers.Dropout(0.5), layers.Flatten(), # Flatten层,连接卷积层与全连接层layers.Dense(128, activation='relu'), # 全连接层,特征进一步提取layers.Dense(len(class_names)) # 输出层,输出预期结果

])model.summary() # 打印网络结构

四、训练模型

在准备对模型进行训练之前,还需要再对其进行一些设置。以下内容是在模型的编译步骤中添加的:

- 损失函数(loss):用于衡量模型在训练期间的准确率。

- 优化器(optimizer):决定模型如何根据其看到的数据和自身的损失函数进行更新。

- 指标(metrics):用于监控训练和测试步骤。以下示例使用了准确率,即被正确分类的图像的比率。

1.设置动态学习率

# 设置初始学习率

initial_learning_rate = 1e-4lr_schedule = tf.keras.optimizers.schedules.ExponentialDecay(initial_learning_rate, decay_steps=60, # 敲黑板!!!这里是指 steps,不是指 epochsdecay_rate=0.96, # lr经过一次衰减就会变成 decay_rate*lrstaircase=True)# 将指数衰减学习率送入优化器

optimizer = tf.keras.optimizers.Adam(learning_rate=lr_schedule)model.compile(optimizer=optimizer,loss=tf.keras.losses.CategoricalCrossentropy(from_logits=True),metrics=['accuracy'])

学习率大与学习率小的优缺点分析:

学习率大

- 优点:

- 1、加快学习速率

- 2、有助于跳出局部最优值

- 缺点:

- 1、导致模型训练不收敛

- 2、单单使用大学习率容易导致模型不精确

学习率小

- 优点:

- 1、有助于模型收敛、模型细化

- 2、提高模型精度

- 缺点:

- 1、很难跳出局部最优值

- 2、收敛缓慢

注意:这里设置的动态学习率为:指数衰减型(ExponentialDecay)。在每一个epoch开始前,学习率(learning_rate)都将会重置为初始学习率(initial_learning_rate),然后再重新开始衰减。计算公式如下:

learning_rate = initial_learning_rate * decay_rate ^ (step / decay_steps)

2.早停与保存最佳模型参数

EarlyStopping()参数说明:

- monitor: 被监测的数据。

- min_delta: 在被监测的数据中被认为是提升的最小变化, 例如,小于 min_delta 的绝对变化会被认为没有提升。

- patience: 没有进步的训练轮数,在这之后训练就会被停止。

- verbose: 详细信息模式。

- mode: {auto, min, max} 其中之一。 在 min 模式中, 当被监测的数据停止下降,训练就会停止;在 max 模式中,当被监测的数据停止上升,训练就会停止;在 auto 模式中,方向会自动从被监测的数据的名字中判断出来。

- baseline: 要监控的数量的基准值。 如果模型没有显示基准的改善,训练将停止。

- estore_best_weights: 是否从具有监测数量的最佳值的时期恢复模型权重。 如果为 False,则使用在训练的最后一步获得的模型权重。

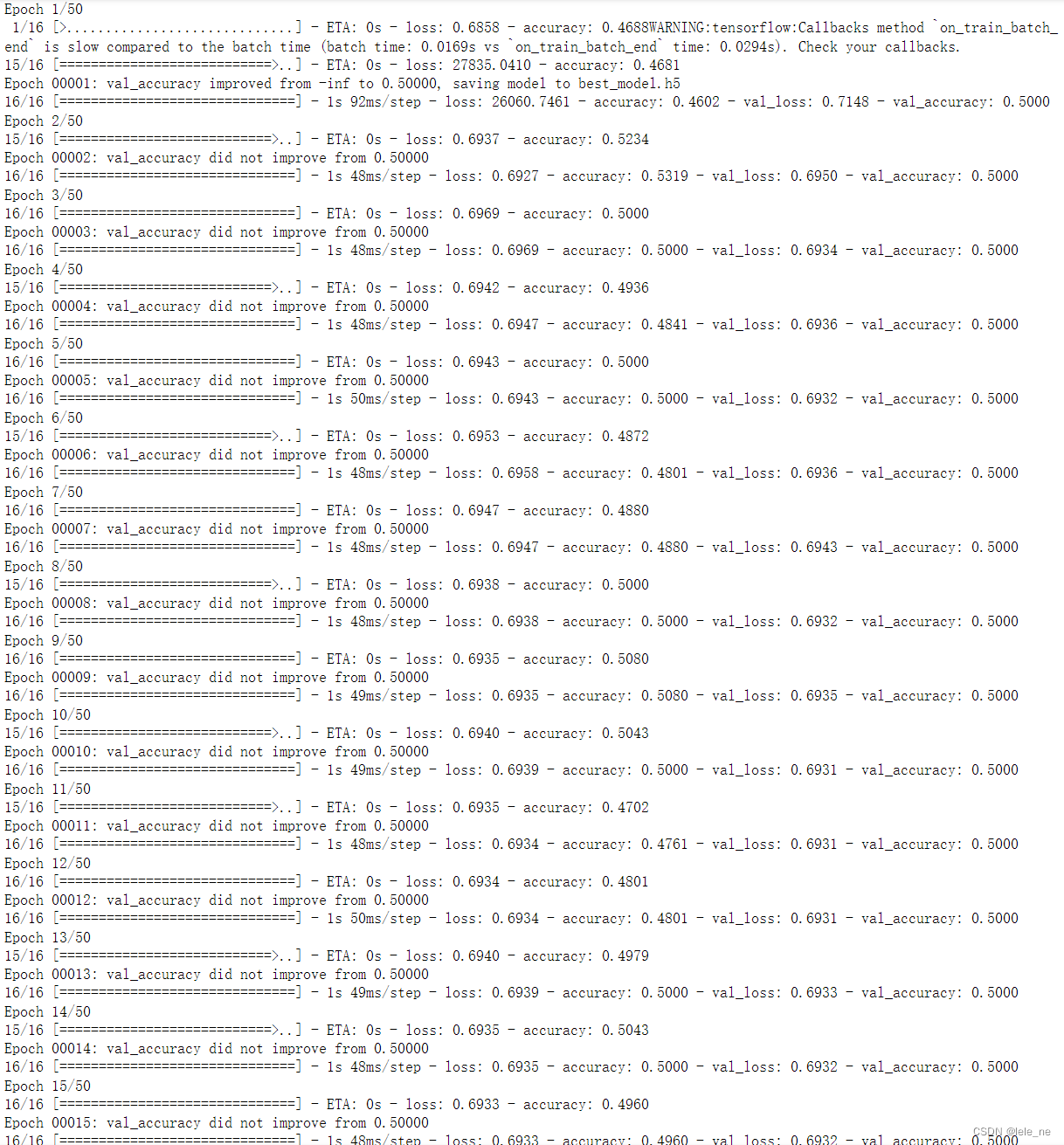

from tensorflow.keras.callbacks import ModelCheckpoint, EarlyStoppingepochs = 100# 保存最佳模型参数

checkpointer = ModelCheckpoint('best_model.h5',monitor='val_accuracy',verbose=1,save_best_only=True,save_weights_only=True)# 设置早停

earlystopper = EarlyStopping(monitor='val_accuracy', min_delta=0.001,patience=20, verbose=1)

3.模型训练

history = model.fit(train_ds,validation_data=val_ds,epochs=epochs,callbacks=[checkpointer, earlystopper])

五、模型评估

1. Loss 与 Accuracy 图

acc = history.history['accuracy']

val_acc = history.history['val_accuracy']loss = history.history['loss']

val_loss = history.history['val_loss']epochs_range = range(len(loss))plt.figure(figsize=(12, 4))

plt.subplot(1, 2, 1)

plt.plot(epochs_range, acc, label='Training Accuracy')

plt.plot(epochs_range, val_acc, label='Validation Accuracy')

plt.legend(loc='lower right')

plt.title('Training and Validation Accuracy')plt.subplot(1, 2, 2)

plt.plot(epochs_range, loss, label='Training Loss')

plt.plot(epochs_range, val_loss, label='Validation Loss')

plt.legend(loc='upper right')

plt.title('Training and Validation Loss')

plt.show()

2. 指定图片进行预测

# 加载效果最好的模型权重

model.load_weights('best_model.h5')

from PIL import Image

import numpy as npimg = Image.open("D:/jupyter notebook/DL-100-days/datasets/48-data/Jennifer Lawrence/003_963a3627.jpg") #这里选择你需要预测的图片

img = np.array(img)

image = tf.image.resize(img, [img_height, img_width])

img_array = tf.expand_dims(image, 0) predictions = model.predict(img_array) # 这里选用你已经训练好的模型

print("预测结果为:",class_names[np.argmax(predictions)])

预测结果为: Jennifer Lawrence

这篇关于【365天深度学习训练营】第6周:好莱坞明星识别的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!