本文主要是介绍灾害事件下社交媒体图文相关性研究,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

灾害事件下社交媒体图文相关性研究

摘 要

对灾害情境下的微博图片和文本内容进行分析,理解灾害情境下微博图片与文本的相关性。基于图像语义理解框架构建图文相关性分类模型,通过对图像和文本进行特征抽取,利用机器学习和深度学习方法提出图文相关性的多标签分类方法,针对台风“山竹”事件开展实验分析。

关键词

灾害事件;图文相关性;社交媒体;图像语义;深度学习

研究意义

基于社交媒体的图像文本相关性研究较少,在突发事件情景下,对于图文相关性的研究还有助于深入理解图片内容,从而更好地服务于突发事件信息管理。

基于图像语义理解模型

因为 Eakins 三层语义模型能够形容图像的全部语义信息,本文根据 Eakins 模型来构建图文相关性的分类体系。

创新点

本文以 2018 年台风山竹相关微博数据展开研究,基于图像语义理解模型构建了灾害下微博图文相关性分类体系,并尝试使用 BiLSTM (bi-direc‐tional long short-term memory) 方法对图文相关类型进行分类,从而深入理解灾害事件下微博的图片和文本内容及其相关性。

图文相关性前人研究成果

- Liu 等在图像的自动标注中将搜索词和图像的关系分解为词与词的关系和词与图的关系, 这 种 方 式 可 以 最 大 化 图 像 和 词 语 联 合 概 率 ;

- Yeh 等通过图像分割的方式分割出图像概念,然后将其与文本的词语的关联性进行独立性检验,从而能够找到图像和文本分布的一致性来实现图像和文本的自动匹配。

- Jiang等 分 别 使 用 改 进 的TF-IDF 和 K-means 算 法 对 文 本 和 图 像 进 行 特 征 提取,然后将两者映射到彼此的向量空间,利用余弦相似度的几何平均值衡量图像和文本的相似性。

- Hu 等将 tweet 的文本和图像内包含的文本的关系以及文本和图像本身的关系相结合来量化图像和文本的相关程度,最终通过相关性量化指标排名以图文检索的方式来验证评估量化结果的质量。

- 胡慧君等通过遗传算法来建立微博图像特征到文本特征图文之间的映射矩阵,然后将数据输入不同的算法评估图像和文本的相关性,降低了图像和文本数据维度不同带来的影响。

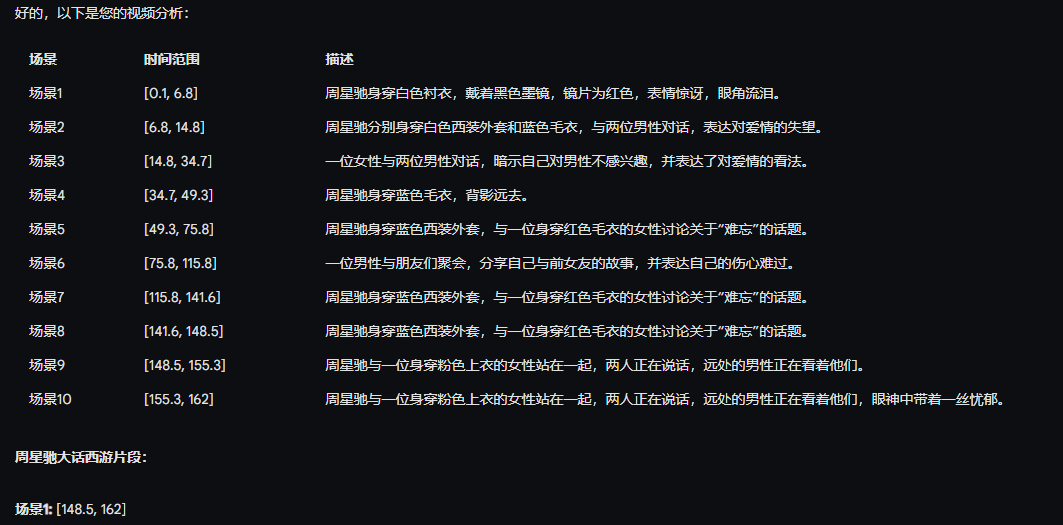

数据集

以“台风山竹”作为关键词,时间跨度为 9 月 7 日—9 月 30 日,通过检索共获取了 51652 条微博数据。微博信息包括微博文本、微博图像链接、点赞数、转发数、评论数、发文设备、发文时间等。然后,依据微博图像链接下载微博图片,总共得到 107328 张图片。

相关性标注

本文的标注体系是依照 Eakins 三层模型构建的图文相关的分类体系。

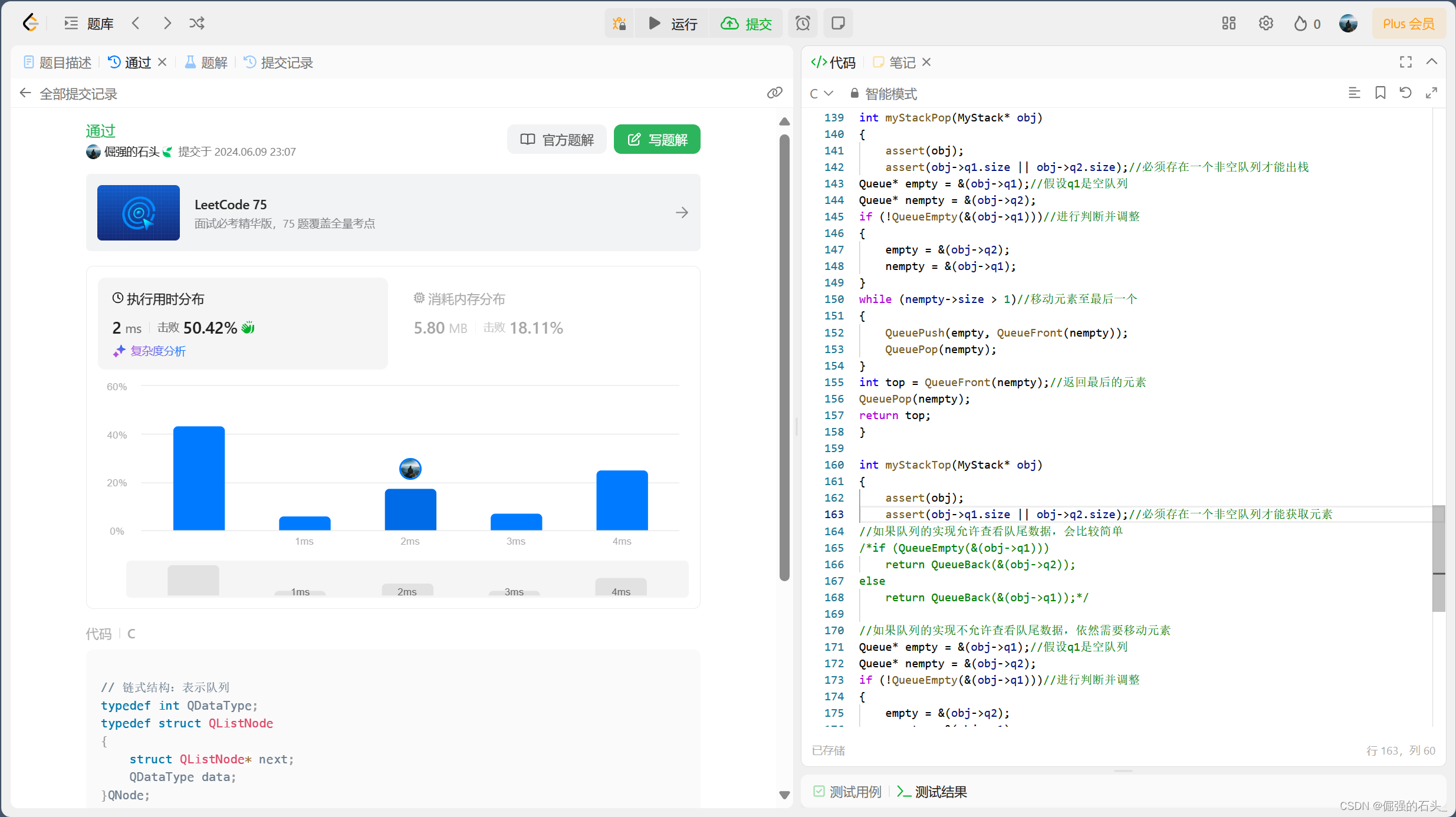

基于 BiLSTM 的图文相关性分类模型

1. 数据预处理

1.1 文本数据处理

文本数据处理的过程包括表情过滤、繁体转换、词法分析、信息提取和文本嵌入。

1.2 图像数据处理

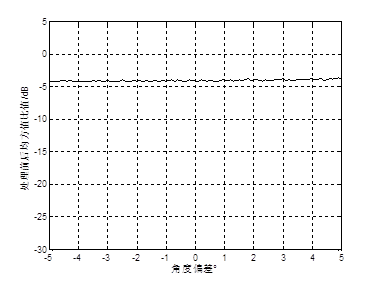

Google Cloud Platform中 Vision 平台 。该工具能够有效地识别图像标签以及其他视觉信息。

2.构建图文相关性分类模型

LSTM

长短记忆神经网络——通常称作LSTM,是一种特殊的RNN,能够学习长的依赖关系。

实验分析结果

实验将数据集按照 8∶2 的方式拆分为训练集和测试集,最终通过正确率、准确率、召回率和F1 值进行比较。表 2 是 BiLSTM 和对比实验的结果,我们使用准确率、召回率和 F1 来评估模型表现。

通过对实验结果的观察,可以得出在所有的相关性分类上,基于深度学习的模型都要优于传统的机器学习模型 SVM。因此总体来说,BiLSTM 在图文相关性的分类上要略 优 于 TextCNN, 除 场 景 相 关 和 文 字 相 关 分 类 ,BiLSTM 的 F1 值都比 TextCNN 高出 5%~15%。

问题与总结

不足之处:1.数据量不够导致了部分的分类效果不佳。

2.因为行为相关和不相关的数据较少导致了二者的召回率较低的问题。

3.台风是一类可预知且持续时间较长的灾害,如果替换成为“地震”等不可预知且持续时间短的灾害数据是否会在结果上有差异还有待进一步研究。

4.如何利用图像信息来为灾害的预警和识别服务是一个重要的研究问题。

5.拟扩充数据来提升数据数量,以及在图像标签提取上采用人工标注和寻找新方法改进标注质量来提高数据的质量,同时使用其他灾害信息来检验在不同类别的灾害下实验的结果;在进一步的研究延伸上,如何利用微博上相关图文来构建灾害下的识别、预警、评估体系,也是值得研究的内容。

这篇关于灾害事件下社交媒体图文相关性研究的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!

![[word] word设置上标快捷键 #学习方法#其他#媒体](https://img-blog.csdnimg.cn/img_convert/7a1ef11f92414f74d152e768c38640bf.gif)