本文主要是介绍v4l2(video4linux2) yuyv(yuv422)、MJPEG、H.264,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

V4L2(Video4Linux2)是Linux内核中的视频设备接口框架,专门用于捕获和输出视频数据。V4L2广泛应用于各种视频设备的驱动程序开发,如网络摄像头、电视调谐器、视频采集卡、以及其他视频输入/输出设备。

### V4L2的主要功能

1. **视频采集**:

- 通过摄像头、视频采集卡等设备捕获视频数据。

- 支持多种视频格式,如YUYV、MJPEG、H.264等。

2. **视频输出**:

- 通过显示设备输出视频流,如电视、显示器等。

3. **视频处理**:

- 支持视频格式转换、缩放、旋转等操作。

- 支持内核空间与用户空间之间的视频数据传输。

4. **音频支持**:

- V4L2也支持与视频流同步的音频数据传输和处理。

### V4L2的工作模式

V4L2支持两种主要的工作模式来管理视频数据的缓冲区:`mmap`模式和`USER_PTR`模式。

1. **mmap 模式**:

- `mmap`模式下,内核分配缓冲区并将其映射到用户空间,应用程序通过这些映射的内存区域来访问视频数据。

2. **USER_PTR 模式**:

- `USER_PTR`模式下,应用程序自行管理缓冲区,并将缓冲区的指针传递给内核。内核直接在这些用户空间的缓冲区中存储和处理数据。

### V4L2的API和结构体

V4L2提供了一系列的IOCTL(Input/Output Control)系统调用和数据结构,开发者可以通过这些接口与视频设备进行交互。

1. **常见的V4L2 IOCTL操作**:

- `VIDIOC_QUERYCAP`:查询设备的功能和能力。

- `VIDIOC_ENUM_FMT`:枚举设备支持的视频格式。

- `VIDIOC_S_FMT` 和 `VIDIOC_G_FMT`:设置和获取视频格式。

- `VIDIOC_REQBUFS`:请求分配视频缓冲区。

- `VIDIOC_QUERYBUF`:查询缓冲区的信息。

- `VIDIOC_QBUF` 和 `VIDIOC_DQBUF`:将缓冲区放入队列和从队列中取出。

- `VIDIOC_STREAMON` 和 `VIDIOC_STREAMOFF`:启动和停止视频流。

2. **主要的V4L2结构体**:

- `v4l2_capability`:表示设备的能力。

- `v4l2_format`:表示视频数据的格式。

- `v4l2_buffer`:表示视频缓冲区。

- `v4l2_requestbuffers`:用于请求缓冲区。

### V4L2的使用流程

一个典型的V4L2应用程序与视频设备交互的流程如下:

1. **打开设备**:

- 使用 `open()` 函数打开 `/dev/videoX` 设备文件。

2. **查询设备能力**:

- 使用 `VIDIOC_QUERYCAP` IOCTL 查询设备的能力。

3. **设置视频格式**:

- 使用 `VIDIOC_S_FMT` 设置所需的视频格式,如分辨率、像素格式等。

4. **请求和分配缓冲区**:

- 使用 `VIDIOC_REQBUFS` 请求内核分配视频缓冲区。

5. **映射缓冲区**(在 `mmap` 模式下):

- 使用 `mmap()` 将缓冲区映射到用户空间。

6. **启动视频流**:

- 使用 `VIDIOC_STREAMON` 启动视频流。

7. **处理视频帧**:

- 使用 `VIDIOC_QBUF` 将缓冲区放入队列,使用 `VIDIOC_DQBUF` 从队列中取出缓冲区,并处理视频数据。

8. **停止视频流**:

- 使用 `VIDIOC_STREAMOFF` 停止视频流。

9. **释放资源**:

- 解除映射,释放缓冲区,关闭设备。

### 应用场景

V4L2广泛应用于开发需要视频采集和处理的应用程序,如网络摄像头应用、视频会议系统、直播系统、安防监控系统、以及多媒体设备的驱动开发。

由于V4L2的灵活性和广泛支持,它成为了Linux平台上处理视频输入和输出的标准接口,尤其是在嵌入式系统和消费类电子产品中。

YUYV、MJPEG、H.264 是视频编码和像素格式的三种常见类型,每种格式在不同的场景下都有其特定的用途和优缺点。

### 1. **YUYV (YUV 4:2:2)**

**YUYV** 是一种像素格式,用于表示视频帧中每个像素的颜色信息。它属于 YUV 色彩空间的一种子采样格式。

- **YUV 色彩空间**:

- Y 代表亮度(Luminance),即灰度信息。

- U 和 V 代表色度(Chrominance),分别存储蓝色和红色分量的差异。

- **4:2:2 子采样**:

- 在 YUYV 格式中,Y 分量的分辨率与图像原始分辨率相同,但色度分量 U 和 V 的分辨率仅为原始分辨率的一半。这种子采样方式有效地减少了数据量,因为人眼对亮度变化比对色度变化更敏感。

- **数据排列**:

- 像素数据以交错方式存储,每两个像素共享一组 U 和 V 值。例如,存储格式为 `Y0 U0 Y1 V0`,其中 Y0 和 Y1 分别为两个像素的亮度,U0 和 V0 是这两个像素共享的色度信息。

- **优点**:

- 比 RGB 格式更节省带宽和存储空间,同时仍能提供良好的图像质量。

- **缺点**:

- 色彩分辨率较低,可能在某些高要求的应用中造成色彩细节丢失。

- **应用场景**:

- 常用于实时视频捕获和传输,如网络摄像头或视频会议系统。

### 2. **MJPEG (Motion JPEG)**

**MJPEG** 是一种视频编码格式,将一系列 JPEG 压缩的静态图像序列组成视频流。

- **编码方式**:

- 每一帧都是独立的 JPEG 图像,通过标准的 JPEG 压缩算法编码。这意味着 MJPEG 没有帧间压缩,帧与帧之间没有依赖性。

- **优点**:

- 编解码简单,资源开销小。

- 因为每一帧都是独立的图像,所以编辑和处理单帧图像非常方便。

- 对丢包不敏感,适合不可靠的网络传输环境。

- **缺点**:

- 由于没有帧间压缩,MJPEG 视频的文件大小通常较大。

- 相比 H.264 等高级视频压缩格式,压缩效率较低。

- **应用场景**:

- 常用于数字相机、网络摄像头、视频监控等应用中,特别是在实时性要求较高的场景中。

### 3. **H.264 (MPEG-4 AVC)**

**H.264**,也称为 **MPEG-4 AVC (Advanced Video Coding)**,是一种广泛使用的高效视频压缩标准。

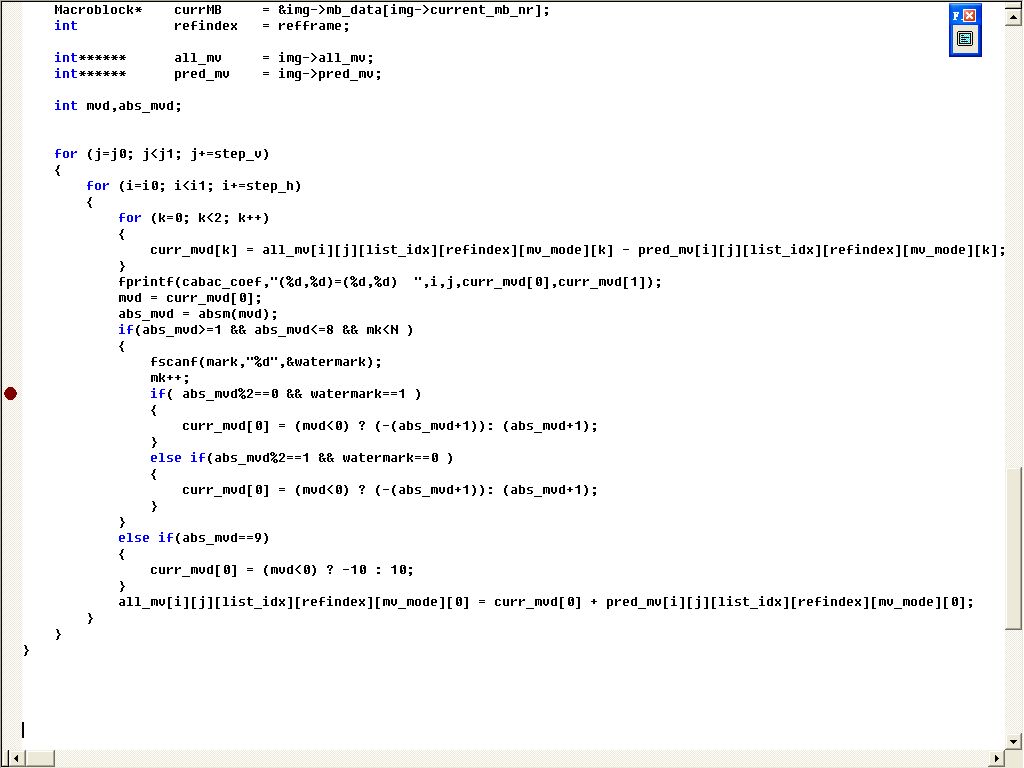

- **编码方式**:

- H.264 使用帧内和帧间压缩技术,通过分析视频帧的冗余性(如运动估计和补偿)来极大地减少数据量。它将视频分成宏块,并对每个宏块进行变换、量化和熵编码。

- **优点**:

- 高压缩效率,能在较低的比特率下提供较高的视频质量。

- 支持多种分辨率和比特率,灵活性高。

- 由于广泛的硬件加速支持,H.264 可以在多种设备上实现高效的编码和解码。

- **缺点**:

- 编码和解码的复杂性较高,要求更多的计算资源。

- 由于其复杂的专利许可结构,在某些情况下可能涉及版权和授权费用。

- **应用场景**:

- H.264 是当前最广泛使用的视频编码格式之一,广泛应用于视频流媒体、视频会议、蓝光光盘、数字电视广播以及各种视频压缩应用中。

### 总结

- **YUYV**:用于未压缩的视频流,适合对延迟和色彩准确性有高要求的实时视频应用。

- **MJPEG**:适合简单的视频捕获和存储应用,特别是在不可靠的传输环境下。

- **H.264**:用于需要高压缩效率和良好视频质量的应用,特别是视频流媒体和高清电视广播。

这篇关于v4l2(video4linux2) yuyv(yuv422)、MJPEG、H.264的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!