本文主要是介绍[CVPR论文介绍] BASNet:边缘感知的显著性物体检测,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

点击上方“AI公园”,关注公众号,选择加“星标“或“置顶”

作者:Jae Duk Seo

编译:ronghuaiyang

导读

和昨天的那篇U²Net同作者,但是更早一点。

大多数深度学习方法→在显著性预测时侧重于区域预测→但现在他们创建了一个新的损失函数→也考虑了目标的边界。

显著性预测→我们人类擅长于此→关注给定的图像或视频中的“重要”目标。(但没有很多方法考虑目标的边界)。现在有很多深度学习模型结合了不同的表示方式。

就像U-net方法一样,→内部特征也可以直接使用。

看起来他们的想法是对的 —— 他们的方法确实比其他SOTA方法更好。(大部分方法使用FCN→全卷积网络→有些实际上使用RNN网络进行迭代预测)。

解决这个问题有许多方法,但不知道哪一种是最好的。

这是一个非常有趣的选择。(第一个网络比第二个网络大得多→池化层没有真正使用)。

拼接→内部特性映射→更好的预测。

他们还手工创建了一个细化模块 —— 这类创新并不容易实现。此外,还调整了损失函数,成功地训练了整个网络。

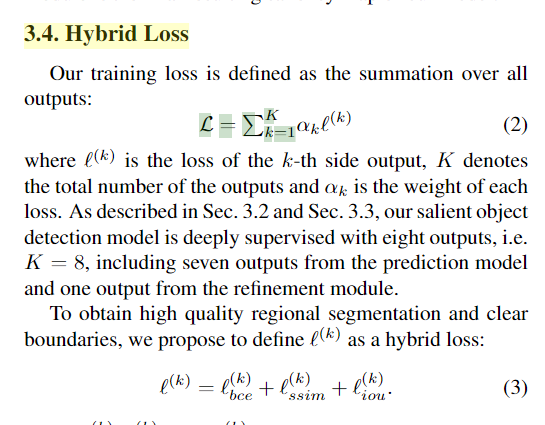

边界损失项被添加到二元交叉熵中 —— SSIM也包括在内——这是相当大的。我还不知道这个度量是可微的。IoU 损失也被使用了→许多不同的损失被合并起来→这是我看到越来越多的趋势之一。

这些损失的组合 → 导致更平滑的预测。

损失越多越好?看来他们的情况就是这样:

—END—

英文原文:https://medium.com/@SeoJaeDuk/cvpr-basnet-boundary-aware-salient-object-detection-a025c7f7d94f

请长按或扫描二维码关注本公众号

喜欢的话,请给我个在看吧!

这篇关于[CVPR论文介绍] BASNet:边缘感知的显著性物体检测的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!