本文主要是介绍洋人道歉,「国产」出品,全球最强端侧多模态大模型!(懒人包),希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

最近,在AI圈发生了一件大事,那就是斯坦福AI团队因抄袭清华系开源大模型而引起了国际社交平台上的巨大争议。事件的核心围绕一款名为“Llama3-V”的斯坦福团队开发的多模态大模型,该模型一经发布,便以其低成本高效率的特性,在开源社区迅速走红。

然而,随着更多细节的披露,人们发现Llama3-V在架构和代码层面与清华系合作的面壁智能团队开发的MiniCPM-Llama3-V 2.5(外号“面壁小钢炮”)惊人相似。

面壁智能的首席科学家刘知远教授在知乎上发表言论,直指Llama3-V实质上是对他们的MiniCPM-Llama3-V 2.5的一个简单“套壳”。在舆论的压力和事实的推动下,Llama3-V的作者团队不得不删除了相关评论,并最终发表公开道歉,承认了其行为,并将Llama3-V从各大平台撤下。以下是美国斯坦福大学AI团队涉事作者道歉内容截图:

想不到啊,大清亡了100多年了,洋人也会因为抄袭咱们「国产」技术而脸红道歉了!

这场风波虽然以和解告终,但它让MiniCPM-Llama3-V 2.5这款模型的能力和潜力再次受到关注。接下来,我们不妨详细了解一下这款备受瞩目的大模型。

MiniCPM-Llama3-V 2.5强在哪?

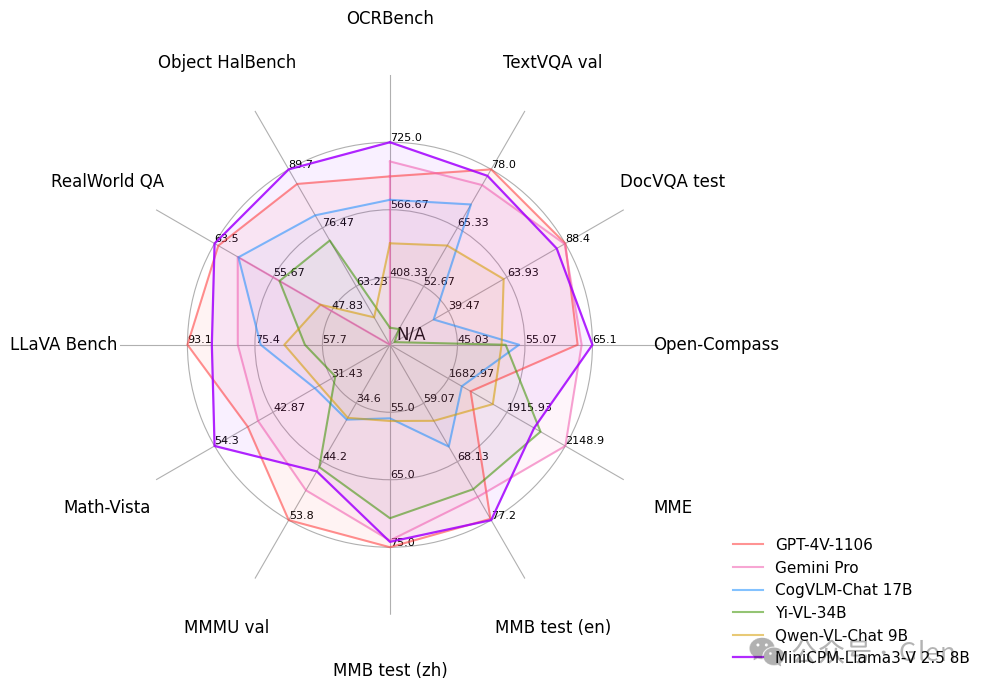

MiniCPM-Llama3-V 2.5是面壁智能最新推出的端侧多模态开源模型,尽管只有8B参数,但其性能甚至已全面超越了OpenAI的GPT-4V和谷歌的Gemini Pro。特别值得一提的是,该模型在OCR长难图识别上刷新了SOTA记录,图像编码速度更是提高了惊人的150倍,这在全球端侧多模态大模型中是绝无仅有的。

图注:模型雷达图,MiniCPM-Llama3-V 2.5 综合能力水平全面优秀

那么,MiniCPM-Llama3-V 2.5到底有哪些突破性的优势呢?

1. 多模态能力显著提升:在多模态能力方面,它不仅处理速度快,而且能力全面,能够在多种语言环境下展现出色的表现。

2. OCR技术突破:MiniCPM-Llama3-V 2.5在复杂图像和文本的识别与理解上有着出色的表现,无论是长图、难图还是长文本,都能精准识别,解码效率大大提高。

3. 端侧性能优化:首次整合了NPU和CPU加速框架,显著提升了在移动设备上的运行效率,使得模型不仅能在高端设备上流畅运行,在普通的消费电子产品上同样表现出色。

4. 多语种支持:支持30多种语言,不仅涵盖了中英双语,还包括了法语、德语、西班牙语等多种主流语言,这使得MiniCPM-Llama3-V 2.5可以服务于全球化的用户需求。

免费离线懒人包来了

为了让大家能够更方便地体验这一神奇的技术,(无所谓,我会出手.jpg

):

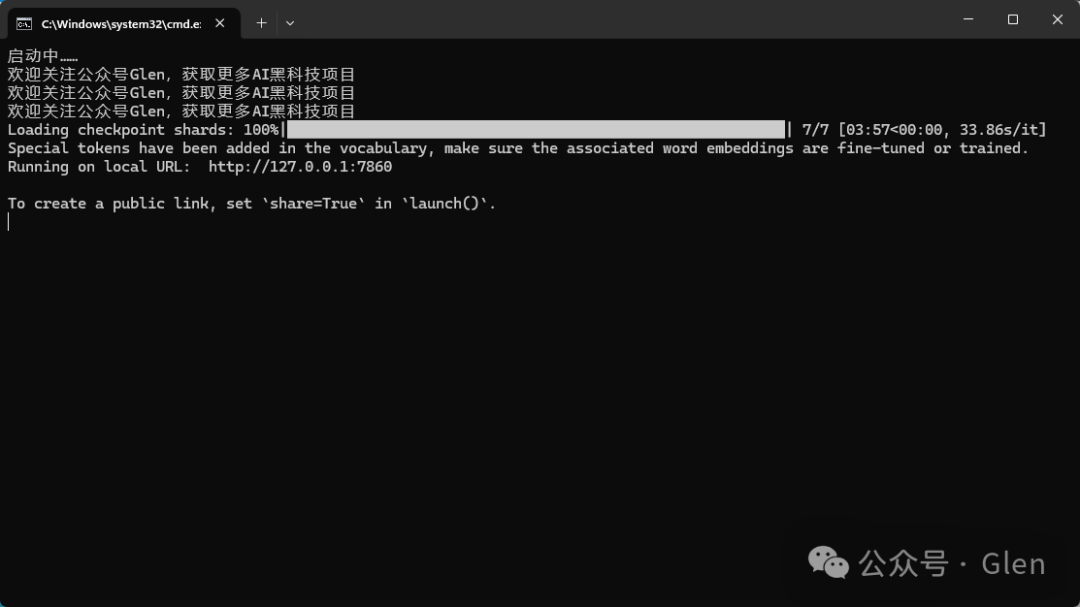

我特地为大家准备了一个离线整合包。这个懒人包操作非常简单,下载到本地后解压并双击“一键启动”。

系统会自动运行并打开一个简单的用户界面。

使用步骤也非常简单:

1. 输入图片:即上传你想要询问的图片内容;

2. 输入提示词:输入你想要问的问题;

2. 点击提交按钮

我提交了以下图片:

我提出的问题是:图片中有什么?

下图是大模型的回答,不仅支持中文回复,而且反应还很迅速,等于在本地就拥有了一个比GPT-4V还要强的多模态大模型AI助手了,感兴趣的朋友,千万不要错过哦~

MiniCPM-Llama3-V 2.5不仅技术领先,更是在全球AI大模型竞争中展示了中国团队的强大实力。它的成功,不仅是技术的胜利,也是中国AI在全球舞台上的一次重要展示。对于希望在AI领域探索更多可能性的科技爱好者和专业人士而言,MiniCPM-Llama3-V 2.5无疑提供了一个极具吸引力的新选项。

注意事项

①因为制作的是int4量化版本,所以拥有8GB显存的英伟达显卡,即可获得最佳体验。

②确保安装路径不包含中文字符,以避免可能的兼容问题。

今天就聊到这了,我是Glen,感谢你看我的内容,欢迎大家继续支持我,请点赞、收藏、分享三连走一波吧~

关注wx公众号Glen,私信回复【面壁小钢炮】,免费获得本文资源~

这篇关于洋人道歉,「国产」出品,全球最强端侧多模态大模型!(懒人包)的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!