本文主要是介绍SVM(二)从拉格朗日对偶问题到SVM,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

2.1 拉格朗日对偶(Lagrange duality)

先抛开上面的二次规划问题,先来看看存在等式约束的极值问题求法,比如下面的最优化问题:

![clip_image001[9] clip_image001[9]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131234477453.png)

目标函数是f(w),下面是等式约束。通常解法是引入拉格朗日算子,这里使用![]() 来表示算子,得到拉格朗日公式为

来表示算子,得到拉格朗日公式为

![clip_image004[6] clip_image004[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131234483700.png)

L是等式约束的个数。

然后分别对w和![]() 求偏导,使得偏导数等于0,然后解出w和

求偏导,使得偏导数等于0,然后解出w和![]() 。至于为什么引入拉格朗日算子可以求出极值,原因是f(w)的dw变化方向受其他不等式的约束,dw的变化方向与f(w)的梯度垂直时才能获得极值,而且在极值处,f(w)的梯度与其他等式梯度的线性组合平行,因此他们之间存在线性关系。(参考《最优化与KKT条件》)

。至于为什么引入拉格朗日算子可以求出极值,原因是f(w)的dw变化方向受其他不等式的约束,dw的变化方向与f(w)的梯度垂直时才能获得极值,而且在极值处,f(w)的梯度与其他等式梯度的线性组合平行,因此他们之间存在线性关系。(参考《最优化与KKT条件》)

然后我们探讨有不等式约束的极值问题求法,问题如下:

![clip_image007[6] clip_image007[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131234511451.png)

我们定义一般化的拉格朗日公式

![clip_image008[6] clip_image008[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131234524417.png)

这里的![]() 和

和![]() 都是拉格朗日算子。如果按这个公式求解,会出现问题,因为我们求解的是最小值,而这里的

都是拉格朗日算子。如果按这个公式求解,会出现问题,因为我们求解的是最小值,而这里的![]() 已经不是0了,若将

已经不是0了,若将![]() 调整成很大的正值,最后的函数结果是负无穷。因此我们需要排除这种情况,我们定义下面的函数:

调整成很大的正值,最后的函数结果是负无穷。因此我们需要排除这种情况,我们定义下面的函数:

![]()

这里的P代表primal。假设![]() 或者

或者![]() ,那么我们总是可以调整

,那么我们总是可以调整![]() 和

和![]() 来使得

来使得![]() 有最大值为正无穷。而只有g和h满足约束时,

有最大值为正无穷。而只有g和h满足约束时,![]() 为f(w)。这个函数的精妙之处在于

为f(w)。这个函数的精妙之处在于![]() ,而且求极大值。(只有ai=0,g(w)<0或者ai>0,g(w)=0值才会最大)

,而且求极大值。(只有ai=0,g(w)<0或者ai>0,g(w)=0值才会最大)

因此我们可以写作

![]()

这样我们原来要求的min f(w)可以转换成求![]() 了。

了。

![]()

我们使用![]() 来表示

来表示![]() 。如果直接求解,首先面对的是两个参数,而

。如果直接求解,首先面对的是两个参数,而![]() 也是不等式约束,然后再在w上求最小值。这个过程不容易做,那么怎么办呢?

也是不等式约束,然后再在w上求最小值。这个过程不容易做,那么怎么办呢?

我们先考虑另外一个问题![]()

D的意思是对偶,![]() 将问题转化为先求拉格朗日关于w的最小值,将

将问题转化为先求拉格朗日关于w的最小值,将![]() 和

和![]() 看作是固定值。之后在求

看作是固定值。之后在求![]() 最大值的话:

最大值的话:

![]()

这个问题是原问题的对偶问题,相对于原问题只是更换了min和max的顺序,而一般更换顺序的结果是Max Min(X) <= MinMax(X)。然而在这里两者相等。用![]() 来表示对偶问题如下:

来表示对偶问题如下:

![]()

下面解释在什么条件下两者会等价。假设f和g都是凸函数,h是仿射的(affine,![]() )。并且存在w使得对于所有的i,

)。并且存在w使得对于所有的i,![]() 。在这种假设下,一定存在

。在这种假设下,一定存在![]() 使得

使得![]() 是原问题的解,

是原问题的解,![]() 是对偶问题的解。还有

是对偶问题的解。还有![]() 另外,

另外,![]() 满足库恩-塔克条件(Karush-Kuhn-Tucker, KKT condition),该条件如下:

满足库恩-塔克条件(Karush-Kuhn-Tucker, KKT condition),该条件如下:

![clip_image048[6] clip_image048[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235189201.png)

所以如果![]() 满足了库恩-塔克条件,那么他们就是原问题和对偶问题的解。让我们再次审视公式(5),这个条件称作是KKT dual complementarity条件。这个条件隐含了如果

满足了库恩-塔克条件,那么他们就是原问题和对偶问题的解。让我们再次审视公式(5),这个条件称作是KKT dual complementarity条件。这个条件隐含了如果![]() ,那么

,那么![]() 。也就是说,

。也就是说,![]() 时,w处于可行域的边界上,这时才是起作用的约束。而其他位于可行域内部(

时,w处于可行域的边界上,这时才是起作用的约束。而其他位于可行域内部(![]() 的)点都是不起作用的约束,其

的)点都是不起作用的约束,其![]() 。这个KKT双重补足条件会用来解释支持向量和SMO的收敛测试。

。这个KKT双重补足条件会用来解释支持向量和SMO的收敛测试。

这部分内容思路比较凌乱,还需要先研究下《非线性规划》中的约束极值问题,再回头看看。KKT的总体思想是将极值会在可行域边界上取得,也就是不等式为0或等式约束里取得,而最优下降方向一般是这些等式的线性组合,其中每个元素要么是不等式为0的约束,要么是等式约束。对于在可行域边界内的点,对最优解不起作用,因此前面的系数为0。

2.2 线性可分

重新回到SVM的优化问题:

![clip_image057[6] clip_image057[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235229818.png)

我们将约束条件改写为:

![]()

从KKT条件得知只有函数间隔是1(离超平面最近的点),对于在线上的点(![]() ),前面的系数

),前面的系数![]() ,对于其他的不在线上的点(

,对于其他的不在线上的点(![]() ),极值不会在他们所在的范围内取得,因此前面的系数

),极值不会在他们所在的范围内取得,因此前面的系数![]() ,注意每一个约束式实际对应一个训练样本。

,注意每一个约束式实际对应一个训练样本。

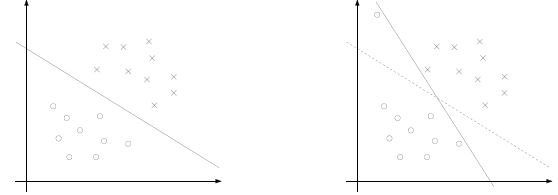

看下面的图:

![clip_image067[6] clip_image067[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235267786.png)

实线是最大间隔超平面,假设×号的是正例,圆圈的是负例。在虚线上的点就是函数间隔是1的点,那么他们前面的系数![]() ,其他点都是

,其他点都是![]() 。这三个点称作支持向量。构造拉格朗日函数如下:

。这三个点称作支持向量。构造拉格朗日函数如下:

![clip_image068[6] clip_image068[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235281633.png)

注意到这里只有![]() 没有

没有![]() 是因为原问题中没有等式约束,只有不等式约束。

是因为原问题中没有等式约束,只有不等式约束。

下面我们按照对偶问题的求解步骤来一步步进行,

![]()

首先求解![]() 的最小值,对于固定的

的最小值,对于固定的![]() ,

,![]() 的最小值只与w和b有关。对w和b分别求偏导数。

的最小值只与w和b有关。对w和b分别求偏导数。

![clip_image071[6] clip_image071[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235339186.png)

![clip_image072[6] clip_image072[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235346088.png)

并得到

![clip_image073[6] clip_image073[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235346579.png)

将上式带回到拉格朗日函数中得到,此时得到的是该函数的最小值(目标函数是凸函数)

代入后,化简过程如下:

最后得到

![clip_image074[6] clip_image074[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235354876.png)

由于最后一项是0,因此简化为

![clip_image075[6] clip_image075[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235352302.png)

这里我们将向量内积![]() 表示为

表示为![]()

此时的拉格朗日函数只包含了变量![]() 。然而我们求出了

。然而我们求出了![]() 才能得到w和b。

才能得到w和b。

接着是极大化的过程![]() ,

,

![clip_image078[6] clip_image078[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235401316.png)

前面提到过对偶问题和原问题满足的几个条件,首先由于目标函数和线性约束都是凸函数,而且这里不存在等式约束h。存在w使得对于所有的i,![]() 。因此,一定存在

。因此,一定存在![]() 使得

使得![]() 是原问题的解,

是原问题的解,![]() 是对偶问题的解。在这里,求

是对偶问题的解。在这里,求![]() 就是求

就是求![]() 了。

了。

如果求出了![]() ,根据

,根据![clip_image083[6] clip_image083[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235463131.jpg) 即可求出w(也是

即可求出w(也是![]() ,原问题的解)。然后

,原问题的解)。然后

![]()

即可求出b。即离超平面最近的正的函数间隔要等于离超平面最近的负的函数间隔。

关于上面的对偶问题如何求解,将在SMO算法一章中来阐明。

这里考虑另外一个问题,由于前面求解中得到

![clip_image086[6] clip_image086[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/20110313123548981.png)

我们通篇考虑问题的出发点是![]() ,根据求解得到的

,根据求解得到的![]() ,我们代入前式得到

,我们代入前式得到

![clip_image089[6] clip_image089[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103131235502419.png)

也就是说,以前新来的要分类的样本首先根据w和b做一次线性运算,然后看求的结果是大于0还是小于0,来判断正例还是负例。现在有了![]() ,我们不需要求出w,只需将新来的样本和训练数据中的所有样本做内积和即可。那有人会说,与前面所有的样本都做运算是不是太耗时了?其实不然,我们从KKT条件中得到,只有支持向量的

,我们不需要求出w,只需将新来的样本和训练数据中的所有样本做内积和即可。那有人会说,与前面所有的样本都做运算是不是太耗时了?其实不然,我们从KKT条件中得到,只有支持向量的![]() ,其他情况

,其他情况![]() 。因此,我们只需求新来的样本和支持向量的内积,然后运算即可。

。因此,我们只需求新来的样本和支持向量的内积,然后运算即可。

2.3 线性不可分

我们之前讨论的情况都是建立在样例线性可分的假设上,当样例线性不可分时,我们可以尝试使用核函数来将特征映射到高维,这样很可能就可分了。然而,映射后我们也不能100%保证可分。那怎么办呢,我们需要将模型进行调整,以保证在不可分的情况下,也能够尽可能地找出分隔超平面。

看下面两张图:

可以看到一个离群点(可能是噪声)可以造成超平面的移动,间隔缩小,可见以前的模型对噪声非常敏感。再有甚者,如果离群点在另外一个类中,那么这时候就是线性不可分了。

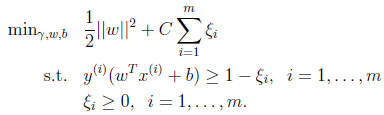

这时候我们应该允许一些点游离并在在模型中违背限制条件(函数间隔小于1)。我们设计得到新的模型如下(也称软间隔):

引入非负参数![]() 后(称为松弛变量),就允许(1)某些样本点的函数间隔小于1,即在最大间隔区间里面,(2)函数间隔是负数,即样本点在对方的区域中。而放松限制条件后,我们需要重新调整目标函数,以对离群点进行处罚,目标函数后面加上的

后(称为松弛变量),就允许(1)某些样本点的函数间隔小于1,即在最大间隔区间里面,(2)函数间隔是负数,即样本点在对方的区域中。而放松限制条件后,我们需要重新调整目标函数,以对离群点进行处罚,目标函数后面加上的![]() 就表示离群点越多,目标函数值越大,而我们要求的是尽可能小的目标函数值。这里的C是离群点的权重,C越大表明离群点对目标函数影响越大,也就是越不希望看到离群点。我们看到,目标函数控制了离群点的数目和程度,使大部分样本点仍然遵守限制条件。

就表示离群点越多,目标函数值越大,而我们要求的是尽可能小的目标函数值。这里的C是离群点的权重,C越大表明离群点对目标函数影响越大,也就是越不希望看到离群点。我们看到,目标函数控制了离群点的数目和程度,使大部分样本点仍然遵守限制条件。

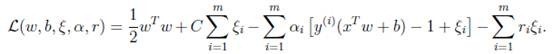

模型修改后,拉格朗日公式也要修改如下:

这里的![]() 和

和![]() 都是拉格朗日乘子,回想我们在拉格朗日对偶中提到的求法,先写出拉格朗日公式(如上),然后将其看作是变量w和b的函数,分别对其求偏导,得到w和b的表达式。然后代入公式中,求带入后公式的极大值。整个推导过程类似以前的模型,这里只写出最后结果如下:

都是拉格朗日乘子,回想我们在拉格朗日对偶中提到的求法,先写出拉格朗日公式(如上),然后将其看作是变量w和b的函数,分别对其求偏导,得到w和b的表达式。然后代入公式中,求带入后公式的极大值。整个推导过程类似以前的模型,这里只写出最后结果如下:

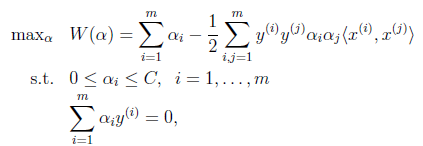

此时,我们发现没有了参数![]() ,与之前模型唯一不同在于

,与之前模型唯一不同在于![]() 又多了

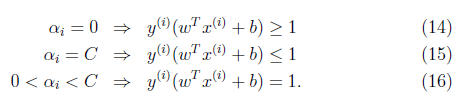

又多了![]() 的限制条件。需要提醒的是,b的求值公式也发生了改变,改变结果在SMO算法里面介绍。先看看KKT条件的变化:

的限制条件。需要提醒的是,b的求值公式也发生了改变,改变结果在SMO算法里面介绍。先看看KKT条件的变化:

上面式子分别表明在两条间隔线外的样本点前面的系数为0,离群样本点前面的系数为C,而支持向量(也就是在超平面两边的最大间隔线上)的样本点前面系数在(0,C)上。通过KKT条件可知,某些在最大间隔线上的样本点也不是支持向量,相反也可能是离群点。

这篇关于SVM(二)从拉格朗日对偶问题到SVM的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!