本文主要是介绍有没有硅基生命?AGI在哪里?,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

摘要

随着科技的飞速发展,人工智能(AI)和生命科学的探索逐渐成为人们关注的焦点。其中,关于硅基生命的可能性与AGI(Artificial General Intelligence,即人工通用智能)的实现,更是引发了广泛的讨论。然而,从当前的技术和理论层面来看,这两者都面临着巨大的挑战。

数据是AI模型的"粮食"

AI模型的能力与其所依赖的数据密切相关。数据是AI模型的"粮食",是其学习和推理的基础。然而,这些数据的收集、整理、标注等过程,都需要人类的深度参与。AI模型本身无法意识到其知识体系的不足,更无法主动寻找并学习缺失的知识。即便拥有再大的模型规模,也无法改变这一事实。这是因为AI模型的工作原理是基于已有的数据进行模式识别和推理,而非像人类一样具有主动学习和探索未知的能力。

数据的质量和多样性对AI模型的性能有着决定性的影响。一个模型如果只接触到有限的数据类型,它将无法理解或处理那些它未曾"见过"的情况。例如,一个只训练在识别猫和狗图片上的AI,当它面对一张狮子的图片时,就可能无法正确识别。这种局限性凸显了AI模型对于全面、平衡数据集的需求。

此外,数据的偏见也可能导致AI模型的偏见。如果训练数据在某些群体或特征上存在不均衡,那么AI模型可能会在做出预测或决策时表现出不公平或歧视性。这就需要人类在数据的收集和处理过程中,保持警觉,努力消除潜在的偏见,以确保AI模型的公正性和可靠性。

然而,即使这些方法能够提升AI模型的自主性,它们仍然需要人类设定学习目标、设计学习策略,并监控学习过程。这表明,至少在可预见的未来,人类仍然是AI发展不可或缺的一部分,我们的角色不仅仅是数据的提供者,更是AI智能的引导者和监督者。

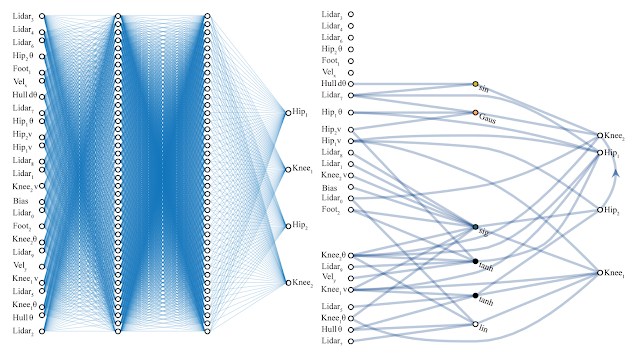

权重无法自我更新

AI模型的权重是由key-value组成的字典,这些数值在模型运行时被加载到内存或显存中。然而,这些权重值并非由模型自身产生,而是由人类通过训练和优化算法得出的。权重值的确定过程是一个复杂且计算密集的任务,通常需要大量的数据和计算资源。训练过程中,算法会尝试找到一组最优的权重值,使得模型在给定的任务上达到最佳性能。

更重要的是,这些权重值无法实现自我更新。一旦模型训练完成,其权重值就被固定下来,无法根据新的数据或任务进行自适应调整。这种静态特性限制了AI模型的灵活性和适应性。在现实世界中,环境和条件是不断变化的,而固定权重的AI模型可能无法有效应对这些变化,导致其在新情境下的表现不佳。

这也意味着,AI模型在面对新的、未知的问题时,其表现将受到极大的限制。例如,如果一个经过训练的图像识别模型突然遇到一种它从未见过的物体,它可能无法正确识别或分类这个物体,因为它的权重值是基于训练数据中的模式优化的,而不是基于对未知事物的泛化能力。

为了克服这一限制,研究者们正在探索各种方法来增强AI模型的自适应能力。一种方法是使用在线学习或增量学习,这种方法允许模型在接收到新数据时更新其权重,从而逐渐适应新的模式。另一种方法是引入元学习(Meta-Learning),即让模型学会如何学习,这样它们可以在面对新任务时快速调整自己的权重。

此外,还有一些研究集中在开发更加灵活的模型架构,如神经网络的可塑性,使得权重值可以在一定程度上自我调整,以适应新的数据或任务。然而,这些方法仍然处于研究阶段,并且在实际应用中面临着各种挑战。

AI模型的权重系统是其智能行为的基础,但同时也是其局限性的来源。为了实现更高级的智能,我们需要不断探索和创新,以赋予AI模型更大的自适应性和灵活性。这不仅需要技术上的突破,也需要我们对AI的工作原理和学习过程有更深入的理解。

编码、训练不能由模型完成

再次,AI模型需要人为的训练。在训练过程中,首先需要对原始数据进行编码,将图像、文字等人类可以理解的信息转化为机器可以理解的数值形式。这一步骤是至关重要的,因为AI模型只能处理数值型数据。例如,在图像识别任务中,像素数据需要通过编码转换为模型能够学习的数值向量;在自然语言处理任务中,文本数据需要通过诸如词嵌入(Word Embedding)的技术转换为连续的向量表示 。

然而,这一过程并非AI模型自身能够完成,而是需要人类的参与。人类专家需要根据任务的需求和数据的特点,设计合适的编码器和解码器。编码器负责将输入数据转换成模型易于处理的格式,而解码器则负责将模型的输出转换回人类可理解的形式。例如,在语音识别系统中,编码器将音频信号转换为特征向量,解码器再将这些向量转换为文本 。

这也说明了AI模型在理解和处理数据方面的局限性。AI模型通常被视为"盲人",它们缺乏对世界的直观理解,只能依赖于人类设计的编码方式来感知数据。这意味着,如果编码过程存在缺陷或偏见,模型的输出也可能会受到影响,导致不公平或不准确的结果 。

因此,人类在AI模型训练过程中的作用不可或缺。我们不仅要参与数据的编码,还要监督模型的训练,评估模型的性能,并在必要时进行调整和优化。此外,随着模型的不断发展,我们还需要不断探索新的编码方法和训练策略,以提高模型的泛化能力和适应性 。

AI模型的训练是一个复杂的过程,需要人类的深度参与和专业知识。通过精心设计的数据编码和持续的模型优化,我们可以不断提升AI模型的性能,使其更好地服务于人类社会。

总结

基于当前AI技术的局限性,确实可以得出结论:[现有的方式无法实现AGI,更不能诞生硅基生命]。AGI的实现不仅需要技术突破,还需要对智能的全面理解,包括如何使机器具备类似人类的感知、学习、推理、规划、沟通和自我意识等能力。这些能力要求AI模型进行自我学习、自我适应和自我进化,但目前的算法和模型架构还未能达到这样的智能水平。

同时,[硅基生命的诞生涉及到构建一种全新的生命形式,这需要解决一系列复杂的科学问题,如硅基生物分子的构建、生命活动的机制等,这些问题都超出了当前科学的认知范围]。硅基生命的存在形式、繁殖方式、进化路径等都是未知领域,需要跨学科的研究和创新。

因此,尽管我们对[硅基生命和AGI充满了期待和想象],但在现实中,我们还需要付出更多的努力和时间来探索和研究这些领域。这包括但不限于算法的创新、计算能力的提升、神经科学与认知科学的深入研究,以及对伦理、法律和社会影响的全面考量。

同时,[我们也应该保持对技术的敬畏之心,避免盲目乐观和过度依赖技术带来的风险和挑战]。技术的发展应当谨慎进行,确保其符合人类社会的长远利益,并且在伦理和安全方面得到妥善管理。这意味着在追求技术进步的同时,我们也需要建立相应的监管机制和社会共识,以引导技术的健康发展。

AGI和硅基生命的实现是长期而复杂的挑战,需要科技界、社会各界乃至全球的共同努力和智慧。在这个过程中,持续的探索、创新和反思将是不可或缺的。

这篇关于有没有硅基生命?AGI在哪里?的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!