本文主要是介绍【AI大模型】Transformers大模型库(二):AutoModelForCausalLM,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

目录

一、引言

二、AutoModelForCausalLM

2.1 概述

2.2 主要功能

2.3 代码示例

三、总结

一、引言

这里的Transformers指的是huggingface开发的大模型库,为huggingface上数以万计的预训练大模型提供预测、训练等服务。

🤗 Transformers 提供了数以千计的预训练模型,支持 100 多种语言的文本分类、信息抽取、问答、摘要、翻译、文本生成。它的宗旨是让最先进的 NLP 技术人人易用。

🤗 Transformers 提供了便于快速下载和使用的API,让你可以把预训练模型用在给定文本、在你的数据集上微调然后通过 model hub 与社区共享。同时,每个定义的 Python 模块均完全独立,方便修改和快速研究实验。

🤗 Transformers 支持三个最热门的深度学习库: Jax, PyTorch 以及 TensorFlow — 并与之无缝整合。你可以直接使用一个框架训练你的模型然后用另一个加载和推理。

本文重点介绍AutoModelForCausalLM类。

二、AutoModelForCausalLM

2.1 概述

`AutoModelForCausalLM`是Hugging Face的`transformers`库中的一个类,它是一个自动模型类,用于因果语言建模(Causal Language Modeling)。因果语言建模是指模型预测文本序列中下一个词或字符,给定之前的词或字符序列的任务。这种模型广泛应用于生成式任务,如对话系统、文本续写、摘要生成等。

2.2 主要功能

这个类是基于`AutoModel`的,它能够根据指定的模型名称或路径自动加载相应的模型架构。当你使用`AutoModelForCausalLM`时,不需要直接指定模型的所有细节,只需要提供模型的名称(如`"gpt2"`、`"t5"`等,尽管T5模型更常用于序列到序列任务),库会自动配置为适合因果语言建模的版本。

2.3 代码示例

例如,加载一个预训练的GPT-2模型用于因果语言建模,代码如下:

from transformers import AutoModelForCausalLM, AutoTokenizermodel_name = "gpt2"

tokenizer = AutoTokenizer.from_pretrained(model_name)

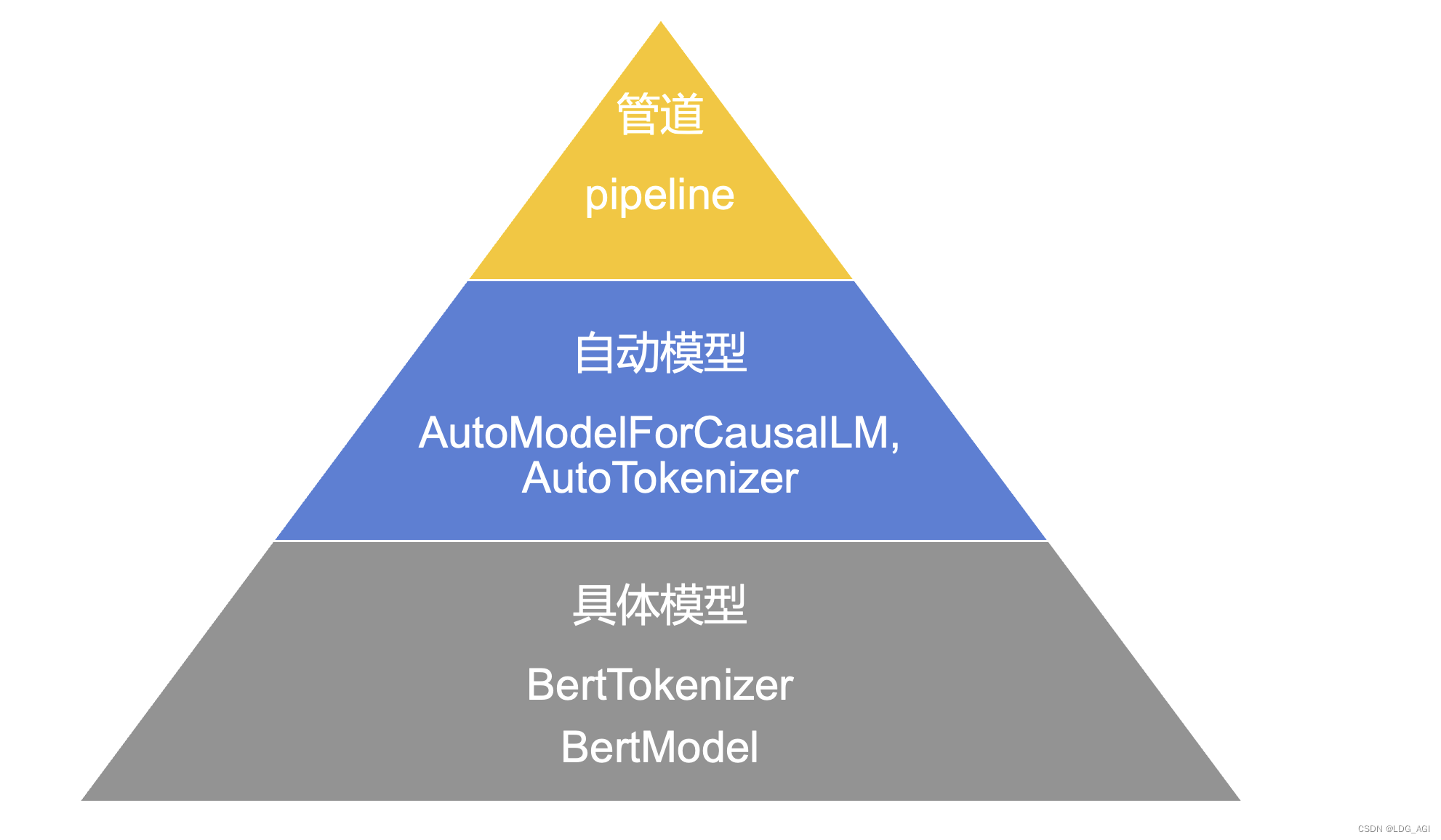

model = AutoModelForCausalLM.from_pretrained(model_name)# 使用模型进行预测的代码会在这里继续...这个例子使用AutoTokenize,AutoModelForCausalLM, r两个类分别实例化gpt2对应的分词器和模型。这里使用了Auto自动模型,transformers包括管道pipeline、自动模型auto以及具体模型三种模型实例化方法,如果同时有配套的分词工具(Tokenizer),需要使用同名调度。

- 管道(Pipline)方式:高度集成的使用方式,几行代码就可以实现一个NLP任务

- 自动模型(AutoModel)方式:自动载入并使用BERT等模型

- 具体模型方式:在使用时需要明确具体的模型,并按照特定参数进行调试

在上述三种应用方式中,管道方式使用最简单,但灵活度最差;具体模型方式使用复杂,但是灵活度最高。

三、总结

本文对使用transformers的AutoModelForCausalLM进行尝试,主要对CausalLM(因果推理模型)进行实例化,需要与同类的AutoTokenizer分词器一起使用。同时,列举了管道模型、自动模型、具体模型等三种transformers预训练大模型实例化方法。期待大家三连。

如果您还有时间,可以看看我的其他文章:

《AI—工程篇》

AI智能体研发之路-工程篇(一):Docker助力AI智能体开发提效

AI智能体研发之路-工程篇(二):Dify智能体开发平台一键部署

AI智能体研发之路-工程篇(三):大模型推理服务框架Ollama一键部署

AI智能体研发之路-工程篇(四):大模型推理服务框架Xinference一键部署

AI智能体研发之路-工程篇(五):大模型推理服务框架LocalAI一键部署

《AI-模型篇》

AI智能体研发之路-模型篇(一):大模型训练框架LLaMA-Factory在国内网络环境下的安装、部署及使用

AI智能体研发之路-模型篇(二):DeepSeek-V2-Chat 训练与推理实战

AI智能体研发之路-模型篇(三):中文大模型开、闭源之争

AI智能体研发之路-模型篇(四):一文入门pytorch开发

AI智能体研发之路-模型篇(五):pytorch vs tensorflow框架DNN网络结构源码级对比

AI智能体研发之路-模型篇(六):【机器学习】基于tensorflow实现你的第一个DNN网络

AI智能体研发之路-模型篇(七):【机器学习】基于YOLOv10实现你的第一个视觉AI大模型

AI智能体研发之路-模型篇(八):【机器学习】Qwen1.5-14B-Chat大模型训练与推理实战

这篇关于【AI大模型】Transformers大模型库(二):AutoModelForCausalLM的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!