本文主要是介绍如何调用demucs官方提供的模型实现音源分离,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

一 背景

背景介绍参考:代码复现|Demucs Music Source Separation_demucs架构原理-CSDN博客。

官方源码链接:GitHub - facebookresearch/demucs: Code for the paper Hybrid Spectrogram and Waveform Source Separation

二 实现

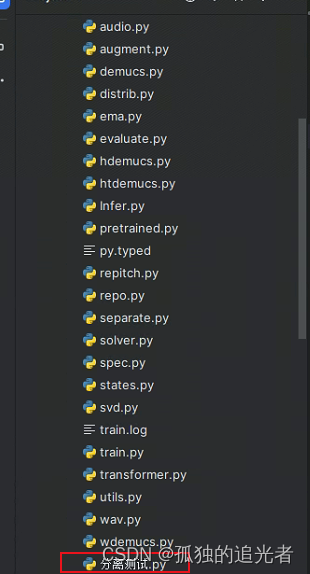

在demucs文件夹下面创建分离测试.py文件,复制以下代码即可运行(python -m demucs.分离测试)。以下代码默认调用htdemucs模型。

# -*- coding:utf-8 -*-

# @FileName :分离测试.py

# @Time :2024/6/02 15:37

# @Author :Tim

'''This code is referenced from the api.md document.

'''

import demucs.apifile_input = "D:\\xxx\\xxx\\xxx\\xxx\\陈百强 - 偏偏喜欢你.mp3" # 换成自己的待分离音频文件

music_name = file_input.split("\\")[-1].split(".")[0]

print(music_name)

# Initialize with default parameters:

separator = demucs.api.Separator()# Separating an audio file

origin, separated = separator.separate_audio_file(file_input)# If you encounter an error like CUDA out of memory, you can use this to change parameters like `segment`:

separator.update_parameter(segment=7.8)# 遍历separated字典中的每个项

for stem, source in separated.items():# 定义保存音频的文件名filename = f"{music_name}_{stem}.wav" # 您可以根据需要修改文件名格式# 使用torchaudio.save保存音频张量到文件demucs.api.save_audio(source, f'测试输出/{filename}', samplerate=separator.samplerate)print(f"Audio for {stem} saved as {filename}")最近开始写公众号,分享一些好用的AI工具。(大家可以关注一下,一起见证我的成长,公众号:桂圆学AI)。

这篇关于如何调用demucs官方提供的模型实现音源分离的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!