本文主要是介绍“揭秘:为什么羊驼Ollama成为计算机运行大型语言模型的最佳拍档?“,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

最近,AIM 评测了在计算机上本地运行大语言模型(LLM)的最佳工具,Ollama 脱颖而出,成为最高效的解决方案,提供了无与伦比的灵活性。Ollama 是 Jeffrey Morgan 开发的一款开源工具,它正在彻底改变爱好者在本地终端上运行大语言模型的方式。

Ollama 具有友好的用户界面,并与 LLaMA 2 和 Mistral 等流行模型兼容,希望安全、经济、高效地进行大语言模型实验的用户可以轻松考虑使用 Ollama。它能让用户利用先进人工智能模型的力量,而无需依赖云服务或昂贵的硬件。

AIM 通过在 Linux (Pop!_OS)、macOS 和 Windows 等多个操作系统上运行多个大语言模型对 Ollama 进行了测试,以便让读者全面了解这款实用工具。

Ollama:在本地快速运行大语言模型的工具

奥拉马运行猎鹰 2 号

奥拉马运行猎鹰 2 号

虽然它是在终端上本地运行大语言模型的最快解决方案,但如果你不习惯这样做,也可以使用图形用户界面,但它需要一些额外的步骤(大多数基本用户都希望避免这些步骤)。

Ollama 可以直接从其库中获取大量大语言模型,只需执行一条命令即可下载。下载完成后,只需执行一条命令即可开始使用。这对那些工作负荷主要围绕终端窗口的用户很有帮助。如果他们在某个地方卡住了,无需切换到另一个浏览器窗口就能得到答案。

在 Linux 上使用 Ollama 时,我们发现其开发人员采用了一种令人惊讶的方法。当你执行安装脚本时,它会自行处理所有 GPU 驱动程序,无需额外步骤。

另一方面,我们发现 macOS 的安装程序是三个平台中最精致的,因为它非常易于浏览和使用。当然,你最终必须切换到终端,但它带你进入终端的方式非常流畅。

不过,如果你想通过图形用户界面使用 Ollama,可以使用 Open Web UI。但它只能通过 Docker 容器安装,这对于不熟悉容器概念的用户来说可能会很麻烦。

AIM 指出,Ollama 唯一的缺点是没有提供官方文档,说明如何使用已经下载的大语言模型。

模型最重要

最肯定的是,使用像 Ollama 这样的最小实用工具在本地运行大语言模型,会让你比其他工具更有优势,但归根结底,你使用的是什么模型最重要。

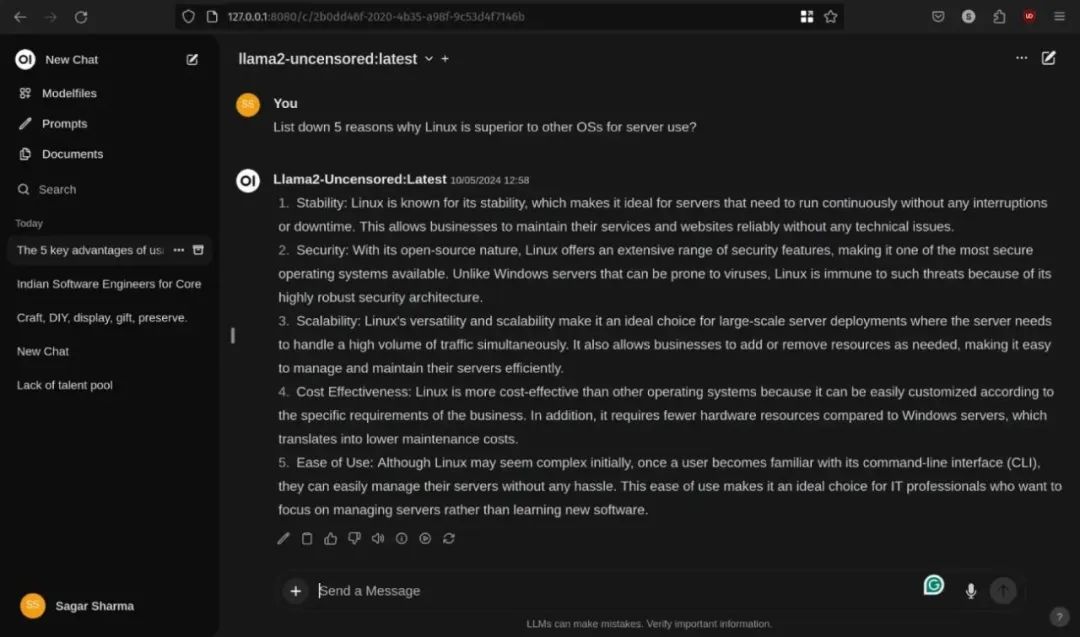

例如,我们在 Ollama 上并排使用了 Llama 2 和 Llama 3,结果让我们大吃一惊。

在 Ollama 中运行 llama2 和 llama3

在 Ollama 中运行 llama2 和 llama3

正如您所看到的,Llama 2 在几秒钟内就开始回答我们的问题,而 LLaMA 3 则花了很长时间,但却针对给定的标准给出了令人信服的详细答案。我们在多个实用工具上测试了 LLaMA 2,但 Llama + 终端给出的结果最快,因此我们得出结论:在终端中使用时,Ollama 的速度最快。

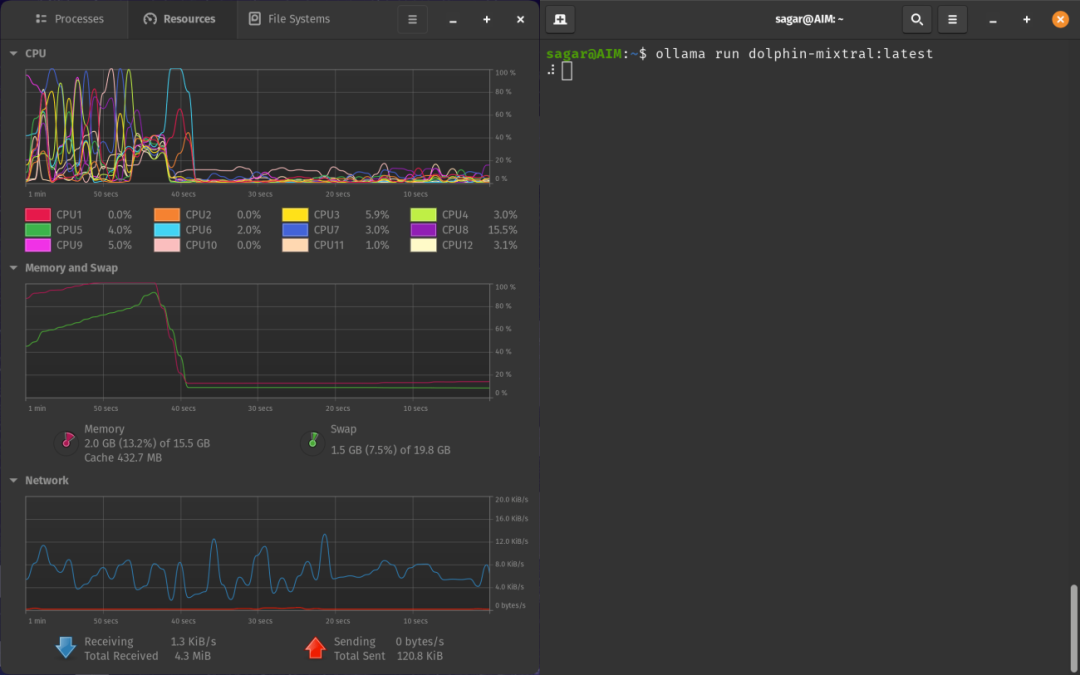

此外,如果你尝试加载一个超出你的规格所能承受的非常大的模型,就像其他工具一样,Ollama 将无法加载给定的模型。更可悲的是,它甚至不会通知你 Ollama 已经停止加载模型。

解决这个问题的唯一办法就是密切关注系统资源。当你看到资源消耗突然下降时,说明 Ollama 加载模型失败,你可以停止整个过程(否则会无休止地显示加载动画)。

总之,我们发现 Ollama 灵活而快速。它既能让你使用图形用户界面,又能在终端中快速响应,可谓一举两得。不过,如果你想使用一些简单的工具,我们很快就会向你介绍 Jan,这是一款能让你在本地运行大语言模型的工具,可以让你事半功倍。

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

这篇关于“揭秘:为什么羊驼Ollama成为计算机运行大型语言模型的最佳拍档?“的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!