本文主要是介绍Java整合ELK实现日志收集 之 Elasticsearch、Logstash、Kibana,希望对大家解决编程问题提供一定的参考价值,需要的开发者们随着小编来一起学习吧!

简介

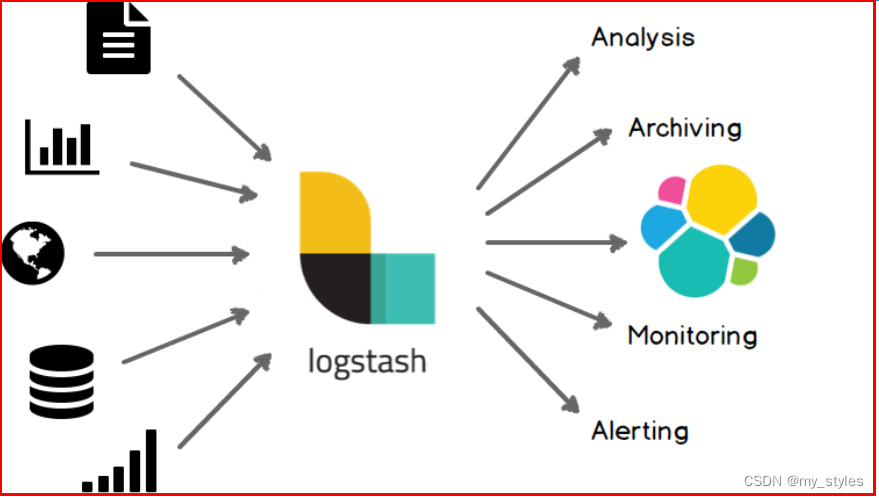

Logstash:用于收集并处理日志,将日志信息存储到Elasticsearch里面

Elasticsearch:用于存储收集到的日志信息

Kibana:通过Web端的可视化界面来查看日志(数据可视化)

Logstash 是免费且开放的服务器端数据处理管道,能够从多个来源采集数据,转换数据,然后将数据发送到您最喜欢的存储库中。

一、安装 Docker Compose 环境

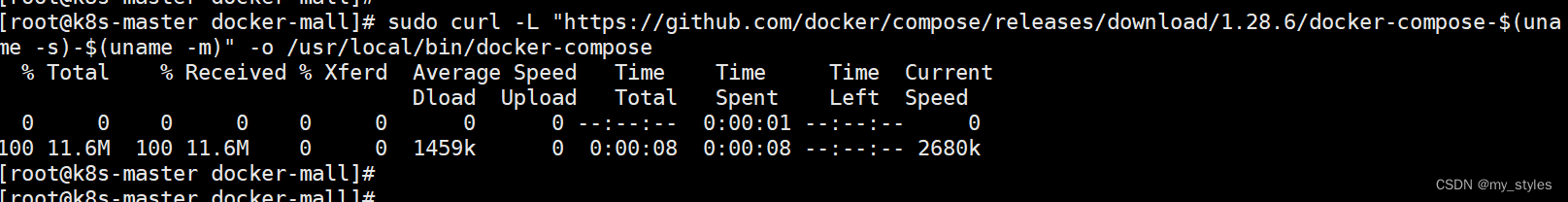

Docker Compose的安装

# docker compose安装步骤

sudo curl -L "https://github.com/docker/compose/releases/download/1.28.6/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-compose设置权限

sudo chmod +x /usr/local/bin/docker-compose

docker-compose --version

或者 (由于是国外ip可能会失败)上面如果下载失败,可以使用下边的命令(由于是国外ip)(多试几次)

sudo curl -L "https://github.com/docker/compose/releases/download/1.28.6/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-compose

sudo chmod +x /usr/local/bin/docker-compose

docker-compose --version

二 、下载镜像

docker pull elasticsearch:7.6.2

docker pull logstash:7.6.2

docker pull kibana:7.6.2

三、使用 Docker Compose 搭建 ELK 环境

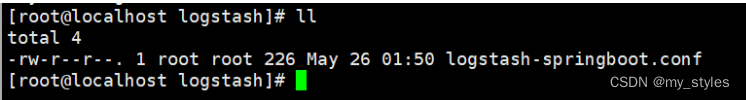

创建目录 /mydata/logstash

创建文件 logstash-springboot.conf

内容如下

input {tcp {mode => "server"host => "0.0.0.0"port => 4560codec => json_lines}

}

output {elasticsearch {hosts => "es:9200"index => "springboot-logstash-%{+YYYY.MM.dd}"}

}

将文件 logstash-springboot.conf 复制到 目录 /mydata/logstash下

创建目录/usr/local/elk

创建 docker-compose.yml 文件

内容如下

version: '3'

services:elasticsearch:image: elasticsearch:7.6.2container_name: elasticsearchuser: rootenvironment:- "cluster.name=elasticsearch" #设置集群名称为elasticsearch- "discovery.type=single-node" #以单一节点模式启动- "ES_JAVA_OPTS=-Xms512m -Xmx512m" #设置使用jvm内存大小volumes:- /mydata/elasticsearch/plugins:/usr/share/elasticsearch/plugins #插件文件挂载- /mydata/elasticsearch/data:/usr/share/elasticsearch/data #数据文件挂载ports:- 9200:9200- 9300:9300logstash:image: logstash:7.6.2container_name: logstashenvironment:- TZ=Asia/Shanghaivolumes:- /mydata/logstash/logstash-springboot.conf:/usr/share/logstash/pipeline/logstash.conf #挂载logstash的配置文件depends_on:- elasticsearch #kibana在elasticsearch启动之后再启动links:- elasticsearch:es #可以用es这个域名访问elasticsearch服务ports:- 4560:4560kibana:image: kibana:7.6.2container_name: kibanalinks:- elasticsearch:es #可以用es这个域名访问elasticsearch服务depends_on:- elasticsearch #kibana在elasticsearch启动之后再启动environment:- "elasticsearch.hosts=http://es:9200" #设置访问elasticsearch的地址ports:- 5601:5601

将文件 docker-compose.yml 复制到目录下 /usr/local/elk

设置 docker-compose.yml 配置路径文件夹的权限

/usr/share/elasticsearch/data

chmod 777 /mydata/elasticsearch/data/

启动

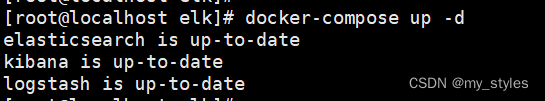

docker-compose up -d

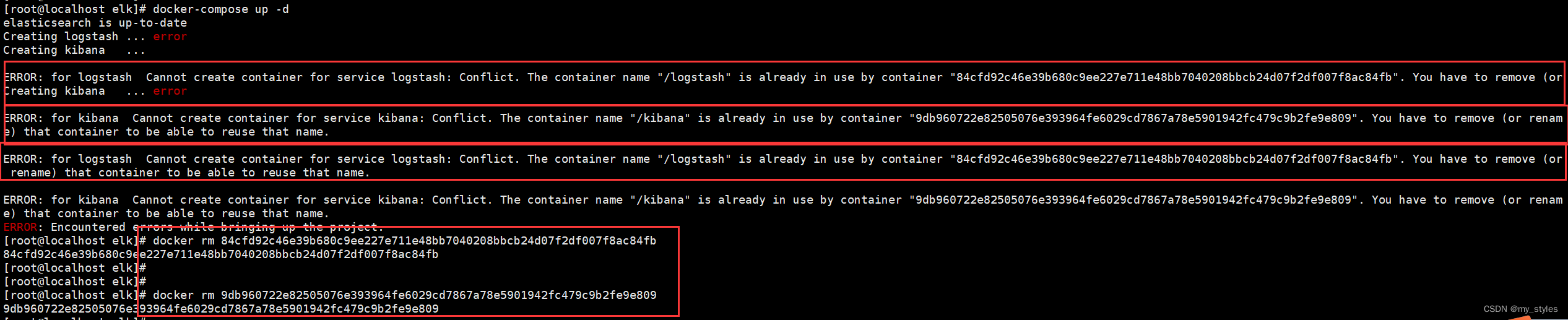

如果之前安装过 Elasticsearch、 logstash、Kibana 会提示已存在该容器

可以先删除 docker rm id

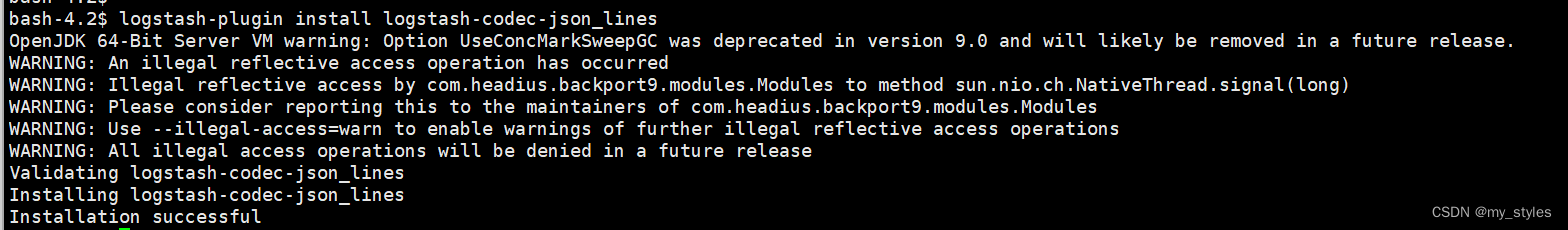

在 logstash 中安装 json_lines 插件

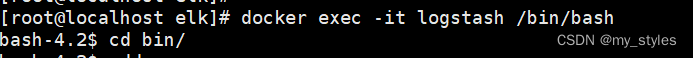

# 进入logstash容器

docker exec -it logstash /bin/bash

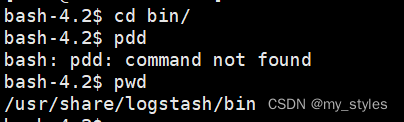

# 进入bin目录

cd /bin/

# 安装插件

logstash-plugin install logstash-codec-json_lines

# 退出容器

exit

# 重启logstash服务 稍微等下 有点慢

docker restart logstash

测试验证

访问 http://192.168.116.160:5601/ 查看是否启动成功

四、框架集成 Logstash

1、添加 logstash-logback-encoder 依赖

pom.xml 中添加:

<!--集成logstash-->

<dependency><groupId>net.logstash.logback</groupId><artifactId>logstash-logback-encoder</artifactId><version>5.3</version>

</dependency>

随便找个项目测试下

2、添加配置文件 logback-spring.xml 让 logback 的日志输出到 logstash

注意 appender 节点下的 destination 需要改成你自己的 logstash 服务地址,比如我的是:192.168.116.160:4560 。

<?xml version="1.0" encoding="UTF-8"?><!DOCTYPE configuration>

<configuration><include resource="org/springframework/boot/logging/logback/defaults.xml"/><include resource="org/springframework/boot/logging/logback/console-appender.xml"/><!--应用名称--><property name="APP_NAME" value="mall-admin"/><!--日志文件保存路径--><property name="LOG_FILE_PATH" value="${LOG_FILE:-${LOG_PATH:-${LOG_TEMP:-${java.io.tmpdir:-/tmp}}}/logs}"/><contextName>${APP_NAME}</contextName><!--每天记录日志到文件appender--><appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender"><rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy"><fileNamePattern>${LOG_FILE_PATH}/${APP_NAME}-%d{yyyy-MM-dd}.log</fileNamePattern><maxHistory>30</maxHistory></rollingPolicy><encoder><pattern>${FILE_LOG_PATTERN}</pattern></encoder></appender><!--输出到logstash的appender--><appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender"><!--可以访问的logstash日志收集端口--><destination>192.168.116.160:4560</destination><encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"/></appender><root><level>INFO</level><appender-ref ref="CONSOLE"/><appender-ref ref="FILE"/><appender-ref ref="LOGSTASH"/></root>

</configuration>

主要配置

<?xml version="1.0" encoding="UTF-8"?>

<configuration><!--输出到logstash的appender--><appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender"><!--可以访问的logstash日志收集端口--><destination>192.168.116.160:4560</destination><encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"/></appender><root><level>INFO</level><appender-ref ref="CONSOLE"/><appender-ref ref="FILE"/><appender-ref ref="LOGSTASH"/></root>

</configuration>3、进行测试

添加一个测试方法:

package com.ruoyi.web;import com.ruoyi.common.utils.http.HttpUtils;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;public class Test {private static final Logger log = LoggerFactory.getLogger(HttpUtils.class);public static void main(String[] args) {log.info("输出info");log.debug("输出debug");log.error("输出error");}}

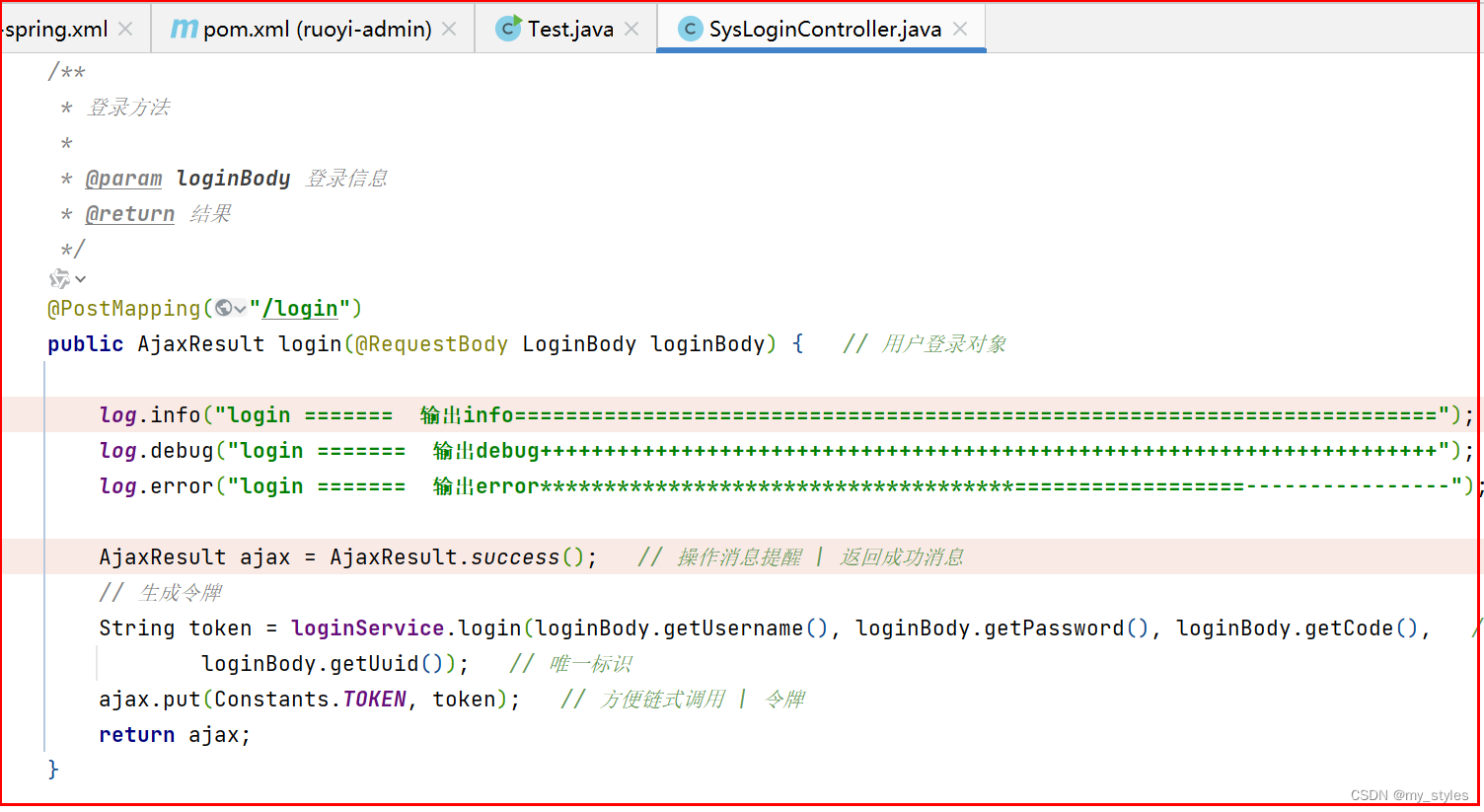

3.1 或者找个借口测试

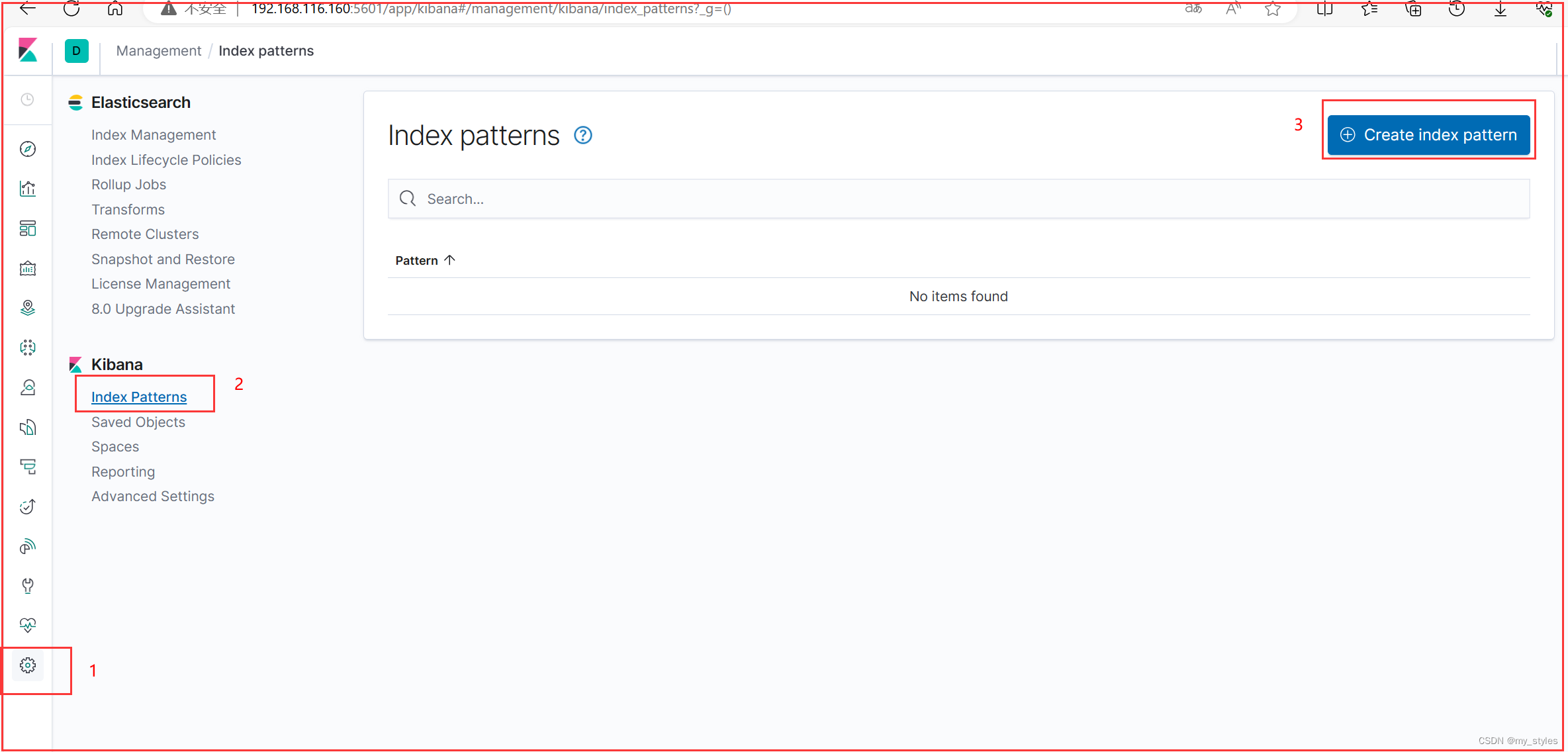

五、在 kibana 中查看日志信息

访问地址: http://192.168.116.160:5601/

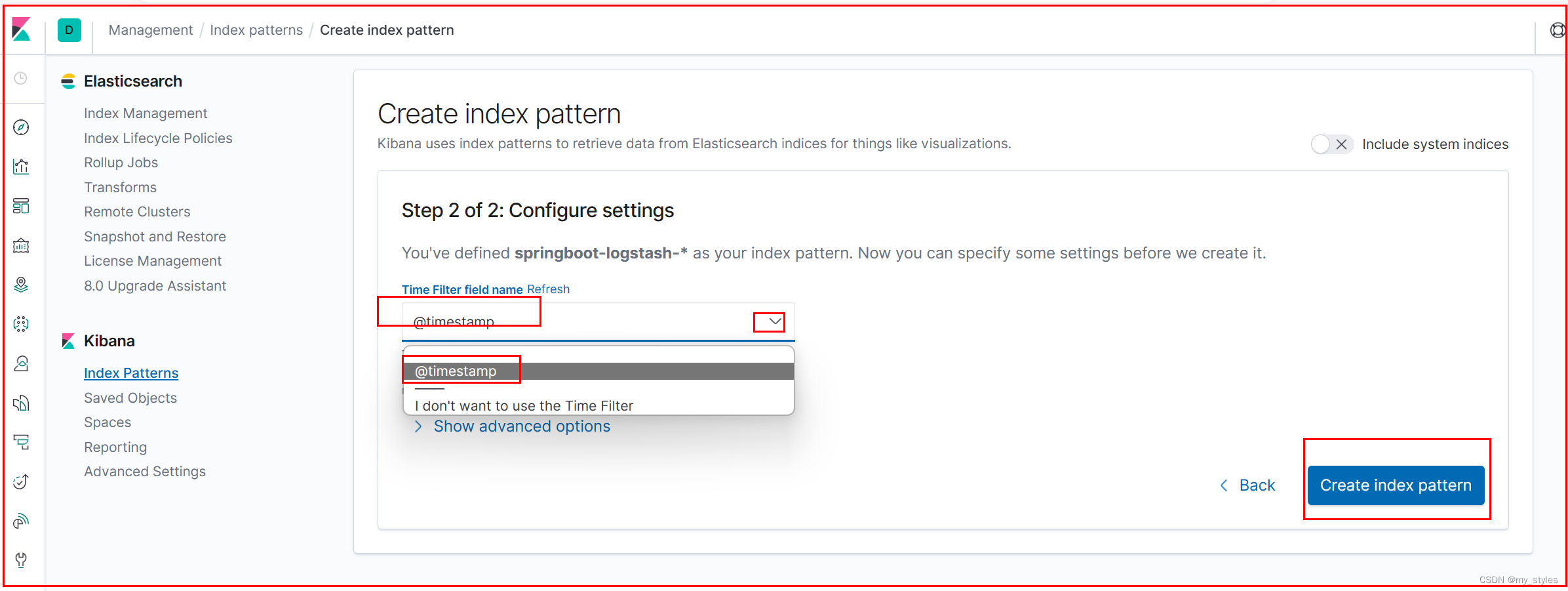

1、创建 index pattern

2.1、Create index pattern

2.2、创建成功

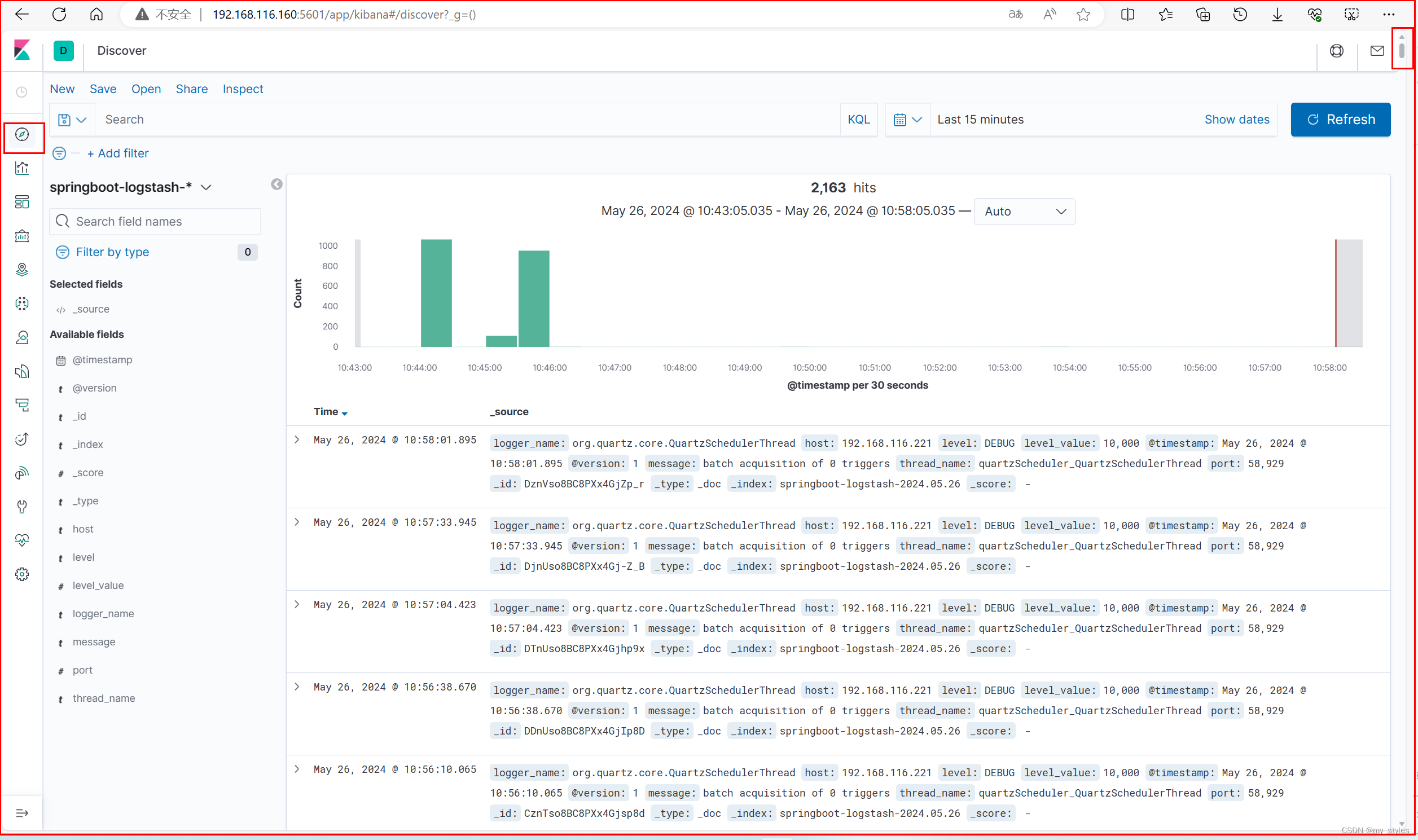

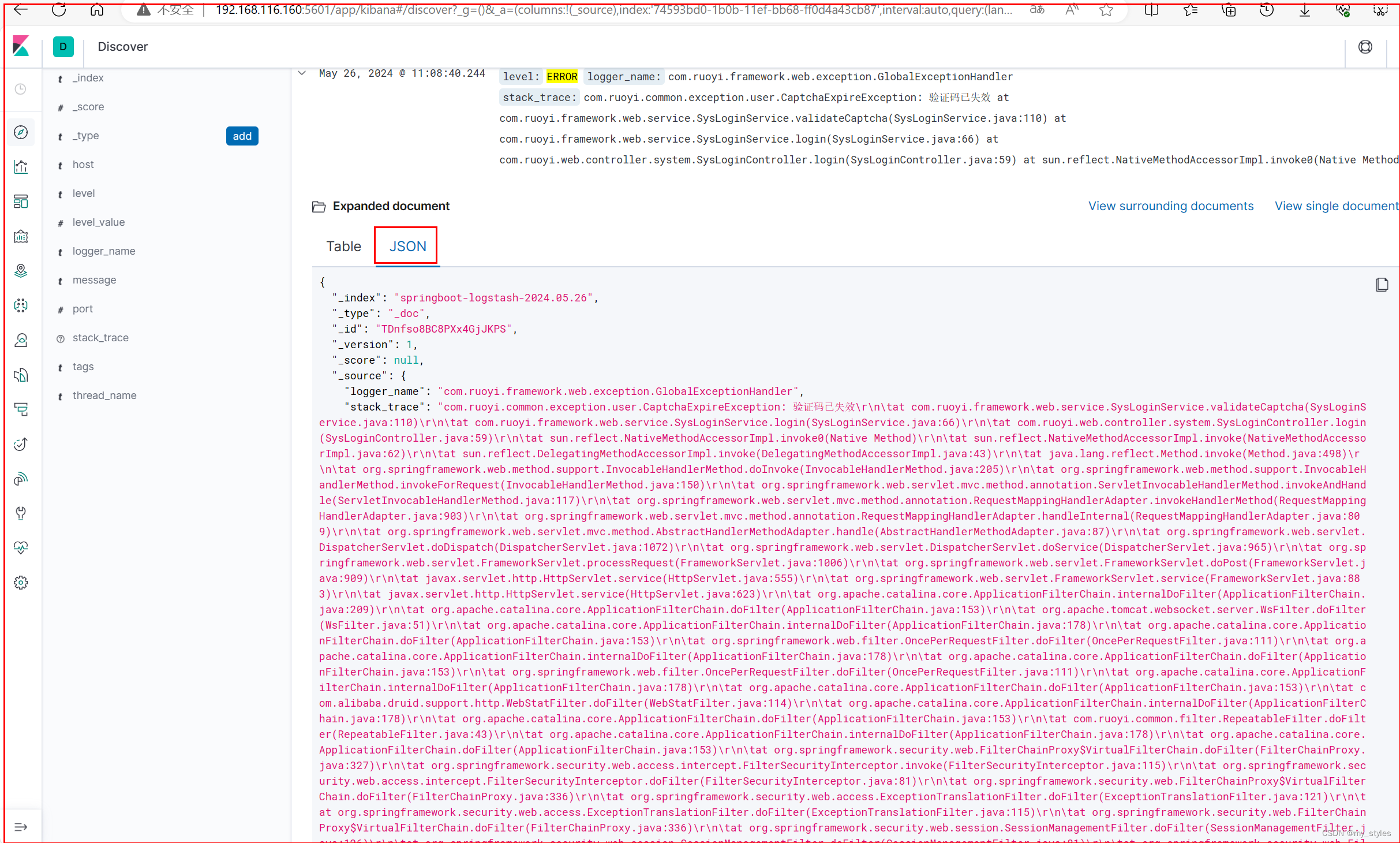

3、查看收集的日志

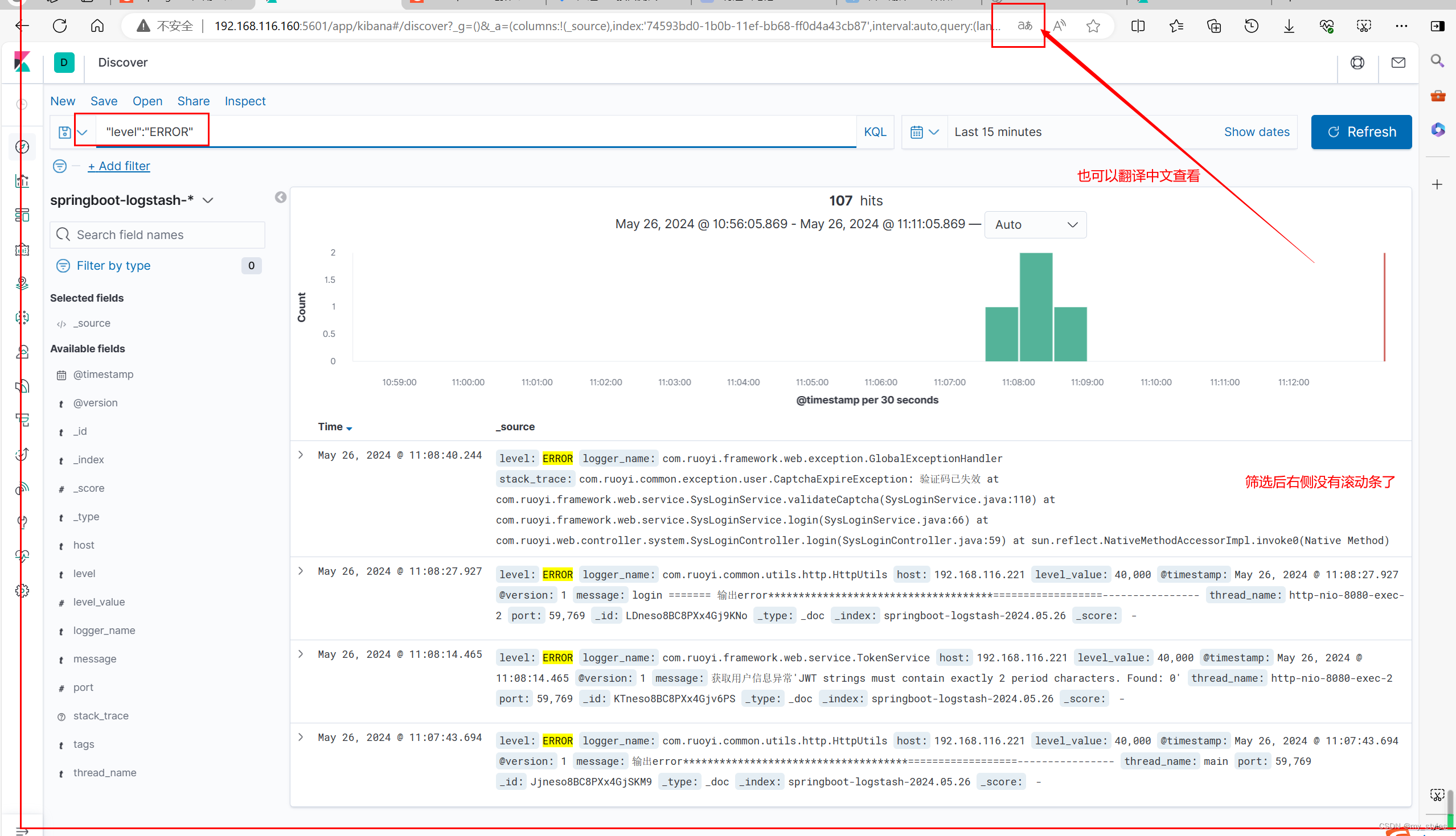

3.1 此时日志比较多 需要筛选日志 "level":"ERROR"

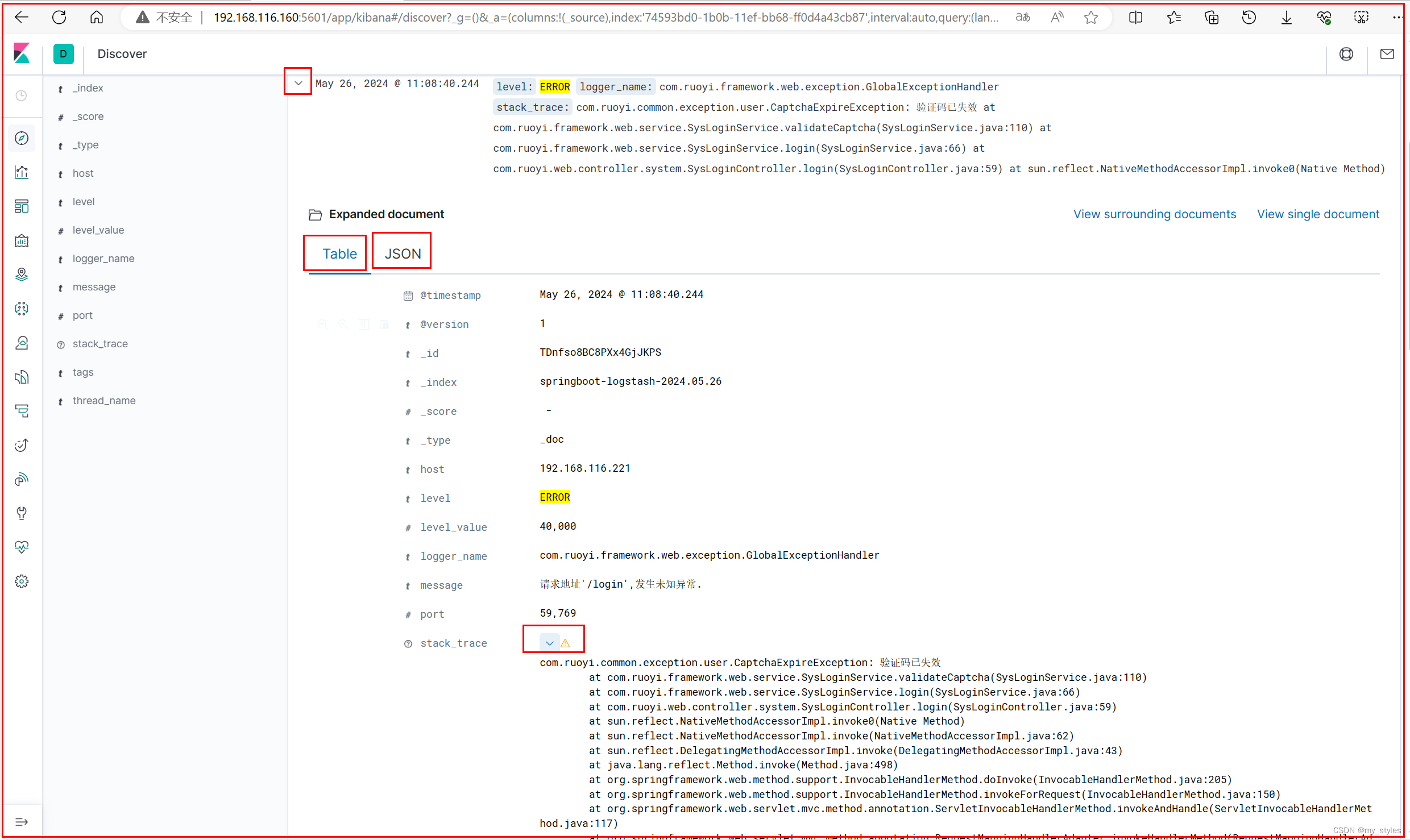

4、查看日志详情

4.1、切换json 查看

这篇关于Java整合ELK实现日志收集 之 Elasticsearch、Logstash、Kibana的文章就介绍到这儿,希望我们推荐的文章对编程师们有所帮助!