短时记忆专题

NLP学习笔记(四):长短时记忆网络

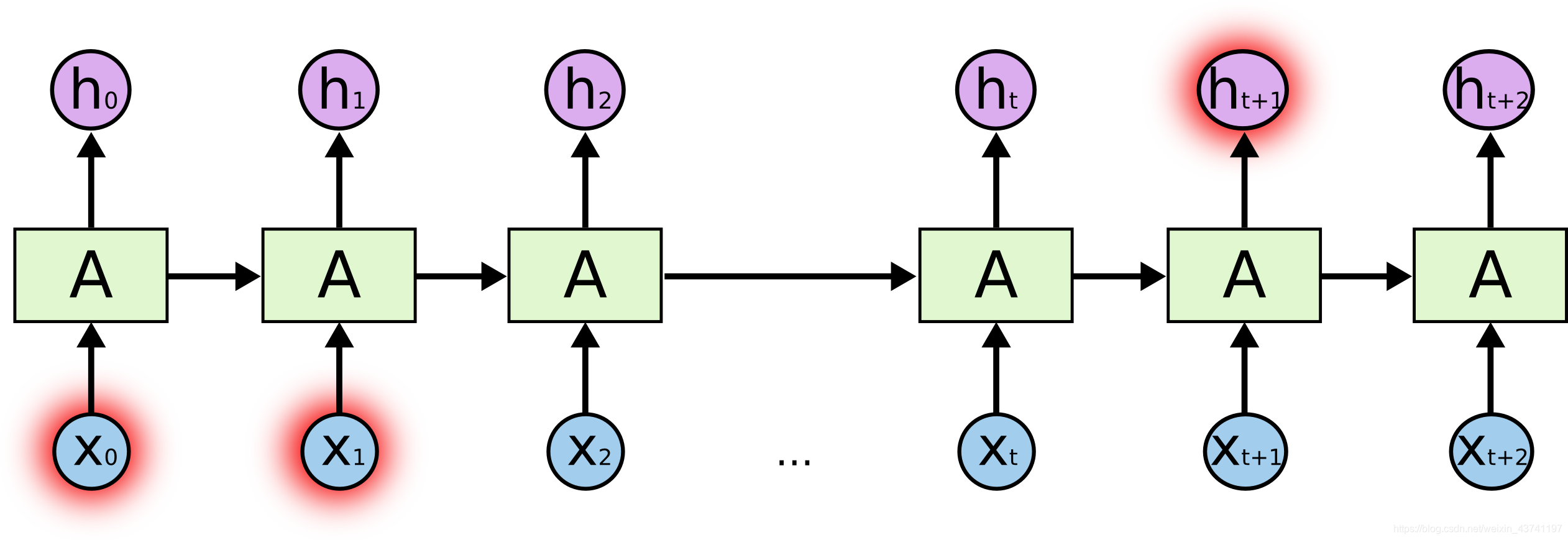

长短时记忆网络(Long Short Term Memory (LSTM)) LSTM 模型 LSTM模型是RNN 模型的改进,可以避免梯度消失的问题,有更长的记忆。 LSTM也是一种循环神经网络,每当读取一个输入x就会更新状态h。LSTM的结构比简单RNN要复杂很多,简单RNN只有一个参数矩阵,LSTM有四个参数矩阵。下面我们具体来看LSTM的内部结构。 LSTM最重要的设计是传输带,记

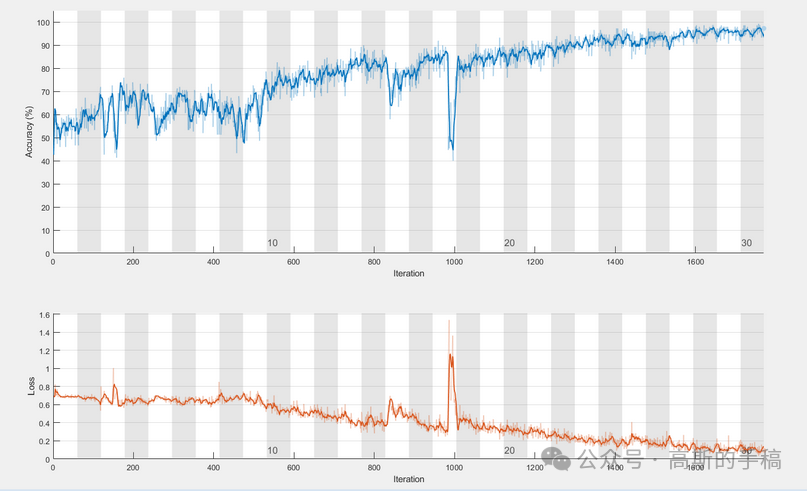

基于双向长短时记忆网络的ECG心电信号识别(包括原始时域信号与时频域特征提取,MATLAB R2021B)

循环神经网络RNN,是一种链式结构,能够对连续输入的序列同时处理,且有不错的效果。RNN具有记忆功能且能够随时接受并处理输入数据,这得益于其特殊的连接方式,即神经元之间以一定的方向互相连接构成环,内部时序状态即时展现。RNN因这种特殊的结构在自然语言处理中得以广泛应用,尤其是在翻译、语音识别和图像处理等领域有更明显的优势。RNN网络结构能够利用历史信息的前提是距离不能太远,在距离较远时记忆效果不理

使用Python实现长短时记忆网络(LSTM)的博客教程

长短时记忆网络(Long Short-Term Memory,LSTM)是一种特殊类型的循环神经网络(RNN),专门设计用来解决序列数据中的长期依赖问题。本教程将介绍如何使用Python和PyTorch库实现一个简单的LSTM模型,并展示其在一个时间序列预测任务中的应用。 什么是长短时记忆网络(LSTM)? 长短时记忆网络是一种循环神经网络的变体,通过引入特殊的记忆单元(记忆细胞)和门控机制,

长短时记忆网络(LSTM)

1. 理解RNN及其局限性 基础知识:首先,你需要了解RNN的基本概念和工作原理,包括它是如何通过时间步处理序列数据的。局限性:掌握RNN面临的主要挑战,特别是梯度消失和梯度爆炸问题,以及这些问题为什么会影响网络学习长期依赖。 2. 学习LSTM的核心概念 LSTM结构:深入了解LSTM单元的结构,包括遗忘门、输入门、输出门以及如何通过这些门控制信息流。长期和短期记忆:理解LSTM是如何同时

为什么LSTM被叫做长短时记忆网络?

因为LSTM long short-term memory是比较长的短时记忆网络,与RNN对比,RNN的记忆单元每一次训练都会更新,但是LSTM因为有forget gate,有的时候记忆单元没有更新,因此这段记忆可以保持较长的时间,这就是长的短时记忆网络。

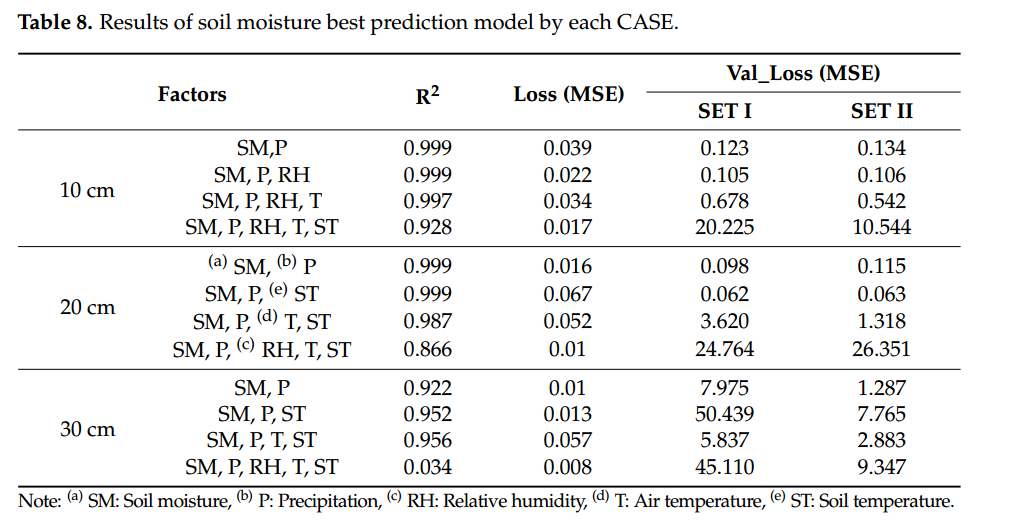

基于循环神经网络长短时记忆(RNN-LSTM)的大豆土壤水分预测模型的建立

Development of a Soil Moisture Prediction Model Based on Recurrent Neural Network Long Short-Term Memory in Soybean Cultivation 1、介绍2、方法2.1 数据获取2.2.用于预测土壤湿度的 LSTM 模型2.3.土壤水分预测的RNN-LSTM模型的建立条件2.4.预测

大致人类应该是短时记忆和利用短时记忆控制利用周围环境达到长期记忆的吧

这里写目录标题 图代码代码解析 图 代码 import timedef route_llm(route_text):passdef write_to_dask(one_sum, one_text, one_path