加速专题

Python使用国内镜像加速pip安装的方法讲解

《Python使用国内镜像加速pip安装的方法讲解》在Python开发中,pip是一个非常重要的工具,用于安装和管理Python的第三方库,然而,在国内使用pip安装依赖时,往往会因为网络问题而导致速... 目录一、pip 工具简介1. 什么是 pip?2. 什么是 -i 参数?二、国内镜像源的选择三、如何

PyInstaller问题解决 onnxruntime-gpu 使用GPU和CUDA加速模型推理

前言 在模型推理时,需要使用GPU加速,相关的CUDA和CUDNN安装好后,通过onnxruntime-gpu实现。 直接运行python程序是正常使用GPU的,如果使用PyInstaller将.py文件打包为.exe,发现只能使用CPU推理了。 本文分析这个问题和提供解决方案,供大家参考。 问题分析——找不到ONNX Runtime GPU 动态库 首先直接运行python程序

机器人助力上下料搬运,加速仓库转运自动化

近年来,国内制造业领域掀起了一股智能化改造的浪潮,众多工厂纷纷采纳富唯智能提供的先进物流解决方案,这一举措显著优化了生产流程,实现了生产效率的飞跃式增长。得益于这些成功案例,某信息技术服务企业在工厂智能物流建设的进程中,也选择了与富唯智能合作。 为了应对日益增长的物料搬运需求,匹配成品输出节拍,该公司引入了富唯智能复合机器人AMR与搬运机器人AGV,实现了仓库成品搬运自动化,大幅减少人工

ACM比赛中如何加速c++的输入输出?如何使cin速度与scanf速度相当?什么是最快的输入输出方法?

在竞赛中,遇到大数据时,往往读文件成了程序运行速度的瓶颈,需要更快的读取方式。相信几乎所有的C++学习者都在cin机器缓慢的速度上栽过跟头,于是从此以后发誓不用cin读数据。还有人说Pascal的read语句的速度是C/C++中scanf比不上的,C++选手只能干着急。难道C++真的低Pascal一等吗?答案是不言而喻的。一个进阶的方法是把数据一下子读进来,然后再转化字符串,这种方法传说中

P0.7全倒装COB超微小间距LED显示屏厂家已量产,加速高清显示的发展

随着P0.7全倒装COB超微小间距LED显示屏技术的成功量产,这一里程碑式的成就不仅标志着高清显示技术迈入了全新纪元,更预示着未来视觉体验将迎来前所未有的变革。各大应用场景,如指挥中心、会议中心、大型活动直播、高端影院乃至家庭娱乐,都将因这项技术而焕发新生。 市场上,消费者对于视觉质量的追求日益高涨,P0.7全倒装COB显示屏以其极致细腻的画质、超高的色彩还原度以及卓越的稳定性,迅速成为行业新宠

鸿蒙(API 12 Beta6版)图形加速【OpenGL ES平台内插模式】超帧功能开发

超帧内插模式是利用相邻两个真实渲染帧进行超帧计算生成中间的预测帧,即利用第N-1帧和第N帧真实渲染帧预测第N-0.5帧预测帧,如下图所示。由于中间预测帧的像素点通常能在前后两帧中找到对应位置,因此内插模式的预测帧效果较外插模式更优。由于第N帧真实渲染帧需要等待第N-0.5帧预测帧生成并送显后才能最终送显,因此会新增1~2帧的响应时延。 OpenGL ES平台 业务流程 基于OpenGL

低代码平台:加速企业制造业数字化转型的新引擎

近期,国家发布了中小企业数字化转型试点城市的政策,旨在通过先行先试,探索支持制造业特别是汽车制造行业数字化转型的有效模式。这一政策的出台,为汽车制造企业的数字化转型提供了强有力的政策支持和方向指引,标志着汽车制造业正迎来一场前所未有的变革。 面对复杂多变的市场需求和日益激烈的市场竞争,汽车制造企业纷纷寻求突破,而低代码平台凭借其快速、灵活、易用的特性,成为了助力这一转型的重要工具。 汽车制造行

word2vec 两个模型,两个加速方法 负采样加速Skip-gram模型 层序Softmax加速CBOW模型 item2vec 双塔模型 (DSSM双塔模型)

推荐领域(DSSM双塔模型): https://www.cnblogs.com/wilson0068/p/12881258.html word2vec word2vec笔记和实现 理解 Word2Vec 之 Skip-Gram 模型 上面这两个链接能让你彻底明白word2vec,不要搞什么公式,看完也是不知所云,也没说到本质. 目前用的比较多的都是Skip-gram模型 Go

免费SSL证书大全,加速普及网站实现HTTPS加密

免费SSL证书大全,加速普及网站实现HTTPS加密 SSL 证书用于加密 HTTP 协议,实现网站通过HTTPS加密协议访问。随着国内外各大网站实现全站 HTTPS 协议,以及搜索引擎对使用 HTTPS 协议网站的更加友好,加之互联网对数据和隐私安全的加强,网站添加 SSL 证书并实现 HTTPS 加密协议访问已经成为趋势和必然。 SSL证书大全zzzjtd.com 而对于给网站添加

当小程序遭遇攻击或超出流量峰值时:SCDN边缘加速的高效防护策略!

在数字化时代,小程序因其便捷性和丰富的功能而备受用户喜爱,但这也使其成为了网络攻击的目标之一。DDoS攻击、CC攻击等不仅会影响小程序的正常运行,还会损害用户体验和品牌形象。在这种情况下,选择合适的安全防护措施至关重要。边缘加速提供了一体化的分布式安全防御解决方案,能够有效应对这些问题。 Edge SCDN边缘加速的核心功能 Edge SCDN边缘加速是一款一体化分布式安全防御产品,它不仅提供

pip 间接通过多个 CPU 来加速安装 wheel

pip 间接通过多个 CPU 来加速安装 wheel pip install 和 wheel 本身并没有直接支持通过多个 CPU 来加速安装。然而,你可以使用以下方法间接加速安装过程: 并行编译: 对于需要编译的 Python 包(比如某些包含 C/C++ 代码的包),可以通过设置环境变量来并行编译,这样就可以利用多个 CPU 核心来加速编译过程。 export MAKEFLA

828华为云征文|使用sysbench对Mysql应用加速测评

文章目录 ❀前言❀测试环境准备❀测试工具选择❀测试工具安装❀mysql配置❀未开启Mysql加速测试❀开启Mysql加速测试❀总结 ❀前言 大家好,我是早九晚十二。 昨天有梳理一篇关于华为云最新推出的云服务器产品Flexus云服务器X。当时有说过,这次的华为云Flexus云服务器X带了应用加速的功能,有MySQL,Redis,NGINX三种选择。并且服务器性能较同类产品有了大量优

如何应对日益复杂的网络攻击?Edge SCDN(边缘安全加速)的应用场景探讨

CDN作为提高网站访问速度和内容分发效率的安全与加速产品,它能够有效减少服务器负载、降低网络延迟,从而提升用户体验和网站的可用性。然而,随着互联网技术的发展和网络攻击形式的日益复杂多样,用户对数据安全性和隐私保护的要求不断提高,对网站和应用的要求也不再只停留在加速上。 当传统CDN逐渐没办法满足当前企业对全方位网络攻击防护的需求时,不少安全厂商开始推出新一代CDN产品,开始将安全防护机制融入

GAMES202——作业5 实时光线追踪降噪(联合双边滤波、多帧的投影与积累、À-Trous Wavelet 加速单帧降噪)

任务 1.实现单帧降噪 2.实现多帧投影 3.实现多帧累积 Bonus:使用À-Trous Wavelet 加速单帧降噪 实现 单帧降噪 这里实现比较简单,直接根据给出的联合双边滤波核的公式就能实现 Buffer2D<Float3> Denoiser::Fil

Gemini 能力加持,Google Workspace 如何加速业务创新协作?

想象一下,借助 Gemini for Google Workspace,你在工作时就会多一位神奇的伙伴。 作为全球最受欢迎的办公协同工具,Google Workspace 拥有超过 30 亿用户和 1000 万付费客户,每天都在帮助你我高效完成工作。 试想一下,如果 Google Workspace 能够融入生成式 AI 的创新驱动力,用户在日常办公时会收获怎样的效果呢? 想你所想!今天,我们

Android Studio配置阿里云镜像地址,加速依赖资源下载

背景 平时安卓项目编译较慢,其中一个原因就是要下载依赖资源包比较慢。为了解决这个问题,可以配置阿里云镜像,加速下载。 配置方法 对所有项目生效在USER_HOME/.gradle/下创建init.gradle文件,内容如下: allprojects{repositories {def ALIYUN_REPOSITORY_URL = 'http://maven.aliyun.com/nexu

比亚迪方程豹携手华为乾崑智驾,加速中国智驾技术向前

近日,比亚迪方程豹与华为乾崑智驾在深圳签署合作协议,中国两大科技巨头强强联合,共同合作开发全球首个硬派专属智能驾驶方案,实现整车智驾深度融合,首发搭载在即将上市的方程豹豹8车型。 比亚迪智驾以自主研发和开放合作双线进行,加速中国智驾向前 在智驾领域,比亚迪坚持独立自主研发与开放合作的双线进行。 在标准化智驾平台上,比亚迪既有全栈自研的高阶智驾“天神之眼”上车,并在腾势、王朝、海洋等多款车

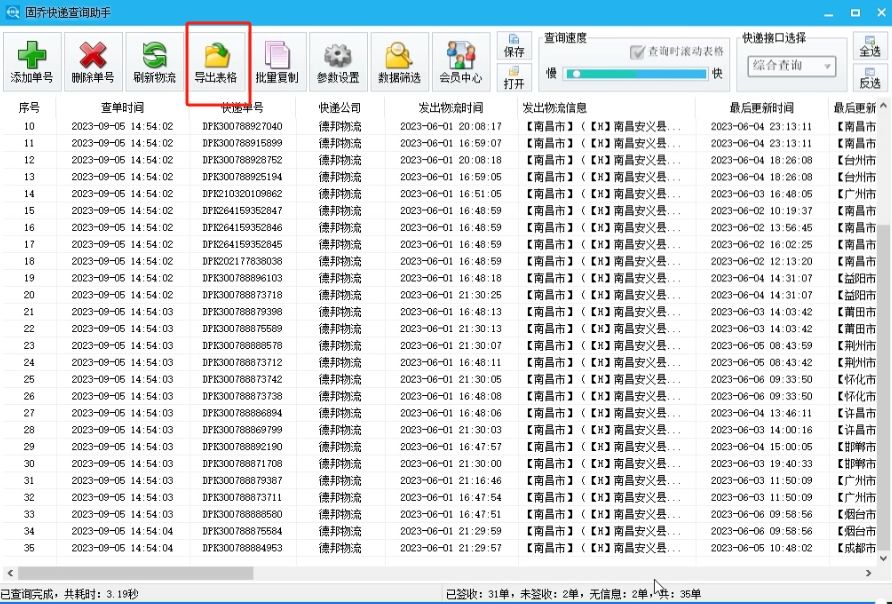

加速电商物流效率:推荐几款实用的快递批量查询工具

做电商必不可少的快递批量查询平台分享:固乔快递查询助手使用全攻略 在电商行业日益竞争的今天,高效管理物流信息成为了商家们不可或缺的一环。面对每天成百上千的订单和快递单号,如何快速、准确地查询并跟踪物流状态,成为了电商卖家们亟需解决的问题。今天,我将向大家分享一款专为电商设计的快递批量查询平台——固乔快递查询助手,并详细介绍其使用方法。 一、软件下载与安装 首先,我们需要在浏览器中搜索“固乔科

docker(2)——docker的安装与运行以及下载加速

首先,我们要搭建自己的实验环境,环境选择:容器需要管理工具、runtime和操作系统。我们的选择如下: (1)管理工具:docker engine(目前最流行使用) (2)runtime-runc(docker默认的runtime) (3)操作系统——ubuntu(自己用vmware装个虚拟机) 安装流程如下: 配置Docker的apt源 1、安装包,允许apt

加速 PyTorch 模型:使用 ROCm 在 AMD GPU 上应用 torch.compile

Accelerate PyTorch Models using torch.compile on AMD GPUs with ROCm — ROCm Blogs 介绍 PyTorch 2.0 引入了一个名为*torch.compile()*的工具,可以极大地加速 PyTorch 代码和模型。通过将 PyTorch 代码转换为高度优化的内核,`torch.compile` 在现有代码库上进行

github在线加速下载

1. 第一个网站 https://github.moeyy.xyz/ 把需要下载的链接复制进去,点下载 https://github.com/dotnet/sdk/archive/refs/tags/v8.0.400.zip 2. 第二个网站 https://gh-proxy.com/

爬虫 headless 访问 知道创宇 加速乐 CDN 网站

通过 requests.get 直接请求网站首页,返回 521 错误提示码,返回结果是js代码。这是采用加速乐反爬技术,在访问前先判断客户端的cookie是否正确,如果不正确,返回521状态码和一段js代码,并且进行set-cookie操作,返回的js代码经过浏览器执行又会生成新的cookie,这两个cookie一起发送给服务器,才会返回正确的网页内容 试了下代码demo如下,有cookie就带上

Kimi浏览器助手,一键加速浏览器搜索工作效率!

在这个信息数字化时代,我们每个人都像是一名信息的探险家,每天在网络的海洋中寻找着知识与答案。而Kimi浏览器插件助手,就像是我们手中的罗盘,指引我们以更快的速度抵达搜索获取结果。它在实际使用中是如何帮助我们提升效率的。 一、Kimi浏览器助手简介 Kimi浏览器助手是一款功能丰富的浏览器扩展程序,它通过一系列智能工具,旨在简化我们的网络搜索使用体验,提高我们的工作效率。

新材料正在加速推动压铸领域3D打印技术应用

3D打印技术,以其独特的逐层累加粉末材料成型方式,正逐步解锁模具制造的无限可能,尤其在实现复杂几何构型与内部结构优化方面展现出非凡潜力。这一技术革新不仅提升了模具制造的精度与效率,还通过随形水路、随形透气钢等创新设计,满足了现代制造业对模具性能的极致追求。 然而,尽管3D打印在注塑模具领域的应用已趋成熟,其在压铸模等高温高压作业环境中的推广却面临材料瓶颈,市场上缺乏专为3D打印设计的、能够胜

上传拍摄素材和后期剪辑素材太慢?镭速助力企业加速大文件传输

随着时光的流逝,当代人对视觉体验的要求越来越高,每一帧画面都追求极致的清晰度与细腻感。这无疑为影视制作带来了机遇,同时也带来了挑战。高清4K、8K视频等大文件的传输需求日益增长,传统的FTP、HTTP等数据传输方式已难以满足行业的需求。那么,如何满足影视制作行业对大文件传输的高效需求呢? 面对拍摄素材庞大、后期传输缓慢的问题,镭速传输技术为影视行业提供了加速大文件传输的解决方案。 大文

es重启后调大恢复并发参数,加速分片分配

通过执行 GET /_cluster/allocation/explain 查看当前索引分配详情 "deciders": [{"decider": "throttling","decision": "THROTTLE","explanation": "reached the limit of outgoing shard recoveries [2] on the node [6gauyszJR