squeeze专题

tf.squeeze/tf.expand_dims

在git上的FM开源代码中看到了这样子的用法 https://github.com/Aifcce/FM-FFM/blob/master/model/FM.py batch_weights = tf.squeeze(batch_weights, axis=2) df_v = tf.expand_dims(df_v, axis=2) tf.squeeze是降维,把维度为1的去掉,我的理

10,09_维度变换,view、reshape,unsqueeze,Squeeze,expand,repeat,矩阵转置,transpose维度交换,permute,Broadcasting

1.9.Tensor维度变换 1.9.1.view、reshape 1.9.2.unsqueeze 1.9.3.Squeeze 1.9.4.expand 1.9.5.repeat 1.9.6.矩阵转置 1.9.7.transpose维度交换 1.9.8.permute 1.10.Broadcasting 1.9.Tensor维度变换 1.9.1.view、reshape 1.两者功能一样:将

Pytorch实用教程:Pytorch中tensor.size()用法 | .squeeze()方法

文章目录 Pytorch中tensor变量.size(0)示例在不同上下文中的用法更广泛的用法 .squeeze()参数解释`.squeeze(-1)` 的作用使用场景示例 Pytorch中tensor变量.size(0) 在 PyTorch 中,tensor.size(0) 是用来获取张量(Tensor)第一个维度的大小的一种方法。这里的“0”指的是第一个维度的索引,因为

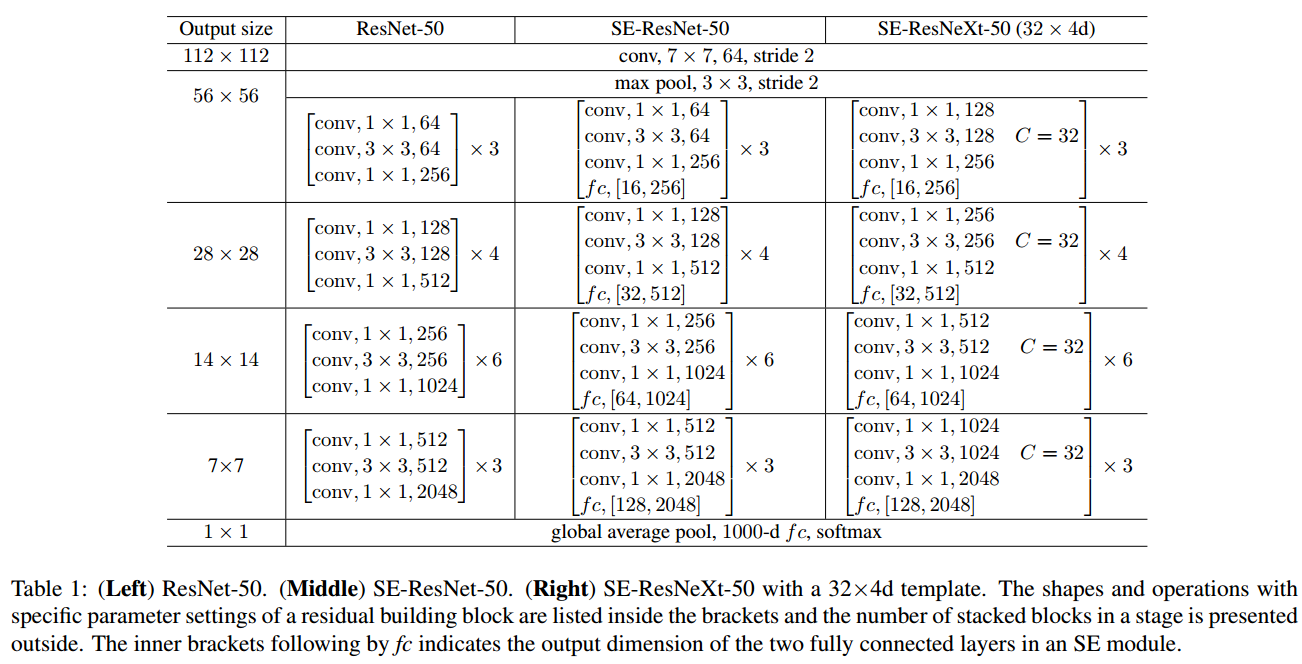

SE注意力模块学习笔记《Squeeze-and-Excitation Networks》

Squeeze-and-Excitation Networks 摘要引言什么是全局平均池化? 相关工作Deep architectures Squeeze-and-Excitation Blocks3.1. Squeeze: Global Information Embedding3.2. Excitation: Adaptive Recalibration3.3. Exemplars: S

tensorflow中的tf.expand_dims和tf.squeeze函数

转自:龙骨 tf.expand_dims() Function tf.expand_dims(input, axis=None, name=None, dim=None) Inserts a dimension of 1 into a tensor’s shape. 在第axis位置增加一个维度 Given a tensor input, this operation inser

squeeze()和abs()、a.shape

1、 abs() 是得到绝对值 eg: >>abs(-1) >>1 2、 a如果是个矩阵,a.shape得到的是a的维度,若a是2*2,则a.shape得到(2,2) 3、 numpy.squeeze(a, axis=None) squeeze()函数的功能是:从矩阵shape中,去掉维度为1的。例如一个矩阵是的shape是(5, 1),使用过这个函数后,结果为(5,)。 参

Pytorch当中squeeze(1)函数和unsqueeze(1)函数的区别及含义

一、squeeze(1) 在 PyTorch 中,.squeeze(1) 是用于张量维度操作的方法之一,它的作用是将张量中尺寸为 1 的维度压缩(去除)掉。 具体来说,如果张量在指定维度(这里是维度 1)上的尺寸为 1,.squeeze(1) 方法将会移除这个维度,从而减少张量的维度数。 举例说明,假设有一个形状为 (A, 1, B, C) 的张量,其中维度 1 的尺寸为 1。使用 .squ

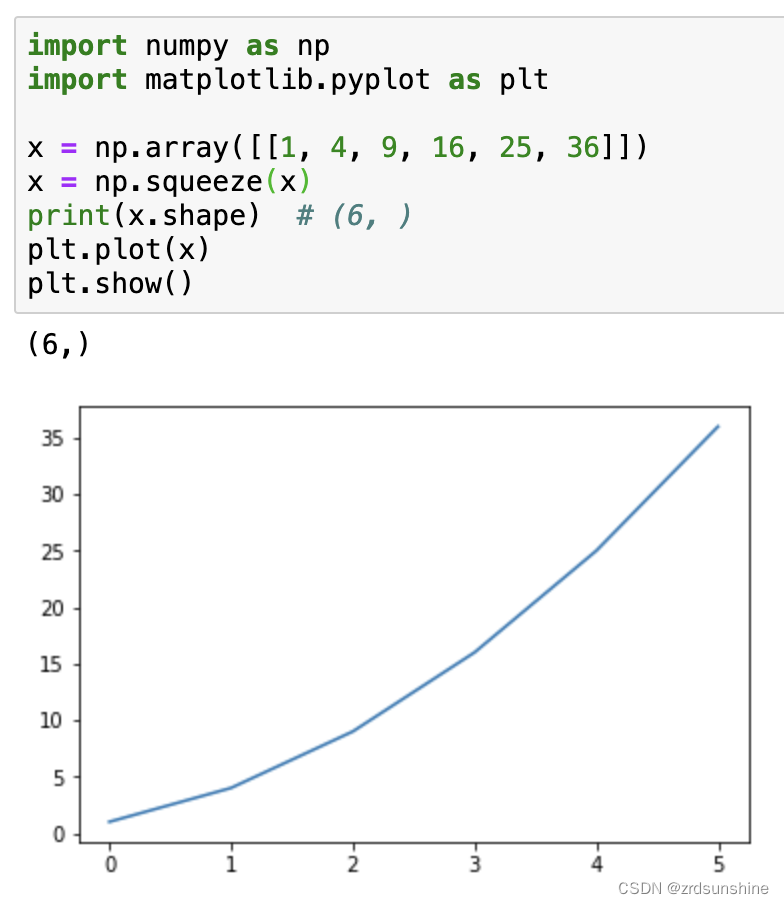

np.array无法直接用matplotlib画图,因为需要借用np.squeeze先转化

文章目录 前言一、使用步骤1.没使用np.squeeze转化2.使用np.squeeze转化 前言 实际工作中,时而难免会遇见np.array无法直接用matplotlib画图的情况,这个时候,是因为在画图之前少了一个步骤,需要先借用np.squeeze先转化 一、使用步骤 1.没使用np.squeeze转化 实例及运行效果: import numpy as n

PyTorch中torch.squeeze() 和torch.unsqueeze()用法

squeeze的用法主要就是对数据的维度进行压缩或者解压 torch.squeeze() 对数据的维度进行压缩 https://pytorch.org/docs/stable/torch.html?highlight=torch%20squeeze#torch.squeeze (a) 去掉维数为1的的维度,比如是一行或者一列这种,一个一行三列(1,3)的数去掉第一个维数为一的维度之后就变成(

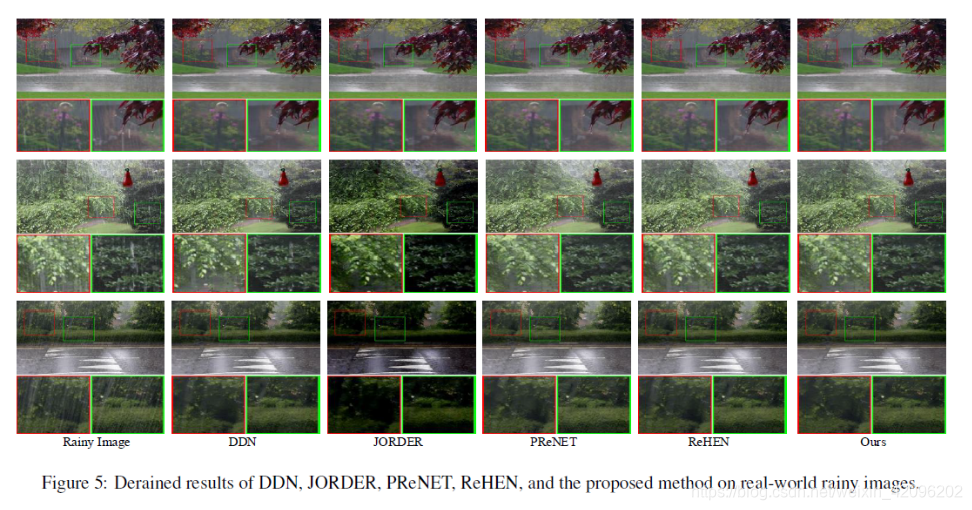

RSEN-25FPS实时图像去雨算法 | Residual Squeeze-and-Excitation Network for Fast Image Deraining

首先,从论文创新方面来说,可以说是毫无创新。但是,其25FPS的速度对于图像去雨来说还是一个很好很实用的模型,而且性能还能够SOTA! 论文地址:https://arxiv.org/pdf/2006.00757.pdf Abstract: 图像去雨是一项重要的图像处理任务,因为雨水条纹不仅会严重降低图像的视觉质量,而且还会严重影响高级视觉任务的性能。传统方法通过不同的递归神经网络逐步消

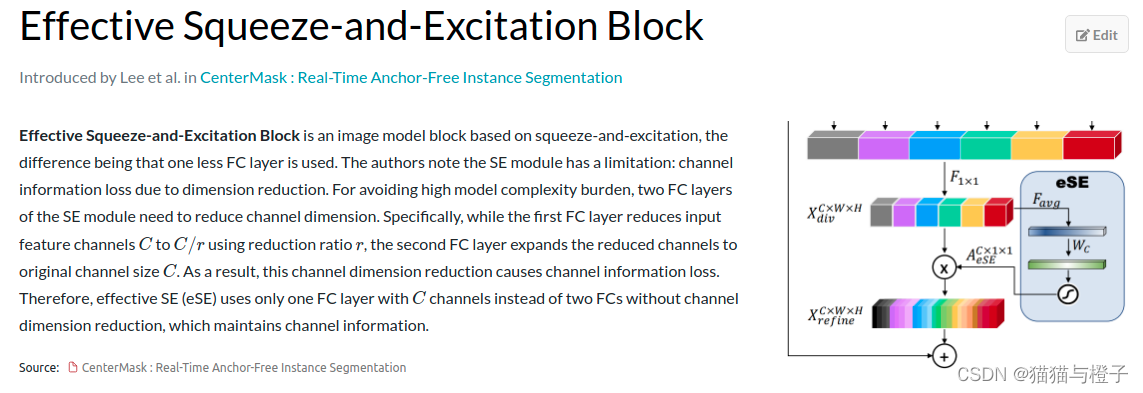

【注意力】ESE:Effective Squeeze-and-Excitation Block

原文:https://arxiv.org/pdf/1911.06667.pdf ESE(Effective Squeeze and Extraction) layer是模型中的一个block,基于SE(Squeeze and Extraction)而来。与SE的区别在于,ESE block只有一个fc层,《CenterMask : Real-Time Anchor-Free Instanc

C语言中squeeze的作用,squeeze technique关于防御性驾驶

1 驾驶机动车在没有施划停车泊位的道路上临时停车,要紧靠左侧路边逆向停放。查看本题分析 2 这个标志的含义是提醒车辆驾驶人前方是单向行驶并且照明不好的涵洞。查看本题分析 3 允许自学直考人员使用图中教练车,在学车专用标识签注的指导人员随车指导下学习驾驶。查看本题分析 4 车辆下坡行驶,要适当控制车速,充分利用发动机进行制动。查看本题分析 5 驾驶人在一个记分周期内累积记分达到12分的,交通警

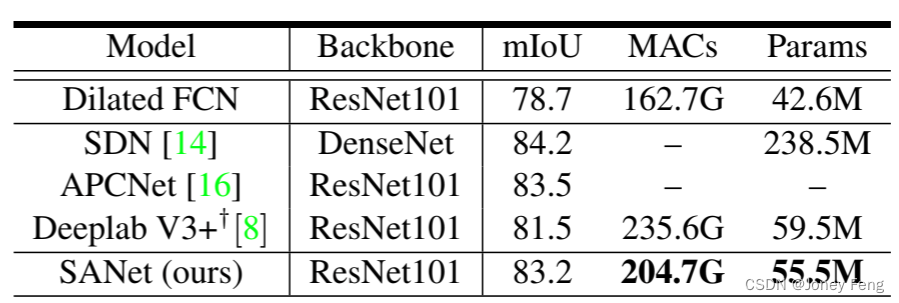

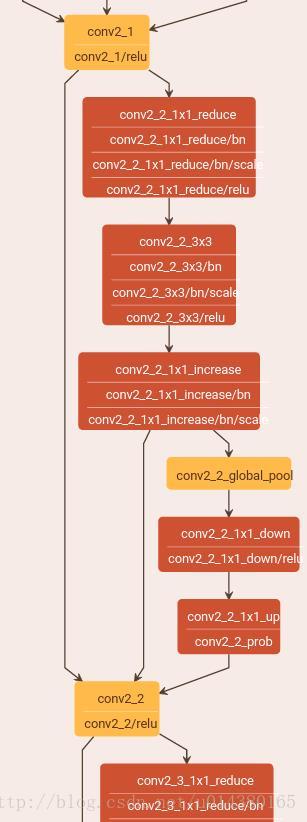

Squeeze-and-Attention Networks for Semantic Segmentation

0.摘要 最近,将注意力机制整合到分割网络中可以通过更重视提供更多信息的特征来提高它们的表征能力。然而,这些注意力机制忽视了语义分割的一个隐含子任务,并受到卷积核的网格结构的限制。在本文中,我们提出了一种新颖的squeeze-and-attention网络(SANet)架构,利用一个有效的squeeze-and-attention(SA)模块来考虑分割的两个独特特征:i)像素组注

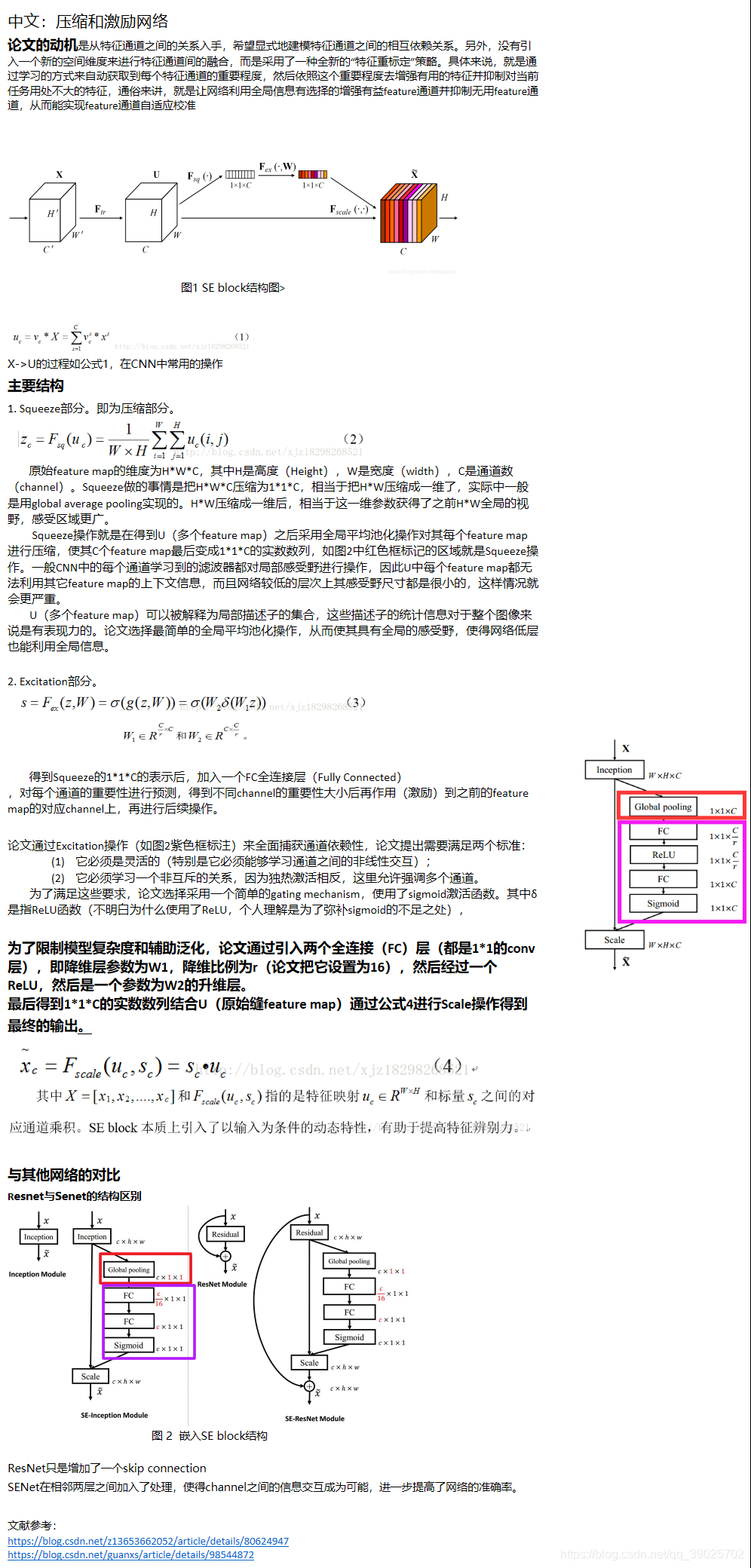

SENet(Squeeze-and-Excitation Networks)算法笔记

-SENet(Squeeze-and-Excitation Networks)算法笔记 –通过学习的方式来自动获取到每个特征通道的重要程度,然后依照这个重要程度去提升有用的特征并抑制对当前任务用处不大的特征 Momenta详解ImageNet 2017夺冠架构SENet 转自机器之心专栏 作者:胡杰 本届 CVPR 2017大会上出现了很多值得关注的精彩论文,国内自动驾驶创业公司 Momen

Pytorch:cat、stack、squeeze、unsqueeze的用法

Pytorch:cat、stack、squeeze、unsqueeze的用法 torch.cat 在指定原有维度上链接传入的张量,所有传入的张量都必须是相同形状 torch.cat(tensors, dim=0, *, out=None) → Tensor tensor:相同形状的tensor dim:链接张量的维度,不能超过传入张量的维度 x = torch.tensor([[