neurons专题

吴恩达机器学习-可选实验室:神经元和层(Neurons and Layers)

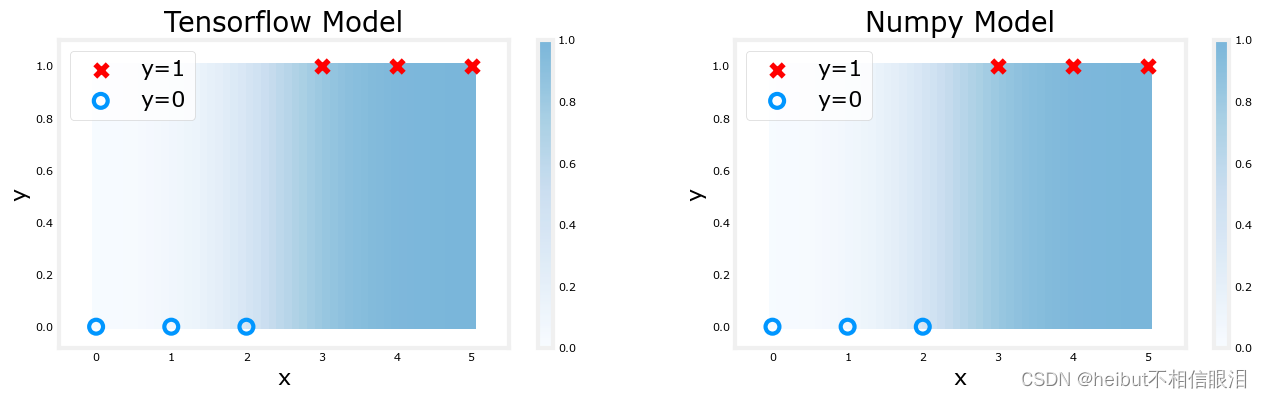

文章目录 可选实验室:神经元和层包无激活神经元-回归/线性模型Sigmoid激活的神经元祝贺 可选实验室:神经元和层 实验室将探索神经元和层的内部工作原理,特别是将课程1中掌握的模型,即回归/线性模型和逻辑斯蒂模型,与之进行对比。本实验室将介绍Tensorflow并演示这些模型是如何在该框架中实现的。 包 Tensorflow和Keras Tensorflow是谷歌开发的

【知识蒸馏2018】Knowledge Transfer via Distillation of Activation Boundaries Formed by Hidden Neurons

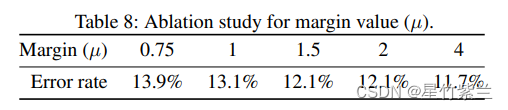

【知识蒸馏2018】Knowledge Transfer via Distillation of Activation Boundaries Formed by Hidden Neurons 论文: https://arxiv.org/pdf/1811.03233.pdf 目录 一 主要思想:二 问题来源及推导模型:1. 问题及推导2.补充: 三 实验结果: 一 主要思想:

CS229 6.15 Neurons Networks Deep Belief Networks

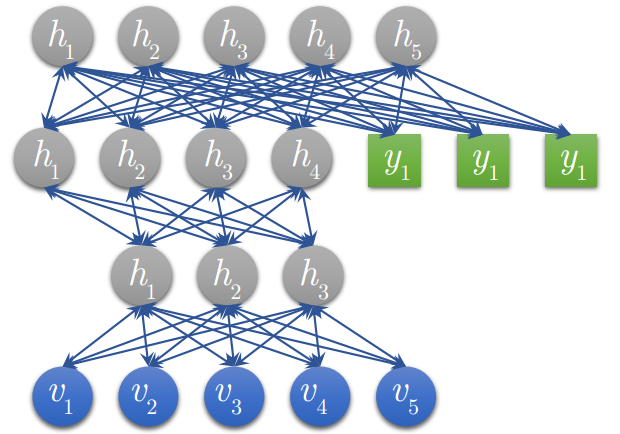

Hintion老爷子在06年的science上的论文里阐述了 RBMs 可以堆叠起来并且通过逐层贪婪的方式来训练,这种网络被称作Deep Belife Networks(DBN),DBN是一种可以学习训练数据的高层特征表示的网络,DBN是一种生成模型,可见变量 与 个隐层的联合分布: 这里 x = h0,为RBM在第 k 层的隐层单元条件下的可见单元的条件分布, 是一个DBN顶部可见层与隐

(六)6.15 Neurons Networks Deep Belief Networks

Hintion老爷子在06年的science上的论文里阐述了 RBMs 可以堆叠起来并且通过逐层贪婪的方式来训练,这种网络被称作Deep Belife Networks(DBN),DBN是一种可以学习训练数据的高层特征表示的网络,DBN是一种生成模型,可见变量 与 个隐层的联合分布: 这里 x = h0,为RBM在第 k 层的隐层单元条件下的可见单元的条件分布, 是一个DBN顶部可见层与隐

Synthesizing the preferred inputs for neurons in neural networks via deep generator networks

该算法(1)生成质量上最先进的合成图像,看起来几乎是真实的;(2)以可解释的方式揭示每个神经元学习的特征;(3)对新的数据集有很好的概括性,对不同的网络结构也有一定的概括性,而不需要重新学习先验;(4)可以被视为一种高质量的生成方法(在这种情况下,通过生成新颖、创造性、有趣、可识别的图像)。 1 Introduction and RelatedWork 受这类神经科学研究的启发,我们有兴趣通过

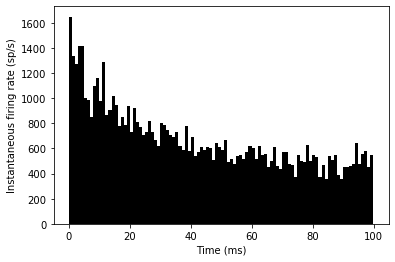

Brian2 学习笔记(1)-Introduction to Brian part 1: Neurons

原址链接:http://brian2.readthedocs.io/en/stable/introduction/index.html 第一次更新:2018年6月2日 Brian是一款面向SNN(spiking neural network)的模拟器。模拟器主体使用python语言,具有简单易学、灵活和可扩展的功能,旨在降低模拟计算的时间。 注:模拟器还有一些其他重要的特性,例如运用多核甚至计算集